【强化学习的稳定性与收敛性分析】:从理论到实践的挑战与解决方案

发布时间: 2024-09-02 14:20:08 阅读量: 128 订阅数: 21

# 1. 强化学习基础

## 简介

强化学习是人工智能领域的一个重要分支,它通过与环境的互动来学习最优策略,即在给定状态下采取哪些行动能最大化累积奖励。这种学习方式特别适用于那些缺乏明确指导或样本数据的问题。

## 基本概念

在强化学习中,存在两个主要概念:智能体(Agent)和环境(Environment)。智能体负责做出决策并执行动作,而环境则根据智能体的行为给予反馈,通常是奖励(Reward)或惩罚。

## 马尔可夫决策过程(MDP)

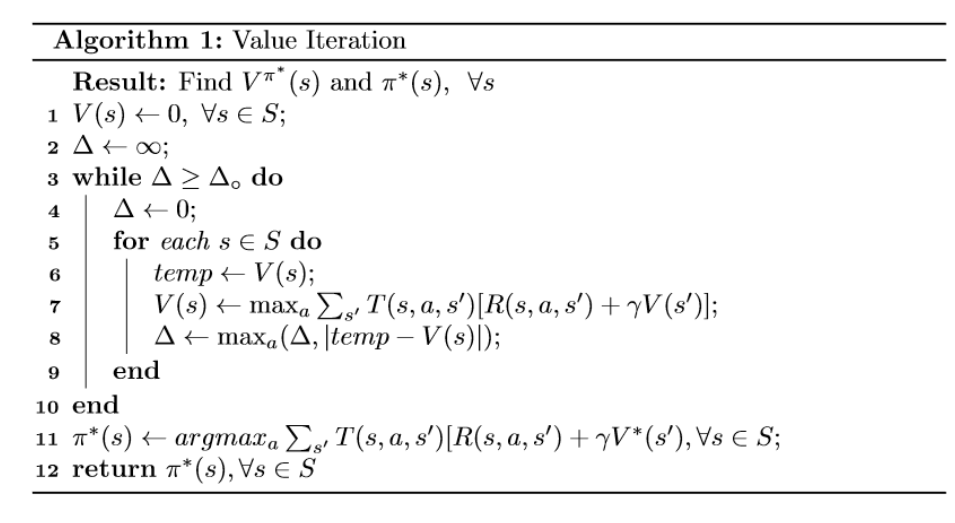

马尔可夫决策过程是强化学习中处理状态转换和奖励计算的核心数学模型。它定义了一个五元组 (S, A, P, R, γ),其中:

- S 表示状态空间

- A 表示动作空间

- P 表示状态转移概率函数 P(s'|s,a)

- R 表示奖励函数 R(s,a,s')

- γ 表示折扣因子,用于计算累积奖励的现值

强化学习的目标是找到一个策略 π,它能最大化累积奖励。策略可以是确定性的(直接映射状态到动作)或随机性的(映射状态到动作的概率分布)。通过评估不同策略的效果,智能体学习并迭代地改进其行为以达到目标。

下一章节将深入讨论强化学习中的稳定性与收敛性,这是衡量算法性能和学习效率的关键指标。

# 2. 稳定性与收敛性理论分析

在强化学习的理论基础之上,稳定性与收敛性的探讨成为理解和提高算法表现的关键。稳定性确保了学习过程中策略的连续性,而收敛性则保证了算法能够最终达到最优解或满意解。本章将深入探讨稳定性与收敛性的理论框架、它们之间的关系,以及如何通过理论指导实践。

## 2.1 强化学习稳定性理论

稳定性是强化学习中描述策略随时间变化是否保持一致性的核心概念。它直接关系到学习算法能否在面对环境变化时保持鲁棒。

### 2.1.1 稳定性的定义和重要性

在数学上,稳定性通常与系统状态在受到扰动后是否能返回到平衡点有关。在强化学习的上下文中,稳定性可以视为一个策略在学习过程中是否能够对抗噪声和不确定性而保持一致。

对于一个强化学习算法而言,稳定性的重要性体现在以下几个方面:

1. **避免策略震荡**:稳定性确保在训练过程中策略不会出现剧烈的摆动,从而避免了震荡带来的性能下降。

2. **提高学习效率**:稳定的策略更新能够使学习过程更有效率,因为每次迭代都是基于前一次迭代的稳定状态。

3. **保障性能下限**:稳定性还可以作为性能的保障,即便在复杂环境中,一个稳定的学习过程也能保证算法维持在一定的性能水平之上。

### 2.1.2 稳定性的数学模型

为了形式化地描述稳定性的概念,研究者提出了多种数学模型。其中,最著名的模型之一是使用马尔可夫决策过程(MDP)框架下的贝尔曼方程来定义稳定性。

贝尔曼方程表达了当前状态的价值函数与下一状态的价值函数之间的关系:

\[ V(s) = R(s) + \gamma \sum_{s'} P(s'|s) V(s') \]

其中,\( V(s) \) 是状态 \( s \) 的价值函数,\( R(s) \) 是即时奖励,\( \gamma \) 是折扣因子,\( P(s'|s) \) 是从状态 \( s \) 到 \( s' \) 的转移概率。

策略的稳定性可以通过分析策略如何影响价值函数的变化来进行度量。当策略发生微小变化时,如果价值函数的更新也能保持在一个很小的范围内,则称这个策略是稳定的。

## 2.2 强化学习收敛性理论

收敛性关注的是学习算法是否能够达到某个目标,比如最大化累积奖励或者达到某个性能标准。

### 2.2.1 收敛性的定义和标准

在强化学习中,收敛性通常与策略或价值函数的优化过程相关。具体地:

- **策略收敛**:指的是在学习过程中,策略逐步接近某个最优策略。

- **价值函数收敛**:指的是价值函数逐步接近真实的最优价值函数。

收敛性的标准可以具体定义为:

1. **绝对收敛**:策略或者价值函数达到一个固定点不再变化。

2. **相对收敛**:策略或者价值函数的变化在可接受的误差范围内,变化非常小。

### 2.2.2 收敛性分析的方法论

为了分析强化学习算法的收敛性,研究者通常会采用以下几种方法:

1. **不动点理论**:利用不动点理论可以证明某些特定策略迭代算法的收敛性。

2. **动态规划**:通过动态规划中的收敛性定理来证明策略评估过程的收敛性。

3. **随机逼近**:使用随机逼近理论分析基于抽样的策略迭代过程的收敛性。

此外,对于深度强化学习等复杂场景,通常会引入一些经验性的假设和定理来证明收敛性。

## 2.3 稳定性与收敛性的关系

稳定性与收敛性之间存在着密切的关系。在大多数情况下,一个稳定的算法更容易保证收敛到最优解。

### 2.3.1 稳定性对收敛性的影响

稳定性对收敛性的影响可以体现在以下几个方面:

1. **稳定性作为收敛的前提**:在不稳定的情况下,策略可能会不断摆动,这使得收敛性难以得到保证。

2. **稳定性作为收敛的保障**:只有当算法稳定地进行更新时,才能够确信学习过程是在朝向正确的方向前进。

### 2.3.2 收敛性对稳定性的依赖

收敛性也对稳定性有依赖性:

1. **收敛性是稳定性的目标**:稳定性的一个重要目标是保证算法的收敛性。

2. **收敛性能够提供稳定性的反馈**:通过分析收敛过程中的策略变化,可以反过来调整稳定性条件,进一步提高算法表现。

为了平衡稳定性和收敛性,常常需要在算法设计时进行权衡。例如,在一些强化学习算法中,可能会牺牲一定的稳定性以追求更快的收敛速度。

```mermaid

graph LR

A[开始] --> B[定义稳定性和收敛性]

B --> C[稳定性分析]

B --> D[收敛性分析]

C --> E[稳定性对收敛性的影响]

D --> F[收敛性对稳定性依赖]

E --> G[权衡稳定性与收敛性]

F --> G

G --> H[设计高效强化学习算法]

```

在本节中,我们从理论上分析了强化学习的稳定性与收敛性,并探讨了它们之间的关系。稳定性是收敛性的基础,而收敛性是稳定性存在的意义。下一章我们将深入探讨强化学习在面对实践中的挑战,以及如何应用稳定性与收敛性理论来克服这些挑战。

# 3. 强化学习实践挑战

## 3.1 环境动态性和不确定性

强化学习中的智能体在与环境进行互动时,常常面临复杂且不断变化的环境条件。环境的动态性和不确定性对强化学习算法的稳定性和收敛性带来了不小的挑战。

### 3.1.1 环境建模的难点

在构建强化学习模型时,准确地对环境进行建模是至关重要的。然而,现实世界的环境往往过于复杂,使得全面且精确的环境模型难以构建。环境模型不仅要描述当前的环境状态,还要能够预测环境未来的变化。随着环境复杂度的增加,模型中潜在的不确定性和动态变化的可能性也会增加。此外,环境模型如果过于简化,则无法准确反映真实世界中的复杂交互,而如果模型过于复杂,又会导致计算开销过大,甚至出现过拟合现象。

### 3.1.2 非确定性环境下的策略调整

在动态和不确定的环境中,强化学习智能体必须能够根据环境的变化及时调整自己的策略。这要求智能体不仅要能够从经验中学习,还要能够预测环境未来的变化,并据此制定出灵活的应对策略。在非确定性环境下,智能体可能需要更多地依赖于探索性行为以获得对环境的更深入理解。而探索和利用之间的平衡是实现智能体长期学习目标的关键。

## 3.2 函数逼近与泛化误差

在处理高维状态空间和复杂任务时,函数逼近技术是强化学习中的重要工具。它允许智能体使用有限的样本数据来近似状态值函数或策略函数,从而推广到未见过的状态。

### 3.2.1 过度拟合和欠拟合问题

函数逼近在提高泛化能力的同时,也带来了过度拟合和欠拟合的风险。过度拟合是指模型在训练数据上表现良好,但在未见数据上性能下降的现象。这种情况下,模型过度依赖训练数据中的噪声和特异性,无法泛化到新的情况。而欠拟合则是指模型在训练和测试数据上都表现不佳,通常是因为模型过于简单,不能捕捉数据中的复杂模式。在这两种情况下,智能体的决策性能都会受到严重影响。

### 3.2.2 泛化误差的控制策略

为了控制泛化误差,可以采取一系列策略,例如:引入正则化项来防止模型过度复杂,利用交叉验证来选择合适的模型复杂度,或者采用集成学习方法来提高模型的鲁棒性。另外,对于深度强化学习,还可以使用技术如dropout,它通过在训练过程中随机“丢弃”一部分神经元来减少模型对特定样本的依赖,从而增强泛化能力。

## 3.3

0

0