【精通party数据包】:R语言高级用户必备的7个最佳实践

发布时间: 2024-11-02 03:58:09 阅读量: 51 订阅数: 47

jiebaR:使用R.R语言中文分词(文档已更新:party_popper::https:qinwenfeng.comjiebaR)进行中文文本分割

# 1. R语言简介及其在数据分析中的地位

## 1.1 R语言的起源和特点

R语言最初由奥克兰大学的罗伯特·简特曼(Robert Gentleman)和罗斯·伊哈卡(Ross Ihaka)在1995年开发,其名称即来自这两位学者姓氏的首字母。R语言是一种用于统计计算和图形表示的编程语言和软件环境,它基于S语言,继承了S语言强大的统计分析功能。

R语言最大的特点在于其强大的图形表达能力以及丰富的统计分析包。它的开源特性使得全球的统计学家和数据分析师可以为它贡献包,使得R语言几乎能够进行所有类型的统计分析。另外,由于R语言的开源特性,任何企业和个人都可以免费使用,这使得R语言在学术界和企业界都具有广泛的应用。

## 1.2 R语言在数据分析中的地位

在数据分析领域,R语言被誉为数据分析师的瑞士军刀。R语言拥有大量的数据处理、统计分析和图形绘制的包,能够满足数据分析的绝大多数需求。它的灵活性和开放性使得它可以在不同的操作系统中运行,而且由于其开源的特性,用户可以根据自己的需求定制或者贡献新的包。

在数据科学社区中,R语言有着庞大的用户基础和丰富的学习资源。无论是初学者还是经验丰富的数据分析师,都能在R社区找到所需要的知识和帮助。随着大数据和人工智能的兴起,R语言在机器学习和数据挖掘等领域的应用也越来越广泛。

# 2. R语言数据处理基础

## 2.1 数据结构的深入理解

### 2.1.1 向量、矩阵、数组和列表

R语言拥有丰富的数据结构,包括向量、矩阵、数组和列表等,它们是数据处理和分析的基础工具。向量是最基础的数据结构,可以看作是一维的数组,用来存储单一类型的数据。而矩阵和数组是向量的扩展,区别在于矩阵是二维的,数组可以有多个维度。列表则是可以包含不同类型数据的结构,支持不同长度的数据元素。

```R

# 创建一个向量

vector_example <- c(1, 2, 3, 4)

# 创建一个矩阵

matrix_example <- matrix(1:9, nrow = 3, ncol = 3)

# 创建一个三维数组

array_example <- array(1:24, dim = c(2, 3, 4))

# 创建一个列表

list_example <- list(name = "Alice", age = 30, scores = c(85, 90, 78))

```

向量的创建使用`c()`函数,矩阵可以使用`matrix()`函数,数组使用`array()`函数,列表则是使用`list()`函数。通过这些函数,我们可以灵活地构建所需的数据结构,为后续的数据操作打下基础。

### 2.1.2 数据框(DataFrame)的操作技巧

数据框(DataFrame)是R语言中最常用的数据结构之一,它是一种列表,其中的每个元素可以是不同长度的向量,但它们的长度决定了数据框的行数。数据框经常被用来存储表格数据。

```R

# 创建一个数据框

data_frame_example <- data.frame(

ID = 1:4,

Name = c("Alice", "Bob", "Charlie", "David"),

Score = c(85, 90, 78, 92)

)

```

在数据框的操作中,经常用到的技巧包括数据的筛选、排序和分组。例如,使用`subset()`函数可以快速筛选出满足特定条件的子集,`order()`函数则用于排序,`aggregate()`函数用来进行分组统计。

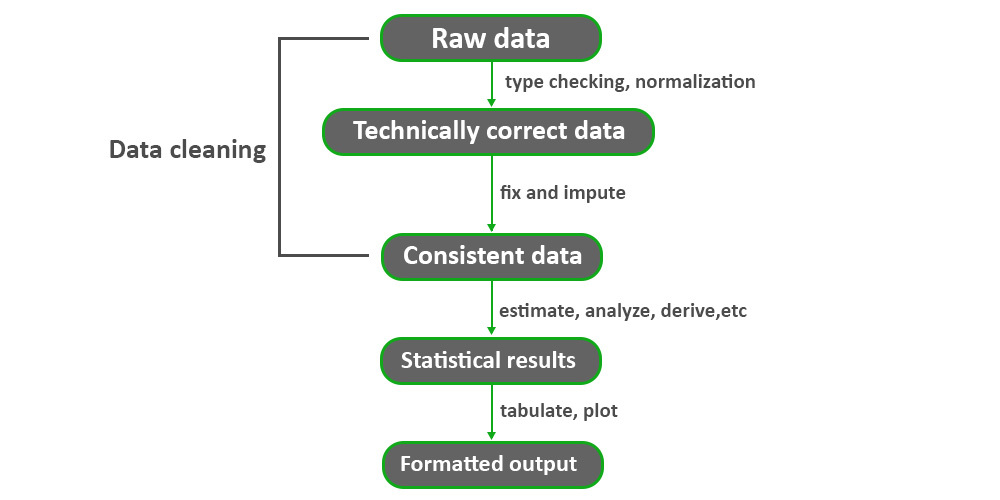

## 2.2 数据清洗和预处理

### 2.2.1 缺失值处理方法

在数据分析中,常常会遇到缺失值的问题。R语言提供了一些内置函数来处理缺失值,常见的方法有忽略缺失值、填充缺失值、删除含有缺失值的行或列等。

```R

# 创建一个含有缺失值的数据框

data_with_na <- data.frame(

ID = 1:5,

Name = c("Alice", "Bob", NA, "David", "Eve"),

Score = c(85, NA, 78, 92, NA)

)

# 使用na.omit()移除含有缺失值的行

clean_data <- na.omit(data_with_na)

# 使用mean()函数填充缺失值,这里以分数为例

data_with_na$Score[is.na(data_with_na$Score)] <- mean(data_with_na$Score, na.rm = TRUE)

```

在处理缺失值时,需要根据数据的实际意义和分析需求选择合适的方法。例如,如果缺失值代表的是未知信息且影响较小,可能选择忽略或者填充固定值;如果缺失值对于分析影响很大,则可能需要删除含有缺失值的行或列。

### 2.2.2 异常值的检测与处理

异常值是数据集中的观测值,与其它数据点相比显得格格不入。异常值可能由错误或极端事件导致,处理异常值通常包括检测、报告和调整三个步骤。

```R

# 检测异常值,以Z-score为例

z_scores <- scale(data_frame_example$Score)

threshold <- 3

outliers <- which(abs(z_scores) > threshold)

# 删除异常值

cleaned_data <- data_frame_example[-outliers, ]

```

在上述代码中,我们使用了标准差标准化方法(Z-score)来计算分数的Z-score。通常Z-score大于3或小于-3被认为是异常值。我们使用`which()`函数找到这些异常值的索引,并利用数据框的子集功能删除这些行。

### 2.2.3 数据转换与重塑

数据转换与重塑是数据处理中非常关键的步骤,它涉及数据的汇总、分割和合并。常用的数据转换函数包括`merge()`用于合并数据框,`reshape()`用于改变数据的结构。

```R

# 假设我们有另一个数据框

data_frame_example2 <- data.frame(

ID = c(1, 2, 3),

Age = c(30, 32, 28)

)

# 使用merge()函数合并两个数据框

merged_data <- merge(data_frame_example, data_frame_example2, by = "ID")

# 使用reshape()函数改变数据的结构

long_data <- reshape(data_frame_example, direction = "long",

varying = list(names(data_frame_example)[-1]), v.names = "Value",

timevar = "Variable")

```

在上述例子中,我们合并了两个数据框,并把数据框从宽格式转换为长格式,这是一种常见的数据重塑方式。长格式的数据有利于进行分组分析和时间序列分析。

## 2.3 数据可视化基础

### 2.3.1 基本图形绘制:条形图、散点图和线图

R语言提供了多种图形绘制函数,基本图形包括条形图、散点图和线图。这些图形是数据分析中表达数据关系的直观方式。

```R

# 绘制条形图

barplot(table(data_frame_example$Name))

# 绘制散点图

plot(data_frame_example$ID, data_frame_example$Score)

# 绘制线图

plot(data_frame_example$ID, data_frame_example$Score, type = "l")

```

条形图通过`barplot()`函数绘制,其中`table()`函数用于生成频率表。散点图和线图通过`plot()`函数绘制,其中`type`参数决定了绘制的类型。条形图适用于分类数据的展示,散点图适用于发现变量间的关系,线图则常用于展示趋势。

### 2.3.2 高级图形绘制:箱线图、热图和地图

高级图形如箱线图、热图和地图提供了更丰富的数据展示和分析手段。箱线图可以直观显示数据的分布情况,热图适用于展示矩阵数据,而地图则用于地理数据的可视化。

```R

# 绘制箱线图

boxplot(data_frame_example$Score)

# 使用ggplot2包绘制热图

library(ggplot2)

heatmap_data <- as.matrix(data_frame_example[, -1])

heatmap(heatmap_data)

# 使用ggplot2包绘制地图

# 假设我们有一个国家和地区数据的数据框

map_data <- data.frame(Country = c("USA", "Canada", "UK"), Value = c(10, 20, 15))

library(ggplot2)

ggplot(map_data, aes(map_id = Country)) +

geom_map(aes(fill = Value), map = map_data) +

expand_limits(x = map_data$long, y = map_data$lat)

```

在上述代码中,我们首先使用基础R的`boxplot()`函数绘制了箱线图。热图的绘制则需要借助`ggplot2`包,我们首先将数据转换为矩阵格式,然后应用`heatmap()`函数。绘制地图需要先确定所用的地图数据,然后利用`ggplot2`的`geom_map()`函数完成。

以上所介绍的内容为R语言在数据处理方面的基础知识,从数据结构的深入理解到数据清洗预处理,再到基本和高级的数据可视化,每一部分都是数据分析不可或缺的重要组成。通过这些基础和技巧,R语言用户能够有效地处理和分析数据,为进一步的数据挖掘和分析打下坚实的基础。

# 3. R语言高级数据分析技术

## 3.1 统计建模与推断

### 3.1.1 常见统计模型:线性回归、逻辑回归

线性回归是最基础的统计模型之一,它用于研究变量之间是否存在线性关系以及关系的强度。在R语言中,可以通过`lm()`函数实现线性回归模型。例如,建立一个关于房屋面积(`area`)和房屋价格(`price`)的线性模型,我们首先创建一个数据框`housing`,然后应用线性模型。

```r

# 创建数据框

housing <- data.frame(

area = c(1200, 1500, 1800, 1900, 2000),

price = c(150000, 175000, 200000, 220000, 230000)

)

# 建立线性模型

lm_model <- lm(price ~ area, data = housing)

# 查看模型摘要

summary(lm_model)

```

输出结果将提供关于模型拟合优度的统计信息,包括系数估计、标准误差、t值、p值等。`summary()`函数的输出帮助我们理解模型的显著性和变量的影响力度。

逻辑回归是处理二分类问题的常用模型。在R语言中,`glm()`函数提供了逻辑回归的实现。例如,根据病人的年龄(`age`)和血压(`bp`)来预测病人是否患有某种疾病(`disease`),我们可以构建一个逻辑回归模型。

```r

# 创建数据框

medical_data <- data.frame(

age = c(20, 30, 40, 50, 60),

bp = c(120, 140, 160, 180, 200),

disease = c(0, 0, 1, 1, 1)

)

# 建立逻辑回归模型

glm_model <- glm(disease ~ age + bp, data = medical_data, family = binomial)

# 查看模型摘要

summary(glm_model)

```

在逻辑回归中,系数的解释与线性回归不同,通常通过发生比(odds ratio)来解释模型的预测能力。

### 3.1.2 假设检验:T检验、卡方检验等

假设检验是统计推断的一个重要环节,用于基于样本数据推断总体参数或比较两个总体。T检验和卡方检验是两种常用的假设检验方法。

T检验用于比较两个样本的均值是否存在显著差异。在R中,`t.test()`函数可执行T检验。例如,我们想比较一组男性的体重(`male_weight`)和一组女性的体重(`female_weight`)是否显著不同。

```r

# 创建数据框

weights <- data.frame(

male_weight = c(80, 75, 70, 65, 85),

female_weight = c(60, 55, 50, 60, 65)

)

# T检验

t_result <- t.test(weights$male_weight, weights$female_weight, var.equal = TRUE)

# 输出T检验结果

print(t_result)

```

卡方检验常用于类别变量,比如检验两个分类变量是否独立。R中`chisq.test()`函数可以实现卡方检验。假设我们想检验某种药物是否对治疗病有效果,可以比较药物组和安慰剂组的治愈率。

```r

# 创建数据表

treatment_data <- matrix(c(80, 20, 40, 60), ncol = 2, byrow = TRUE)

colnames(treatment_data) <- c("Drug", "Placebo")

rownames(treatment_data) <- c("Cured", "Not Cured")

# 卡方检验

chisq_result <- chisq.test(treatment_data)

# 输出卡方检验结果

print(chisq_result)

```

通过这些检验,我们可以获得两个样本或分类变量之间差异性的统计证据,进而决定是否拒绝原假设。

# 4. R语言在特定领域的应用案例

## 4.1 生物信息学数据分析

### 4.1.1 基因表达数据分析

在生物信息学领域,基因表达数据分析是研究基因活动和表达水平的重要手段,而R语言提供了多种用于基因表达数据处理和分析的工具和包。例如,Bioconductor项目就是一个专门提供生物信息学计算解决方案的R包集合,其中包含了对基因表达数据进行标准化、差异表达分析、功能注释和路径分析等的工具。

在进行基因表达数据分析时,用户需要经过如下步骤:

- **数据读取**:将基因表达矩阵和相关的注释信息从文件中读取到R环境中。

- **数据预处理**:进行数据清洗、标准化和归一化处理。

- **差异表达分析**:使用适当的统计模型识别在不同条件或时间点下显著差异表达的基因。

- **结果解释**:利用基因本体论(Gene Ontology)或通路分析等方法对差异表达基因的功能进行解释。

```r

# 示例:使用limma包进行差异表达分析

library(limma)

# 读取数据

expression_data <- readRDS("expression_data.rds")

design <- model.matrix(~ 0 + sample_conditions)

colnames(design) <- levels(sample_conditions)

# 标准化处理

expression_data <- normalizeBetweenArrays(expression_data, method = "quantile")

# 线性模型拟合

fit <- lmFit(expression_data, design)

# 对比不同条件之间的差异表达

contrast.matrix <- makeContrasts(ConditionA - ConditionB, levels=design)

fit2 <- contrasts.fit(fit, contrast.matrix)

# eBayes统计模型用于寻找差异表达基因

fit2 <- eBayes(fit2)

# 获取结果

results <- topTable(fit2, coef=1, adjust="fdr", number=nrow(expression_data))

```

上述代码段展示了使用R语言的limma包进行差异表达分析的基本流程。代码开始加载了limma包,接着读取基因表达矩阵数据,定义实验设计并进行标准化处理。之后构建线性模型并应用eBayes统计模型进行差异表达基因的发现。最后,通过topTable函数获取差异表达基因的统计结果。

### 4.1.2 序列比对和进化树构建

在生物信息学的另一重要方面,即序列分析中,R语言同样可以发挥关键作用。序列比对是理解生物分子间相似性和差异性的基础,而进化树的构建可以帮助科学家推断物种或序列的进化关系。

对于序列比对,R语言的Biostrings包提供了一系列工具用于处理生物学序列数据。用户可以对DNA或蛋白质序列进行比对,然后基于比对结果构建进化树。著名的R包如ape提供了进化树构建和分析的功能。

```r

# 示例:使用ape包构建进化树

library(ape)

# 读取序列数据

sequences <- read.GenBank(c("Sequence1", "Sequence2", "Sequence3"))

# 序列比对

aligned_sequences <- muscle(sequences)

# 构建进化树

distances <- dist.dna(aligned_sequences, model="Kimura")

tree <- NJ(distances)

# 绘制进化树

plot(tree)

```

代码中,首先加载ape包,读取了几个基因序列,然后使用muscle函数进行序列比对。接着,通过dist.dna函数计算了序列间的距离,并用邻接法(NJ)构建进化树。最后,绘制出了进化树。

## 4.2 金融数据分析

### 4.2.1 风险管理中的统计分析

在金融行业,R语言被广泛应用于风险管理、市场分析以及预测建模。R提供了丰富的方法和工具来进行时间序列分析、回归分析、信用评分模型、风险度量(如Value at Risk, VaR)和其他金融数据统计分析。

统计分析在风险管理中极为重要,因为它可以帮助金融机构了解市场变动、评估潜在风险并制定相应的风险管理策略。VaR是一种常用的风险度量方法,它可以估算在正常市场条件下,给定的置信水平下,一个投资组合在特定时期内可能遭受的最大损失。

```r

# 示例:使用rugarch包计算Value at Risk(VaR)

library(rugarch)

# 加载时间序列数据

data("stock_index")

# 拟合一个ARMA-GARCH模型

spec <- ugarchspec(variance.model=list(model="sGARCH", garchOrder=c(1,1)),

mean.model=list(armaOrder=c(1,0)))

fit <- ugarchfit(data=stock_index[, "SP500"], spec=spec)

# 计算VaR

VaR <- ugarchVaR(fit, portfolio_spread=1, n.ahead=1,

target="normal", alpha=0.05)

```

这里,通过rugarch包,首先定义了一个ARMA-GARCH模型的规格,然后拟合了股票指数数据。接着,使用ugarchVaR函数计算了一定置信水平下的VaR值。这有助于金融分析师评估投资组合潜在的损失风险。

### 4.2.2 资产配置和投资组合分析

在资产配置和投资组合管理中,R语言同样可以发挥关键作用。R语言的优化包可以帮助投资者在特定风险偏好下找到最优的资产组合,提高投资回报,降低风险。此外,还可以用于优化资产配置,比如通过夏普比率或信息比率等指标来进行评估。

```r

# 示例:使用quadprog包进行资产配置优化

library(quadprog)

# 定义资产收益矩阵和协方差矩阵

returns <- cbind(CorporateBonds, TreasuryBills, StockMarket)

cov_matrix <- cov(returns)

# 定义目标函数

D <- t(returns) %*% solve(cov_matrix) %*% returns

d <- rep(0, ncol(returns))

N <- nrow(returns)

# 定义约束条件

A <- cbind(rep(1, ncol(returns)), diag(ncol(returns)))

b <- c(1, rep(0, ncol(returns)))

# 优化求解

solution <- solve.QP(Dmat=D, dvec=d, Amat=A, bvec=b, meq=1)

# 输出最优权重

optimal_weights <- solution$solution

```

在上述示例中,首先定义了资产收益和协方差矩阵,然后构建了目标函数和约束条件,最后使用solve.QP函数求解了二次规划问题,得到了最优的资产权重分配。

## 4.3 社会科学数据处理

### 4.3.1 大规模调查数据的分析方法

在社会科学领域,特别是心理学、社会学和经济学,大规模调查数据的分析是了解人类行为和趋势的重要手段。R语言提供了处理和分析此类数据的多种方法和包。例如,通过使用R中的ggplot2和dplyr包,用户可以进行数据可视化和数据处理。

大规模调查数据的分析通常包含以下步骤:

- **数据清洗**:处理缺失值、异常值和数据格式错误。

- **数据转换**:将非数值数据转换为数值,比如将类别变量编码为虚拟变量。

- **探索性数据分析**:生成描述性统计量,如均值、标准差、中位数等。

- **推断性统计分析**:应用t检验、卡方检验等统计方法。

```r

# 示例:使用dplyr和ggplot2进行探索性数据分析

library(ggplot2)

library(dplyr)

# 加载数据

survey_data <- read.csv("survey_data.csv")

# 数据清洗和转换

clean_data <- survey_data %>%

filter(!is.na(Income)) %>%

mutate(IncomeGroup = factor(ifelse(Income > 100000, "High", "Low")))

# 生成描述性统计量

summary_stats <- clean_data %>%

group_by(IncomeGroup) %>%

summarise(MeanAge = mean(Age),

MedianIncome = median(Income))

# 绘制条形图

ggplot(clean_data, aes(x=IncomeGroup, fill=IncomeGroup)) +

geom_bar() +

theme_minimal()

```

该示例展示了如何使用dplyr进行数据清洗和转换,使用ggplot2进行数据可视化。代码读取了调查数据,清洗了包含缺失值的观测,并将收入变量转换为两个收入组别。然后计算了每个组别的平均年龄和中位数收入,并绘制了一个条形图来可视化不同收入组别的数据分布。

### 4.3.2 文本挖掘和情感分析技术

在处理文本数据时,R语言能够实现从基础的文本预处理到高级的文本挖掘和情感分析。使用R语言的tidytext、quanteda等包可以对文本数据进行分析,提取有用信息,并进行情感倾向的判断。

文本挖掘和情感分析流程一般包括:

- **分词**:将文本数据分解为独立的单词或术语。

- **去除停用词**:过滤掉一些常见的但对分析没有帮助的单词,如“的”、“是”等。

- **词频统计**:统计单词出现的频率,了解文本中哪些词使用得最多。

- **主题建模**:识别文本中的潜在主题。

- **情感分析**:确定文本中情感倾向的积极或消极。

```r

# 示例:使用tidytext包进行情感分析

library(tidytext)

# 加载文本数据

text_data <- read.csv("text_data.csv")

# 分词和情感分析

tidy_data <- text_data %>%

unnest_tokens(word, text) %>%

inner_join(get_sentiments("afinn"), by = "word")

# 计算情感得分

sentiment_score <- tidy_data %>%

group_by(document) %>%

summarise(SentimentScore = sum(value))

# 可视化情感得分

ggplot(sentiment_score, aes(x=SentimentScore)) +

geom_histogram(binwidth=1) +

theme_minimal()

```

示例中通过tidytext包实现了对文本数据的分词、情感分析及得分统计。使用unnest_tokens函数分词,通过inner_join函数与afinn情感词典合并,统计每篇文档的情感得分,最后使用ggplot2包绘制了情感得分的直方图。

通过上述案例,我们可以看到R语言在特定领域的应用潜力巨大,无论是生物信息学、金融数据分析还是社会科学,它都能提供丰富的工具和方法来支持深入的数据分析和挖掘工作。

# 5. R语言编程最佳实践

## 5.1 代码优化和性能提升

### 5.1.1 函数式编程的优势

在R语言中,函数式编程是一种编程范式,它允许我们将函数视为一等公民。这意味着函数可以作为参数传递给其他函数,可以作为结果返回,也可以存储在变量中。函数式编程的优势在于它可以提高代码的可读性和可重用性,同时减少代码中的重复部分,从而提升整体性能。

**函数式编程的几个关键概念包括:**

- **高阶函数**:接受函数作为参数或将函数作为结果返回的函数。

- **匿名函数**:不需要显式定义的函数,通常用在需要函数作为参数传递的地方。

- **递归**:函数自我调用,用于解决可以分解为更小问题的问题。

举个例子,我们可以使用`lapply`或`vapply`这类高阶函数来替代传统的循环结构,这不仅可以使代码更加简洁,还能利用R内部的优化提升计算效率。

```r

# 使用lapply函数应用一个操作到列表的每个元素

result <- lapply(data, function(x) x + 1)

```

**性能分析工具:**

R提供了`microbenchmark`包来测试代码片段的性能。我们可以使用此包来比较不同函数或代码段的执行时间,从而找到性能瓶颈并进行优化。

```r

# 载入microbenchmark包

library(microbenchmark)

# 测试不同的代码片段

microbenchmark(

loop = for(i in 1:1000) {x <- x + 1},

lapply = lapply(1:1000, function(x) x + 1),

times = 100

)

```

### 5.1.2 内存管理和代码效率分析

在R中,内存管理是影响程序性能的关键因素。为了有效地管理内存,我们需要了解R的内存模型和垃圾回收机制。R中的对象存储在内存中的虚拟地址空间,当没有引用指向这些对象时,它们会被标记为垃圾回收。

**提高代码效率的几个方法:**

- **避免复制数据**:使用R6类或环境可以避免数据的不必要复制。

- **使用大数据对象**:例如,使用`data.table`代替`data.frame`。

- **减少对象的创建**:避免在循环内部创建新对象,可以使用预分配的方式。

此外,代码效率分析工具如`profvis`可以帮助我们识别代码中运行缓慢的部分,并对其进行优化。

```r

# 载入profvis包

library(profvis)

# 运行profvis分析代码块

p <- profvis({

# 这里放置代码块

data <- data.frame(x = rnorm(1000000), y = rnorm(1000000))

result <- lm(y ~ x, data = data)

})

# 显示分析结果

print(p)

```

通过以上方法,我们可以从代码层面挖掘潜在的性能提升点,并针对性地进行优化。

## 5.2 包管理和开发

### 5.2.1 第三方包的安装和管理

R语言的生态系统非常丰富,成千上万的第三方包可以供用户下载和使用。管理这些包可以使用`install.packages()`, `update.packages()`和`remove.packages()`函数。但当包数量非常庞大时,手动管理这些包可能会变得繁琐和低效。幸好R社区提供了一些工具来帮助我们更高效地管理这些包。

**常用的包管理工具包括:**

- **devtools**:提供了许多用于开发R包的便利函数,比如安装开发版本的包。

- **packrat**:通过为每个项目创建一个隔离的包环境,可以解决依赖性问题,确保项目依赖的包版本一致性。

- **renv**:类似于packrat的包管理工具,但是提供了更多的功能和更好的性能。

例如,使用`devtools`安装开发版本的包的代码如下:

```r

# 安装开发版本的包

devtools::install_github("r-lib/remotes")

```

### 5.2.2 R包的开发流程和发布

开发一个R包是一个系统化的过程,从初始化包结构到版本控制,再到文档编写和提交到CRAN。以下是R包开发的基本流程:

1. **初始化包结构**:使用`usethis`包的`create_package()`函数创建包的骨架。

2. **编写函数和文档**:在包中添加函数定义,并使用`roxygen2`包为函数生成文档。

3. **检查和测试**:使用`devtools`包的`check()`函数检查包的兼容性和问题。

4. **构建和安装**:构建包并手动测试安装。

5. **版本控制**:使用`git`进行版本控制,确保所有变更都可以追溯。

6. **发布到CRAN**:一旦包准备好并且通过了CRAN的检查,就可以提交到CRAN。

下面是一个简单的R包结构示例:

```r

# 创建一个新的R包结构

usethis::create_package("my_new_package")

```

一旦R包开发完成,并且通过了CRAN的检查,就可以提交到CRAN进行发布。发布前需要确保包遵循CRAN的发布标准,包括代码质量、文档和测试覆盖率。

## 5.3 生产级R应用的部署

### 5.3.1 从R到生产环境的流程

将R代码部署到生产环境需要考虑代码的稳定性和可靠性。在部署之前,应该确保代码已经经过了充分的测试,并且可以处理各种潜在的错误情况。通常的做法是创建一个可复现的环境,这个环境与生产环境尽可能一致。

**部署流程一般包括:**

- **环境搭建**:配置与生产环境相似的本地或测试环境。

- **自动化测试**:编写自动化测试脚本以确保代码的正确性。

- **版本控制**:通过版本控制系统管理代码变更,如Git。

- **打包部署**:将代码打包为可部署的形式,如Docker镜像。

### 5.3.2 容器化和云服务集成

容器化技术如Docker可以有效地封装R环境和应用,使应用可以在任何支持Docker的平台上运行,不受环境差异的影响。R语言与云服务的集成也越来越紧密,RStudio Server和RStudio Connect是将R集成到云服务中的两个例子,它们提供了与R语言相关的应用和服务。

**容器化部署的一个例子:**

```Dockerfile

# Dockerfile 示例

FROM rocker/verse:latest

# 安装必要的R包

RUN R -e "install.packages('ggplot2', repos='***')"

# 设置工作目录

WORKDIR /home/rstudio/

# 将应用代码复制到镜像中

COPY . /home/rstudio/

# 设置启动脚本

CMD ["R", "-e", "shiny::runApp('/home/rstudio/myapp')"]

```

以上Dockerfile示例将一个使用Shiny构建的web应用封装到Docker容器中,确保应用可以在任何安装了Docker的机器上运行。

R语言与云服务的集成则可以通过APIs、云存储服务和云数据库服务等方式实现。例如,使用AWS S3进行存储,或者使用Google BigQuery进行大规模数据分析。

通过这些最佳实践,R语言程序员可以确保他们的代码能够从开发环境平滑过渡到生产环境,并在高负载的条件下保持高效运行。

# 6. R语言社区与未来展望

## 6.1 R语言社区资源

R语言的流行离不开其强大的社区支持。在这一部分,我们将详细探讨R语言社区提供的学习资源和教育平台,以及社区支持和协作工具。

### 6.1.1 学习资源和教育平台

R语言社区提供了丰富的学习资源,包括免费和付费的在线课程、教程、书籍和视频。例如,R语言的官方网站(***)提供了一系列的介绍性文档和用户指南。此外,像Coursera、edX等在线教育平台上有由大学和专业机构提供的课程,涵盖从基础到高级的各种技能。

**免费资源:**

- [R-Project](*** 官方网站,包括用户手册和邮件列表

- [CRAN Task Views](***语言任务视图,对不同领域中可用的R包进行分类

- [R-bloggers](***博客网站,收录了大量R语言使用者的博客文章

**付费资源:**

- [DataCamp](*** 提供交互式R语言课程

- [RStudio](*** 提供培训和研讨会

- [Udemy](*** 上面有很多专业讲师制作的R语言课程,涵盖各种主题

### 6.1.2 社区支持和协作工具

R社区的协作工具多样,从论坛、邮件列表到社交平台,为用户提供了互相帮助、交流想法的渠道。

**论坛和邮件列表:**

- [Rhelp](*** 邮件列表,一个讨论R语言相关问题的活跃社区

- [Stack Overflow](*** 在这个网站上可以找到关于R语言的问答

**社交平台:**

- [RStudio Community](***官方社区论坛

- [Twitter](***语言用户经常在Twitter上使用#RStats标签分享信息和资源

**协作工具:**

- [GitHub](*** 上面托管着大量的R包和数据分析项目

- [R-Forge](*** 提供R包的开发和分发平台

通过这些学习资源和社区工具,新用户可以快速入门,而经验丰富的用户则可以保持自己的知识和技能的最新状态,并参与到开源项目和协作中。

## 6.2 R语言的发展趋势

R语言不仅在学术界享有盛誉,在业界的应用也越发广泛。在这一部分,我们将讨论R语言与其他编程语言的融合,以及在大数据和人工智能中的应用前景。

### 6.2.1 R语言与其他编程语言的融合

R语言的设计初衷是提供一个用于统计计算和图形的环境,但其在数据分析和机器学习方面的表现也日益突出。为了进一步扩大其应用范围,R语言与其他编程语言的整合变得越来越重要。

**整合Python:**

- [reticulate](*** 包允许R语言直接调用Python代码,可以方便地使用Python的数据分析工具如Pandas、scikit-learn等。

**整合SQL:**

- 在数据处理过程中,经常需要与数据库打交道。通过像[RMySQL](***、[RSQLite](***这样的包,R可以直接与MySQL、SQLite等数据库进行交互。

### 6.2.2 R语言在大数据和人工智能中的应用前景

随着数据科学的发展,R语言在处理大数据以及人工智能领域的需求中也扮演着越来越重要的角色。

**大数据处理:**

- [SparkR](*** 和 [sparklyr](*** 允许R用户在Apache Spark上进行数据处理和分析。

- [HadoopStreaming](*** 让R用户可以利用Hadoop进行大规模数据处理。

**机器学习和人工智能:**

- R语言为机器学习提供了多种库和工具,例如 [h2o](*** 和 [mlr](***。

- 随着深度学习的兴起,R社区也在开发深度学习的包,如 [keras](*** 和 [tensorflow](***,这些工具使得在R中训练复杂的神经网络成为可能。

R语言的未来非常有前景,它将继续进化以应对数据分析领域的最新挑战。随着社区的持续贡献和新技术的集成,R语言将继续在数据科学领域保持其重要地位。

0

0