【R语言并行计算入门】:用party包提升数据处理速度的5大技巧

发布时间: 2024-11-02 04:36:06 阅读量: 40 订阅数: 28

# 1. R语言并行计算简介

随着数据科学领域的发展,数据分析的规模和复杂度日益增加,传统单线程计算模式已经难以满足现代计算需求。R语言作为一种广泛应用于统计分析、数据挖掘的编程语言,其并行计算能力的提升显得尤为重要。本章将为您介绍R语言并行计算的基本概念、意义以及它如何帮助处理大规模数据集。

并行计算可以显著缩短数据处理时间,提升计算效率。它通过同时使用多个计算资源,如CPU核心或网络中的多个计算机,将一个大的计算任务划分为多个小任务并行执行。对于R语言用户而言,掌握并行计算不仅可以加快现有数据处理流程,还可以实现更复杂的数据分析。

在R语言中,有多个包提供了并行计算功能,如`parallel`、`foreach`、`snow`以及本章重点介绍的`party`包。`party`包集成了多种并行计算工具,支持从基础的多线程运算到复杂的分布式计算。通过本系列章节,我们将深入探讨如何使用`party`包及其相关工具,以并行的方式解决R语言中的数据处理问题。

# 2. 并行计算的基础知识

### 2.1 并行计算的理论基础

#### 2.1.1 并行计算的定义和重要性

并行计算是一种计算方法,它涉及同时使用多个计算资源来解决问题。这些资源可以是多核心的处理器、多处理器的计算机、甚至是网络中的多个计算节点。并行计算通过将任务分解成小块,让每个计算资源同时处理任务的一部分,从而大幅提高计算速度。

并行计算的重要性在于能够处理大规模和复杂的计算问题,提供高速的数据处理能力。这对于科学计算、工程设计、金融分析等众多领域至关重要,因为它能够在可接受的时间内给出问题的答案,而单线程计算往往无法满足对速度和效率的要求。

#### 2.1.2 并行计算的主要模型和类型

并行计算的主要模型可以分为以下几种:

- 数据并行(Data Parallelism):任务中的数据被分割成多个部分,并且每个部分由不同的处理器同时处理。这种方法适用于数据集可以轻松分割且每个部分的处理逻辑相同的场景。

- 任务并行(Task Parallelism):将任务分成可以同时执行的子任务。这些子任务通常有不同的执行路径和依赖关系。

- 流水线并行(Pipelined Parallelism):流水线并行是在任务的不同阶段中应用并行处理。它常用于图形渲染、数据处理流水线等场景,其中每个阶段依赖于前一个阶段的输出。

### 2.2 R语言中的并行计算工具

#### 2.2.1 R语言支持的并行计算包概览

R语言作为一种流行的统计编程语言,支持并行计算的包众多。这些包提供了不同的功能,帮助用户有效地利用多核处理器和多处理器系统。一些常用的包包括:

- `parallel`:R自带的并行计算包,提供了基本的并行功能。

- `foreach`:为循环提供了一个灵活的接口,可以与多种并行后端结合。

- `Rmpi`:提供了MPI(消息传递接口)的R实现,支持集群级别的并行计算。

- `doParallel`:为foreach循环提供了一个并行后端。

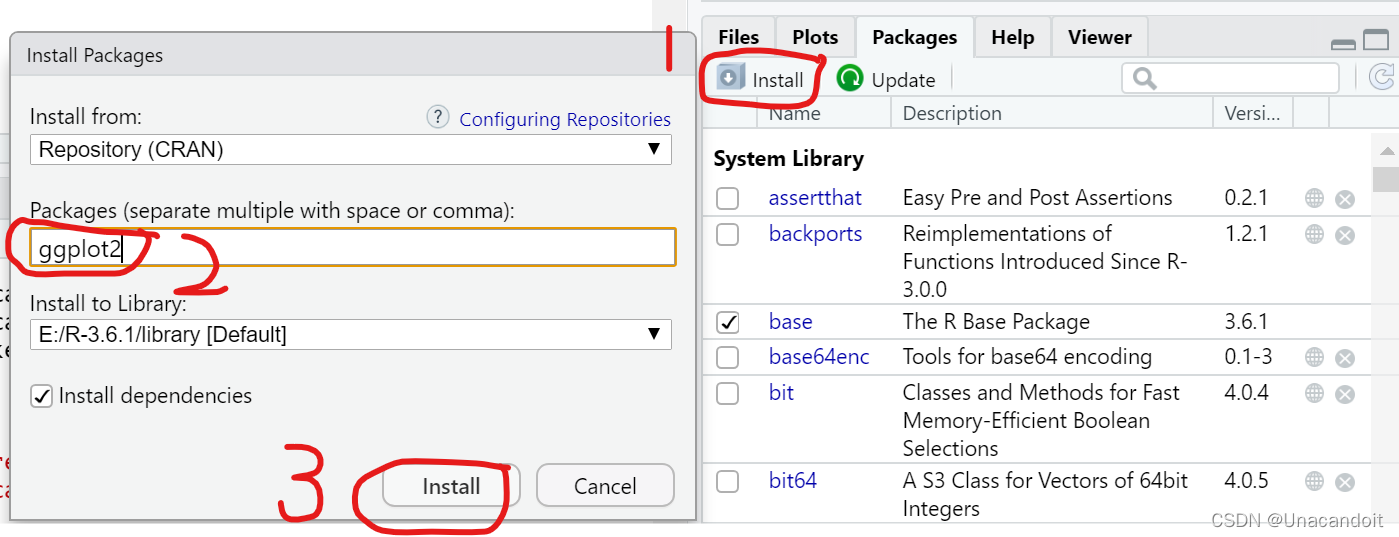

#### 2.2.2 party包的安装与配置

`party`包是R语言的一个功能包,主要用于数据挖掘和统计分析。它通过并行计算提供快速的数据处理能力。安装和配置`party`包的基本步骤如下:

1. 安装`party`包:

```R

install.packages("party")

```

2. 配置并行计算环境:

```R

library(party)

cl <- makeCluster(4) # 创建4个工作的集群

registerDoParallel(cl) # 注册并行后端

```

在使用`party`包进行并行计算前,需要确保有足够的处理器核心可用,否则并行化不会带来性能提升。

### 2.3 并行计算的性能考量

#### 2.3.1 任务分解与负载平衡

在并行计算中,任务分解是将一个复杂问题划分为若干个可以并行解决的小任务。这一过程需要考虑任务的粒度,过于细小的任务会增加通信开销,过于粗大的任务则无法充分利用并行资源。

负载平衡是确保所有并行处理单元都满负荷工作,无资源浪费。在实际应用中,负载平衡通常需要根据任务特性和计算资源动态调整。

#### 2.3.2 内存管理和数据共享问题

内存管理是并行计算中的另一个重要考量。当多个并行计算单元访问和修改同一内存区域时,可能会发生数据竞争或不一致的情况。因此,需要有效的同步机制来管理内存。

数据共享问题是指在并行环境中,多个计算单元可能需要访问相同的数据。在内存中直接共享数据可能导致竞态条件,因此需要使用消息传递或其他形式的数据交换机制,如使用`Rmpi`包在不同节点间传递数据。

```mermaid

graph LR

A[开始] --> B[任务分解]

B --> C[分配任务]

C --> D[并行计算]

D --> E[负载平衡]

E --> F[内存管理]

F --> G[数据共享]

G --> H[结束]

```

并行计算的每个步骤都需要精心设计和考量,以确保整个系统的性能和稳定性。从理论到实践,每一步都是并行计算成功实现的关键。

# 3. 使用party包进行基本并行计算

## 3.1 party包核心功能介绍

### 3.1.1 party包的数据结构和操作函数

party包是R语言中用于并行计算的一个重要工具,它提供了一套完整的函数库来支持并行计算的任务。数据结构方面,party包重点支持树形结构,这在处理分类和回归分析时尤为重要。利用这些数据结构,开发者可以轻松地构建决策树和模型。

在操作函数方面,party包提供了诸如`ctree`和`mob`等函数来训练决策树模型,而`predict`函数则用于模型预测。除了这些核心函数,`party`还包含了数据分割、模型评估和可视化等辅助功能。

为了更好地理解party包,以下是一个使用`ctree`函数的基本示例代码:

```r

# 加载party包

library(party)

# 准备数据集

data("iris")

iris_data <- iris[, -5] # 移除分类标签

iris_label <- iris[, 5]

# 使用ctree函数构建决策树模型

ctree_model <- ctree(iris_label ~ ., data = iris_data)

# 查看模型详情

print(ctree_model)

# 对模型进行预测

predicted_label <- predict(ctree_model, newdata = iris_data)

```

### 3.1.2 基本并行任务的实现方法

并行计算在party包中的应用,主要是在处理大规模数据集或者计算密集型任务时,能够将工作分配到多个核心或计算节点上。party包通过其内置的并行处理机制,使得用户可以在多个处理器上执行计算任务,而无需修改原有代码逻辑。

实现并行任务,一个常见的方法是利用R的并行包,如`parallel`。在party包中,可以通过设置并发任务数量来实现并行计算,这通常通过`parallel`包的`detectCores()`函数来获取可用的CPU核心数,并用此来设置并行计算的参数。

```r

# 载入并行包

library(parallel)

# 获取可用核心数

numCores <- detectCores()

# 设置并行核心数

cl <- makeCluster(numCores)

registerDoParallel(cl)

# 使用并行计算进行模型训练

ctree_model_parallel <- foreach(i = 1:numCores) %dopar% {

# 假设我们这里要分割数据集,并在每个核心上训练模型

data_split <- split(iris_data, cut(seq(1, nrow(iris_data)), breaks = numCores))[i]

ctree(iris_label ~ ., data = data_split)

}

stopCluster(cl)

registerDoSEQ()

```

以上代码展示了如何利用并行计算功能,将数据集分割后在多个核心上分别训练模型。这样的处理方法可以显著缩短模型训练时间,特别是当单个核心无法在合理时间内完成计算时。

## 3.2 并行化数据处理技巧

### 3.2.1 并行化数据读取和预处理

在数据科学项目中,数据读取和预处理往往占据了大多数的时间。并行化处理技术可以加速这些步骤,从而提高整个数据处理流程的效率。

使用party包结合R语言的并行计算库,我们可以在数据读取阶段就实现并行化。以读取大型CSV文件为例,可以将文件分割为多个小块,然后用不同的线程并行读取,最后将数据块合并。

```r

# 加载必要的库

library(foreach)

library(doParallel)

# 假设我们有一个大型CSV文件,并且我们想要并行化读取

numCores <- detectCores()

cl <- makeCluster(numCores)

registerDoParallel(cl)

# 创建一个函数来并行读取数据

read_data_chunk <- function(file_name, chunk_size, offset) {

# 计算读取的行数

line_count <- sum(1 == readBin(file_name, what = "raw", n = 8, size = "double"))

if (offset + chunk_size > line_count) {

return(read.csv(file_name, sep = ",", header = FALSE, row.names = NULL, colClasses = "character", skip = offset))

} else {

return(read.csv(file_name, sep = ",", header = FALSE, row.names = NULL, colClasses = "character", skip = offset, nrows = chunk_size))

}

}

# 使用并行计算读取数据

data_chunks <- foreach(offset = seq(0, line_count, chunk_size), .combine = rbind) %dopar% {

read_data_chunk(file_name = "large_dataset.csv", chunk_size = chunk_size, offset = offset)

}

stopCluster(cl)

```

在这个例子中,`read_data_chunk`函数负责读

0

0