挑战与机遇并存:深度学习模型可解释性全解析

发布时间: 2024-09-06 02:51:47 阅读量: 67 订阅数: 33

# 1. 深度学习模型可解释性的概念与重要性

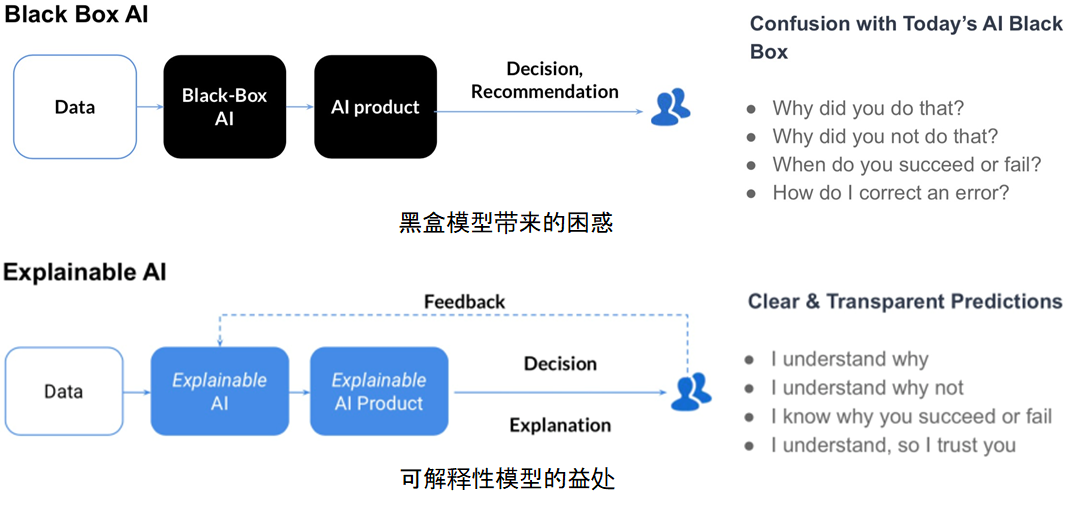

在当前的AI技术革命中,深度学习模型的应用领域越来越广泛,从医学诊断到自动驾驶,从金融风险评估到自然语言处理。然而,随着这些强大模型的普及,"黑箱"问题变得日益严峻——即模型的决策过程缺乏透明度,导致难以理解和信任模型的输出结果。这就是深度学习模型可解释性问题的起点。在本章中,我们将探讨模型可解释性的基本概念、它的重要性以及为什么我们需要关注这个问题。我们还将深入分析可解释性如何影响到模型的接受度、可信度以及其在现实世界中的应用潜力。

## 模型可解释性的定义

模型可解释性指的是对模型的决策过程进行解释的能力。具体地说,它涉及到模型内部工作机制的理解,包括如何将输入数据映射到预测输出,以及模型在学习过程中的特征重要性。深度学习模型,尤其是神经网络,往往被视为"黑箱",因为其复杂的内部结构使得理解这些映射关系变得异常困难。

## 可解释性的重要性

深度学习模型的可解释性至关重要,原因有多个层面。从技术角度来看,可解释性可以帮助开发者发现模型的错误,优化算法,并提高模型的准确性。从伦理和法律的角度来看,可解释性确保了模型的决策是可以被审计和解释的,这对于保护用户隐私、遵守法规以及建立用户信任至关重要。此外,对于特定的应用场景,如医疗诊断,可解释性更是一个无法回避的问题,因为它直接关系到人的生命安全。

在后续的章节中,我们将详细探讨深度学习模型的工作原理、性能评估方法,以及如何在实践中提升模型的可解释性,最终将这些知识应用到各个具体领域,为解决实际问题提供支持。

# 2. 深度学习模型的理论基础与工作原理

### 2.1 深度学习模型的核心组件

#### 2.1.1 神经网络的层次结构

深度学习模型的核心是由多层神经元组成的层次结构,每层包含若干个神经元,这些神经元之间相互连接并传递信号。在深度学习中,通常所说的“深度”指的是模型中隐藏层的数量,隐藏层的增加可以提供更复杂的非线性映射能力,从而解决更复杂的模式识别任务。

层次结构的每一层都有其特定的角色,如输入层接收数据,隐藏层进行特征提取,输出层给出最终预测结果。通过不同层次间复杂的信息处理和传递,深度学习模型能够学习到从简单到复杂的特征表示,从而实现高层次的任务。

层次结构的引入是深度学习区别于传统机器学习的主要特点之一。由于参数众多,模型复杂度高,训练过程中可能遇到的挑战也更多,例如梯度消失和梯度爆炸等问题。为解决这些问题,研究者们提出了各种各样的优化策略和网络结构设计。

#### 2.1.2 前向传播与反向传播算法

神经网络的训练过程主要包括前向传播和反向传播两个阶段。前向传播是指输入信号从输入层开始,逐层向后传递直到输出层的过程,在这个过程中每一层的神经元会根据其输入和激活函数计算出输出。

反向传播算法是训练过程中用于更新网络参数的关键算法,它通过计算损失函数对每个参数的梯度,进而利用梯度下降或其变种算法更新参数,以减少模型输出和真实标签之间的误差。在反向传播过程中,误差信号会从输出层逆向传播回输入层,并在每一层中根据链式法则计算局部梯度。整个过程需要保证梯度计算的准确性,这对于深度网络的稳定训练至关重要。

### 2.2 深度学习模型的学习过程

#### 2.2.1 参数初始化与优化方法

深度学习模型的参数初始化是一个重要的步骤,好的初始化方法能够帮助模型更快速地收敛。初始化不当可能导致模型训练困难,如梯度消失或爆炸。常用的初始化方法包括零初始化、随机初始化和He初始化等。

参数优化方法主要是指梯度下降及其变种算法。基本的梯度下降算法通过固定步长(学习率)来更新参数,而更先进的方法如Adam、RMSprop则引入了学习率的自适应调整机制,帮助模型在训练过程中更快地收敛,并在一定程度上抵抗过拟合。

优化算法通常需要配合适当的学习率调度策略来使用,如学习率衰减和周期性调整学习率等。此外,梯度裁剪、动量等技术也能有效改善优化过程。

#### 2.2.2 损失函数与正则化技术

损失函数是衡量模型预测值与真实值之间差异的函数,其目的是为模型优化提供指导方向。常见的损失函数包括均方误差(MSE)、交叉熵损失等。在不同的任务中,选择合适的损失函数对于模型训练至关重要。

正则化技术用于防止模型过拟合,常见的正则化方法包括L1正则化、L2正则化,以及Dropout技术。L1和L2正则化通过在损失函数中添加与模型权重相关的项来约束模型的复杂度。Dropout则是一种在训练过程中随机丢弃一部分神经元的方法,从而在一定程度上防止模型对训练数据过度拟合。

### 2.3 深度学习模型的性能评估

#### 2.3.1 交叉验证与超参数调优

交叉验证是一种评估模型泛化能力的方法,通过将数据集分成多个子集,并在其中一部分上训练模型,另一部分上验证模型,可以减少模型评估的方差,从而更准确地估计模型性能。

超参数调优是指在模型训练之前设定模型的参数,如学习率、网络层数、每层神经元数量等。常用的超参数搜索方法包括网格搜索、随机搜索和贝叶斯优化等。有效的超参数调优可以显著提升模型性能。

#### 2.3.2 评估指标与模型比较

在深度学习中,根据不同的任务,有不同的评估指标。对于分类任务,通常使用准确率、精确率、召回率和F1分数等指标;对于回归任务,常用的指标有均方误差、平均绝对误差等。

模型比较是评估模型性能的重要环节,除了使用单一指标外,还可以采用ROC曲线、AUC值等方法进行综合评估。在比较时,还需要考虑到模型的复杂度、训练和预测时间等因素,以评估模型的实际应用价值。

# 3. 深度学习模型可解释性方法论

## 3.1 可解释性工具与技术

### 3.1.1 特征重要性评分方法

深度学习模型的黑箱特性使得其决策过程难以被理解,但通过特征重要性评分方法,我们能够对模型的内部机制有所洞察。这些方法包括但不限于:Shapley值、Permutation Feature Importance和LIME(局部可解释模型-不透明模型的解释)。这些方法通过分配分数来衡量每个特征对模型预测的贡献度,帮助我们识别模型的关键决策因素。

以LIME为例,其核心思想是对数据点周围的局部区域进行建模,以推断该点附近模型的行为。它通过对输入样本添加噪声,然后观察预测值的变化来工作。这些变化用于训练一个可解释的替代模型,如线性模型或决策树。

下面展示了使用LIME库对图像分类任务进行可解释性的代码示例:

```python

import lime

import lime.lime_image

import numpy as np

from keras.models import load_model

# 加载预训练的模型(此处假设模型已存在)

model = load_model('path_to_model.h5')

# 创建LIME解释器

explainer = lime.lime_image.LimeImageExplainer()

# 对一张图片进行解释

image = np.array(image) # 图片需要是3维数组形式

idx = image_paths.index('image.jpg') # 图片在数据集中的位置

exp = explainer.explain_instance(image, classifier_fn, top_labels=5, hide_color=0, num_samples=1000)

# 显示LIME解释结果

temp, mask = exp.get_image_and_mask(***_labels[0], positive_only=True, num_features=10, hide_rest=False)

temp1, mask1 = exp.get_image_and_mask(***_labels[0], positive_only=False, num_features=10, hide_rest=True)

plt.imshow(mark_boundaries(temp / 2 + 0.5, mask)) # 显示图片和重要区域

plt.show()

```

通过上述代码,LIME为模型的每个预测结果提供了一个可解释的局部视图。模型输出与输入特征之间的关系以可视化的形式呈现,这样研究人员和工程师能够直观地了解模型的关键驱动因素。

### 3.1.2 模型可视化技术

可视化技术能够帮助我们以直观的方式理解深度学习模型的内部结构。例如,可视化卷积神经网络(CNN)中的特征图可以帮助我们理解模型如何从输入图像中识别模式和特征。

在本例中,我们利用keras-vis库来生成一个卷积神经网络的激活图,以查看哪个区域影响了模型的决策。这在图像识别任务中尤其有用。

```

```

0

0