揭秘Python并发编程实战:多线程与多进程的深度解析

发布时间: 2024-06-17 20:12:41 阅读量: 14 订阅数: 13

# 1. Python并发编程概述

并发编程是一种编程范式,它允许一个程序同时执行多个任务。在Python中,并发编程可以通过多线程和多进程两种方式实现。

### 1.1 多线程编程

多线程编程是指在一个进程中创建和管理多个线程。每个线程都是一个独立的执行单元,它拥有自己的栈空间和程序计数器。多线程编程可以提高程序的性能,因为它允许多个任务同时执行,而不必等待每个任务完成。

### 1.2 多进程编程

多进程编程是指在一个计算机系统中创建和管理多个进程。每个进程都是一个独立的程序,它拥有自己的内存空间和资源。多进程编程可以提高程序的稳定性,因为它允许每个进程独立运行,而不受其他进程的影响。

# 2. 多线程编程实践

### 2.1 线程的创建和管理

#### 2.1.1 线程的创建

在 Python 中,可以通过 `threading` 模块创建线程。最简单的方法是使用 `Thread` 类:

```python

import threading

def task():

print("Hello from thread")

thread = threading.Thread(target=task)

thread.start()

```

这段代码创建了一个新的线程,该线程将执行 `task` 函数。`start()` 方法启动线程,使它开始执行。

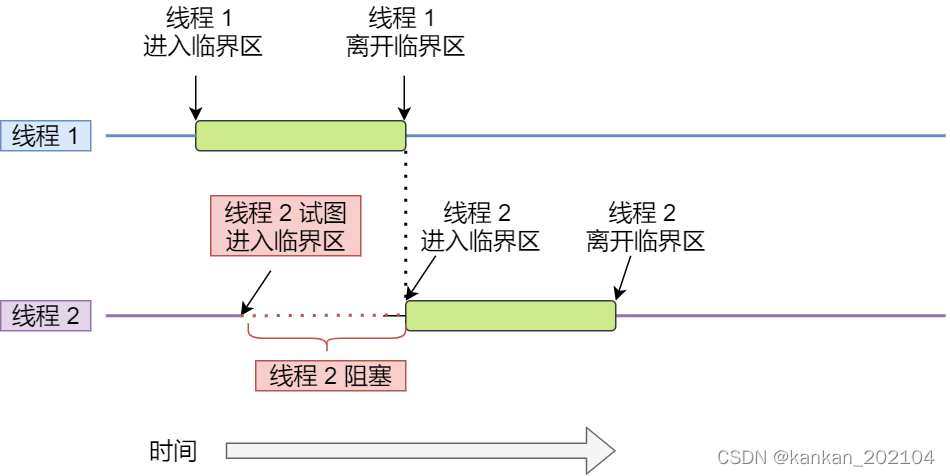

#### 2.1.2 线程的同步和通信

多个线程可以同时访问共享资源,这可能会导致数据竞争和不一致。为了防止这种情况,需要使用同步机制,如锁和事件。

**锁**用于保护共享资源,确保一次只有一个线程可以访问它。Python 中的锁可以由 `threading.Lock` 类表示:

```python

import threading

lock = threading.Lock()

def task():

with lock:

# 临界区代码

pass

```

**事件**用于通知线程某个事件已发生。Python 中的事件可以由 `threading.Event` 类表示:

```python

import threading

event = threading.Event()

def task():

event.wait()

# 事件已发生,继续执行

```

### 2.2 多线程编程的应用场景

#### 2.2.1 并行计算

多线程编程最常见的应用之一是并行计算。通过将任务分配给多个线程,可以同时执行它们,从而提高性能。

#### 2.2.2 I/O 密集型任务

I/O 密集型任务涉及大量 I/O 操作,例如文件读写或网络通信。多线程编程可以提高这些任务的性能,因为线程可以并行执行 I/O 操作,而无需等待 I/O 完成。

**表格:多线程编程的应用场景**

| 应用场景 | 描述 |

|---|---|

| 并行计算 | 将任务分配给多个线程,同时执行 |

| I/O 密集型任务 | 并行执行 I/O 操作,提高性能 |

**流程图:多线程编程的应用场景**

```mermaid

graph LR

subgraph 并行计算

A[并行计算] --> B[任务分配]

B[任务分配] --> C[多线程执行]

end

subgraph I/O 密集型任务

D[I/O 密集型任务] --> E[并行 I/O 操作]

E[并行 I/O 操作] --> F[性能提升]

end

```

# 3. 多进程编程实践

### 3.1 进程的创建和管理

#### 3.1.1 进程的创建

在 Python 中,可以使用 `multiprocessing` 模块创建进程。`multiprocessing` 模块提供了 `Process` 类,该类可以用来创建和管理进程。

```python

import multiprocessing

def worker(num):

"""子进程执行的函数"""

print(f"子进程 {num} 正在运行")

if __name__ == "__main__":

# 创建一个进程对象

p = multiprocessing.Process(target=worker, args=(1,))

# 启动进程

p.start()

# 等待进程结束

p.join()

```

**代码逻辑分析:**

* `multiprocessing.Process(target=worker, args=(1,))`:创建了一个进程对象,指定了要执行的函数 `worker` 和其参数 `1`。

* `p.start()`:启动进程。

* `p.join()`:等待进程结束。

#### 3.1.2 进程的通信和同步

进程之间需要通信和同步才能协同工作。`multiprocessing` 模块提供了以下机制:

* **队列(Queue):**用于在进程之间安全地交换数据。

* **管道(Pipe):**用于在进程之间双向通信。

* **锁(Lock):**用于防止多个进程同时访问共享资源。

* **信号量(Semaphore):**用于限制同时访问共享资源的进程数量。

* **事件(Event):**用于通知进程某个事件已发生。

### 3.2 多进程编程的应用场景

多进程编程适用于以下场景:

#### 3.2.1 资源密集型任务

当任务需要大量 CPU 或内存资源时,可以将其分配给多个进程,从而提高性能。

#### 3.2.2 分布式计算

在分布式系统中,可以将任务分配给不同的机器上的进程,从而并行处理。

### 3.2.3 表格:多进程编程的应用场景

| 应用场景 | 描述 |

|---|---|

| 资源密集型任务 | 任务需要大量 CPU 或内存资源 |

| 分布式计算 | 任务分配给不同机器上的进程 |

| I/O 密集型任务 | 任务涉及大量 I/O 操作 |

| 并行计算 | 任务可以并行执行 |

### 3.2.4 流程图:多进程编程的应用场景

```mermaid

graph LR

subgraph 应用场景

A[资源密集型任务] --> B[分布式计算]

A --> C[I/O 密集型任务]

A --> D[并行计算]

end

```

# 4. 多线程与多进程的比较和选择

### 4.1 性能和资源消耗

多线程和多进程在性能和资源消耗方面存在显着差异。

**性能**

* 多线程:由于线程共享同一内存空间,因此线程之间的切换开销较小,性能较高。

* 多进程:由于进程具有独立的内存空间,因此进程之间的切换开销较大,性能较低。

**资源消耗**

* 多线程:由于线程共享同一内存空间,因此内存消耗较少。

* 多进程:由于每个进程都有自己的内存空间,因此内存消耗较大。

### 4.2 适用场景和限制

多线程和多进程适用于不同的场景,并具有各自的限制。

**多线程适用场景**

* CPU密集型任务:多线程可以有效利用多核 CPU,提升计算性能。

* I/O密集型任务:多线程可以同时处理多个 I/O 请求,提高 I/O 吞吐量。

* 并行计算:多线程可以将任务分解为多个子任务,并行执行,提升计算效率。

**多线程限制**

* GIL(全局解释器锁):Python 中存在 GIL,它限制了同一时间只能有一个线程执行 Python 字节码,这会影响多线程的并行性。

* 共享内存:线程共享同一内存空间,如果处理不当,可能会导致数据竞争和死锁。

**多进程适用场景**

* 资源密集型任务:多进程可以充分利用系统资源,提升资源密集型任务的性能。

* 分布式计算:多进程可以将任务分配到不同的机器上执行,实现分布式计算。

* 避免 GIL 限制:多进程不受 GIL 限制,可以充分利用多核 CPU 的并行性。

**多进程限制**

* 内存消耗:每个进程都有自己的内存空间,因此内存消耗较大。

* 进程切换开销:进程之间的切换开销较大,可能会影响性能。

* 通信开销:进程之间需要通过 IPC(进程间通信)机制进行通信,这会引入额外的开销。

### 4.3 选择建议

在选择多线程还是多进程时,需要考虑以下因素:

* **任务类型:**CPU 密集型任务适合多线程,而资源密集型任务适合多进程。

* **并行性要求:**如果需要高并行性,则多线程更合适。

* **资源限制:**如果内存资源有限,则多线程更合适。

* **GIL 限制:**如果需要避免 GIL 限制,则多进程更合适。

通过综合考虑这些因素,可以做出最优选择,以充分利用 Python 并发编程的优势。

# 5. Python并发编程中的常见问题

### 5.1 死锁和竞态条件

**死锁**

死锁是指两个或多个线程或进程无限期地等待对方释放资源,从而导致系统无法继续执行。在Python中,死锁通常是由线程或进程试图获取同一把锁时引起的。

**解决死锁**

解决死锁的方法包括:

* **避免死锁:**通过仔细设计程序,避免线程或进程同时持有多个锁。

* **死锁检测和恢复:**使用死锁检测算法,例如超时或死锁检测库,检测死锁并采取措施恢复系统。

* **预防死锁:**使用锁层次结构或优先级继承等技术,防止死锁发生。

**竞态条件**

竞态条件是指多个线程或进程同时访问共享资源时,导致资源状态不一致。在Python中,竞态条件通常是由多个线程或进程同时修改同一个变量或数据结构时引起的。

**解决竞态条件**

解决竞态条件的方法包括:

* **互斥锁:**使用互斥锁,确保一次只有一个线程或进程可以访问共享资源。

* **原子操作:**使用原子操作,确保对共享资源的修改是不可中断的。

* **并发安全数据结构:**使用并发安全的数据结构,例如队列或字典,处理共享资源。

### 5.2 调试和性能优化

**调试**

调试并发程序可能具有挑战性,因为多个线程或进程同时执行。以下是一些调试技巧:

* **打印日志:**在关键代码路径中打印日志,以跟踪线程或进程的执行。

* **使用调试器:**使用Python调试器(pdb)或其他调试工具,逐步执行代码并检查变量值。

* **可视化工具:**使用可视化工具,例如PyCharm或Visual Studio Code,可视化线程或进程的执行。

**性能优化**

优化并发程序的性能至关重要,以避免死锁、竞态条件和其他问题。以下是一些性能优化技巧:

* **减少锁争用:**通过细粒度锁定或使用非阻塞算法,减少对锁的争用。

* **使用线程池:**使用线程池,管理线程的生命周期并提高性能。

* **优化数据结构:**选择合适的并发安全数据结构,例如队列或字典,以优化数据访问。

**代码示例**

**死锁示例**

```python

import threading

# 创建两个线程

thread1 = threading.Thread(target=lambda: print("Thread 1"))

thread2 = threading.Thread(target=lambda: print("Thread 2"))

# 创建一个锁

lock = threading.Lock()

# 线程1尝试获取锁

lock.acquire()

# 线程2尝试获取锁

lock.acquire()

# 死锁发生

```

**竞态条件示例**

```python

import threading

# 共享变量

shared_variable = 0

# 创建两个线程

thread1 = threading.Thread(target=lambda: shared_variable += 1)

thread2 = threading.Thread(target=lambda: shared_variable -= 1)

# 启动线程

thread1.start()

thread2.start()

# 等待线程完成

thread1.join()

thread2.join()

# 输出共享变量的值

print(shared_variable) # 可能为 0、1 或 -1

```

# 6. Python并发编程的实战应用

### 6.1 Web服务器并行化

**应用场景:**

当Web服务器处理大量并发请求时,使用多线程或多进程可以显著提高吞吐量和响应时间。

**多线程并行化:**

```python

from flask import Flask, request, jsonify

app = Flask(__name__)

@app.route('/process', methods=['POST'])

def process():

data = request.get_json()

result = process_data(data)

return jsonify(result)

if __name__ == '__main__':

app.run(host='0.0.0.0', port=5000, threads=4)

```

**多进程并行化:**

```python

from multiprocessing import Process

from flask import Flask, request, jsonify

app = Flask(__name__)

def process_request(data):

result = process_data(data)

return result

@app.route('/process', methods=['POST'])

def process():

data = request.get_json()

p = Process(target=process_request, args=(data,))

p.start()

return jsonify({'status': 'processing'})

if __name__ == '__main__':

app.run(host='0.0.0.0', port=5000, processes=4)

```

**代码解释:**

* 多线程并行化使用`app.run(threads=4)`设置线程池大小。

* 多进程并行化使用`Process`类创建新进程,并使用`target`和`args`参数指定要执行的函数和参数。

* 进程启动后,Web服务器返回一个`processing`状态,表示请求正在处理中。

### 6.2 数据处理并行化

**应用场景:**

当需要对大量数据进行处理时,可以使用多线程或多进程来并行执行任务,从而缩短处理时间。

**多线程并行化:**

```python

import threading

import time

def process_data(data):

# 处理数据

time.sleep(1)

data = [1, 2, 3, 4, 5, 6, 7, 8, 9, 10]

start = time.time()

threads = []

for item in data:

t = threading.Thread(target=process_data, args=(item,))

threads.append(t)

t.start()

for t in threads:

t.join()

end = time.time()

print(f'多线程处理时间:{end - start}')

```

**多进程并行化:**

```python

import multiprocessing

import time

def process_data(data):

# 处理数据

time.sleep(1)

data = [1, 2, 3, 4, 5, 6, 7, 8, 9, 10]

start = time.time()

processes = []

for item in data:

p = multiprocessing.Process(target=process_data, args=(item,))

processes.append(p)

p.start()

for p in processes:

p.join()

end = time.time()

print(f'多进程处理时间:{end - start}')

```

**代码解释:**

* 多线程并行化使用`threading.Thread`类创建线程,并使用`target`和`args`参数指定要执行的函数和参数。

* 多进程并行化使用`multiprocessing.Process`类创建进程,并使用`target`和`args`参数指定要执行的函数和参数。

* 进程或线程启动后,主进程或主线程等待所有子进程或子线程完成。

* 最后打印出多线程和多进程处理数据的耗时对比。

0

0