【Java I_O流内存映射】:提升I_O效率的秘密武器

发布时间: 2024-09-24 20:01:10 阅读量: 36 订阅数: 41

IPC.rar_IPC_java i_java ipc_java共享内存_共享内存

# 1. Java I/O流的基础知识

## 简介

Java I/O流是用于输入(input)和输出(output)操作的类和接口集合。它允许Java程序在运行时从多种数据源读取数据,以及将数据写入多种目标。在这一章,我们将对Java I/O流的体系结构和基本概念进行概述。

## Java I/O体系结构

Java的I/O体系结构基于两种模型:字节流和字符流。字节流处理原始数据(如图片和视频),而字符流则处理文本数据。每种类型都包含输入和输出流,分别对应于`InputStream`/`Reader`和`OutputStream`/`Writer`。

## I/O流的分类

Java I/O流可以进一步细分为几个子类,包括但不限于`FileInputStream`、`FileOutputStream`、`BufferedInputStream`和`BufferedWriter`等。这些流提供了不同的功能,例如缓冲(减少对设备的I/O次数)、过滤(添加额外的处理步骤)等。

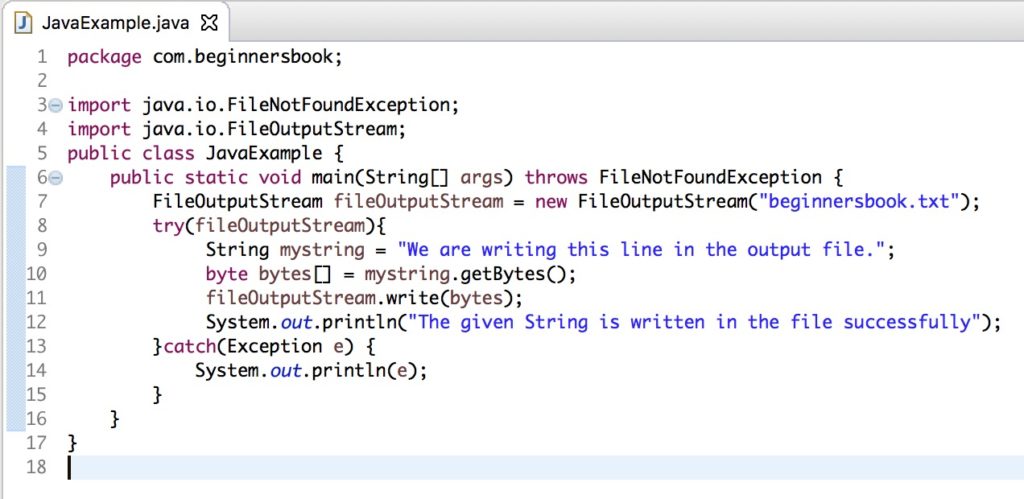

## 应用示例

为了快速理解Java I/O流的使用,可以看一个简单的文件复制程序示例。这个程序将从一个输入流读取字节,并将它们写入到一个输出流中。

```java

import java.io.*;

public class FileCopyExample {

public static void main(String[] args) {

FileInputStream inputStream = null;

FileOutputStream outputStream = null;

try {

inputStream = new FileInputStream("input.txt");

outputStream = new FileOutputStream("output.txt");

int data;

while ((data = inputStream.read()) != -1) {

outputStream.write(data);

}

} catch(IOException e) {

e.printStackTrace();

} finally {

try {

if (inputStream != null) inputStream.close();

if (outputStream != null) outputStream.close();

} catch(IOException e) {

e.printStackTrace();

}

}

}

}

```

在上述示例中,我们创建了`FileInputStream`和`FileOutputStream`对象来分别从文件读取和写入数据。使用`try-with-resources`语句确保资源得到释放,即使在发生异常时也是如此。这个基础示例展示了I/O流如何用于文件操作。随着本章的深入,我们将探讨更多高级特性和I/O流的用法。

# 2. 内存映射的概念与原理

## 2.1 内存映射的基本概念

### 2.1.1 什么是内存映射

内存映射(Memory-Mapped I/O)是一种允许程序通过虚拟内存地址直接访问内核缓冲区的技术。在内存映射中,一个文件或者文件的一部分被映射到进程的地址空间中,于是文件的内容就可以像访问普通内存一样进行读写操作。这种方式允许快速的数据访问,因为它绕过了标准的读写系统调用,减少了数据在内核空间和用户空间之间的拷贝。

### 2.1.2 内存映射的优势

内存映射相比于传统的文件操作有诸多优势。首先,它能够提供更快的文件访问速度,因为不需要通过传统的系统调用进行数据拷贝。其次,内存映射可以简化程序设计,因为文件的映射区域可以像访问内存一样读写,无需使用读写函数。最后,内存映射允许多个进程共享内存区域,这样在进行文件交换或进程间通信时,可以通过共享内存映射区域来实现高效的协作。

## 2.2 内存映射的实现机制

### 2.2.1 内存映射的底层原理

内存映射的实现基于操作系统的内存管理单元(MMU),它能够将物理内存映射到进程的虚拟地址空间。在Unix和类Unix系统中,`mmap`系统调用是实现内存映射的关键。当一个文件被`mmap`调用映射后,文件的内容实际上被加载到操作系统的页缓存中。当进程访问该虚拟地址时,MMU将其转换为对应的物理地址,并读写文件内容。

### 2.2.2 Java中内存映射的实现

在Java中,内存映射是通过`java.nio`包中的`FileChannel`类和`MappedByteBuffer`类来实现的。`FileChannel`的`map`方法提供了创建内存映射文件的能力。`MappedByteBuffer`是一个抽象类,它继承自`ByteBuffer`,提供了内存映射文件的视图。以下是Java中创建内存映射文件的基本代码示例:

```java

import java.io.RandomAccessFile;

import java.nio.MappedByteBuffer;

import java.nio.channels.FileChannel;

public class MemoryMappedFileExample {

public static void main(String[] args) throws Exception {

RandomAccessFile aFile = new RandomAccessFile("largeFile.txt", "rw");

FileChannel fileChannel = aFile.getChannel();

long size = fileChannel.size();

MappedByteBuffer buffer = fileChannel.map(FileChannel.MapMode.READ_WRITE, 0, size);

// 在这里可以直接对buffer进行读写操作

// ...

fileChannel.close();

aFile.close();

}

}

```

在这段代码中,`RandomAccessFile`以读写模式打开文件,`getChannel()`方法用于获取一个`FileChannel`实例。通过`map`方法创建一个可读写的`MappedByteBuffer`。该字节缓冲区直接映射到文件内容,允许通过`buffer`变量像操作普通缓冲区一样进行数据读写。

## 2.3 内存映射与其他I/O技术的比较

### 2.3.1 传统I/O方式对比

传统的I/O操作依赖于`InputStream`和`OutputStream`类,每次读写操作都会涉及到内核空间和用户空间的数据拷贝。这种拷贝过程是低效的,尤其是在处理大型文件或需要频繁I/O操作的场景中。相比之下,内存映射避免了这种拷贝,从而提高了性能。

### 2.3.2 零拷贝技术与内存映射

零拷贝(Zero-copy)是一种减少或避免数据在内核空间和用户空间之间进行拷贝的技术。内存映射是实现零拷贝的一种方式,因为它允许数据直接在内核页缓存和用户进程之间传输,无需通过标准I/O函数进行拷贝。除了内存映射之外,零拷贝的实现还包括了其他技术,如`sendfile`系统调用,后者在某些操作系统中可以进一步提高数据传输效率。

# 3. 内存映射在Java I/O中的应用

## 3.1 内存映射文件的创建和使用

### 3.1.1 创建内存映射文件

在Java中创建内存映射文件涉及使用`java.nio.MappedBy

0

0