【强化学习损失函数探索】:奖励函数与损失函数的深入联系及优化策略

发布时间: 2024-11-25 19:01:49 阅读量: 5 订阅数: 18

# 1. 强化学习中的损失函数基础

强化学习(Reinforcement Learning, RL)是机器学习领域的一个重要分支,它通过与环境的互动来学习如何在特定任务中做出决策。在强化学习中,损失函数(loss function)起着至关重要的作用,它是学习算法优化的关键所在。损失函数能够衡量智能体(agent)的策略(policy)表现,帮助智能体通过减少损失来改进自身的决策能力。

损失函数的基本功能是评价智能体采取的行动与最优行为之间的差异,即所谓的偏差(deviation)。为了达到这一目的,损失函数需要定义明确,能够反映长期累积奖励(cumulative reward)的期望值。

理解损失函数在强化学习中的作用,是构建高效学习系统的先决条件。本章节将从损失函数的概念讲起,逐步介绍其在强化学习中的基本应用,并为后续章节中关于奖励函数与损失函数的关系等更深入的讨论打下基础。

# 2. 奖励函数与损失函数的关系

在强化学习中,奖励函数与损失函数是实现智能体决策优化的两个核心部分。理解它们之间的关系不仅有助于设计更加高效的算法,而且在策略优化和模型训练中起着至关重要的作用。

### 2.1 奖励函数在强化学习中的作用

#### 2.1.1 奖励机制的基本概念

在强化学习的框架内,智能体通过与环境的交互来学习。每当智能体完成一个动作后,环境会给予一个奖励值作为反馈。奖励机制的核心目的是引导智能体朝着期望的行为方向发展。奖励可以是正的,也可以是负的,正奖励鼓励智能体重复某个行为,而负奖励则促使智能体避免或停止某种行为。

```python

# 示例:简单的奖励函数逻辑

def reward_function(state, action, next_state):

"""

state: 当前状态

action: 执行的动作

next_state: 执行动作后的下一个状态

"""

# 假设我们定义了从状态到奖励的映射

reward_map = {

('state1', 'action1', 'state2'): 10,

('state1', 'action2', 'state3'): -5,

# 更多映射...

}

return reward_map.get((state, action, next_state), 0)

```

在这个简化的例子中,我们用一个字典`reward_map`来定义不同的状态、动作组合对应的奖励值。在实际应用中,奖励函数可以非常复杂,它可能基于复杂的环境模型、目标函数,或者用深度学习模型来预测。

#### 2.1.2 奖励函数的设计原则

设计一个高效的奖励函数需要考虑多个方面,其中包括但不限于:

- **激励目标行为**:奖励需要明确地反映出期望智能体去执行的行为。

- **避免误导性奖励**:防止智能体通过非期望的路径获取高奖励。

- **考虑长期影响**:奖励不仅仅要考虑即时回报,还要考虑到长期效益。

- **可调性**:奖励函数的参数应该可以调整,以便于在不同的环境和任务中进行优化。

### 2.2 损失函数在强化学习中的角色

#### 2.2.1 损失函数的目标和意义

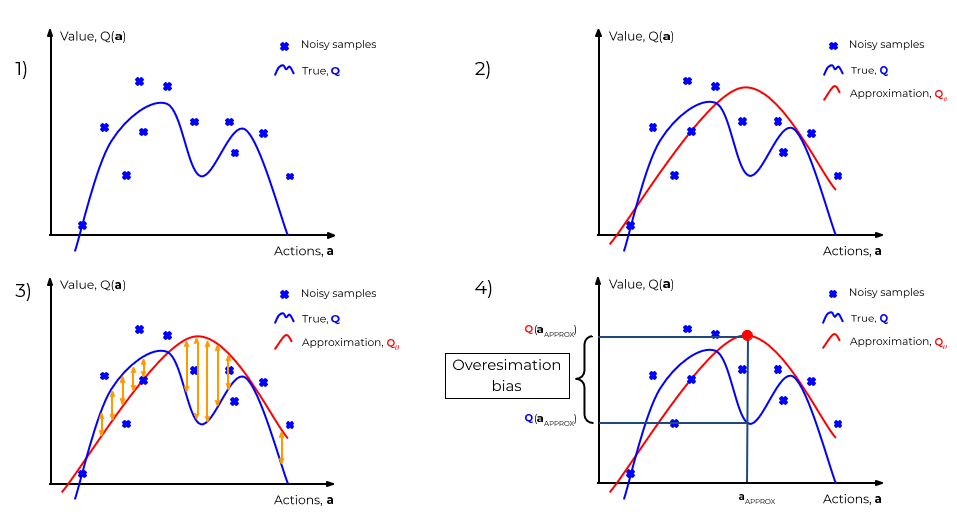

损失函数是强化学习算法中用来衡量智能体策略好坏的标准。它衡量的是智能体在特定状态下采取特定行为的预期回报与实际回报之间的差异。在强化学习中,损失函数的目标是指导智能体调整其策略参数,以最小化这种差异,从而实现策略的优化。

```python

# 示例:简单的损失函数

def loss_function(states, actions, rewards, Q_function):

"""

states: 状态列表

actions: 行动列表

rewards: 奖励列表

Q_function: Q函数,即策略的估计模型

"""

total_loss = 0

for state, action, reward in zip(states, actions, rewards):

Q预测 = Q_function(state, action)

Q实际 = reward + discount_factor * max(Q_function(state, next_action))

total_loss += (Q预测 - Q实际) ** 2

return total_loss

```

在上述示例中,`loss_function`计算了Q函数预测值和实际值之间的均方误差,这是一个衡量策略好坏的标准。通过最小化损失函数,智能体可以逐渐逼近最优策略。

#### 2.2.2 损失函数与奖励函数的关联

损失函数与奖励函数之间存在着密切的联系。损失函数实际上是在间接优化奖励函数,因为损失函数的最小化意味着智能体的预期回报与实际回报之间的差异最小化,这与获得最大奖励的目标是一致的。然而,损失函数的形式可以非常多样,依据不同的学习算法和模型会有不同的表现形式。

### 2.3 联系与差异:奖励与损失的对比分析

#### 2.3.1 奖励函数和损失函数的互补性

奖励函数和损失函数在强化学习中是互补的。奖励函数直接提供了学习信号,而损失函数提供了一个间接学习的机制。在强化学习的不同阶段,两者可以相互支持。例如,在策略的探索阶段,奖励函数可能起主导作用;而在策略的细化阶段,损失函数通过指导策略网络的参数调整起到决定性作用。

#### 2.3.2 在策略优化中的协同效应

在策略优化中,奖励函数和损失函数的协同效应是至关重要的。通过设计一个良好的奖励函数,智能体可以得到有效的引导,而损失函数则在策略参数调整上提供了可操作的方法。二者的结合往往能够产生比单独使用时更好的效果。

```mermaid

flowchart LR

A[智能体行为] -->|反馈| B[奖励函数]

B -->|强化信号| C[损失函数]

C -->|参数调整| D[策略优化]

D --> A

```

这个流程图展示了奖励函数和损失函数在强化学习中的协同作用。智能体的行为首先反馈到奖励函数,得到强化信号,然后转换为损失函数的值,用于指导策略的优化过程。经过不断迭代,智能体的策略得以不断改进。

总的来说,奖励函数与损失函数在强化学习中的关系错综复杂,它们既相互独立又相互依赖。理解和掌握二者之间的关系对于设计高效的学习算法以及在实际问题中的应用具有重要的意义。

# 3. 损失函数的类型与优化

损失函数是强化学习中的核心组件,它能够衡量模型的预测值与真实值之间的差距。了解损失函数的类型、特性及其优化方法,对于设计有效的强化学习算法至关重要。

## 3.1 常见的强化学习损失函数

在强化学习中,损失函数可以分为不同的类型,每种类型适用于不同的情景,并对学习过程产生不同的影响。

### 3.1.1 价值损失函数

价值损失函数主要用来衡量代理(Agent)对状态价值或行为价值的估计准确性。这类损失函数通常与贝尔曼方程(Bellman equation)结合使用,确保价值函数逼近其真实值。

```python

# 一个简单的价值损失函数计算示例,采用均方误差(MSE)

import torch

# 假设我们有真实的回报值 (ground truth returns) 和代理预测的回报值 (predicted returns)

real_returns = torch.tensor([1.0, 2.0, 3.0], dtype=torch.float32)

predicted_returns = torch.tensor([1.1, 2.1, 3.1], dtype=torch.float32)

# 计算价值损失函数,这里是均方误差

value_loss = torch.nn.MSELoss()(predicted_returns, real_returns)

print(f"Value Loss: {value_loss.item()}")

```

### 3.1.2 策略梯度损失函数

策略梯度损失函数用于直接优化代理的策略,使得在给定状态下执行特定行为的概率最大化期望回报。

```python

# 策略梯度损失函数示例,使用对数概率乘以回报值进行优化

log_probs = torch.log(torch.tensor([0.1, 0.6, 0.3], dtype=torch.float32))

advantages = torch.tensor([1.0, 0.8, -0.5], dtype=torch.float32)

# 策略梯度损失函数计算

policy_loss = -torch.mean(log_probs * advantages)

print(f"Policy Loss: {

```

0

0