Linux系统下Python脚本性能优化:瓶颈分析与调优技巧,提升脚本效率

发布时间: 2024-06-22 22:36:15 阅读量: 90 订阅数: 33

一款能分析系统性能瓶颈的优化软件

# 1. Python脚本性能优化概述

Python脚本性能优化旨在提升脚本的执行效率和响应速度。它涉及识别和解决脚本执行中的瓶颈,并采取优化措施来提高性能。

优化脚本性能的好处包括:

- 缩短脚本执行时间

- 提高用户体验

- 降低服务器负载

- 节省计算资源

# 2. Python脚本性能瓶颈分析

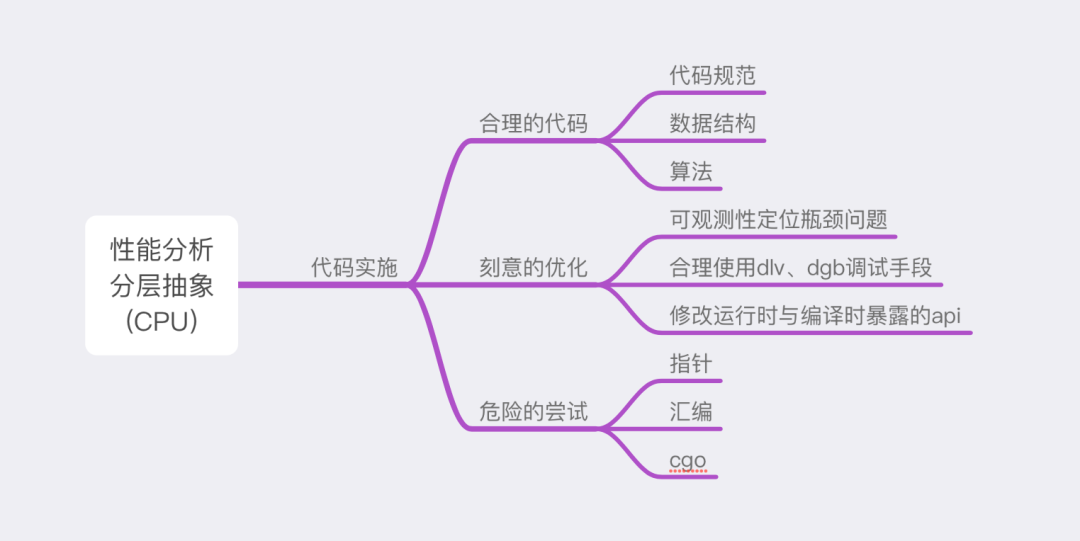

### 2.1 CPU瓶颈分析

#### 2.1.1 CPU占用率监控

**监控工具:**

* Linux系统自带:`top`、`ps`

* 第三方工具:`htop`、`atop`

**监控指标:**

* **CPU使用率:**反映CPU被占用的程度,超过80%表示存在CPU瓶颈。

* **进程CPU时间:**显示每个进程占用的CPU时间,有助于识别高CPU消耗的进程。

**代码示例:**

```bash

# 使用top命令监控CPU使用率

top -d 1 -p PID

```

**逻辑分析:**

`top`命令以每秒一次的频率刷新CPU使用率信息,`-d 1`指定刷新间隔为1秒,`-p PID`指定监控特定进程的CPU使用率。

#### 2.1.2 代码执行时间分析

**工具:**

* Python内置函数:`timeit`

* 第三方库:`cProfile`

**分析方法:**

1. 使用`timeit`函数测量代码执行时间:

```python

import timeit

code = '...'

timeit.timeit(code, number=100000)

```

2. 使用`cProfile`分析代码执行时间分布:

```python

import cProfile

cProfile.run('...')

```

**代码示例:**

```python

# 使用timeit测量代码执行时间

import timeit

code = 'for i in range(100000): pass'

print(timeit.timeit(code, number=100000))

```

**逻辑分析:**

`timeit`函数通过重复执行代码100000次来测量其执行时间,单位为秒。

### 2.2 内存瓶颈分析

#### 2.2.1 内存使用量监控

**监控工具:**

* Linux系统自带:`free`、`vmstat`

* 第三方工具:`glances`、`memwatch`

**监控指标:**

* **内存使用量:**反映内存被占用的程度,超过80%表示存在内存瓶颈。

* **交换空间使用量:**当物理内存不足时,系统会使用交换空间,交换空间使用量过高会影响性能。

**代码示例:**

```bash

# 使用free命令监控内存使用量

free -m

```

**逻辑分析:**

`free`命令显示内存使用情况,包括总内存、已用内存、空闲内存和交换空间使用量。

#### 2.2.2 内存泄漏检测

**工具:**

* Python内置库:`gc`

* 第三方库:`memory_profiler`

**分析方法:**

1. 使用`gc`模块检测内存泄漏:

```python

import gc

gc.collect()

gc.get_objects()

```

2. 使用`memory_profiler`分析内存泄漏:

```python

impo

```

0

0