提升数据处理效率:Hadoop SecondaryNameNode的I_O优化技巧

发布时间: 2024-10-26 13:42:06 阅读量: 22 订阅数: 48

大数据处理优化:Spark与Hadoop的深度应用与性能调优

# 1. Hadoop SecondaryNameNode简介

Hadoop SecondaryNameNode 是 Hadoop 分布式文件系统(HDFS)中的一个关键组件,其主要功能是合并文件系统的元数据检查点和编辑日志,减轻主 NameNode 的内存压力。这个角色对于大型 Hadoop 集群的稳定运行至关重要。如果没有 SecondaryNameNode,随着时间的推移,主 NameNode 上的内存将不断累积编辑日志,并最终导致节点崩溃。SecondaryNameNode 在维护系统稳定性和提升性能方面起到了“缓冲”的作用,确保了 Hadoop 系统的高可用性和扩展性。接下来的章节将深入探讨 Hadoop 文件系统的核心原理以及 SecondaryNameNode 的工作机制。

# 2. Hadoop文件系统的核心原理

### 2.1 HDFS的基本架构

#### 2.1.1 NameNode与DataNode的作用

Hadoop分布式文件系统(HDFS)设计上具有高容错性和可扩展性,其核心组件包括NameNode和DataNode。NameNode是HDFS的主节点,它负责管理文件系统的命名空间,维护文件系统的目录树结构,并记录每个文件被切分成的各个数据块(block)的位置信息。DataNode是HDFS的工作节点,负责存储实际数据,将数据分块存储在本地文件系统中,每个DataNode会周期性地向NameNode发送心跳信号和块报告,以维持健康状态的集群。

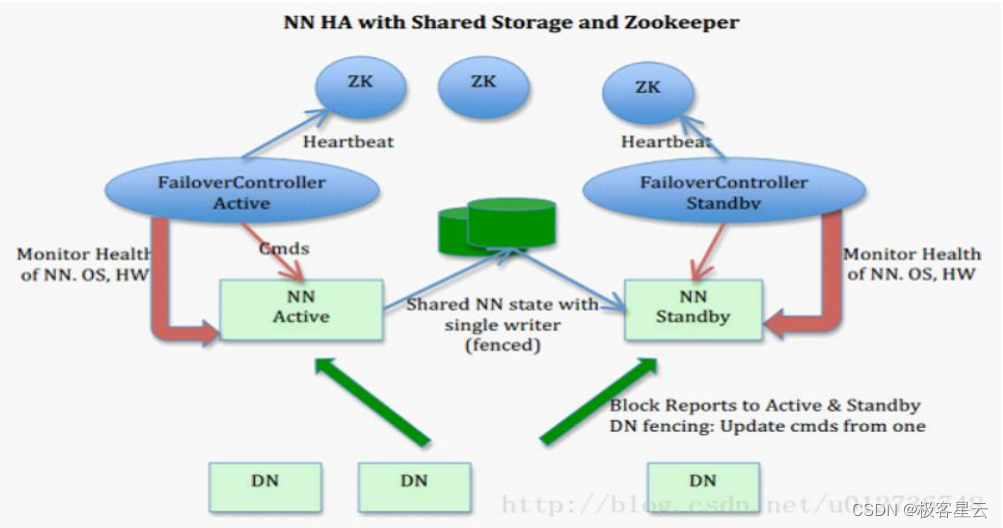

由于NameNode集中管理了元数据,这造成潜在的单点故障问题,因此Hadoop采取了多种措施以增强其可靠性,如支持NameNode的热备份,使用SecondaryNameNode或者Checkpoint Node来辅助NameNode完成编辑日志的合并工作。

#### 2.1.2 HDFS的读写流程

HDFS的读写操作流程是理解其高效性的关键。当客户端需要读取数据时,它首先与NameNode通信获取数据块的位置信息。之后,客户端直接与拥有数据的DataNode建立连接,从而直接读取所需数据块。这种设计有效降低了NameNode的负载,提高了读取速度。

写入操作更为复杂,需要确保数据的可靠性和一致性。当客户端写入数据时,首先也是与NameNode通信,获取空闲的DataNode列表。客户端将数据分割成块,并并行地写入到多个DataNode中。写入过程中,数据首先存储在DataNode的内存中,然后逐渐写入磁盘,以保证即使在系统崩溃的情况下数据也不丢失。完成数据写入后,客户端通知NameNode更新命名空间元数据。

### 2.2 SecondaryNameNode的工作机制

#### 2.2.1 检查点的创建过程

SecondaryNameNode的主要职责是定期合并编辑日志和文件系统的元数据检查点,来减轻NameNode的压力。HDFS通过编辑日志记录所有对文件系统的更改,随着时间的推移,编辑日志会不断增长。由于NameNode的内存资源有限,因此需要定期创建检查点来压缩编辑日志并更新文件系统的命名空间状态。

检查点的创建过程分为以下几个步骤:

1. SecondaryNameNode请求NameNode停止服务一段时间,此时NameNode不再处理客户端请求。

2. NameNode将内存中的文件系统状态(fsimage)和编辑日志(edit log)发送给SecondaryNameNode。

3. SecondaryNameNode接收到fsimage和edit log后,开始合并这两个文件,生成新的fsimage。

4. 新的fsimage被返回给NameNode,而原来的编辑日志则可以被清空或归档。

5. NameNode将新的fsimage加载到内存中,并继续服务客户端请求。

#### 2.2.2 滚动编辑日志的重要性

编辑日志的滚动是保证HDFS稳定运行的关键步骤。编辑日志中记录了从上次检查点之后的所有文件系统更改操作。如果不定时对编辑日志进行滚动,那么随着编辑日志的不断增长,NameNode的重启和故障恢复将变得非常缓慢,甚至可能导致内存溢出。

编辑日志滚动的过程包括:

1. NameNode确定当前编辑日志达到预设的大小限制或时间周期后,开始创建新的编辑日志文件。

2. 命令当前所有的客户端操作暂停,并等待所有正在执行的操作完成。

3. 关闭当前的编辑日志文件,并创建一个新的编辑日志文件用于后续记录。

4. 通知客户端可以继续进行文件操作,同时开始新的写入操作日志。

滚动编辑日志保证了即使发生故障,NameNode也能在可接受的时间内恢复到最近的一致状态,从而提高系统的鲁棒性。

为了深入理解HDFS架构和SecondaryNameNode的工作机制,需要仔细审视代码逻辑和系统设计的细节。接下来的章节中,我们将进一步探讨Hadoop I/O性能瓶颈,并提供相应优化策略的详细分析。

# 3. I/O性能瓶颈分析

## 3.1 Hadoop I/O操作的挑战

### 3.1.1 磁盘I/O与网络I/O的限制

在Hadoop生态系统中,I/O操作是影响整体性能的关键因素之一。Hadoop的I/O操作主要分为磁盘I/O和网络I/O。磁盘I/O操作涉及数据的读写,而网络I/O则涉及数据在不同节点间传输的过程。

磁盘I/O性能受限于存储介质的速度和寻道时间。传统机械硬盘(HDD)相比于固态硬盘(SSD)有更长的寻道时间和较低的数据传输速率,这会导致Hadoop在处理大量小文件时效率低下。网络I/O的限制则体现在集群内部节点间的数据传输速率,尤其是在跨数据中心部署时,网络带宽和延迟问题会成为瓶颈。

### 3.1.2 I/O密集型任务的性能影响

对

0

0