Hadoop高可用性实现:SecondaryNameNode高效故障转移技巧

发布时间: 2024-10-26 13:15:26 阅读量: 43 订阅数: 36

# 1. Hadoop高可用性概念解析

大数据技术的核心之一是Hadoop,它依赖于高可用性(High Availability, HA)机制来保证在发生硬件故障或软件问题时,系统仍能持续稳定地提供服务。高可用性的关键在于能够快速从故障中恢复,最小化系统宕机时间。Hadoop高可用性架构通过实现主从(Master-Slave)模式,确保NameNode的故障可以迅速转移到备份节点上,从而使得整个集群仍然处于工作状态。

## 2.1 Hadoop NameNode的角色和功能

### 2.1.1 NameNode在Hadoop集群中的作用

NameNode是Hadoop分布式文件系统(HDFS)中最重要的组件之一,负责管理文件系统的命名空间,以及记录文件和目录的元数据信息。它不存储实际的数据文件,而是维护了文件系统树及整棵树内所有的文件和目录。这使得NameNode在数据定位和管理中起到至关重要的作用。

### 2.1.2 NameNode的内存和磁盘交互

NameNode主要的内存数据结构包括:文件系统命名空间的内存表示和文件到数据块的映射表。这些内存结构被定期保存到磁盘上的两个文件中,即命名空间镜像(fsimage)和编辑日志(edits)。文件系统的状态是通过这两个文件的组合来恢复的。因此,NameNode的磁盘交互对于HDFS的稳定性和数据恢复至关重要。

# 2. SecondaryNameNode工作机制

## 2.1 Hadoop NameNode的角色和功能

### 2.1.1 NameNode在Hadoop集群中的作用

NameNode是Hadoop分布式文件系统(HDFS)的核心组件,负责管理文件系统的命名空间以及客户端对文件的访问。具体来说,NameNode的作用可以分解为以下几个方面:

1. **命名空间管理:** NameNode维护着文件系统树及整个HDFS的元数据。这些元数据包括文件和目录的名称、权限、属性、以及每个文件的块信息和块存储位置的映射等。

2. **文件系统元数据存储:** NameNode将文件系统的所有元数据信息存储在内存中,以便快速检索。一旦NameNode重启,这些信息会被重新加载到内存中。

3. **客户端请求处理:** NameNode处理来自客户端的文件操作请求,如打开、关闭、重命名文件或目录等。对于读写请求,NameNode会为客户端提供所需的数据节点(DataNode)信息。

4. **数据块的复制策略:** NameNode负责文件块的复制策略,确保数据的安全性。当数据块副本数小于最小复制数时,NameNode会调度数据块在DataNode之间的复制。

5. **系统的维护和恢复:** NameNode定期接收DataNode的报告,了解数据块的状态,并进行元数据的备份。在发生故障时,NameNode支持数据的恢复。

下面的mermaid流程图展示了NameNode在HDFS中的基本操作流程:

```mermaid

graph LR

A[客户端请求] -->|打开文件| B(NameNode)

B -->|解析元数据| C[文件系统元数据]

B -->|通知DataNode| D[数据节点]

D -->|传输数据| A

B -->|心跳检测| D

B -->|接收报告| E[数据块状态]

B -->|元数据备份| F[持久化存储]

B -->|故障处理| G[系统恢复]

```

### 2.1.2 NameNode的内存和磁盘交互

NameNode的内存主要用来存储文件系统的命名空间和块映射信息。由于Hadoop中的文件被切分成一系列的块,NameNode需要追踪每个块与DataNode的映射关系。数据的读写操作都是通过这些映射关系来定位和访问数据块。

磁盘在NameNode中扮演了两个主要角色:

1. **元数据持久化:** NameNode需要将内存中的元数据信息定期持久化到磁盘上。这是通过编辑日志(edits log)和文件系统镜像(fsimage)来实现的。编辑日志记录了所有的文件系统更改操作,而fsimage则是一个包含文件系统元数据的快照。

2. **检查点机制:** 检查点(checkpoint)是NameNode重新启动时加载元数据的关键。在启动时,NameNode从最新的fsimage加载命名空间,然后逐条应用编辑日志,完成整个命名空间的重建。

## 2.2 SecondaryNameNode的工作原理

### 2.2.1 Checkpoint过程详解

Checkpoint是SecondaryNameNode的核心职责,它的主要作用是定期合并编辑日志和fsimage文件,以减少NameNode重启时的加载时间。Checkpoint过程分为以下几个步骤:

1. **接收编辑日志:** SecondaryNameNode定期从NameNode接收编辑日志的副本。

2. **合并编辑日志和fsimage:** SecondaryNameNode将接收到的编辑日志合并到本地的fsimage文件中,生成新的fsimage文件。

3. **返回新的fsimage:** 完成合并后,SecondaryNameNode将新的fsimage文件发送回NameNode。

4. **替换旧的元数据:** NameNode接收到新的fsimage后,替换旧的编辑日志和fsimage,这样即使NameNode发生故障,也可以快速恢复到最新状态。

Checkpoint过程中,可以使用以下Hadoop命令来监控SecondaryNameNode的工作状态:

```bash

hadoop secondarynamenode -checkpoint [force]

```

该命令会强制SecondaryNameNode进行 checkpoint 操作,如果不加 "force" 参数,SecondaryNameNode会在默认的时间间隔或者根据配置的检查点间隔进行自动的checkpoint。

### 2.2.2 SecondaryNameNode与Standby NameNode的对比

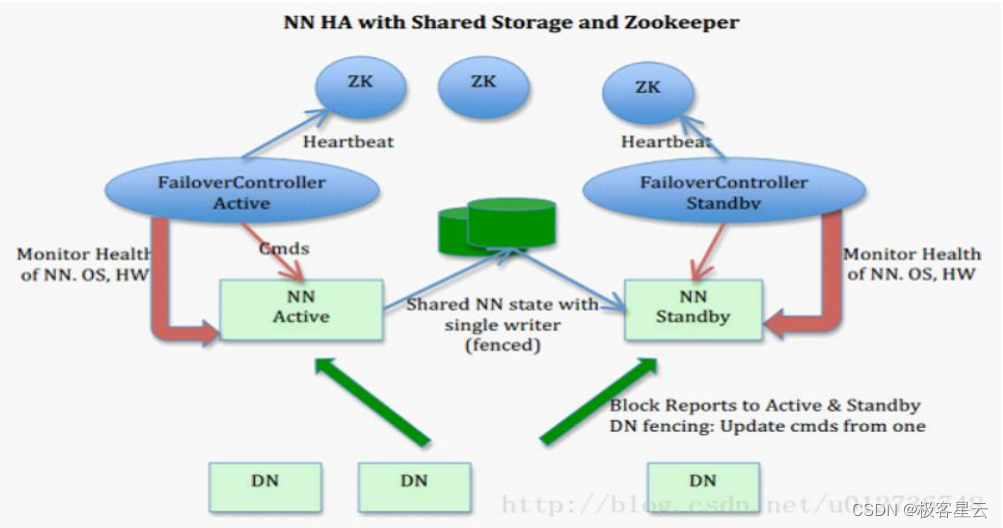

Hadoop 2.x以后引入了高可用性架构,其中引入了Standby NameNode来替代SecondaryNameNode。Standby NameNode与SecondaryNameNode的工作原理有以下几个主要的区别:

1. **热备份与冷备份:** SecondaryNameNode是一种冷备份机制,它在NameNode发生故障时能够提供最近的元数据状态,但它并不实时地与Active NameNode保持同步。而Standby NameNode作为热备份角色,它能够与Active NameNode实时同步元数据,实现真正的高可用性。

2. **数据一致性:** Standby NameNode通过Zookeeper和Quorum Journal Manager等组件,实现与Active NameNode的状态同步,确保了元数据的一致性。

3. **故障转移:** 在Hadoop 2.x的高可用性集群中,当Active NameNode发生故障时,Standby NameNode能够自动接管成为新的Active NameNode,从而提供无缝服务。而SecondaryNameNode则需要人工介入和额外配置来实现故障转移。

4. **资源消耗:** 由于需要实时同步数据,Standby NameNode消耗的资源相对较多,配置要求高;而SecondaryNameNode通常只在NameNode发生故障时才会参与工作,对资源的需求较低。

## 2.3 故障转移的必要性与挑战

### 2.3.1 高可用性环境下的故障转移概述

在高可用性(High Availability, HA)环境中,故障转移(failover)是确保服务不中断的关键机制。当集群的主节点(Active NameNode)发生故障时,能够将服务快速切换到备用节点(Standby NameNode)继续对外提供服务。故障转移过程对于用户而言应当是透明的,即用户不应感觉到服务有中断。

高可用性环境下的故障转移主要包含以下几个步骤:

1. **故障检测:** 通过心跳检测、健康检查等方式确定Active NameNode是否发生了故障。

2. **状态切换:** 当确认Active NameNode发生故障后,将Standby NameNode切换到Active状态,接管对外服务。

3. **数据同步:** 在切换之前,确保Standby NameNode与Active NameNode的数据完全同步,以免数据丢失或不一致。

4. **服务恢复:** 切换完成后,对外发布新的服务地址,并重新路由所有新的客户端请求到新的Active NameNode。

### 2.3.2 常见故障类型及影响分析

在Hadoop集群中,故障可以分为不同的类型,每种故障对集群的影响也不尽相同。常见的故障类型包括:

1. **硬件故障:** 包括服务器硬件损坏、网络故障等,这类故障影响整个DataNode或Nam

0

0