深度学习讲座6:神经网络训练基础

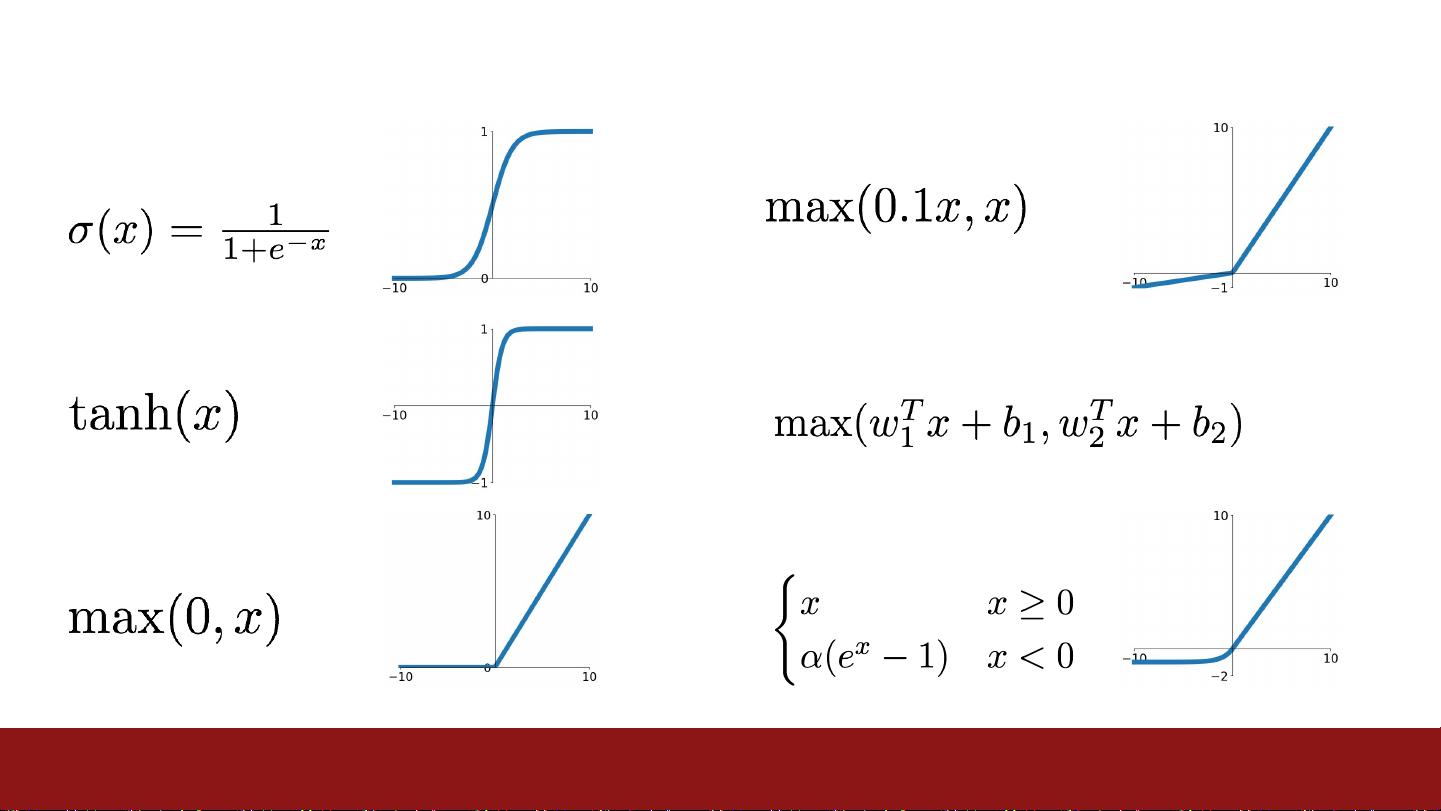

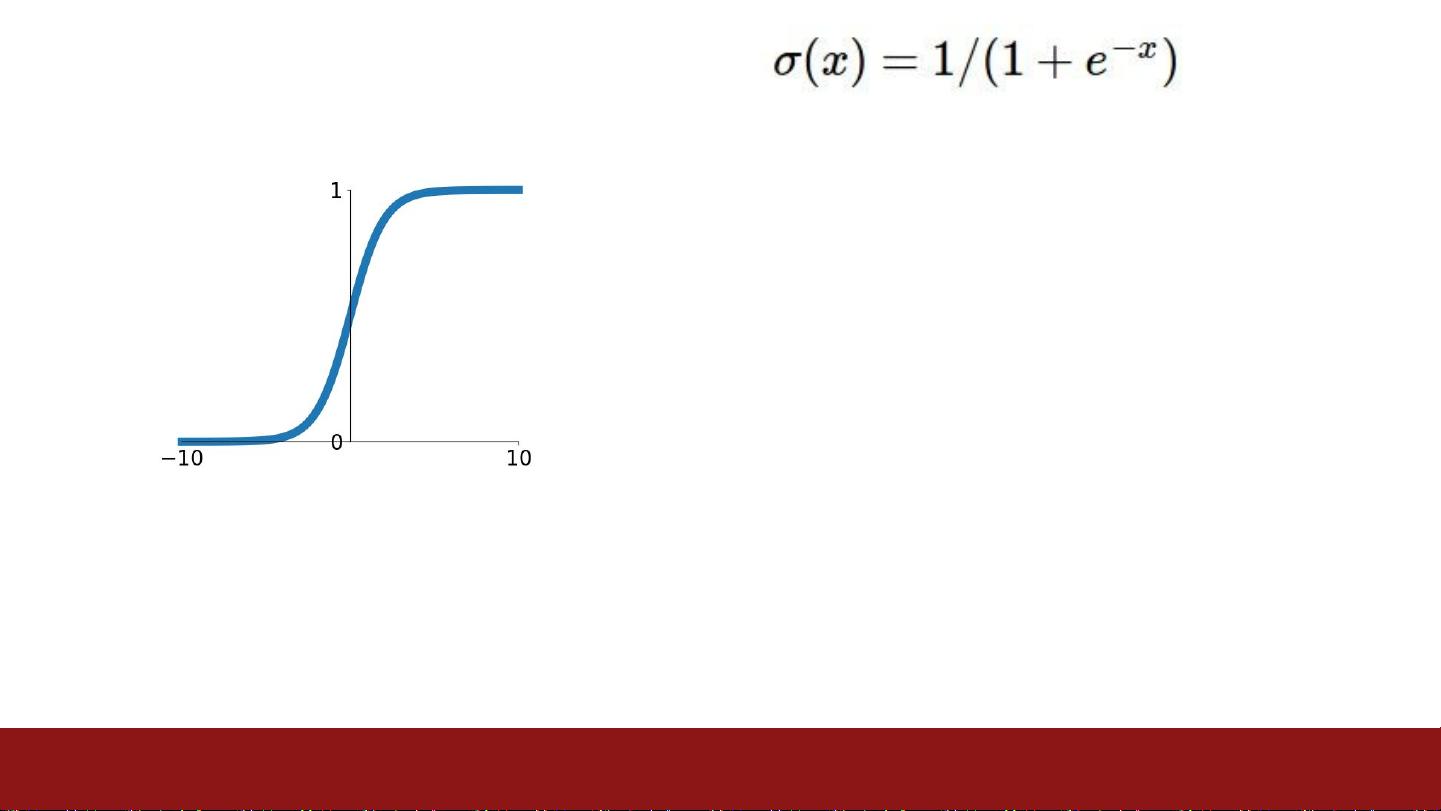

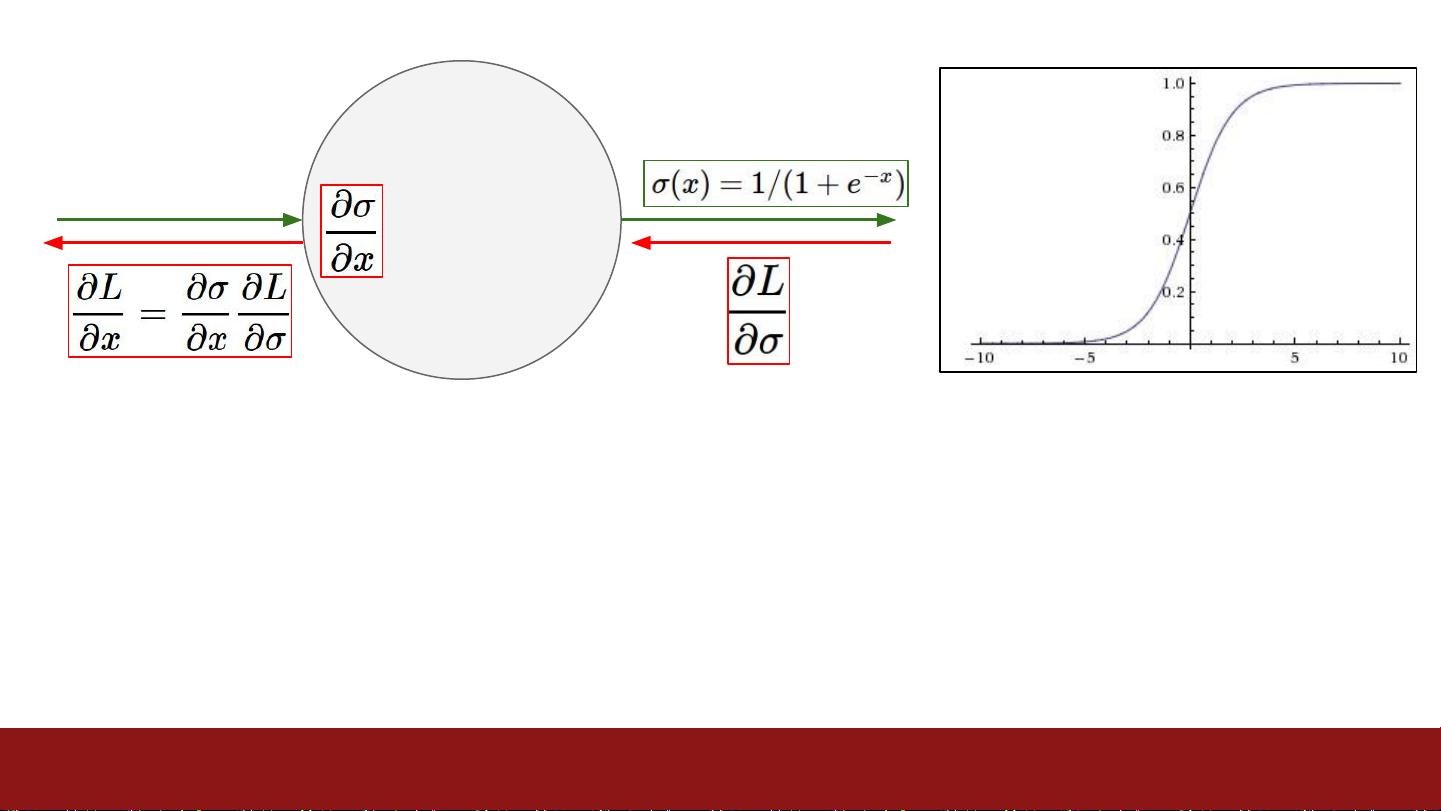

"cs231n_2017_lecture6.pdf" 这篇讲座主要讨论的是神经网络的训练,这是CS231n课程的一部分,由Fei-Fei Li, Justin Johnson和Serena Yeung在2017年4月20日进行。讲座分为两个部分,本部分是第一部分,主要关注神经网络的训练。 首先,提到了一个重要的行政事项,即作业1应在今天(4月20日)晚上11:59之前在Canvas上提交,作业2今天发布,项目提案则需在4月25日星期二前提交。此外,关于线性层的反向传播以及向量/张量导数的笔记链接在课程大纲中与第四讲相关联,这为理解神经网络的计算图和梯度计算提供了基础。 在内容部分,讲座首先回顾了之前的学习进度。讨论了线性评分函数,这是一个简单的模型,它将输入特征(x)通过权重矩阵(W)转换,然后通过损失函数(如 hinge loss)进行评估。这里的损失函数用于衡量模型预测的得分(s)与实际类别标签之间的差异。这个过程涉及到计算图的概念,它有助于理解和计算模型参数的梯度。 接着,讲座引入了两层神经网络,它包含一个线性层和一个非线性激活函数(h),以及第二个线性层。这种网络结构可以处理更复杂的模式,其中输入特征(x)通过第一层权重矩阵(W1)映射到隐藏层,然后隐藏层的输出通过第二层权重矩阵(W2)映射到输出层。隐藏层的神经元数量为100,输出层通常对应于10个类别。 最后,讲座提到了卷积神经网络(CNNs),这是在图像识别任务中广泛应用的神经网络结构。CNNs利用卷积层来检测局部特征,减少了参数的数量,并且能够捕获图像数据的空间结构。LeCun等人在1998年的研究被引用,他们的工作在深度学习领域具有里程碑意义,特别是对于卷积神经网络的发展。 这场讲座深入探讨了神经网络的基础训练方法,包括线性模型、多层神经网络和卷积神经网络的构建,以及与之相关的损失函数和计算图,这些都是理解深度学习算法的关键概念。

剩余88页未读,继续阅读

- 粉丝: 50

- 资源: 17

我的内容管理

展开

我的内容管理

展开

我的资源

快来上传第一个资源

我的资源

快来上传第一个资源

我的收益 登录查看自己的收益

我的收益 登录查看自己的收益 我的积分

登录查看自己的积分

我的积分

登录查看自己的积分

我的C币

登录后查看C币余额

我的C币

登录后查看C币余额

我的收藏

我的收藏  我的下载

我的下载  下载帮助

下载帮助

最新资源

- 构建Cadence PSpice仿真模型库教程

- VMware 10.0安装指南:步骤详解与网络、文件共享解决方案

- 中国互联网20周年必读:影响行业的100本经典书籍

- SQL Server 2000 Analysis Services的经典MDX查询示例

- VC6.0 MFC操作Excel教程:亲测Win7下的应用与保存技巧

- 使用Python NetworkX处理网络图

- 科技驱动:计算机控制技术的革新与应用

- MF-1型机器人硬件与robobasic编程详解

- ADC性能指标解析:超越位数、SNR和谐波

- 通用示波器改造为逻辑分析仪:0-1字符显示与电路设计

- C++实现TCP控制台客户端

- SOA架构下ESB在卷烟厂的信息整合与决策支持

- 三维人脸识别:技术进展与应用解析

- 单张人脸图像的眼镜边框自动去除方法

- C语言绘制图形:余弦曲线与正弦函数示例

- Matlab 文件操作入门:fopen、fclose、fprintf、fscanf 等函数使用详解

信息提交成功

信息提交成功