ETL技术在数据集成中的应用与挑战

110 浏览量

更新于2024-08-27

收藏 174KB PDF 举报

"面向数据集成的ETL技术研究"

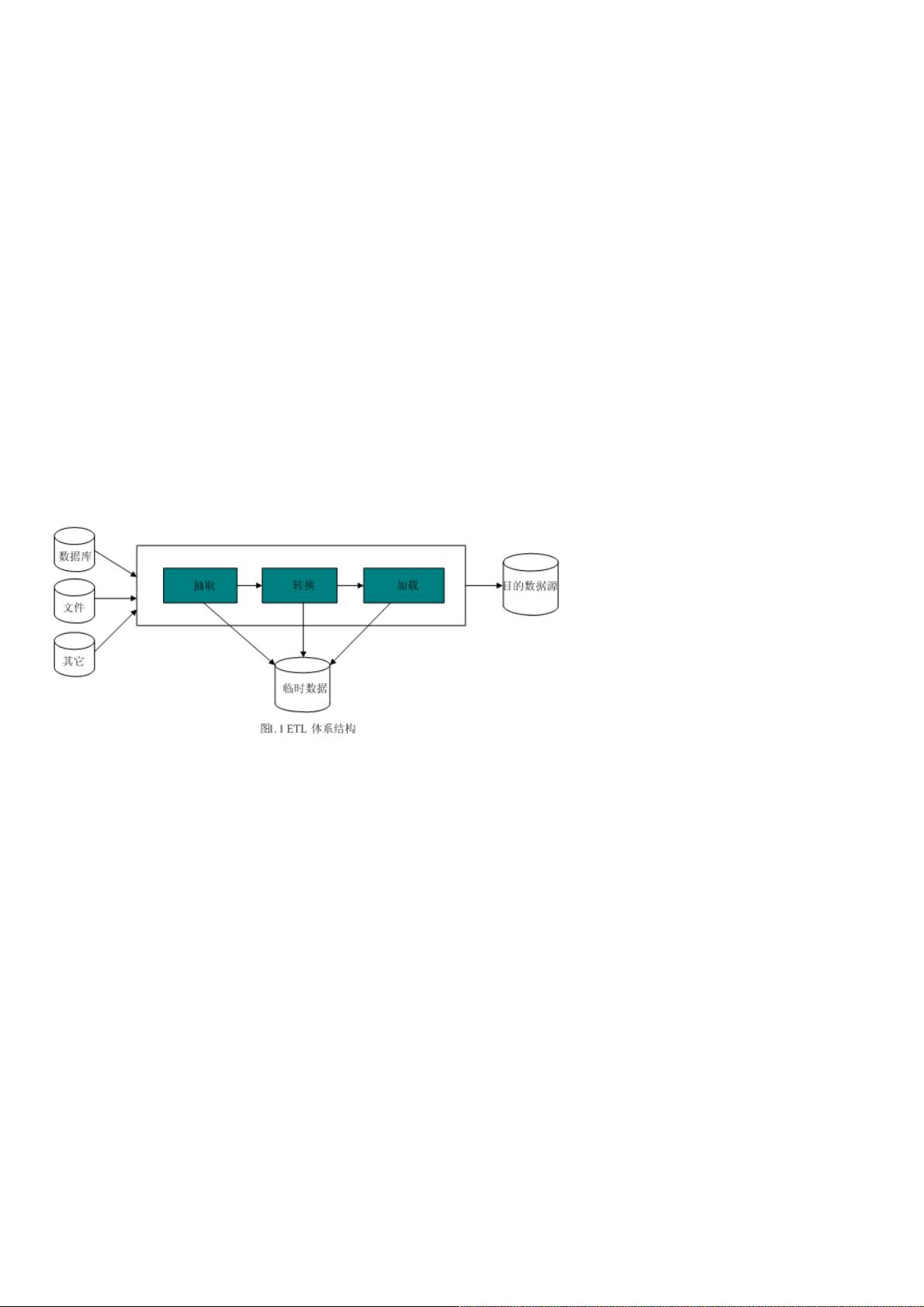

在企业信息化进程中,数据集成扮演着至关重要的角色,它能够整合来自不同源头、格式各异的数据,实现企业内部的数据共享,支持商务智能和数据仓库系统的运行。ETL(Extract, Transform, Load)技术是数据集成的核心方法,它包括数据抽取、转换和加载三个主要步骤。

1. 数据抽取:

数据抽取是从原始数据源中提取所需信息的过程。这可能涉及到多个异构系统,如ERP、CRM、SCM等。企业内部各个独立运作的信息系统导致数据冗余和重复劳动,因此需要一个统一的数据抽取机制来收集数据,避免这些不必要的问题。

2. 数据转换:

数据转换是将抽取的数据按照特定业务需求进行格式化和清理。这包括数据清洗,去除错误、不一致的数据,以及将数据转换为符合目标系统要求的格式。转换过程可能涉及到类型转换、数据规约、数据标准化等操作,确保数据的质量和一致性。

3. 数据加载:

数据加载是将经过转换的数据加载到目标系统,通常是数据仓库或数据集市。这个阶段确保数据准确无误地被存入,以便后续的分析和决策支持。

ETL技术最初应用于构建数据仓库,但现在已广泛应用于数据迁移、交换和同步等更广泛的场景。在ETL过程中,有以下几个关键技术和挑战:

- **连接器和适配器**:用于连接和通信不同的数据源,确保能访问各种类型的数据,如关系数据库、XML文件、API接口等。

- **数据质量控制**:在抽取和转换过程中检测和处理数据的错误、缺失值和异常,确保数据的准确性。

- **数据映射**:定义源数据与目标数据之间的映射规则,保证数据的一致性。

- **并行处理和性能优化**:大型ETL项目往往需要高效处理大量数据,因此并行处理和负载均衡技术是必要的。

- **元数据管理**:记录数据的来源、转换规则等信息,便于管理和维护ETL流程。

- **调度和监控**:自动化ETL作业的调度,实时监控任务执行情况,及时发现并解决可能出现的问题。

ETL技术的研究和发展对于提高企业数据利用率、提升决策效率和竞争优势具有重大意义。随着大数据、云计算等新技术的涌现,ETL也在不断演进,以适应更复杂的数据环境和更高的处理需求。例如,云ETL工具可以提供弹性的资源分配,分布式ETL可以处理PB级数据,而实时ETL则满足了实时分析的需求。理解并掌握ETL技术,对于现代企业的数据管理策略至关重要。

2020-06-03 上传

2021-08-09 上传

点击了解资源详情

点击了解资源详情

2010-09-12 上传

2021-08-08 上传

点击了解资源详情

点击了解资源详情

weixin_38644141

- 粉丝: 6

- 资源: 924

最新资源

- SSM动力电池数据管理系统源码及数据库详解

- R语言桑基图绘制与SCI图输入文件代码分析

- Linux下Sakagari Hurricane翻译工作:cpktools的使用教程

- prettybench: 让 Go 基准测试结果更易读

- Python官方文档查询库,提升开发效率与时间节约

- 基于Django的Python就业系统毕设源码

- 高并发下的SpringBoot与Nginx+Redis会话共享解决方案

- 构建问答游戏:Node.js与Express.js实战教程

- MATLAB在旅行商问题中的应用与优化方法研究

- OMAPL138 DSP平台UPP接口编程实践

- 杰克逊维尔非营利地基工程的VMS项目介绍

- 宠物猫企业网站模板PHP源码下载

- 52简易计算器源码解析与下载指南

- 探索Node.js v6.2.1 - 事件驱动的高性能Web服务器环境

- 找回WinSCP密码的神器:winscppasswd工具介绍

- xctools:解析Xcode命令行工具输出的Ruby库