CS 229 – Machine Learning https://stanford.edu/~shervine

VIP Cheatsheet: Supervised Learning

Afshine Amidi and Shervine Amidi

October 27, 2018

翻译: Wang Hongnian. 由朱小虎, Chaoying Xue and Z 审阅

监监监督督督学学学习习习简简简介介介

给定一组数据点{x

(1)

, ..., x

(m)

} 和与其对应的输出{y

(1)

, ..., y

(m)

},我们想要建立一个分类器,学习

如何从x 预测y。

r 预预预测测测类类类型型型 – 不同类型的预测模型总结如下表:

回回回归归归 分分分类类类

输输输出出出 连续 类

例例例子子子 线性回归 Logistic回归,SVM,朴素贝叶斯

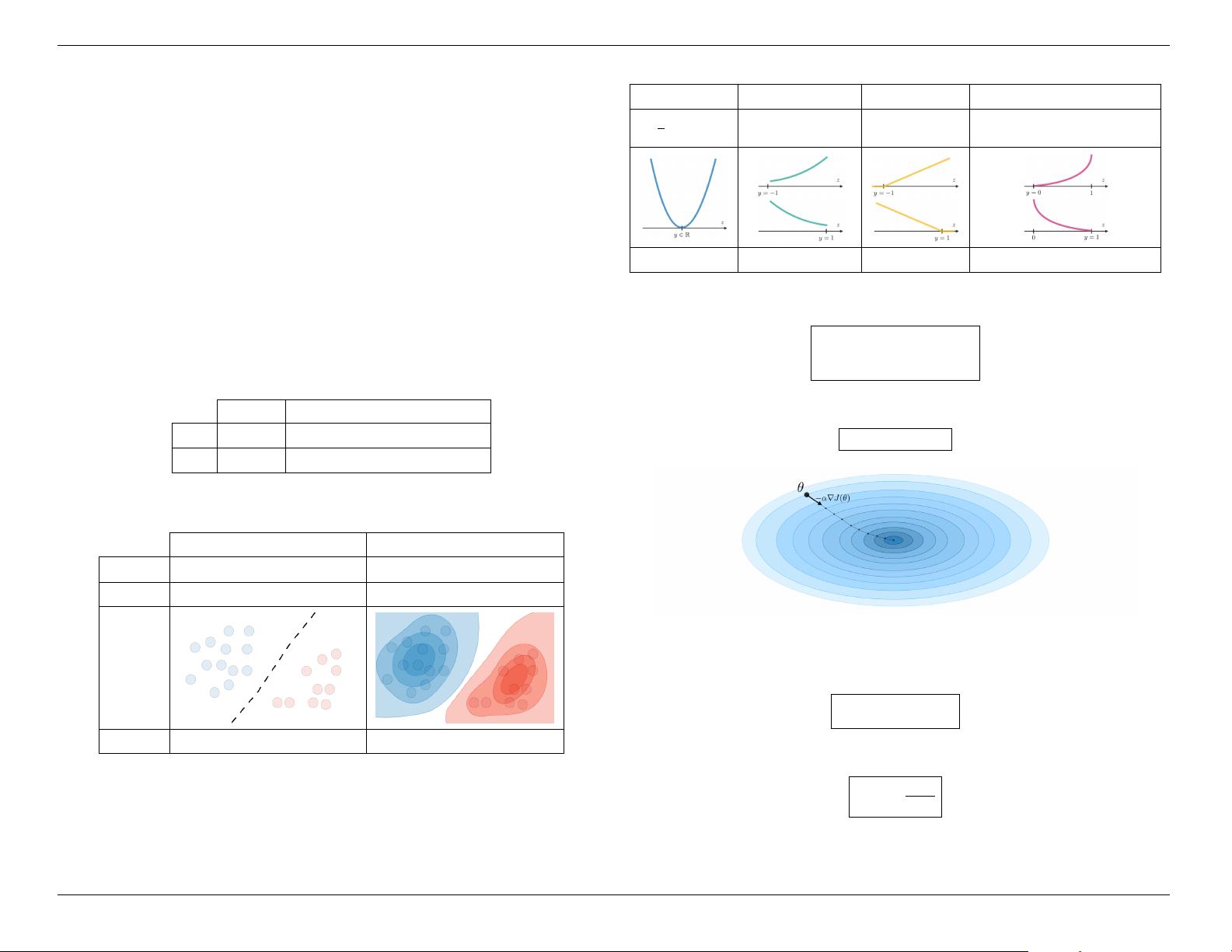

r 型型型号号号类类类型型型 – 不同型号总结如下表:

判判判别别别模模模型型型 生生生成成成模模模型型型

目目目标标标 直接估计P (y|x) 估计P (x|y) 然后推导P (y|x)

所所所学学学内内内容容容 决策边界 数据的概率分布

例例例图图图

示示示例例例 回归,SVMs GDA,朴素贝叶斯

符符符号号号和和和一一一般般般概概概念念念

r 假假假设设设 – 假设我们选择的模型是h

θ

。对于给定的输入数据x

(i)

,模型预测输出是h

θ

(x

(i)

)。

r 损损损失失失函函函数数数 – 损失函数是一个L : (z,y) ∈ R × Y 7−→ L(z,y) ∈ R 的函数,其将真实数据值y 和其预

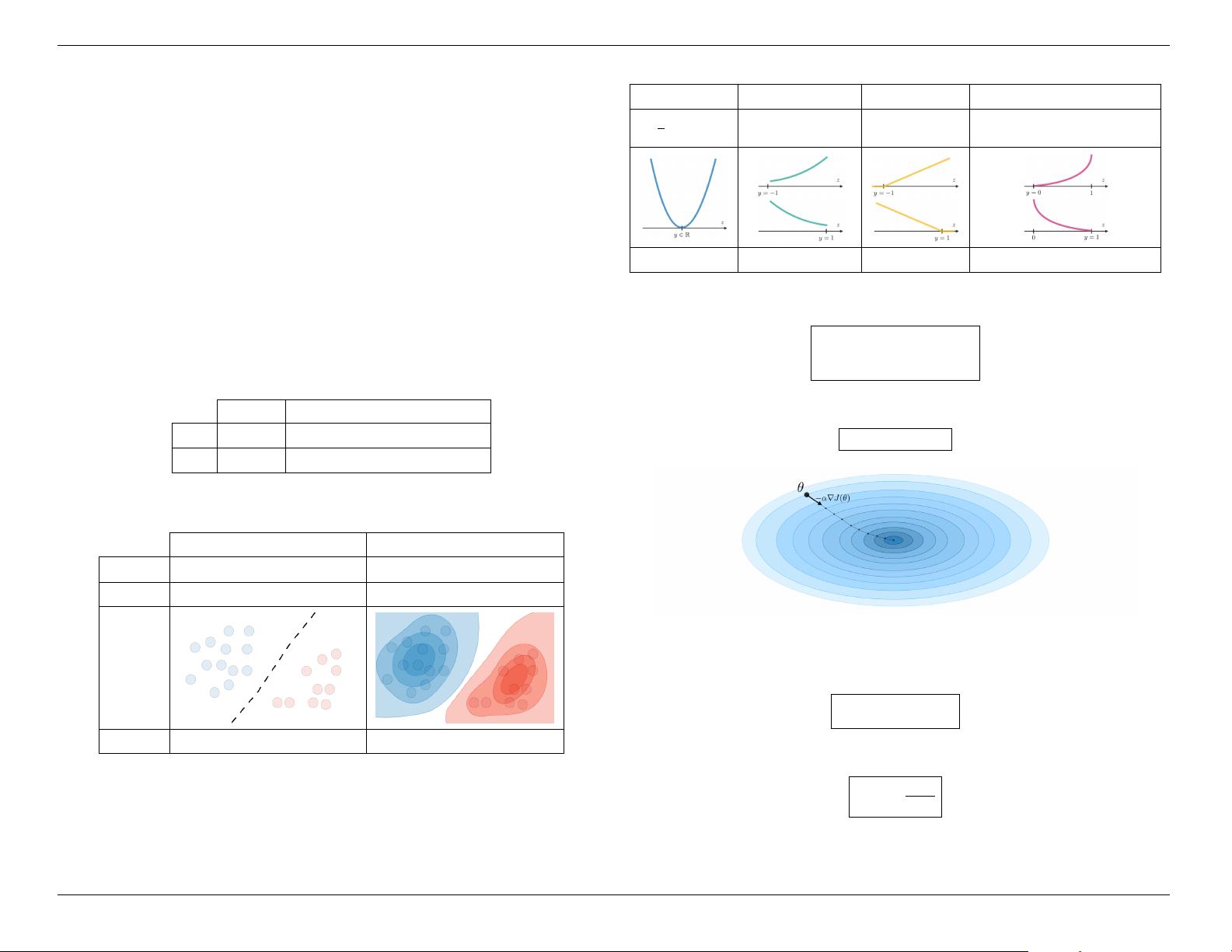

测值z 作为输入,输出它们的不同程度。常见的损失函数总结如下表:

最最最小小小二二二乘乘乘误误误差差差 Logistic损损损失失失 铰铰铰链链链损损损失失失 交交交叉叉叉熵熵熵

1

2

(y − z)

2

log(1 + exp(−yz)) max(0,1 − yz) −

y log(z) + (1 − y) log(1 − z)

线性回归 Logistic回归 SVM 神经网络

r 成成成本本本函函函数数数 – 成本函数J 通常用于评估模型的性能,使用损失函数L 定义如下:

J(θ) =

m

X

i=1

L(h

θ

(x

(i)

), y

(i)

)

r 梯梯梯度度度下下下降降降 – 记学习率为α ∈ R,梯度下降的更新规则使用学习率和成本函数J 表示如下:

θ ←− θ − α∇J(θ)

备注:随机梯度下降(SGD)是根据每个训练样本进行参数更新,而批量梯度下降是在一批训练样本

上进行更新。

r 似似似然然然 – 给定参数θ 的模型L(θ) 的似然性用于通过最 大化似然性来找到最佳参数θ。 在实践中,我

们使用更容易优化的对数似然`(θ) = log(L(θ))。我们有:

θ

opt

= arg max

θ

L(θ)

r 牛牛牛顿顿顿算算算法法法 – 牛顿算法是一种数值方法,目的是找到一个θ 使得`

0

(θ) = 0. 其更新规则如下:

θ ← θ −

`

0

(θ)

`

00

(θ)

备注:多维泛化,也称为Newton-Raphson 方法,具有以下更新规则:

θ ← θ −

∇

2

θ

`(θ)

−1

∇

θ

`(θ)

Stanford University 1 Fall 2018