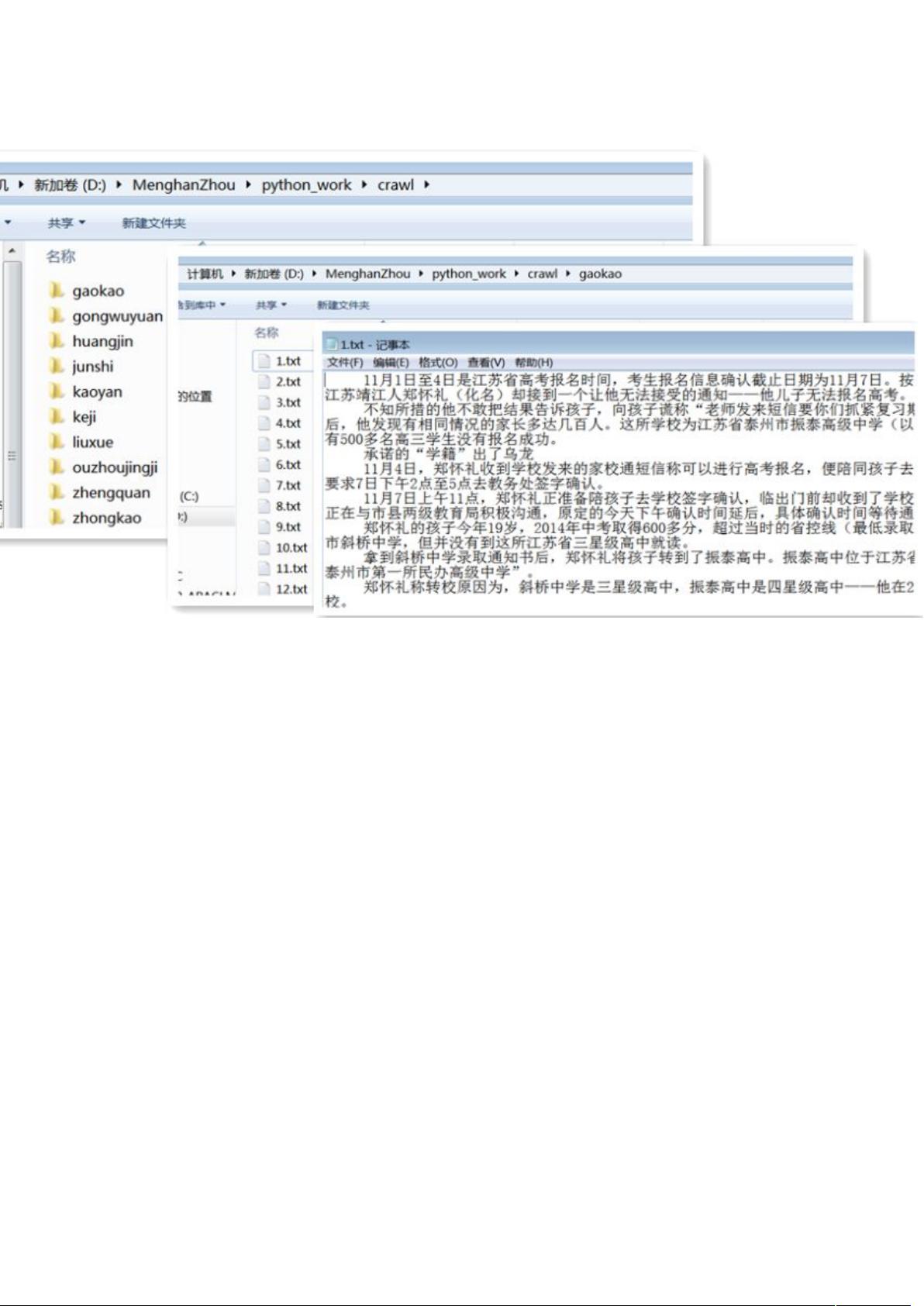

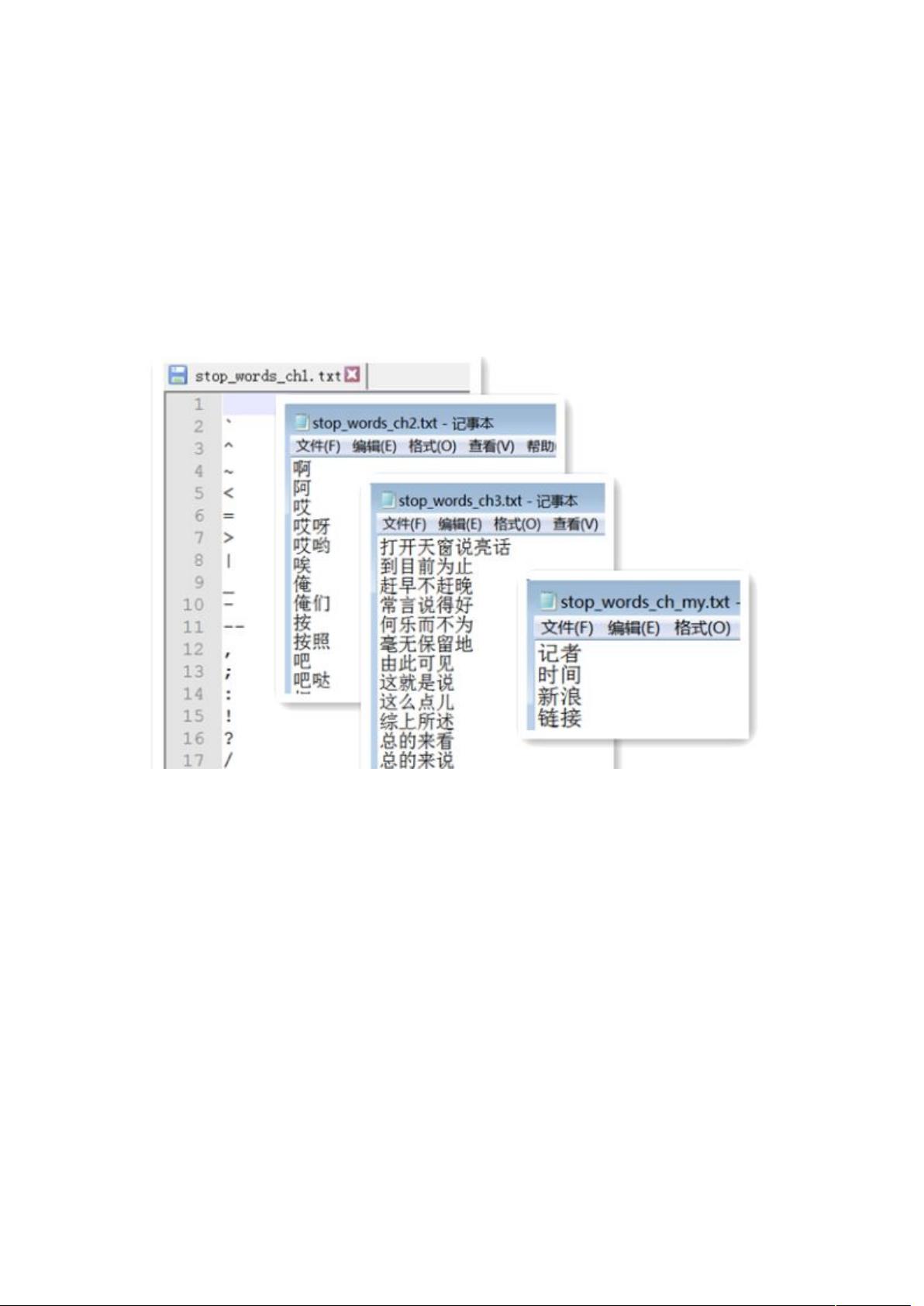

本报告涵盖了文本分类的完整处理过程,包括对24万条搜狗预料库的处理、jieba分词、停用词和无关词的处理,以及词袋模型的构建,其中特征筛选使用了CHI值检验,特征向量值使用了tfidf。同时,本报告还采用了自编的朴素贝叶斯算法和sklearn包中的SVM算法对文本进行了分类,并通过混淆矩阵和ROC曲线展现了实验效果。 在实验一中,我们的实验目的是观察网站结构,并利用爬虫算法爬取某网站的几类新闻网页内容。通过对这些网页内容进行预处理、分词以及特征选择等工作,我们建立了特征词典,并构建了每篇文章的特征向量。之后,我们利用分类算法,如朴素贝叶斯和SVM,针对训练集的特征向量和类标签进行了训练,得到了分类模型,并通过在测试集上计算预测准确率、召回率等指标,对不同分类器的分类效果以及不同参数的影响进行了性能评估。此外,我们还通过ROC曲线直观地对比了不同分类器的分类效果。 实验进展方面,本实验由一人完成,完成时间表如下: - 11月8日:学习Python基本语法 - 11月9日至11日:了解爬虫算法,掌握操作URL的urllib和网页解析器BeautifulSoup,观察新浪几类新闻资讯网页结构的HTML标签,编写代码,抓取10类共2万多篇文本的新闻内容,并保存到本地。 - 11月12日至13日:了解常用的几种分词方法,选用jieba分词和词性提取包作为本实验的分词工具,并去除停用词、无关词(自己加入的)等,仅保留flag为名词的词语,并保存到文本中。 - 11月14日:统计每篇文章中的出现词语的词频信息、每个类别中出现词语的词频信息、每个类别的文章数,并根据CHI值筛选特征词语,并用tfidf生成特征向量。 综上所述,本实验的目标是通过对文本进行分类,我们采用了搜狗预料库作为数据集,并利用jieba分词、停用词无关词处理和词袋模型构建等方法进行预处理。然后,我们采用了朴素贝叶斯和SVM算法进行分类,并通过混淆矩阵和ROC曲线展示实验结果。实验报告写得很详细,对于不懂的地方可以查看报告以及博客中的细节讲解。

剩余51页未读,继续阅读

- 粉丝: 754

- 资源: 4

我的内容管理

收起

我的内容管理

收起

我的资源

快来上传第一个资源

我的资源

快来上传第一个资源

我的收益 登录查看自己的收益

我的收益 登录查看自己的收益 我的积分

登录查看自己的积分

我的积分

登录查看自己的积分

我的C币

登录后查看C币余额

我的C币

登录后查看C币余额

我的收藏

我的收藏  我的下载

我的下载  下载帮助

下载帮助

会员权益专享

最新资源

- 电力电子系统建模与控制入门

- SQL数据库基础入门:发展历程与关键概念

- DC/DC变换器动态建模与控制方法解析

- 市***专有云IaaS服务:云主机与数据库解决方案

- 紫鸟数据魔方:跨境电商选品神器,助力爆款打造

- 电力电子技术:DC-DC变换器动态模型与控制

- 视觉与实用并重:跨境电商产品开发的六重价值策略

- VB.NET三层架构下的数据库应用程序开发

- 跨境电商产品开发:关键词策略与用户痛点挖掘

- VC-MFC数据库编程技巧与实现

- 亚马逊新品开发策略:选品与市场研究

- 数据库基础知识:从数据到Visual FoxPro应用

- 计算机专业实习经验与项目总结

- Sparkle家族轻量级加密与哈希:提升IoT设备数据安全性

- SQL数据库期末考试精选题与答案解析

- H3C规模数据融合:技术探讨与应用案例解析

信息提交成功

信息提交成功