掌握Spark-submit:部署与应用提交指南

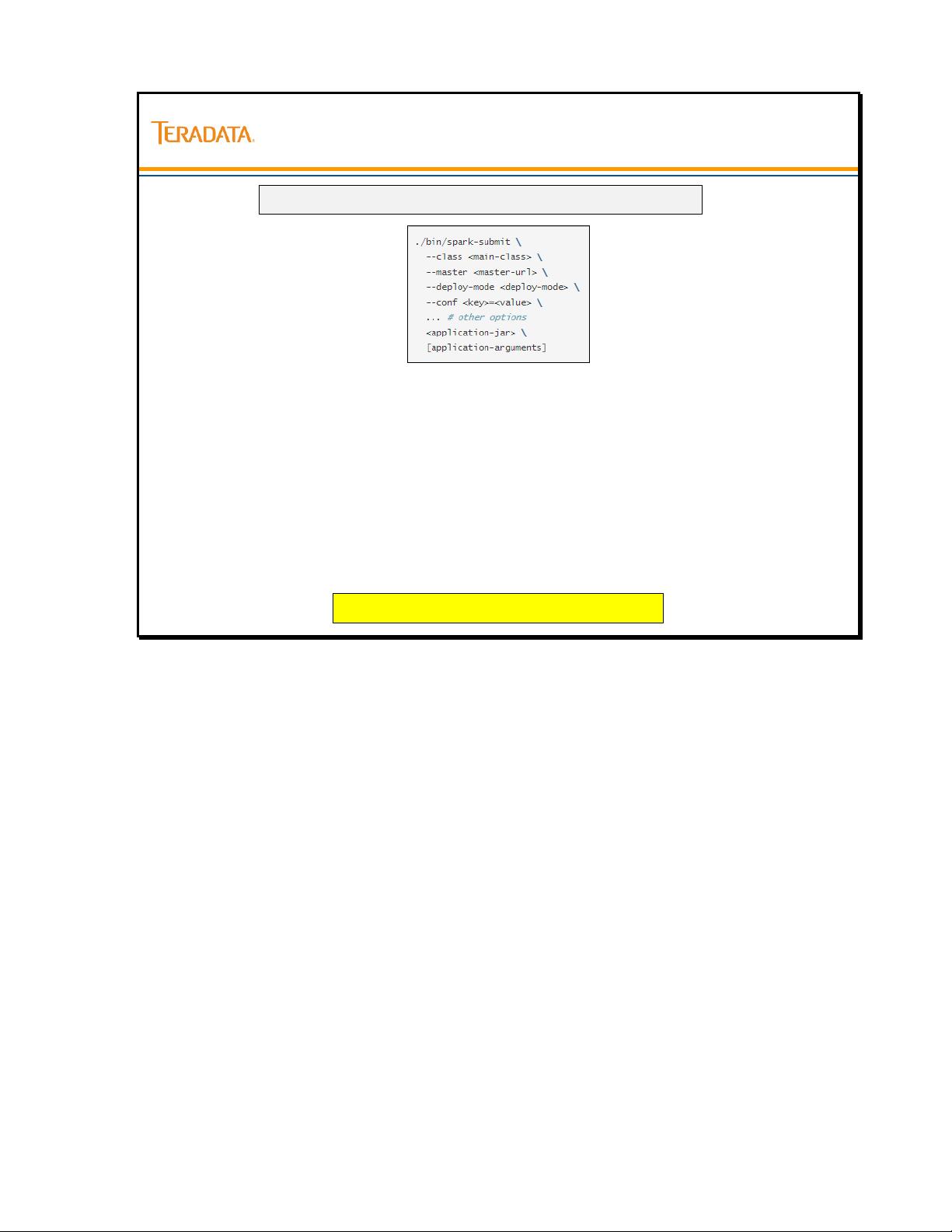

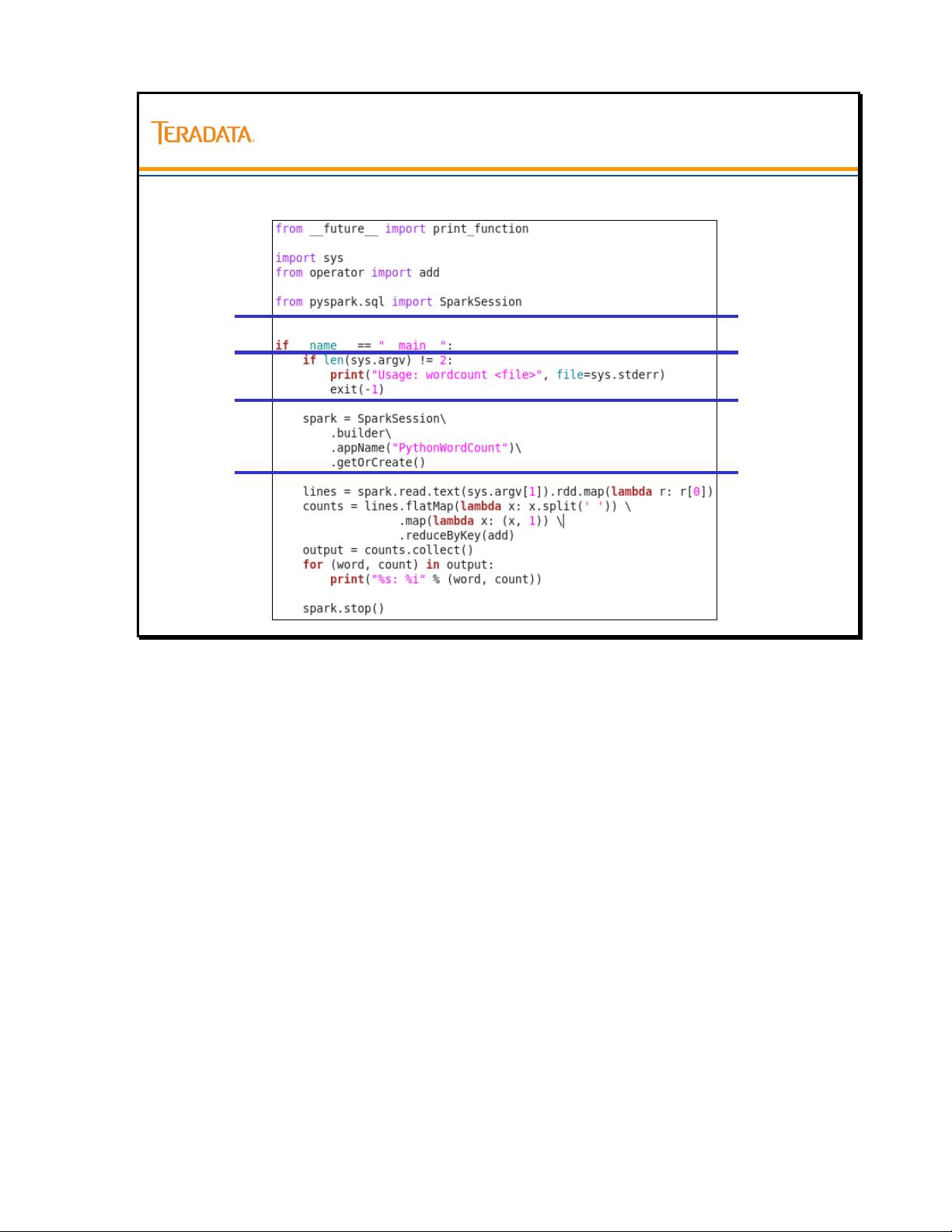

Spark-submit是Apache Spark项目中的一个重要组件,用于在集群上提交、管理和监控Spark应用程序的执行。它允许用户轻松地在Hadoop分布式文件系统(HDFS)上运行大规模的数据处理任务,无需详细了解底层的集群配置和调度。本篇内容主要涵盖以下几个关键知识点: 1. **创建Spark应用**: 学习如何编写一个Spark应用程序,包括基础的Scala或Python代码,如Spark WordCount示例,这通常是使用Scala的`SparkContext`对象进行操作。 2. **部署模式(Deploy Mode)**: Spark-submit支持两种部署模式:local和cluster。local模式是在本地机器上运行,而cluster模式则利用Hadoop YARN或Mesos等资源管理器在集群上并行执行。了解不同模式下的配置和适用场景是十分重要的。 3. **提交应用程序**: 学习如何通过命令行工具`spark-submit`提交应用程序,这个过程涉及到提供必要的参数,如主类路径、JAR包、应用配置文件等。链接`http://spark.apache.org/docs/latest/submitting-applications.html#launching-applications-with-spark-submit`提供了详细的指南。 4. **可选参数配置**: 包括设置作业的资源限制(如内存、CPU)、日志级别、监控选项等,这些配置可以帮助优化应用程序的性能和资源利用率。 5. **HDP和Sandbox环境**: 如果在HDP(Hortonworks Data Platform)环境中使用,可能还需要理解Hortonworks的特定接口和配置,如`http://sandbox.hortonworks.com:18080/history/application_1492949290794_0019/2/stages/`所示的HDP作业历史查看。 6. **Spark shell与OpenZeppelin**: 提及了OpenZeppelin作为一个交互式环境,可以结合Spark-submit来运行脚本或者进行数据探索,这对于数据分析和机器学习场景尤其有用。 7. **脚本打包**: 如何将应用程序的依赖项(如库、数据文件)打包成一个可执行的jar或egg,以便于在不同的环境中部署。 8. **脚本结构**: 分析了Scala或Python脚本的基本结构,包括导入所需的Spark库、设置入口点(`if_name_=”_main_”:`)、处理条件语句、创建SparkContext以及编写主逻辑代码。 9. **示例:WordCount Script in Scala/Python**: 通过具体的WordCount示例展示了如何在Scala或Python中编写和提交这样的应用程序,帮助读者深入理解Spark-submit的工作原理。 通过学习和实践Spark-submit,开发者可以有效地将复杂的数据处理任务分解为易于管理的小任务,充分利用大数据处理平台的强大功能。掌握这些技能对于在实际生产环境中部署和管理Spark应用至关重要。

剩余52页未读,继续阅读

- 粉丝: 0

- 资源: 14

我的内容管理

展开

我的内容管理

展开

我的资源

快来上传第一个资源

我的资源

快来上传第一个资源

我的收益 登录查看自己的收益

我的收益 登录查看自己的收益 我的积分

登录查看自己的积分

我的积分

登录查看自己的积分

我的C币

登录后查看C币余额

我的C币

登录后查看C币余额

我的收藏

我的收藏  我的下载

我的下载  下载帮助

下载帮助

最新资源

- Lombok 快速入门与注解详解

- SpringSecurity实战:声明式安全控制框架解析

- XML基础教程:从数据传输到存储解析

- Matlab实现图像空间平移与镜像变换示例

- Python流程控制与运算符详解

- Python基础:类型转换与循环语句

- 辰科CD-6024-4控制器说明书:LED亮度调节与触发功能解析

- AE particular插件全面解析:英汉对照与关键参数

- Shell脚本实践:创建tar包、字符串累加与简易运算器

- TMS320F28335:浮点处理器与ADC详解

- 互联网基础与结构解析:从ARPANET到多层次ISP

- Redhat系统中构建与Windows共享的Samba服务器实战

- microPython编程指南:从入门到实践

- 数据结构实验:顺序构建并遍历链表

- NVIDIA TX2系统安装与恢复指南

- C语言实现贪吃蛇游戏基础代码

信息提交成功

信息提交成功