序贯最小优化算法(SMO)是一种用于求解凸二次规划问题的算法。它的主要思想是选取两个变量作为待更新的变量,固定其他变量,针对这两个变量构造一个二次规划问题,然后用解析方法求解该子问题,反复迭代直到所有的解都满足最优化问题的KKT条件。

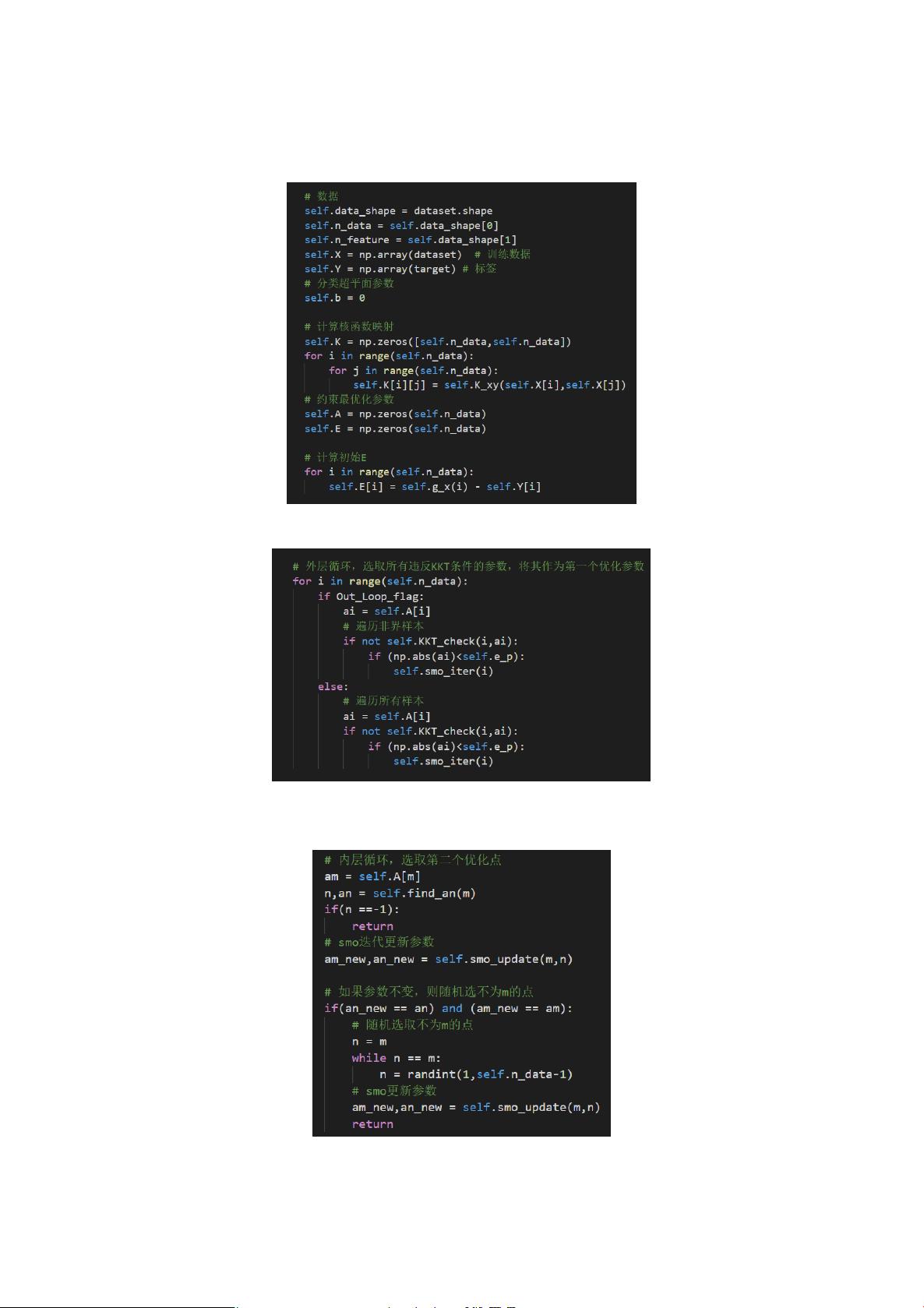

本实验的主要目的是理解SMO算法的工作原理,并编程实现该算法以用于非线性分类问题。具体地,基于SMO算法,我们自定义了一个用于分类的类,其中核函数分别采用了RBF核和多项式核。我们利用这个自定义的SMO类,在乳腺癌数据集上训练了一个SVM分类器,并测试了其分类精度,并将其与SKlearn中的SVM进行了比较。

实验环境是CPU i5-8300H、8G内存、512G固态硬盘,操作系统为Windows 10家庭版。我们使用了Python 3.7作为编程语言,并使用Visual Studio Code作为开发工具。实验的数据集是乳腺癌数据集。

SMO算法的具体描述如下表所示:

表 1 算法描述

输入:训练数据集T = {(x1,y1),…,(xN,yN)};

输出:最优化问题的解sigma*和b*;

1: 初始化alpha为0向量,b为0,选择一个样本点(x1,y1)

2: while 没有收敛 do

3: if alpha的维度都没有发生更新 then

4: for 所有的i do

5: 找到不满足KKT条件的i,即满足如下任一条件:

6: yi*(wx+b) <= 1 且 alpha < C

7: yi*(wx+b) = 1 且 alpha = 0 or alpha = C

8: end for

9: end if

10: 选择不满足KKT条件的第一个样本点(xi,yi)

11: 针对(xi,yi),更新alpha和b:

12: 计算Ei = wxi + b - yi

13: 选择alpha2并计算E2 = wx2 + b - y2

14: 通过alpha1和alpha2的约束条件计算L和H

15: 如果L等于H,则跳出本次循环(继续下一个i)

16: 计算eta = 2K(xi,xi) - K(x1,x1) - K(x2,x2)

17: 更新alpha2的值

18: 使用alpha2的新值更新alpha1的值

19: 更新b的值

20: 更新alpha中其他维度的值

21: end for

22: end while

23: 返回最优化问题的解sigma*和b*

通过上述算法描述,我们可以看出SMO算法的工作原理。它通过选择两个变量,针对这两个变量构造一个二次规划问题,并用解析方法求解该子问题。通过不断迭代,直到所有的解都满足最优化问题的KKT条件。这样,我们就可以得到最优化问题的解sigma*和b*,从而得到了SVM分类器。

在本实验中,我们使用了自定义的SMO类来实现SVM分类器,并采用了RBF核和多项式核作为核函数。通过在乳腺癌数据集上训练SVM分类器,并与SKlearn中的SVM进行比较,我们可以评估自定义的SMO算法的性能和分类精度。

总之,本实验通过理解SMO算法的工作原理,并编程实现该算法以解决非线性分类问题。实验结果表明,自定义的SMO算法在乳腺癌数据集上表现良好,并与SKlearn中的SVM进行了有效的比较。这些实验结果证明了SMO算法的有效性和可行性,对于解决实际的非线性分类问题具有重要的意义。