理解过拟合:从数据挖掘到模型复杂度的影响

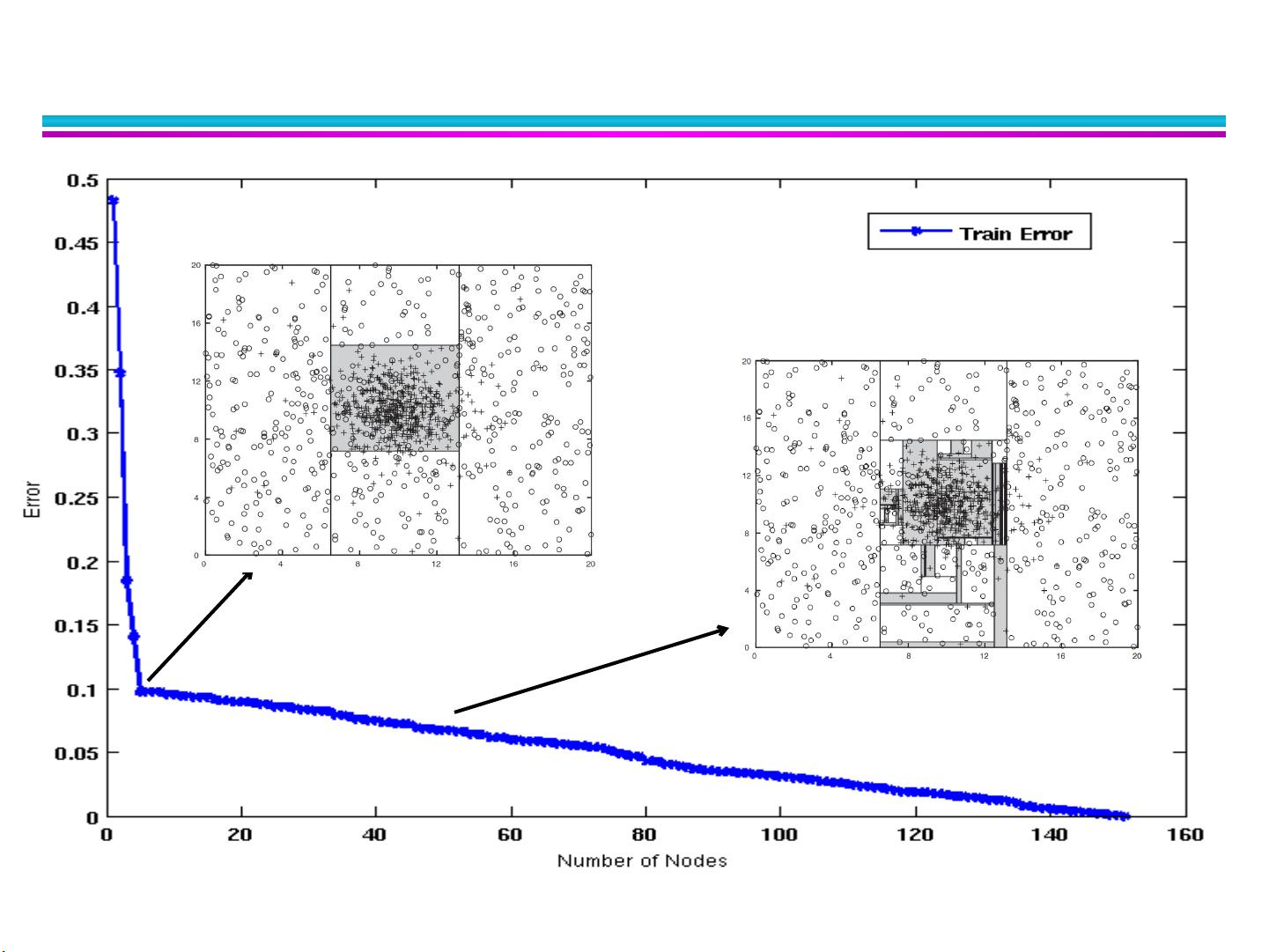

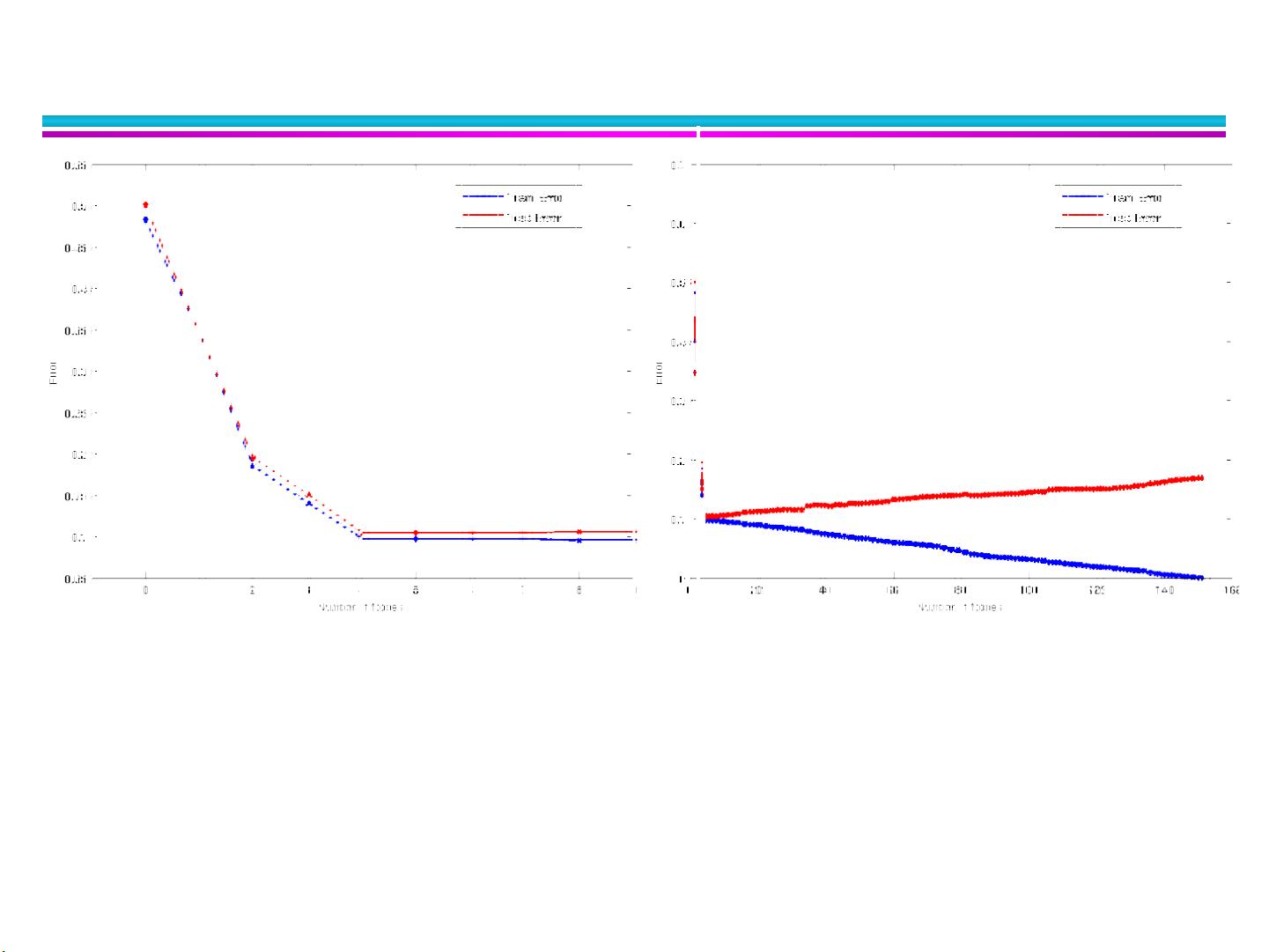

"数据挖掘导论(第二版)第3章深入探讨了过拟合这一重要概念,通过实例展示了过拟合对模型性能的影响。文件包含了一组对比实验,涉及不同大小的决策树模型,以及如何通过增加训练数据来缓解过拟合问题。" 在数据挖掘和机器学习领域,过拟合是一个常见的问题,它指的是模型在训练数据上表现良好,但在未见过的测试数据上表现糟糕的现象。描述中的内容提到了两个关键指标:训练误差和测试误差。训练误差是模型在训练数据上的误差,而测试误差则是模型在独立的测试数据集上的误差。理想的模型应该在两者之间取得平衡,但过拟合往往导致测试误差远高于训练误差。 过拟合的发生通常与模型的复杂度和训练数据量有关。当模型过于复杂,例如决策树节点过多,模型可能会过度适应训练数据中的噪声或特殊模式,导致在新的、未知数据上的泛化能力下降。文件中通过4个节点和50个节点的决策树对比,展示了随着模型复杂度增加,过拟合的风险也随之增加。 为了减轻过拟合,一个有效的策略是增加训练数据的量。如描述中提到的,增加训练数据可以帮助减少训练误差和测试误差之间的差距,因为更大的数据集能够更好地代表整体数据分布,使得模型更难捕捉到特定训练集的噪声。这种现象被称为“过拟合两倍训练量”。 此外,描述还提到了“多重比较问题”,这在统计分析中是一个重要概念。在大量属性或特征中选择最佳模型时,由于尝试的次数多,可能会偶然选出看似表现优秀的但实际无用的特征,从而导致过拟合。这在股票市场预测的例子中得到体现,即使每个分析师的预测是随机的,但总会有个别分析师因运气而猜对多次,这样的情况在大量比较中并不罕见。 解决多重比较问题,需要谨慎选择模型的构建方式,避免贪婪策略过于依赖单次优化结果。例如,每次添加新参数时,应确保模型的整体性能有所提升,而不是简单地增加特征数量。在特征选择过程中,正则化等技术可以用来限制模型复杂度,防止过拟合。 总结来说,过拟合是模型设计中需要特别关注的问题,它涉及到模型复杂度、训练数据量和特征选择策略等多个方面。理解和控制过拟合对于构建具有良好泛化能力的模型至关重要。在数据挖掘实践中,我们应尽量寻找在训练集和测试集上都有良好表现的平衡模型,以确保模型的稳健性和实用性。

剩余36页未读,继续阅读

- 粉丝: 3

- 资源: 15

我的内容管理

展开

我的内容管理

展开

我的资源

快来上传第一个资源

我的资源

快来上传第一个资源

我的收益 登录查看自己的收益

我的收益 登录查看自己的收益 我的积分

登录查看自己的积分

我的积分

登录查看自己的积分

我的C币

登录后查看C币余额

我的C币

登录后查看C币余额

我的收藏

我的收藏  我的下载

我的下载  下载帮助

下载帮助

最新资源

- AirKiss技术详解:无线传递信息与智能家居连接

- Hibernate主键生成策略详解

- 操作系统实验:位示图法管理磁盘空闲空间

- JSON详解:数据交换的主流格式

- Win7安装Ubuntu双系统详细指南

- FPGA内部结构与工作原理探索

- 信用评分模型解析:WOE、IV与ROC

- 使用LVS+Keepalived构建高可用负载均衡集群

- 微信小程序驱动餐饮与服装业创新转型:便捷管理与低成本优势

- 机器学习入门指南:从基础到进阶

- 解决Win7 IIS配置错误500.22与0x80070032

- SQL-DFS:优化HDFS小文件存储的解决方案

- Hadoop、Hbase、Spark环境部署与主机配置详解

- Kisso:加密会话Cookie实现的单点登录SSO

- OpenCV读取与拼接多幅图像教程

- QT实战:轻松生成与解析JSON数据

信息提交成功

信息提交成功