没有合适的资源?快使用搜索试试~ 我知道了~

首页Python Celery实战:异步任务与周期定时任务详解

Python Celery实战:异步任务与周期定时任务详解

0 下载量 75 浏览量

更新于2024-09-01

收藏 157KB PDF 举报

本文是一篇详细的Python教程,着重讲解如何利用Celery库来实现异步任务、周期任务和定时任务。Celery是一个功能强大的分布式任务队列和调度系统,它特别适合实时处理和任务调度,允许开发者快速构建和管理分布式任务。在Python中,Celery主要由三个关键部分组成:用户任务应用(app)、消息中间件(broker)如Redis或RabbitMQ,以及结果后端(backend)用于存储任务状态和结果。 文章首先介绍了Celery的工作原理,用户向服务器提交任务,Celery会将任务分解并分配给多个worker(线程或进程),这些worker持续监听任务,一旦接收到就立即执行。Celery的优势在于它的异步处理能力,能够实现任务的并发执行,并且可以轻松地管理和监控任务流程。 对于定时任务和周期任务,文章指出Linux自带的定时任务管理并不够灵活和可控,难以满足复杂的需求,例如结果保存和管理。相反,通过Celery,开发者可以设置定时任务,即使在后台运行的调度器也会定期检查并执行任务,确保任务的可靠性和可管理性。 接下来,文章会提供具体的示例代码,展示如何在Python项目中设置和配置Celery,包括如何定义任务、设置broker和backend、配置worker的数量以及如何启动定时任务和周期任务。这部分内容将对初学者和有一定经验的开发人员都非常实用,可以帮助他们更好地理解和使用Celery来优化他们的Python应用程序性能和架构。通过阅读和实践这篇教程,读者可以掌握如何在实际项目中有效地利用Celery实现高效的异步任务处理和任务调度。

资源详情

资源推荐

python教程:教程:python基于基于celery实现异步任务周期任务定时任务实现异步任务周期任务定时任务

这篇文章主要介绍了python基于celery实现异步任务周期任务定时任务,文中通过示例代码介绍的非常详细,对大家的学习或者工作具有一定

的参考学习价值,需要的朋友可以参考下

hello, 小伙伴们, 好久不更新了,这一次带来的是celery在python中的应用以及设置异步任务周期任务和定时任务的步骤,希望能给入坑的你带来

些许帮助.

首先是对celery的介绍,Celery其实是一个专注于实时处理和调度任务的分布式任务队列,同时提供操作和维护分布式系统所需要的全部数据,

因此可以用它提供的接口快速实现并管理一个分布式的任务队列,它本身不是任务队列,它是封装了操作常见任务队列的各种操作, 可以使用它

快速进行任务队列的使用与管理.在Python中的组成部分是 1.用户任务 app 2.管道 broker 用于存储任务 官方推荐的是 redis rabbitMQ /

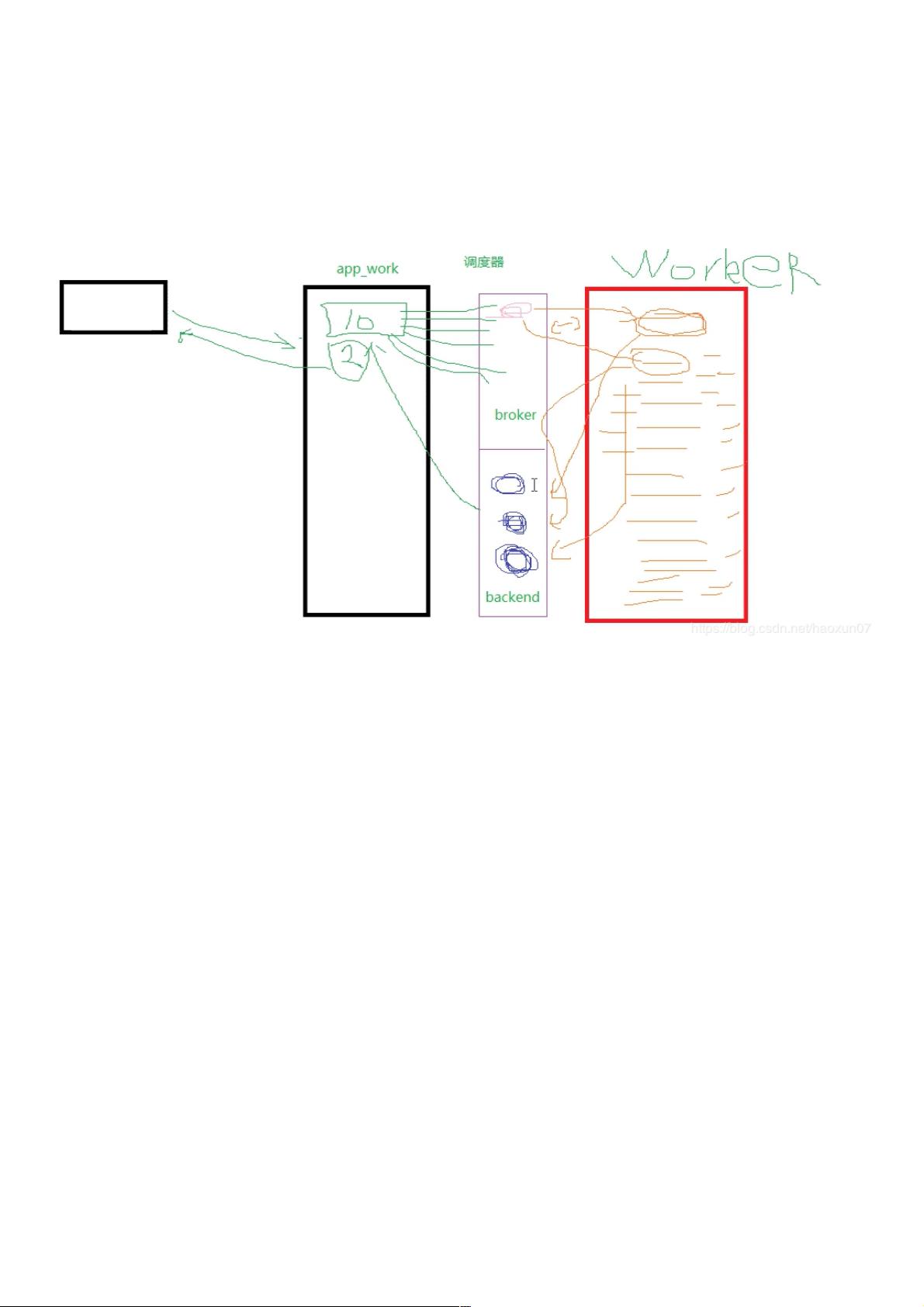

backend 用于存储任务执行结果的 3, 员工 worker 大致流程入下:

最左边的是用户, 用户发起1个请求给服务器, 要服务器执行10个任务,将这10个任务分给10个调度器,即开启10个线程进行任务处理,worker会

一直监听调度器是否有任务, 一旦发现有新的任务, 就会立即执行新任务,一旦执行完就会返回给调度器, 即backend, backend会将请求发送给

服务器, 服务器将结果返回给用户, 表现的结果就是,这10个任务同时完成,同时返回,这就是Celery的整个工作流程, 其中的角色分别为,任务

(app_work), 调度器(broker + backend), 将任务缓存的部分, 即将所有任务暂时存在的地方,相当于生产者, 消费者(worker 可以指定数量, 即在

创建worker命令的时候可以指定数量), 在worker拿到任务后,人就控制不了了, 除非把worker杀死, 不然肯定会执行完.

也即 任务来了以后, 调度器(broker)去缓存任务, worker去执行任务, 完成后返回backend,接着返回,

还有就是关于定时任务和周期任务在linux上为什么不用自身所带着的去做,是因为linux周期定时任务是不可控的, 不好管理, 返回值保存也是个

麻烦事, 而celery只要开启着调度器, 就可以随时把人物结果获取到,即使用celery控制起来是非常方便的.

接下来就是实例代码:

workers.py

from celery import Celery

import time

# 创建一个Celery实例, 就是用户的应用app 第一个参数是任务名称, 可以随意起 后面的就是配置的broker和backend

diaoduqi= Celery("mytask", broker="redis://127.0.0.1:6379", backend="redis:127.0.0.1:6379")

# 接下来是为应用创建任务 ab

@diaoduqi.task

def ab(a,b):

time.sleep(15)

return a+b

brokers.py

from worker import ab

# 将任务交给Celery的Worker执行

res = ab.delay(2,4)

#返回任务ID

print(res.id)

backends.py

from celery.result import AsyncResult

from worker import diaoduqi

# 异步获取任务返回值

async_task = AsyncResult(id="31ec65e8-3995-4ee1-b3a8-1528400afd5a",app=diaoduqi)

下载后可阅读完整内容,剩余3页未读,立即下载

weixin_38657835

- 粉丝: 3

- 资源: 931

上传资源 快速赚钱

我的内容管理

展开

我的内容管理

展开

我的资源

快来上传第一个资源

我的资源

快来上传第一个资源

我的收益 登录查看自己的收益

我的收益 登录查看自己的收益 我的积分

登录查看自己的积分

我的积分

登录查看自己的积分

我的C币

登录后查看C币余额

我的C币

登录后查看C币余额

我的收藏

我的收藏  我的下载

我的下载  下载帮助

下载帮助

最新资源

- C++多态实现机制详解:虚函数与早期绑定

- Java多线程与异常处理详解

- 校园导游系统:无向图实现最短路径探索

- SQL2005彻底删除指南:避免重装失败

- GTD时间管理法:提升效率与组织生活的关键

- Python进制转换全攻略:从10进制到16进制

- 商丘物流业区位优势探究:发展战略与机遇

- C语言实训:简单计算器程序设计

- Oracle SQL命令大全:用户管理、权限操作与查询

- Struts2配置详解与示例

- C#编程规范与最佳实践

- C语言面试常见问题解析

- 超声波测距技术详解:电路与程序设计

- 反激开关电源设计:UC3844与TL431优化稳压

- Cisco路由器配置全攻略

- SQLServer 2005 CTE递归教程:创建员工层级结构

资源上传下载、课程学习等过程中有任何疑问或建议,欢迎提出宝贵意见哦~我们会及时处理!

点击此处反馈

安全验证

文档复制为VIP权益,开通VIP直接复制

信息提交成功

信息提交成功