Python实现ID3决策树算法详解

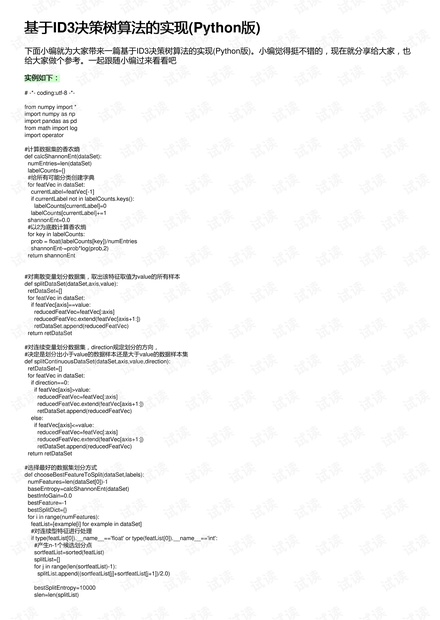

"本文将介绍如何在Python中实现ID3决策树算法,通过实例代码解析算法的每个步骤,帮助读者理解决策树的工作原理。" ID3(Iterative Dichotomiser 3)决策树算法是一种早期的分类算法,主要应用于离散型特征的数据集。它的核心思想是基于信息增益(Information Gain)来选择最优特征进行节点划分。下面我们将详细讲解ID3算法的实现过程。 1. **信息熵(Entropy)**:信息熵是衡量数据集纯度的一个指标。在ID3算法中,我们使用香农熵(Shannon Entropy)来计算数据集的不确定性。`calcShannonEnt`函数用于计算数据集的信息熵。它遍历数据集中的所有样本,统计每个类别出现的次数,然后计算每个类别的概率,并根据概率计算信息熵。 2. **信息增益(Information Gain)**:信息增益是划分前后的信息熵之差,用于评估特征对数据集纯度的提升程度。在选择最佳划分特征时,我们选择信息增益最大的特征。计算信息增益的公式为:`Gain = EntropyBefore - EntropyAfter`。 3. **划分数据集**:`splitDataSet`函数用于根据离散特征的取值来划分数据集。而`splitContinuousDataSet`函数则是针对连续特征,通过比较某个阈值(value)来划分数据集。这两个函数是构建决策树的关键部分,它们将数据集划分为更小的子集,直到满足停止条件(如达到预设深度或叶子节点纯度)。 4. **构建决策树**:在Python实现中,通常使用递归方式构建决策树。首先,计算当前节点的信息熵,然后对每个特征计算信息增益,选取最大信息增益的特征作为分裂标准。接着,对每个可能的特征值(离散特征)或阈值(连续特征)递归地划分数据集,直到所有样本属于同一类别或者没有更多特征可分。 5. **剪枝处理**:为了避免过拟合,ID3算法可以通过设置最小信息增益阈值或最小叶子节点样本数来进行剪枝操作。当信息增益低于阈值或叶子节点样本数少于指定数量时,不再继续划分,而是直接将其标记为最常见类别。 6. **预测**:决策树构建完成后,可以使用前向传播的方式进行预测。对于新样本,沿着决策树路径进行判断,直到到达叶子节点,返回该叶子节点对应的类别。 总结来说,ID3决策树算法通过信息熵和信息增益来选择最佳特征进行数据划分,递归构建决策树模型。Python中的实现涉及到数据集的处理、信息熵的计算以及递归构建和预测等关键步骤。在实际应用中,ID3算法虽然简单易懂,但因为只适用于离散特征且容易过拟合,因此后来被C4.5和随机森林等更先进的决策树算法所取代。

- 粉丝: 3

- 资源: 951

我的内容管理

收起

我的内容管理

收起

我的资源

快来上传第一个资源

我的资源

快来上传第一个资源

我的收益 登录查看自己的收益

我的收益 登录查看自己的收益 我的积分

登录查看自己的积分

我的积分

登录查看自己的积分

我的C币

登录后查看C币余额

我的C币

登录后查看C币余额

我的收藏

我的收藏  我的下载

我的下载  下载帮助

下载帮助

会员权益专享

最新资源

- 京瓷TASKalfa系列维修手册:安全与操作指南

- 小波变换在视频压缩中的应用

- Microsoft OfficeXP详解:WordXP、ExcelXP和PowerPointXP

- 雀巢在线媒介投放策划:门户网站与广告效果分析

- 用友NC-V56供应链功能升级详解(84页)

- 计算机病毒与防御策略探索

- 企业网NAT技术实践:2022年部署互联网出口策略

- 软件测试面试必备:概念、原则与常见问题解析

- 2022年Windows IIS服务器内外网配置详解与Serv-U FTP服务器安装

- 中国联通:企业级ICT转型与创新实践

- C#图形图像编程深入解析:GDI+与多媒体应用

- Xilinx AXI Interconnect v2.1用户指南

- DIY编程电缆全攻略:接口类型与自制指南

- 电脑维护与硬盘数据恢复指南

- 计算机网络技术专业剖析:人才培养与改革

- 量化多因子指数增强策略:微观视角的实证分析

信息提交成功

信息提交成功