AI硬件爆发:GPT时代的服务器需求分析

需积分: 0 83 浏览量

更新于2024-06-25

收藏 4.87MB PDF 举报

该报告由广发证券电子行业团队发布,标题为“AI的iPhone时刻”,日期为2023年5月30日,旨在探讨人工智能(AI)硬件市场的新趋势。分析师许兴军、王亮、耿正和张大伟合作完成了这一深度行业研究。报告的核心观点聚焦于人工智能计算能力的爆炸性增长,特别是随着像ChatGPT这样的大模型的出现,对AI硬件,尤其是AI服务器的需求急剧增加。

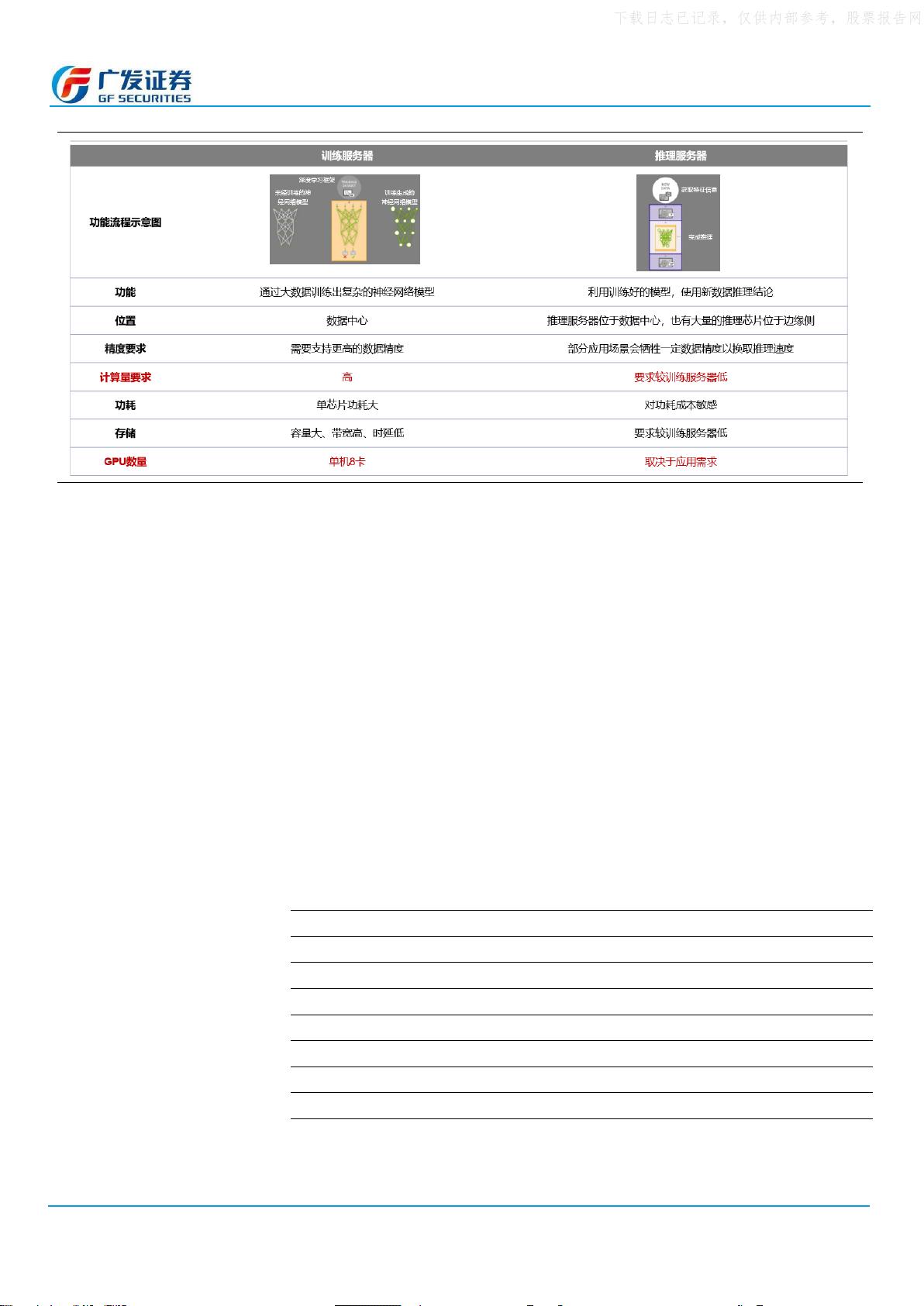

首先,报告指出,大模型的训练和推理过程对高性能计算资源的需求巨大。例如,训练一个GPT-3.5175B模型,NVIDIA A100 GPU需要1080个,AI服务器需135台;而万亿参数量的AI大模型对这些资源的需求更高,分别需要8521个A100 GPU和1065台AI服务器。在推理阶段,谷歌级应用使用这些模型时,对NVIDIA A100 GPU和AI服务器的需求同样显著,如GPT-3.5175B的推理场景下,AI服务器需求可达到9万台。

报告进一步强调了AI服务器市场的增长驱动力,因为它们专为高效处理AI任务设计,通常包括2颗CPU、4或8颗GPGPU(图形处理器)以及一系列辅助芯片,如NVLink和NVSwitch光芯片,以及高速接口芯片。这意味着,随着大模型训练和推理需求的增长,AI服务器的销售预计将进入快速增长的“黄金时代”。

报告通过实际的数据计算,预测了大规模部署大模型对AI服务器市场的影响。以2022年14万台AI服务器出货量为基础,训练100个GPT-3.5175B模型可能导致AI服务器出货量增长9.6%,而10个谷歌级应用使用这类模型进行推理,则可能拉动全球AI服务器出货量增长高达643%。这表明,AI硬件市场将迎来前所未有的发展机遇,同时也提醒投资者和行业参与者关注技术进步带来的市场变化和投资机会。

这份报告不仅提供了对当前AI硬件市场状况的深入洞察,还对未来发展趋势进行了前瞻性分析,对于理解AI硬件行业的战略定位、供应链管理以及市场潜力具有重要意义。

2023-07-30 上传

点击了解资源详情

2024-01-26 上传

2023-03-26 上传

2023-09-01 上传

2023-12-18 上传

2024-01-25 上传

weishaoonly

- 粉丝: 135

- 资源: 1381

最新资源

- 多模态联合稀疏表示在视频目标跟踪中的应用

- Kubernetes资源管控与Gardener开源软件实践解析

- MPI集群监控与负载平衡策略

- 自动化PHP安全漏洞检测:静态代码分析与数据流方法

- 青苔数据CEO程永:技术生态与阿里云开放创新

- 制造业转型: HyperX引领企业上云策略

- 赵维五分享:航空工业电子采购上云实战与运维策略

- 单片机控制的LED点阵显示屏设计及其实现

- 驻云科技李俊涛:AI驱动的云上服务新趋势与挑战

- 6LoWPAN物联网边界路由器:设计与实现

- 猩便利工程师仲小玉:Terraform云资源管理最佳实践与团队协作

- 类差分度改进的互信息特征选择提升文本分类性能

- VERITAS与阿里云合作的混合云转型与数据保护方案

- 云制造中的生产线仿真模型设计与虚拟化研究

- 汪洋在PostgresChina2018分享:高可用 PostgreSQL 工具与架构设计

- 2018 PostgresChina大会:阿里云时空引擎Ganos在PostgreSQL中的创新应用与多模型存储