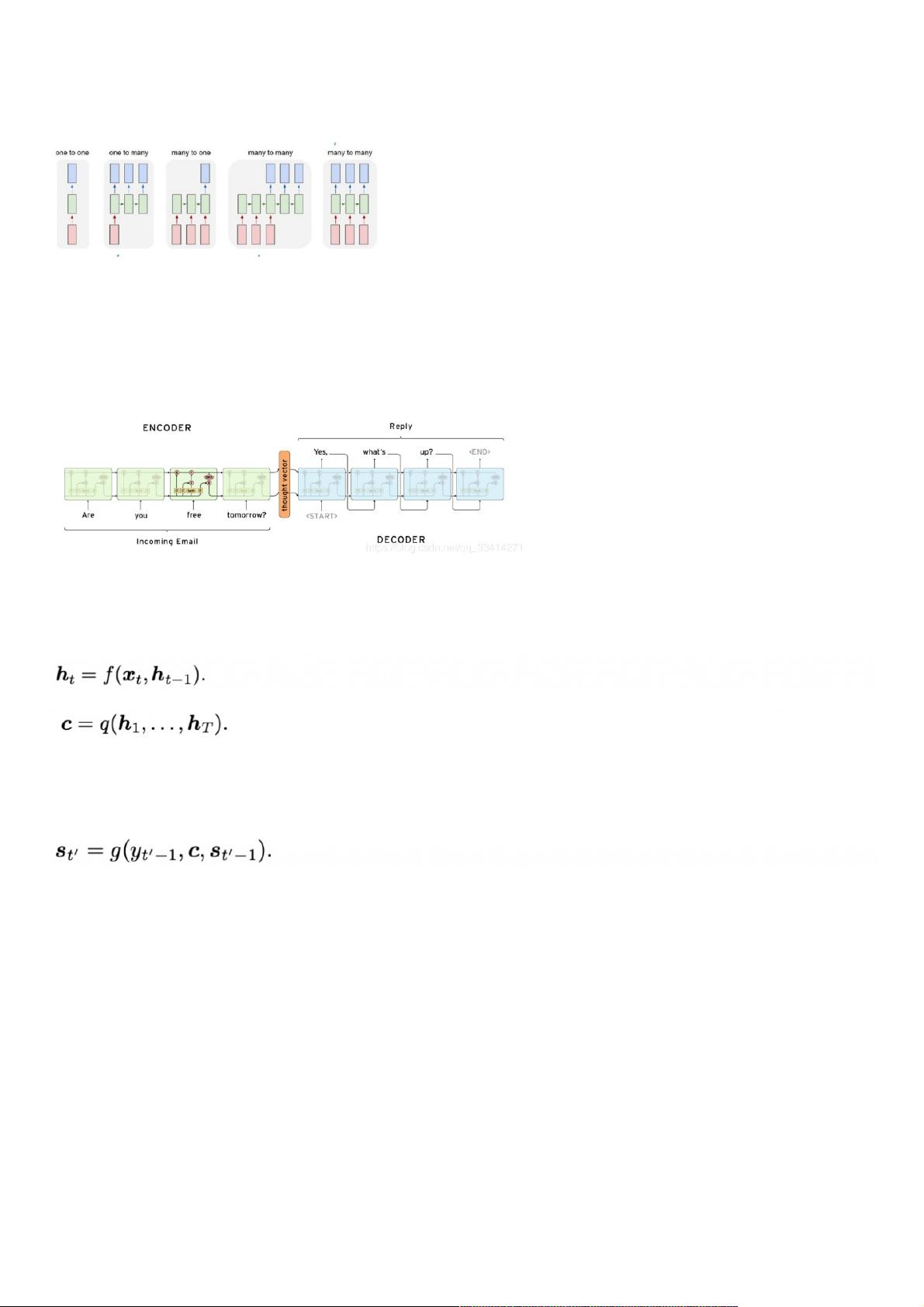

"本文主要介绍了Seq2Seq模型及其在自然语言处理(NLP)中的应用,特别是在TensorFlow2.x和Keras框架下的实战。Seq2Seq模型是为了解决输入和输出序列长度不一致的问题,常用于机器翻译和对话系统。模型由编码器和解码器两部分组成,其中编码器负责将输入序列压缩成固定长度的向量,解码器则依据这个向量生成输出序列。在训练阶段和预测阶段,解码器的输入处理方式有所不同。此外,文章还涵盖了超参数设置、数据预处理、模型构建和模型使用等相关步骤。" Seq2Seq模型是一种在NLP领域广泛使用的架构,它允许从一个序列转换到另一个序列,克服了传统RNN模型对输入和输出序列长度的限制。这种模型的灵活性使其在诸如机器翻译、聊天机器人等任务中表现优秀。 1.1 Seq2Seq模型 Seq2Seq模型由两个主要部分组成:编码器(Encoder)和解码器(Decoder)。编码器接收输入序列,并将其转化为固定长度的上下文向量,这个向量包含了输入序列的关键信息。而解码器则使用这个上下文向量来生成输出序列。在训练过程中,解码器通常依赖目标序列的前一个词作为当前时刻的输入,而在预测阶段,解码器则基于上一时刻自身的输出来生成下一个词。 1.2 Encoder-Decoder结构 01、Encoder 编码器通常采用循环神经网络(RNN),如LSTM或GRU,来处理输入序列。每个时间步的输出被用来更新内部状态,最后的隐藏状态被认为包含了整个输入序列的语义信息,形成上下文向量。 02、Decoder 解码器同样可以是RNN结构,其初始状态是编码器的最终隐藏状态,这样解码器就可以获取输入序列的所有信息。在训练期间,解码器的输入包括上一时刻的解码器输出和目标序列的当前词。而在生成阶段,由于没有目标序列可用,解码器会基于自身前一时刻的输出来预测下一个词。 2. 实战 实战部分涵盖了构建Seq2Seq模型的关键步骤: 2.1 超参数设置 这涉及到模型的结构参数(如RNN层数、隐藏单元数)、学习率、优化器类型等,它们直接影响模型的性能和训练速度。 2.2 数据预处理 包括分词、构建词汇表、序列填充(padding)以确保所有序列长度相同,以及将文本转换为数字表示。 2.3 模型输入 模型输入需要包含编码器的输入序列和解码器的起始令牌,以便解码器知道何时开始生成输出。 2.4 模型构建 使用TensorFlow2.x或Keras构建Seq2Seq模型,通常涉及定义编码器和解码器的RNN层,以及连接它们的结构。 2.5 模型使用 训练模型后,可以通过调用模型的predict方法,传入编码后的输入序列,让解码器生成对应的输出序列。 总结,Seq2Seq模型结合TensorFlow2.x和Keras的实现,为解决自然语言处理中的序列转换问题提供了强大的工具,同时也展示了深度学习在NLP领域的巨大潜力。通过理解和实践这些步骤,开发者可以更好地掌握这一技术并应用于实际项目中。

下载后可阅读完整内容,剩余4页未读,立即下载

- 粉丝: 3

- 资源: 898

我的内容管理

展开

我的内容管理

展开

我的资源

快来上传第一个资源

我的资源

快来上传第一个资源

我的收益 登录查看自己的收益

我的收益 登录查看自己的收益 我的积分

登录查看自己的积分

我的积分

登录查看自己的积分

我的C币

登录后查看C币余额

我的C币

登录后查看C币余额

我的收藏

我的收藏  我的下载

我的下载  下载帮助

下载帮助

最新资源

- C++多态实现机制详解:虚函数与早期绑定

- Java多线程与异常处理详解

- 校园导游系统:无向图实现最短路径探索

- SQL2005彻底删除指南:避免重装失败

- GTD时间管理法:提升效率与组织生活的关键

- Python进制转换全攻略:从10进制到16进制

- 商丘物流业区位优势探究:发展战略与机遇

- C语言实训:简单计算器程序设计

- Oracle SQL命令大全:用户管理、权限操作与查询

- Struts2配置详解与示例

- C#编程规范与最佳实践

- C语言面试常见问题解析

- 超声波测距技术详解:电路与程序设计

- 反激开关电源设计:UC3844与TL431优化稳压

- Cisco路由器配置全攻略

- SQLServer 2005 CTE递归教程:创建员工层级结构

信息提交成功

信息提交成功