掌握Hadoop集群架构与工作流程

需积分: 10 147 浏览量

更新于2024-07-24

收藏 2.49MB PDF 举报

在理解Hadoop集群的核心原理中,这个来自国外专家的PPT提供了深入的讲解。Hadoop是一个开源框架,专为大规模数据处理而设计,尤其适合于大数据分析和云计算环境。其核心组件包括Hadoop Distributed File System (HDFS) 和 MapReduce 模型。

首先,介绍部分概述了Hadoop Server的角色,其中包括DataNode(数据节点)和TaskTracker(任务追踪器)。DataNode负责存储和管理分布式文件系统中的数据块,而TaskTracker则是MapReduce任务的执行者,协调计算任务的分配和执行。这两个角色共同构成了Hadoop集群的基础架构,通过网络连接在整个集群内进行数据的读写和处理。

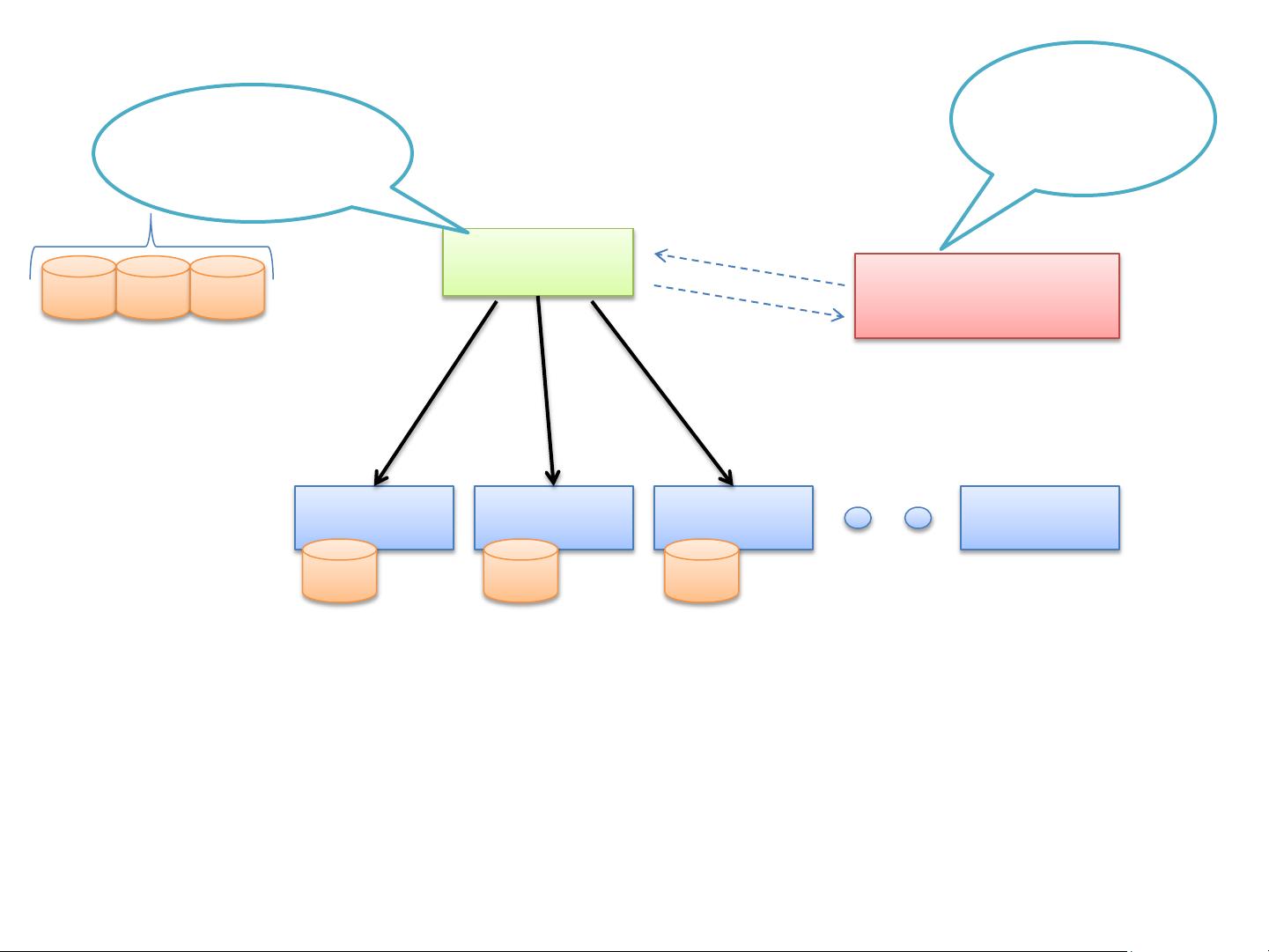

Hadoop集群通常按照物理机架(Rack)进行分组,以提高数据传输效率和故障容错性。NameNode(名称节点)和JobTracker是两个关键服务,NameNode负责元数据管理,如文件系统的目录树,而JobTracker则管理和调度MapReduce作业。此外,还有辅助的Secondary NameNode用于备份和检查NameNode的状态。

整个流程涉及典型的工作流程,包括将数据加载到集群(通过HDFS写入),进行数据分析(使用MapReduce进行计算),将结果存储回集群(继续通过HDFS写入),以及从集群中读取结果(HDFS读取)。例如,一个实际的应用场景可能是统计客户在客户服务邮件中提到“欺诈”这个词的频率。

这个PPT展示了Hadoop集群如何通过分布式数据存储(DistributedDataStorage)和分析(DistributedDataAnalytics)功能,实现高效、可扩展的数据处理能力。网络结构是Hadoop集群设计中的关键,利用交换机连接各个节点,确保数据在集群内的快速流动。

理解Hadoop集群的关键在于掌握其分布式架构、数据节点与任务追踪器的协作、元数据管理、以及MapReduce和HDFS的工作原理。通过这个PPT,学习者可以深入理解Hadoop如何在云计算的大背景下解决大规模数据处理问题。

2013-12-12 上传

2013-11-11 上传

点击了解资源详情

点击了解资源详情

点击了解资源详情

点击了解资源详情

2018-10-17 上传

点击了解资源详情

2019-12-11 上传

dfd2342343

- 粉丝: 0

- 资源: 2

最新资源

- C语言数组操作:高度检查器编程实践

- 基于Swift开发的嘉定单车LBS iOS应用项目解析

- 钗头凤声乐表演的二度创作分析报告

- 分布式数据库特训营全套教程资料

- JavaScript开发者Robert Bindar的博客平台

- MATLAB投影寻踪代码教程及文件解压缩指南

- HTML5拖放实现的RPSLS游戏教程

- HT://Dig引擎接口,Ampoliros开源模块应用

- 全面探测服务器性能与PHP环境的iprober PHP探针v0.024

- 新版提醒应用v2:基于MongoDB的数据存储

- 《我的世界》东方大陆1.12.2材质包深度体验

- Hypercore Promisifier: JavaScript中的回调转换为Promise包装器

- 探索开源项目Artifice:Slyme脚本与技巧游戏

- Matlab机器人学习代码解析与笔记分享

- 查尔默斯大学计算物理作业HP2解析

- GitHub问题管理新工具:GIRA-crx插件介绍