"本文将梳理Transformer在时间序列预测中的发展历程,介绍从2020年至2023年的代表工作,包括原始Transformer的应用、TFT、Informer、LogTrans、Autoformer、Reformer、Sparse Transformer、LSTNet、Multivariate Transformer等模型的创新点和应用场景。"

Transformer模型自2017年提出以来,以其并行计算的优势和强大的序列建模能力,逐渐被应用于各个领域,尤其是在自然语言处理中取得了显著成果。然而,时间序列预测因其独特的自相关性、周期性和长期依赖性,对模型提出了新的要求。Transformer的结构经过一系列改造,以适应时间序列数据的特点。

1. Transformer-based Model(2020)

论文《Deep Transformer Models for Time Series Forecasting: The Influenza Prevalence Case》首次尝试将标准Transformer应用于时间序列预测,主要用作Encoder-Decoder架构,尽管没有针对时间序列特性进行优化,但它开启了Transformer在这个领域的研究。

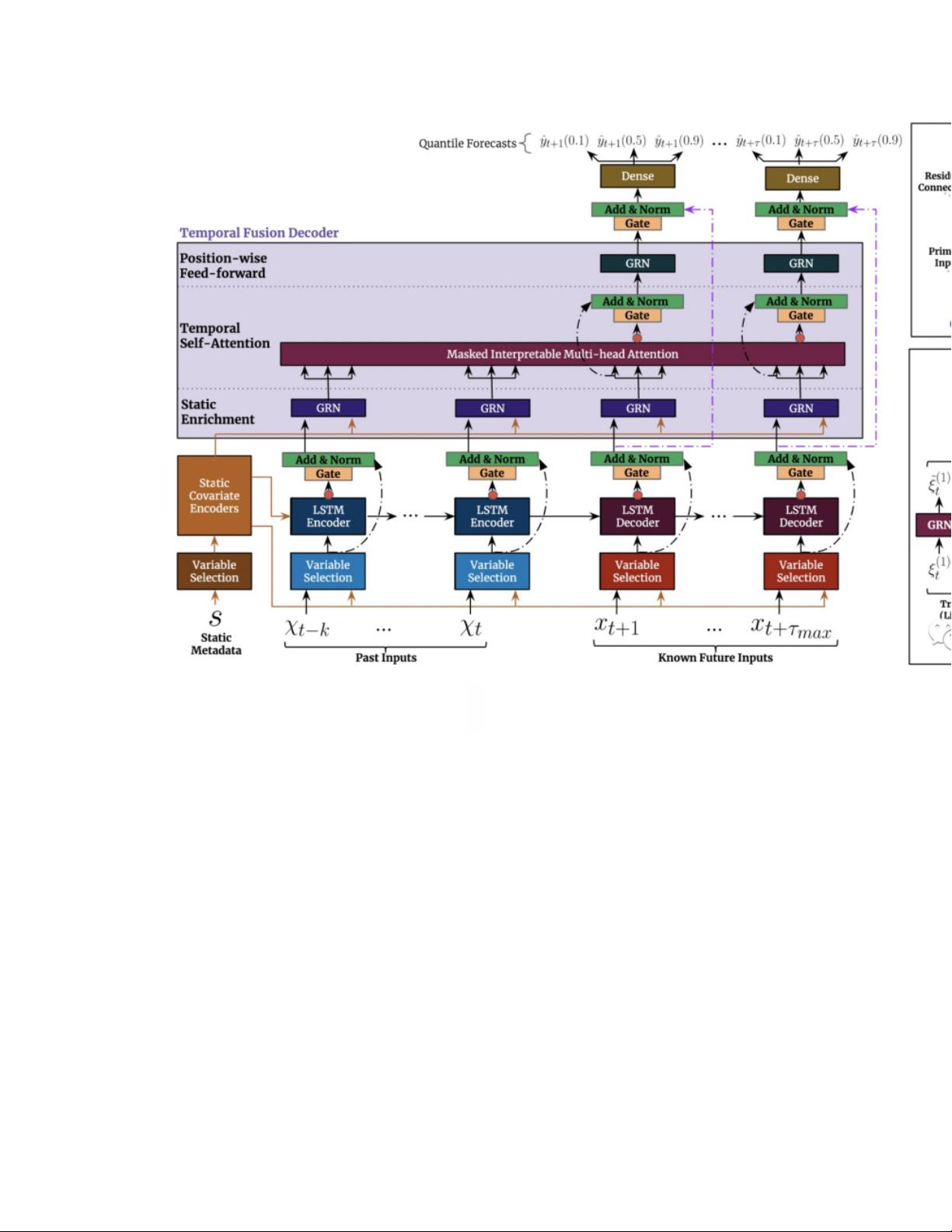

2. TFT (Temporal Fusion Transformer)(2019)

Temporal Fusion Transformers (TFT)结合了LSTM和Transformer,LSTM用于捕捉时间序列的局部依赖,而Transformer用于全局信息融合,尤其在多步预测任务中展现出优秀性能。

3. Informer(2020)

Informer通过引入自注意力的稀疏机制,解决了Transformer计算复杂度高的问题,特别是对于长序列预测,它能够有效地捕获远距离依赖。

4. LogTrans(2021)

LogTrans针对时间序列的指数衰减特性,提出了对数变换的自注意力机制,改善了Transformer在处理长期依赖时的效率。

5. Autoformer(2021)

Autoformer利用周期性和趋势分解,将时间序列预测问题分解为几个更小的子任务,提高了预测的精度和效率。

6. Reformer(2020)

Reformer通过使用局部敏感哈希(LSH)来实现自注意力的线性复杂度,使得长序列的Transformer模型成为可能,同时也适用于时间序列预测。

7. Sparse Transformer(2019)

Sparse Transformer采用稀疏矩阵乘法来降低Transformer的计算成本,同样适用于需要处理大量时间步长的情况。

8. LSTNet(2017)

LSTNet结合了长短时记忆网络(LSTM)和卷积神经网络(CNN),在捕捉时间序列的局部和全局模式方面有出色表现,是早期尝试将深度学习应用于时间序列预测的成功案例。

9. Multivariate Transformer(2022)

Multivariate Transformer专门针对多变量时间序列预测,通过多头自注意力来处理多个变量之间的相互影响,增强了模型的泛化能力。

这些工作展示了Transformer如何逐步进化以适应时间序列预测的特性,从最初的直接应用到后来的结构创新,如引入稀疏注意力、周期性建模、分解任务和变量间交互处理等。这些进展不仅提高了预测准确率,还降低了计算复杂度,使得Transformer在实际的时间序列预测任务中更具竞争力。随着研究的深入,可以预见Transformer将在时间序列预测领域发挥更大的作用,持续推动AI技术的发展。