PySpark学习指南:从环境搭建到SparkSQL与SparkStreaming

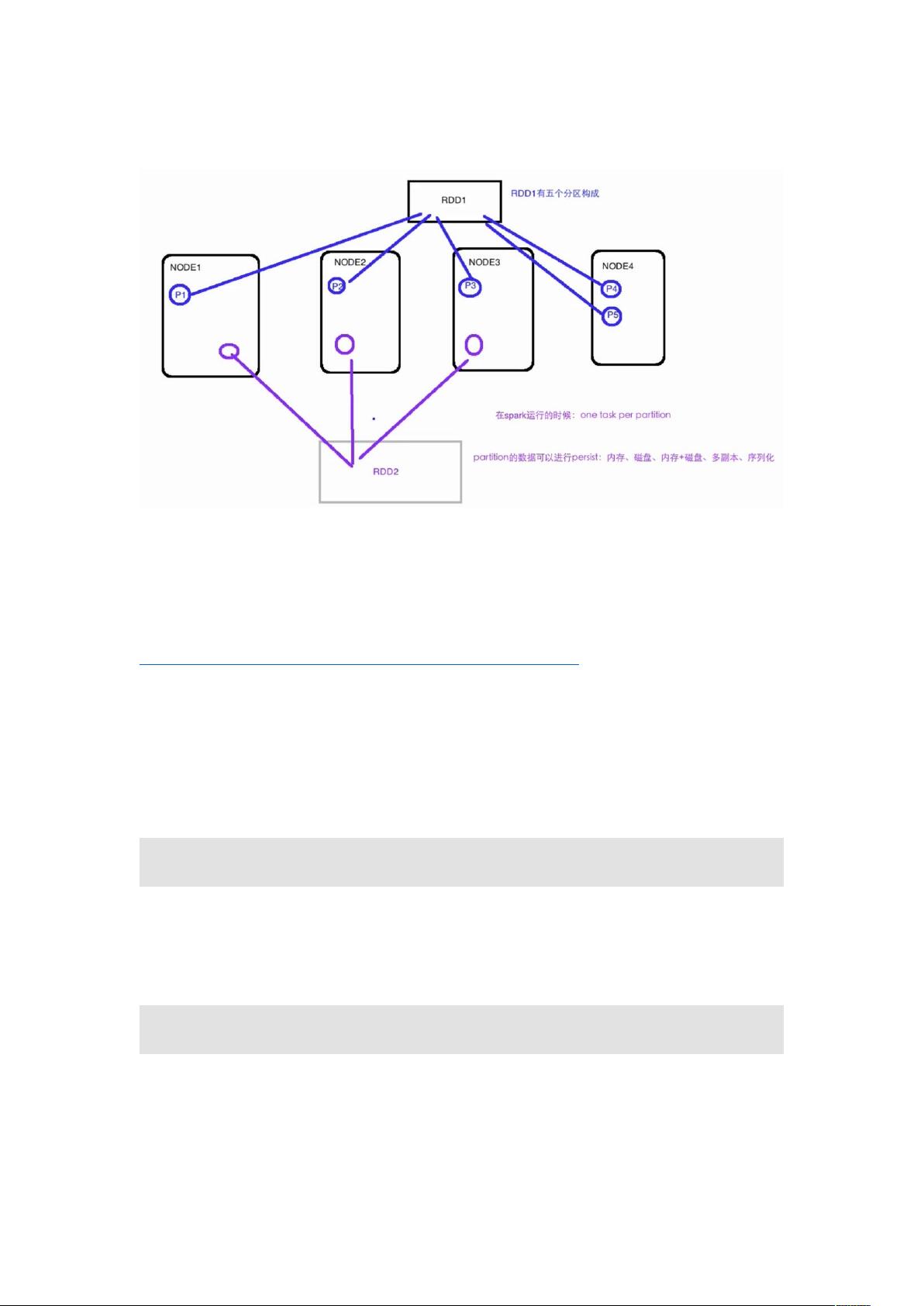

"09-SparkV1.2(PySpark)-LAPTOP-G48G0MSR.docx" 本文档详细介绍了如何学习和使用Apache Spark的PySpark接口,特别是针对Spark 2.3版本,该版本对Python的支持已经非常成熟。文档首先列出了课程安排,涵盖从环境搭建到综合项目实战的全过程,强调了理论与实践相结合的重要性。 1. **环境搭建** 在开始学习PySpark之前,需要安装和配置一系列的软件环境,包括: - JDK:安装Java Development Kit并将其添加到系统环境变量中,因为Spark是用Java编写的。 - Scala:安装Scala并添加环境变量,因为Spark的基础是Scala库。 - Hadoop:配置Hadoop环境变量,Spark可以与Hadoop生态系统集成。 - MAVEN:安装Maven,用于编译Spark源代码。 - Python:安装Python 3,并在源码下编译安装,以供PySpark使用。同时,需要确保安装了一些Python依赖。 2. **Spark源码编译与安装** - 下载Spark源码后,通过`./configure --prefix=xxx/xxx/xxx`指定Python的安装路径来配置源码。 - 添加Python到环境变量,以便Spark能识别。 - 使用Maven编译源码,遵循官方文档中的“Building Spark”指南。 - 编译完成后,解压缩生成的Spark二进制包,并通过`bin/spark-shell`启动Spark shell。 3. **Spark运行模式** - Spark支持多种运行模式,如本地模式(适用于开发)、YARN模式(适用于生产环境)等。在开发过程中,本地模式就足够了,但在实际生产环境中,YARN或Mesos等集群管理模式更常见。 4. **PySpark配置** - 若要使用PySpark,需确保`PYSPARK_PYTHON`环境变量指向Python 3解释器的路径。若启动时默认使用Python 2.7,可以通过设置`PYSPARK_PYTHON`环境变量来切换到Python 3。 5. **PySpark使用** - 启动PySpark shell通过运行`./pyspark`命令。 - 可以使用`./pyspark --help`查看所有可用的命令行选项。 6. **学习建议** - 推荐做笔记和查阅官方文档,以加深理解和记忆。 - 鼓励多尝试,独立思考,避免过分依赖他人的帮助。 7. **课程内容** - SparkCore核心:介绍RDD(弹性分布式数据集)的概念和编程模型。 - SparkCore进阶与调优:探讨高级RDD操作和性能优化策略。 - SparkSQL:学习如何使用Spark SQL进行结构化数据处理。 - SparkStreaming:理解Spark实时流处理框架的工作原理。 - Azkanban:可能是一个关于敏捷项目管理工具Azkanban的课程,包含基础、实战和进阶内容。 - 综合项目实战:通过实际项目练习,巩固所学知识。 通过这个课程,学员将能够全面掌握PySpark的使用,从基本的RDD操作到复杂的SparkSQL查询,再到实时流处理,最终能应用到实际项目中去。

剩余52页未读,继续阅读

- 粉丝: 168

- 资源: 17

我的内容管理

展开

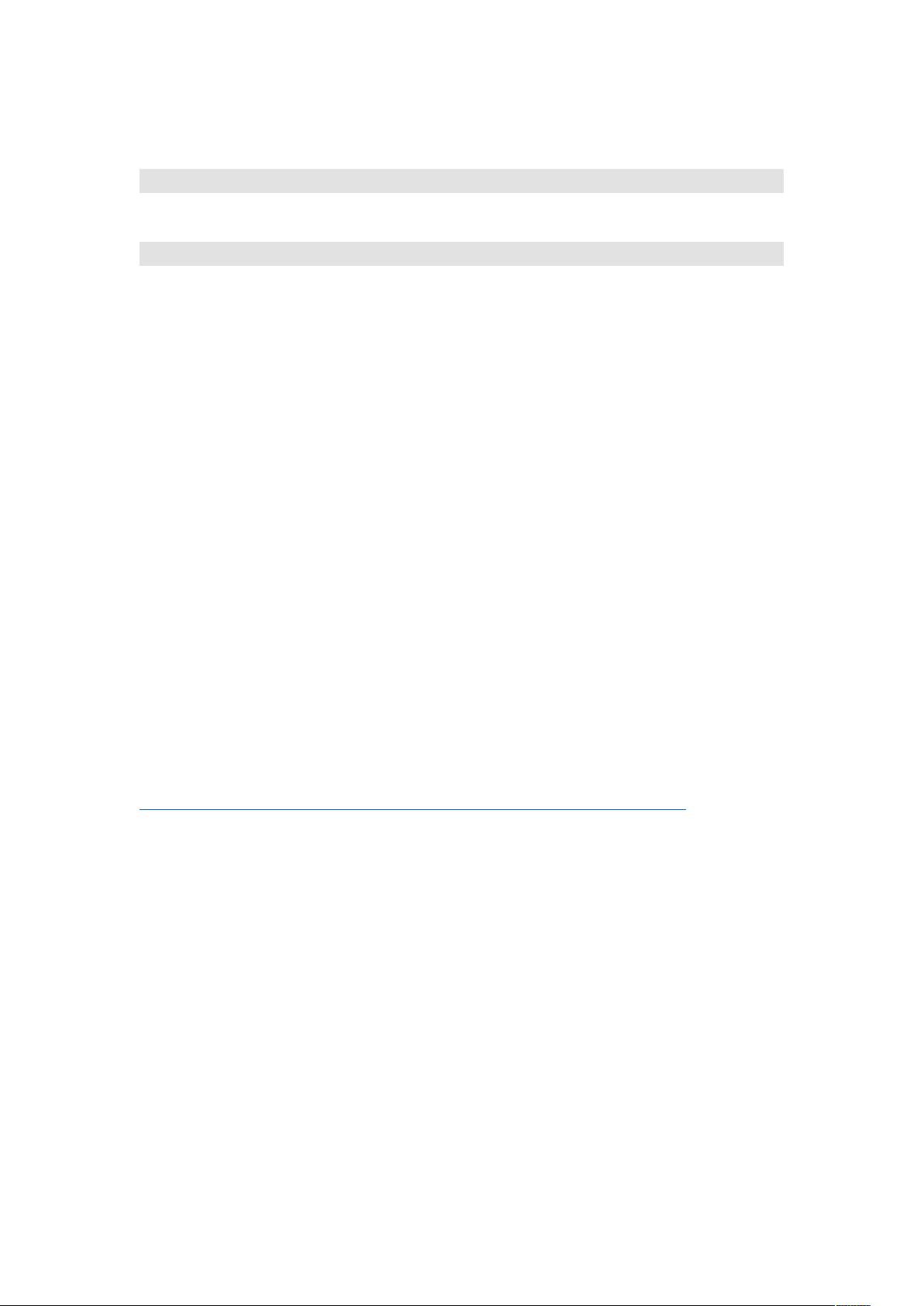

我的内容管理

展开

我的资源

快来上传第一个资源

我的资源

快来上传第一个资源

我的收益 登录查看自己的收益

我的收益 登录查看自己的收益 我的积分

登录查看自己的积分

我的积分

登录查看自己的积分

我的C币

登录后查看C币余额

我的C币

登录后查看C币余额

我的收藏

我的收藏  我的下载

我的下载  下载帮助

下载帮助

最新资源

- 多模态联合稀疏表示在视频目标跟踪中的应用

- Kubernetes资源管控与Gardener开源软件实践解析

- MPI集群监控与负载平衡策略

- 自动化PHP安全漏洞检测:静态代码分析与数据流方法

- 青苔数据CEO程永:技术生态与阿里云开放创新

- 制造业转型: HyperX引领企业上云策略

- 赵维五分享:航空工业电子采购上云实战与运维策略

- 单片机控制的LED点阵显示屏设计及其实现

- 驻云科技李俊涛:AI驱动的云上服务新趋势与挑战

- 6LoWPAN物联网边界路由器:设计与实现

- 猩便利工程师仲小玉:Terraform云资源管理最佳实践与团队协作

- 类差分度改进的互信息特征选择提升文本分类性能

- VERITAS与阿里云合作的混合云转型与数据保护方案

- 云制造中的生产线仿真模型设计与虚拟化研究

- 汪洋在PostgresChina2018分享:高可用 PostgreSQL 工具与架构设计

- 2018 PostgresChina大会:阿里云时空引擎Ganos在PostgreSQL中的创新应用与多模型存储

信息提交成功

信息提交成功