实时计算与自助式数据分析:Kudu与Impala的结合应用

2.虚拟产品一经售出概不退款(资源遇到问题,请及时私信上传者)

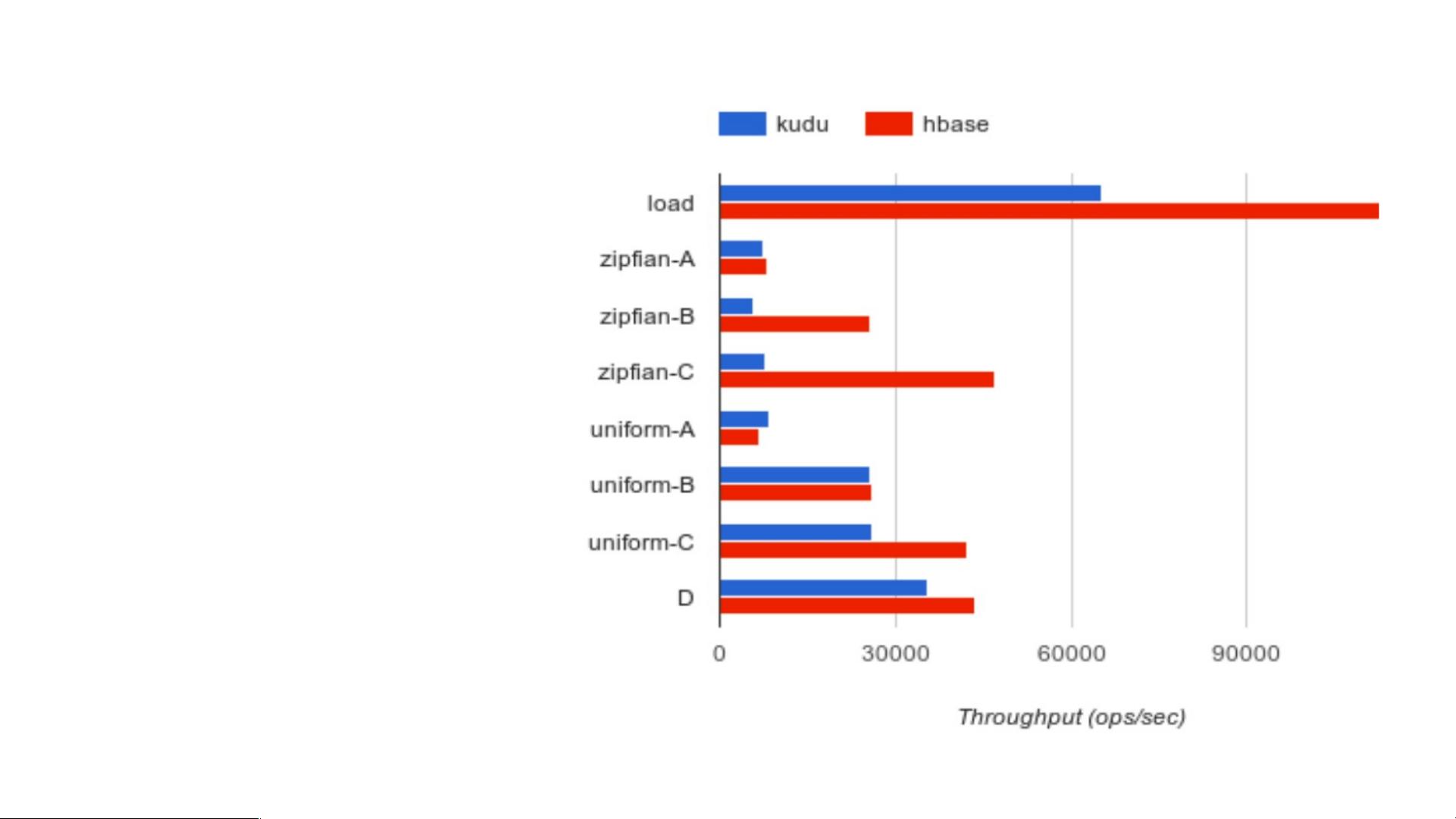

"该文档详细介绍了实时计算与自助式数据分析的相关技术,包括日志收集、存储解决方案、计算框架以及数据分析工具。重点讲述了Kudu和Impala在构建实时数据仓库和即席分析引擎中的作用和特性,并提供了机器部署方案。" 在大数据处理领域,实时计算与自助式数据分析正变得越来越重要。日志收集是这一过程的第一步,文档提到了H5日志收集、App日志收集和服务端日志收集,这些都是获取数据的关键环节,用于理解用户行为、系统性能和业务运营状况。 存储方面,文档介绍了三种不同层次的存储解决方案:离线存储如HDFS,近线存储如Kudu,以及在线存储如Hbase。HDFS适合大规模批处理,而Kudu则以高效Scan查询和随机读写能力为特点,适用于实时数据处理。Hbase则作为在线存储,提供高并发的实时读写操作。 在计算层面上,文档提到了SparkJob、Impala和HiveSQL等工具。SparkSQL和Spark Streaming用于离线计算,它们是Spark框架的一部分,能够处理大规模数据集。Spark Structure Streaming是Spark针对流数据处理的更新,提供了更简洁的API。Storm则是一个分布式实时计算系统,适合处理连续的数据流。 自助式数据分析工具如Metabase,使得业务人员无需编程就能创建报表和进行数据分析,极大地提高了工作效率。数据应用部分涉及数据挖掘算法,这通常包括预测模型、分类和聚类算法等,用于发现数据中的模式和洞察。 业务实时监控是通过实时计算平台对关键指标进行监控,确保业务正常运行。BI(商业智能)战略分析则利用数据来驱动决策,帮助公司制定长远规划。在卖家开店和经营分析场景中,这些工具可以提供关键的业务洞察,优化运营策略。 Kudu+Impala组合构成了一个强大的实时数据仓库和即席分析引擎。Kudu的强项在于其随机读写性能和高效的Scan查询,而Impala则是一个快速的SQL查询引擎,能够兼容Hive语法,提供内存Shuffle以加速计算。两者结合,能够实现高性能的数据分析。 在硬件部署上,文档描述了一个由20台物理机组成的Kudu和HDFS混合部署集群,以及一个由300台物理机组成的更大规模集群,用于处理大量数据和提供计算能力。这些机器配置了不同数量的内存、SSD和SATA硬盘,以满足不同工作负载的需求。 该文档深入探讨了实时计算和数据分析的各个环节,从数据收集到存储,再到计算和分析,最后到硬件部署,为读者提供了全面的理解和实践指导。

剩余27页未读,继续阅读

- 粉丝: 12w+

- 资源: 9195

我的内容管理

展开

我的内容管理

展开

我的资源

快来上传第一个资源

我的资源

快来上传第一个资源

我的收益 登录查看自己的收益

我的收益 登录查看自己的收益 我的积分

登录查看自己的积分

我的积分

登录查看自己的积分

我的C币

登录后查看C币余额

我的C币

登录后查看C币余额

我的收藏

我的收藏  我的下载

我的下载  下载帮助

下载帮助

最新资源

- AirKiss技术详解:无线传递信息与智能家居连接

- Hibernate主键生成策略详解

- 操作系统实验:位示图法管理磁盘空闲空间

- JSON详解:数据交换的主流格式

- Win7安装Ubuntu双系统详细指南

- FPGA内部结构与工作原理探索

- 信用评分模型解析:WOE、IV与ROC

- 使用LVS+Keepalived构建高可用负载均衡集群

- 微信小程序驱动餐饮与服装业创新转型:便捷管理与低成本优势

- 机器学习入门指南:从基础到进阶

- 解决Win7 IIS配置错误500.22与0x80070032

- SQL-DFS:优化HDFS小文件存储的解决方案

- Hadoop、Hbase、Spark环境部署与主机配置详解

- Kisso:加密会话Cookie实现的单点登录SSO

- OpenCV读取与拼接多幅图像教程

- QT实战:轻松生成与解析JSON数据

信息提交成功

信息提交成功