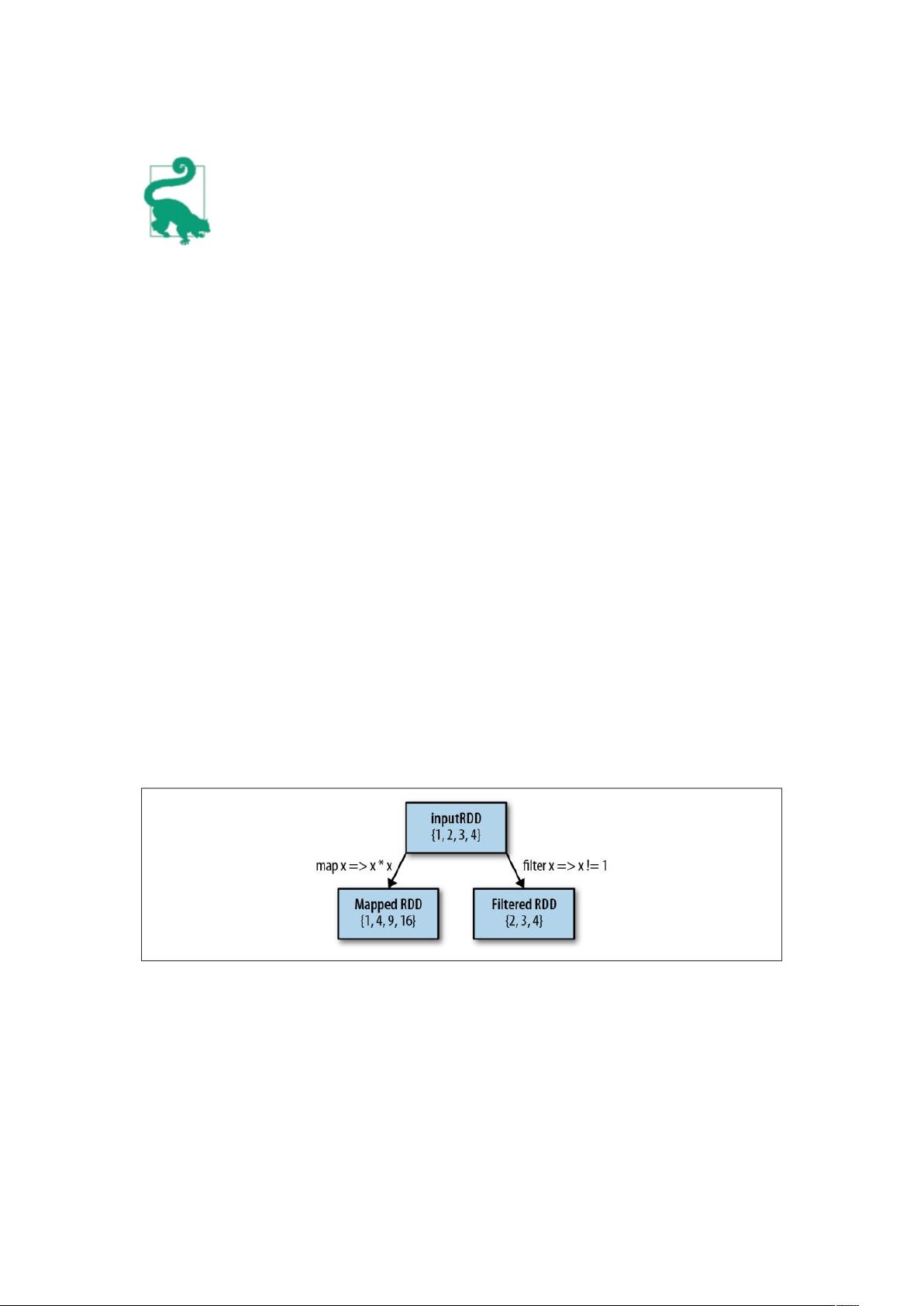

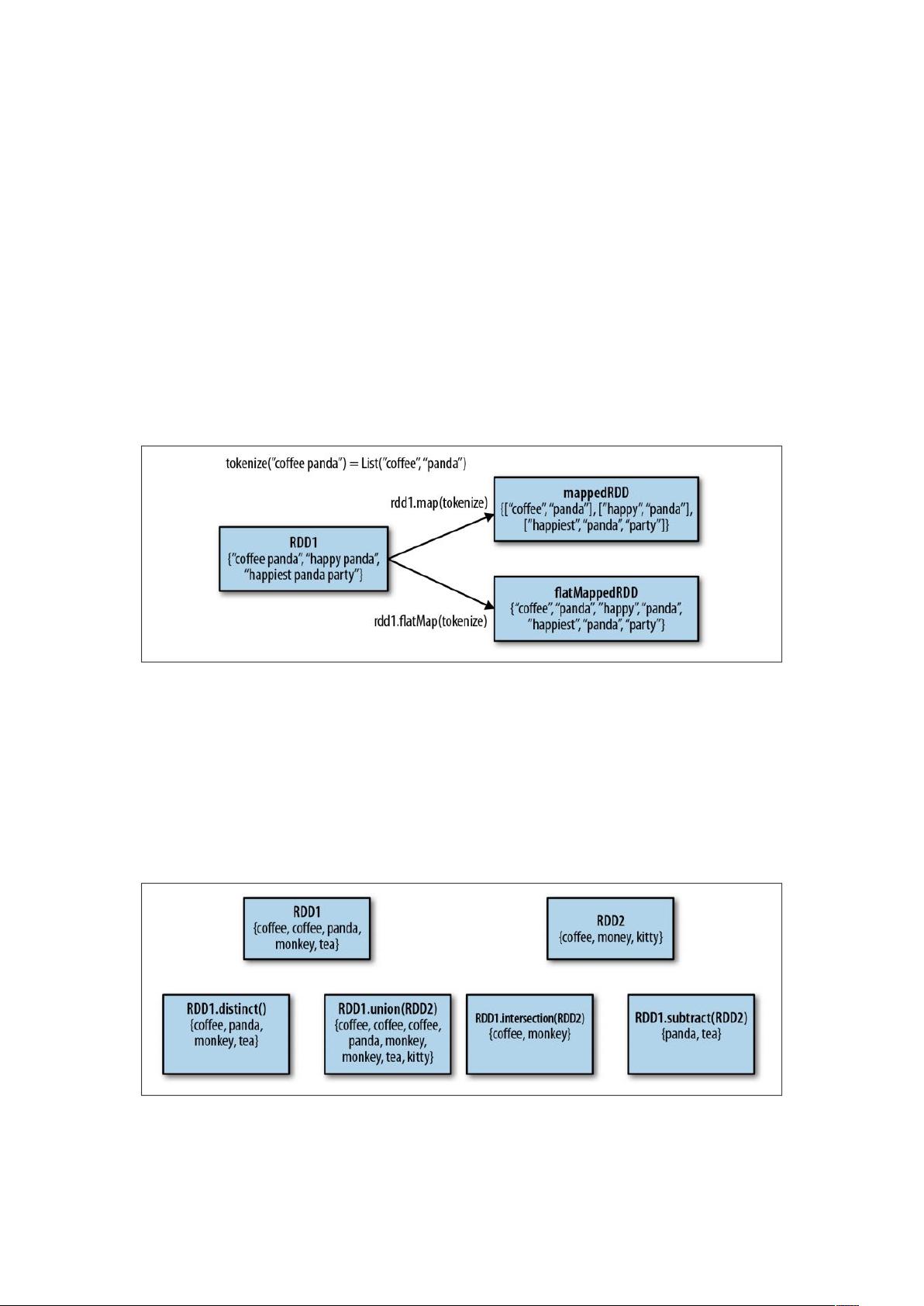

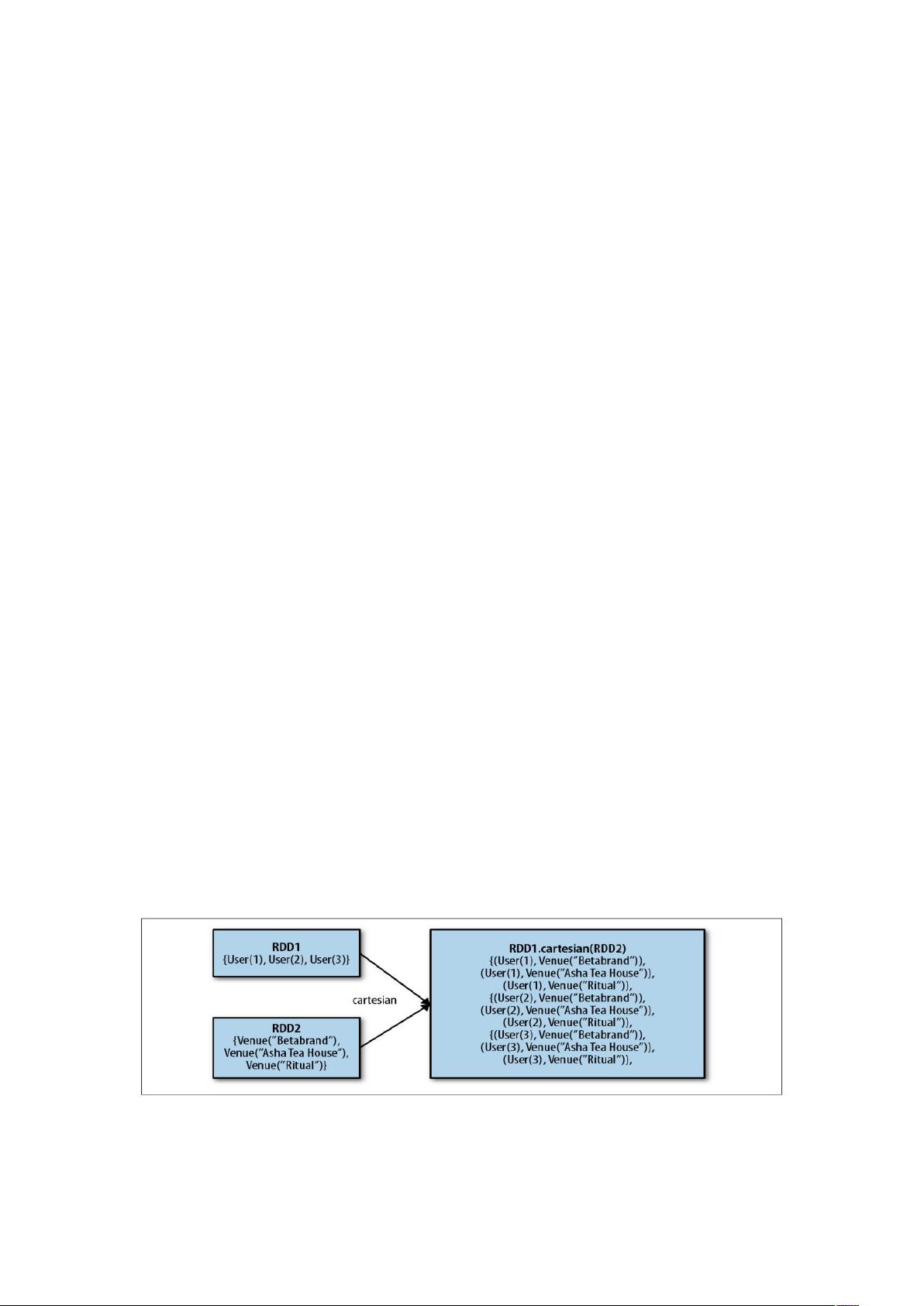

"Learning Spark 中文原文翻译3-8章,涵盖了大数据处理框架Spark的核心概念和技术" 在《Learning Spark》这本书的第3至8章中,作者Holden Karau、Andy Konwinski、Patrick Wendell和Matei Zaharia深入介绍了Apache Spark这一强大的大数据处理框架。这些章节的内容对于理解Spark的基本原理和实际应用至关重要。以下是对这部分内容的详细概述: 1. **Spark核心概念**:Spark的核心是弹性分布式数据集(Resilient Distributed Datasets, RDDs),这是一种不可变、分区的数据集合,可在集群中并行操作。RDD的设计使得它能够高效地支持数据处理任务,如转换和行动,并具备容错性。 2. **Spark架构**:Spark架构基于一个主从模型,由驱动程序(Driver)和工作节点(Worker Nodes)组成。驱动程序负责管理作业(Job)和任务(Task)的生命周期,而工作节点执行实际的计算任务。 3. **Spark编程模型**:Spark提供了多语言支持,包括Scala、Java、Python和R。Spark Shell提供了一个交互式环境,便于快速测试和调试代码。Spark API包含了一套丰富的操作符,如map、filter和reduce,用于对数据进行转换。 4. **Spark SQL**:Spark SQL是Spark的一个模块,允许用户使用SQL或DataFrame API来处理结构化数据。DataFrame API提供了一种统一的方式来处理不同来源的数据,如Parquet、Hive或JSON,提高了开发效率。 5. **Spark Streaming**:Spark Streaming处理实时数据流,通过微批处理(micro-batching)实现了低延迟的数据处理。它可以与多种数据源(如Kafka、Flume和TCP sockets)集成,构建实时流处理应用。 6. **机器学习库MLlib**:MLlib提供了广泛的机器学习算法,包括分类、回归、聚类、协同过滤等,以及模型选择和评估工具。它简化了机器学习流程,使得数据科学家可以更专注于模型的构建和优化。 7. **图形处理Giraph**:虽然Spark自身并不包含图形处理功能,但它可以通过Giraph库支持图论算法,如PageRank和社区检测,适用于社交网络分析等领域。 8. **Spark部署和优化**:这部分内容涵盖如何在各种环境(如Standalone、YARN或Mesos)中部署Spark集群,以及如何进行性能调优,包括内存管理和数据序列化策略。 通过这些章节的学习,读者将能掌握Spark的基本用法,理解其背后的分布式计算原理,并具备开发大规模数据处理应用的能力。书中的实例和实践建议有助于加深理论知识的理解,同时提供实际操作经验。

剩余142页未读,继续阅读

- 粉丝: 7

- 资源: 14

我的内容管理

展开

我的内容管理

展开

我的资源

快来上传第一个资源

我的资源

快来上传第一个资源

我的收益 登录查看自己的收益

我的收益 登录查看自己的收益 我的积分

登录查看自己的积分

我的积分

登录查看自己的积分

我的C币

登录后查看C币余额

我的C币

登录后查看C币余额

我的收藏

我的收藏  我的下载

我的下载  下载帮助

下载帮助

最新资源

- 贵州煤矿矿井水分类与处理策略:悬浮物、酸性与非酸性

- 醛固酮增多症肾上腺静脉采样对比:ACTH后LR-CAV的最优评估

- 开源云连接传感器监控平台:农业土壤湿度远程监测

- 母婴用品企业年度生产计划线性规划优化模型:实证与应用

- 井下智能变电站:Rogowski线圈电流检测系统的研发与性能验证

- 霍州矿区煤巷稳定性分析及支护策略

- ARM嵌入式系统远程软件更新方案:基于TFTP协议

- 煤炭选煤中汞分布规律与洗选脱汞效果

- 提升码垛机器人性能:拉格朗日动力学模型与滑模模糊控制的应用

- 增强现实技术提升学前手写教学:设计与开发案例

- 不规则工作面沉陷三角剖分算法提升与应用

- 卡尔曼滤波在瞬变电磁干扰压制中的应用研究

- 煤矿安全能力研究:理论与系统构建

- LonWorks总线技术在斜巷运输车辆定位与跑车防护中的应用

- 神东煤炭集团高效煤粉锅炉系统:节能环保新实践

- Ti/SnO2+Sb2Ox/PbO2电极分形维数与电催化性能研究

信息提交成功

信息提交成功