【Python中的自然语言处理】:让机器理解人类语言,3个实战项目

发布时间: 2024-08-31 10:36:22 阅读量: 21 订阅数: 96

python自然语言处理实战pdf_dode.zip

# 1. Python自然语言处理基础

在信息技术日新月异的今天,自然语言处理(NLP)已经成为AI领域的核心议题。Python以其简洁和强大的库支持,在NLP领域占据了一席之地。本章将带你入门Python自然语言处理的世界,我们将从最基础的知识开始,逐步深入了解NLP的各个方面。

## 1.1 Python在自然语言处理中的地位

Python是目前最受欢迎的编程语言之一,它在自然语言处理领域中的地位也十分显赫。原因主要有以下几点:

- **易读性强**:Python简洁的语法和强大的表达能力使得代码更易于理解和维护。

- **丰富的库支持**:像NLTK、spaCy、gensim等NLP专业库的出现,大大降低了NLP的门槛。

- **活跃的社区**:Python社区庞大,有着丰富的学习资源和问题解决方案。

## 1.2 NLP基本概念和应用场景

自然语言处理是计算机科学、人工智能和语言学相结合的领域,它使用算法让计算机理解、解析、生成人类语言。

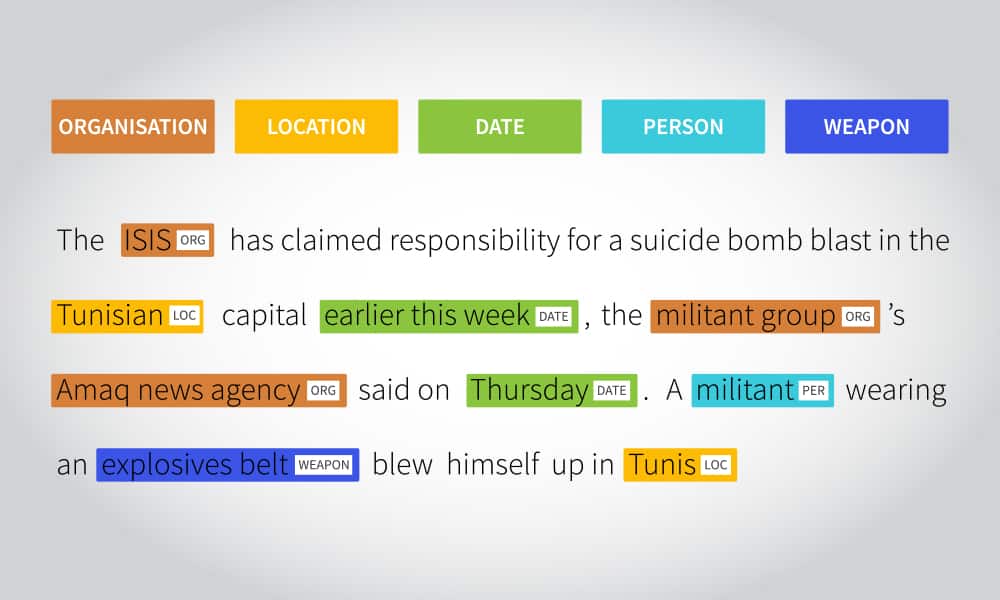

- **基本概念**:包括分词(Tokenization)、词性标注(POS tagging)、命名实体识别(NER)、依存句法分析(Dependency parsing)等。

- **应用场景**:从简单的聊天机器人到复杂的机器翻译,NLP的应用场景广泛,包括但不限于搜索引擎、语音识别、情感分析等。

接下来的章节,我们将深入探讨NLP的理论基础和实用工具,为读者构建一个坚实的知识体系。

# 2. 自然语言处理理论

自然语言处理(NLP)是计算机科学和人工智能领域的一个分支,旨在使计算机能够理解和处理人类语言。本章将探讨NLP中的基础理论,涵盖从文本表示到语义理解,再到情感分析与文本分类的不同层面。

### 2.1 语言模型与文本表示

#### 2.1.1 词袋模型

词袋模型(Bag of Words,BoW)是一种简单的文本表示方法,它忽略了文本中词的顺序和语法结构,只记录每个词在文档中出现的次数。尽管它对于一些NLP任务来说过于简化,但为文本处理提供了一个基础。

下面是一个简单的BoW实现的示例,使用Python中的`sklearn.feature_extraction.text`模块。

```python

from sklearn.feature_extraction.text import CountVectorizer

corpus = [

'This is the first document.',

'This document is the second document.',

'And this is the third one.',

'Is this the first document?',

]

vectorizer = CountVectorizer()

X = vectorizer.fit_transform(corpus)

print(X.toarray())

```

在上述代码中,`CountVectorizer`类将一系列文本文档转换为词频矩阵。`fit_transform`方法同时拟合词袋模型并转换文本数据。

#### 2.1.2 TF-IDF模型

TF-IDF(Term Frequency-Inverse Document Frequency)模型是一种用于信息检索和文本挖掘的常用加权技术,该模型考虑了词频(TF)和逆文档频率(IDF)两个因素。

TF-IDF模型在表示文档时,旨在反映单词对于一个文档集或一个语料库中的其中一份文档的重要性。TF-IDF值越高,表示词条在文档中的重要性越高。

下面的Python代码展示了如何使用`sklearn.feature_extraction.text.TfidfVectorizer`类来实现TF-IDF模型。

```python

from sklearn.feature_extraction.text import TfidfVectorizer

corpus = [

'This is the first document.',

'This document is the second document.',

'And this is the third one.',

'Is this the first document?',

]

vectorizer = TfidfVectorizer()

X = vectorizer.fit_transform(corpus)

print(X.toarray())

```

在上述代码中,`TfidfVectorizer`类同样将一系列文本文档转换为TF-IDF向量形式。

### 2.2 词义消歧与语义理解

#### 2.2.1 Word2Vec与词向量表示

Word2Vec是Google提出的一种词嵌入技术,用于将词汇表示为密集的向量形式。它通过学习词与词之间的关系来捕获语义信息。Word2Vec模型有两个主要的架构:CBOW(连续词袋)和Skip-gram。

Word2Vec模型能够有效地捕捉到同义词和反义词在向量空间中的相对位置。以下是一个使用`gensim`库训练Word2Vec模型的示例。

```python

from gensim.models import Word2Vec

sentences = [

['this', 'is', 'the', 'first', 'document'],

['this', 'document', 'is', 'the', 'second', 'document'],

['and', 'this', 'is', 'the', 'third', 'one'],

['is', 'this', 'the', 'first', 'document']

]

model = Word2Vec(sentences, vector_size=100, window=5, min_count=1, workers=4)

model.train(sentences, total_examples=len(sentences), epochs=10)

```

上述代码展示了如何使用`Word2Vec`模型训练一个简单的词向量表示。通过训练,我们得到了每个词的向量表示,这些向量能够反映词的语义信息。

#### 2.2.2 语义相似度计算

语义相似度是指两个或多个词汇在语义上的相似性。在词向量空间中,可以通过计算两个向量之间的余弦相似度来衡量语义相似度。

下面是一个计算两个单词向量之间相似度的代码示例:

```python

def cosine_similarity(vec1, vec2):

dot_product = np.dot(vec1, vec2)

norm_vec1 = np.linalg.norm(vec1)

norm_vec2 = np.linalg.norm(vec2)

return dot_product / (norm_vec1 * norm_vec2)

# 假设我们已经有了两个单词的向量表示word_vector1和word_vector2

similarity = cosine_similarity(word_vector1, word_vector2)

print(similarity)

```

在这段代码中,我们定义了一个`cosine_similarity`函数来计算两个向量的余弦相似度。这种方法可以用来比较文本中不同词汇之间的语义相似度。

通过这样的词向量表示和相似度计算,NLP领域能够对文本进行更深层次的理解和处理。然而,这只是NLP众多技术中的一部分。下一节将探讨如何应用这些技术在情感分析和文本分类上。

### 2.3 情感分析与文本分类

#### 2.3.1 情感分析原理与方法

情感分析(Sentiment Analysis)是自然语言处理的一个分支,主要用于识别文本中的主观信息,并且对内容的情感倾向进行分类。例如,可以将一段评论分为正面、中性或负面情感。

情感分析通常基于有监督学习方法,使用预先标记好的数据集来训练模型,并将训练好的模型用于未标记数据的情感预测。其方法包括基于机器学习的分类算法和基于深度学习的方法,如循环神经网络(RNN)、长短期记忆网络(LSTM)等。

下面是一个使用Python中的`nltk`库进行情感分析的简单示例:

```python

import nltk

from nltk.sentiment import SentimentIntensityAnalyzer

nltk.download('vader_lexicon')

sia = SentimentIntensityAnalyzer()

text = "I love this phone. The screen is fantastic!"

sentiment_score = sia.polarity_scores(text)

print(sentiment_score)

```

在这个例子中,我们利用`SentimentIntensityAnalyzer`分析一段文本的情感倾向。该方法会返回一个包含四个情感指标的字典,包括:'neg'(负面),'neu'(中立),'pos'(正面),以及'compound'(复合得分)。

#### 2.3.2 文本分类技术及其应用

文本分类是将文本数据分配到一个或多个类别中的过程。文本分类的方法包括朴素贝叶斯、支持向量机(SVM)、随机森林等。这些技术在垃圾邮件检测、新闻文章分类、情感分析等多个领域中都有应用。

例如,朴素贝叶斯分类器是一种基于贝叶斯定理的简单概率分类器,适用于高维数据集。下面是一个使用`scikit-learn`库的朴素贝叶斯分类器进行新闻文章分类的示例:

```python

from sklearn.feature_extraction.text import CountVectorizer

from sklearn.model_selection import train_test_split

from sklearn.naive_bayes import MultinomialNB

from sklearn.metrics import accuracy_score

# 假设corpus为新闻数据集的文本,labels为对应的数据集标签

corpus = [

'This is the first document.',

'This document is the second document.',

'And this is the third one.',

'Is this the first document?',

]

labels = ['1', '2', '3', '1']

vectorizer = CountVectorizer()

X = vectorizer.fit_transform(corpus)

X_train, X_test, y_train, y_test = train_test_split(X, labels, test_size=0.25, random_state=0)

clf = MultinomialNB()

clf.fit(X_train, y

```

0

0