【Python数据挖掘技巧】:从入门到精通,发现数据中的隐藏宝藏

发布时间: 2024-08-31 10:04:01 阅读量: 600 订阅数: 101

Python数据科学领域Anaconda全面解析:从入门到精通的应用指南

# 1. 数据挖掘概述与Python基础

## 1.1 数据挖掘简介

数据挖掘是从大量数据中提取有价值信息的过程。它通常与人工智能、机器学习和统计学紧密相关,目的是为了识别数据中的模式,从而帮助企业做出更加明智的决策。数据挖掘的核心在于发现数据之间未知的关系,这些关系可以用来预测未来趋势,为业务增长提供支撑。

## 1.2 Python编程语言的崛起

Python已经发展成为数据科学领域的主导语言,其流行主要归功于强大的数据处理能力、丰富的第三方库以及简洁易读的语法。它支持从数据采集、清洗、分析到数据可视化的一整套流程,尤其在数据挖掘和机器学习方面,其生态系统的成熟使得Python成为行业首选。

## 1.3 Python在数据挖掘中的应用

Python提供了像NumPy、Pandas和Matplotlib这样的数据分析和可视化库,这些库为数据处理和结果展示提供了强大的支持。而scikit-learn库的出现,则使得Python在构建和测试各种数据挖掘模型上变得前所未有的简单。以下是一个简单的Python示例代码,展示了如何使用Pandas库处理数据:

```python

import pandas as pd

# 加载数据集

data = pd.read_csv('dataset.csv')

# 查看数据的前五行

print(data.head())

# 数据描述性统计分析

print(data.describe())

```

上述章节的内容概述了数据挖掘的基本概念、Python在数据挖掘领域的重要角色以及如何使用Python进行基础的数据处理操作。这是整个数据挖掘流程的起点,为后续章节中更深入的数据处理和挖掘实践打下了基础。

# 2. 数据预处理的艺术

在数据挖掘的生命周期中,数据预处理占据了核心的位置。数据预处理的艺术主要集中在数据质量的提升,为后续的数据分析和挖掘工作打下坚实的基础。本章将深入探讨数据预处理的关键步骤,特征工程的实践技巧,以及数据归一化和标准化的方法。

## 2.1 数据清洗的关键步骤

数据清洗是预处理的首要任务,目的是去除数据集中的错误和无关信息,提高数据的准确性和可靠性。

### 2.1.1 缺失值的处理方法

在实际数据集中,缺失值几乎无处不在。它们可能是由于数据收集、传输或存储过程中的各种问题而产生的。处理缺失值的方法有多种,包括删除含有缺失值的记录、填充缺失值(使用均值、中位数、众数或预测模型等)以及忽略缺失值(在一些特定算法中可行)。选择合适的处理方法取决于数据的特性和业务需求。

#### 示例代码块:处理缺失值

```python

import pandas as pd

import numpy as np

# 创建一个含有缺失值的数据框

data = pd.DataFrame({

'A': [1, 2, np.nan, 4],

'B': [5, np.nan, np.nan, 8],

'C': [9, 10, 11, 12]

})

# 方法1: 删除含有缺失值的记录

data_dropped = data.dropna()

# 方法2: 使用均值填充缺失值

data_filled_mean = data.fillna(data.mean())

# 方法3: 使用前一个值填充缺失值

data_filled_forward = data.fillna(method='ffill')

```

### 2.1.2 异常值的识别与处理

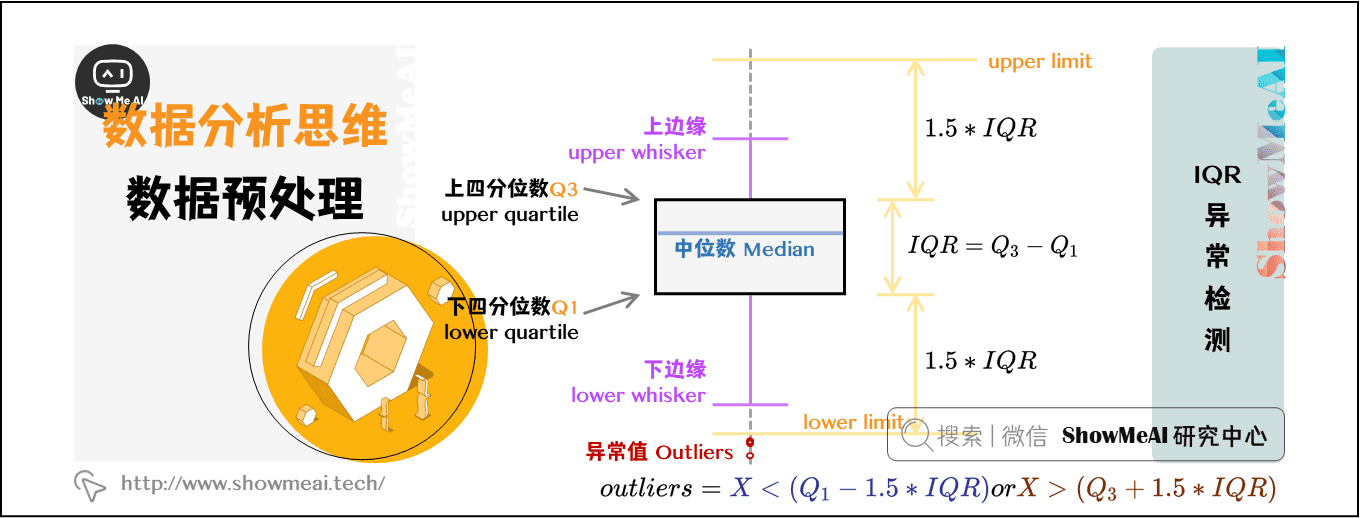

异常值(Outliers)是不符合数据总体分布规律的值,它们可能是由于错误或者异常事件导致。识别和处理异常值对于提高数据质量至关重要。常见的识别异常值的方法包括标准差方法、四分位数范围(IQR)方法等。

#### 示例代码块:识别与处理异常值

```python

# 继续使用上面创建的DataFrame 'data'

# 方法1: 使用标准差识别异常值

mean = data.mean()

std = data.std()

data[(data < (mean - 3 * std)) | (data > (mean + 3 * std))]

# 方法2: 使用IQR识别异常值

Q1 = data.quantile(0.25)

Q3 = data.quantile(0.75)

IQR = Q3 - Q1

data[~((data < (Q1 - 1.5 * IQR)) | (data > (Q3 + 1.5 * IQR))).any(axis=1)]

```

## 2.2 特征工程的实践技巧

特征工程是数据预处理的另一个关键环节,它关注于从原始数据中构造出有助于提升模型性能的新特征。

### 2.2.1 特征选择技术

特征选择旨在从原始特征集中挑选出对模型预测最有帮助的特征子集,从而提高模型的泛化能力和训练效率。

#### 表格展示:特征选择技术比较

| 技术 | 描述 | 优点 | 缺点 |

| --- | --- | --- | --- |

| 过滤方法 | 基于统计测试的特征选择 | 计算简单、快速 | 可能忽略特征间依赖关系 |

| 包裹方法 | 基于模型的特征选择 | 考虑特征间依赖 | 计算代价高 |

| 嵌入方法 | 集成特征选择和模型训练 | 模型选择灵活 | 依赖特定算法 |

### 2.2.2 特征构造与转换

特征构造是通过组合、转换现有特征,创造新的特征,以期望捕捉到更多的数据信息。特征转换则是应用数学函数改变特征的分布或尺度,使其更加符合模型的要求。

#### 示例代码块:特征构造与转换

```python

# 继续使用上面创建的DataFrame 'data'

# 特征构造示例

data['A+B'] = data['A'] + data['B']

# 特征转换示例,对数转换

data['log_A'] = np.log(data['A'] + 1) # 加1以防止log(0)

```

## 2.3 数据归一化和标准化

在数据预处理中,数据归一化和标准化是使不同尺度的数据在相同尺度下进行比较和处理的过程,以避免模型训练时产生偏差。

### 2.3.1 归一化的目标和方法

归一化是将特征值缩放到[0,1]区间的过程,常用的归一化方法包括最小-最大归一化。

### 2.3.2 标准化的应用场景

标准化是将数据的每个特征值都转换为均值为0,标准差为1的分布,也称为Z分数标准化。当数据的分布呈正态分布或模型对数据尺度敏感时,标准化尤其有用。

#### 代码块示例:数据标准化

```python

from sklearn.preprocessing import StandardScaler

# 创建一个数据框

data = pd.DataFrame({

'A': [1, 5, 3, 7],

'B': [1, 10, 3, 4]

})

# 创建标准 scaler 实例

scaler = StandardScaler()

# 对数据进行标准化

data_scaled = scaler.fit_transform(data)

```

数据预处理的每一步都为数据挖掘的成功打下了坚实的基础。通过有效地处理缺失值、识别和处理异常值,以及精心的特征工程,数据科学工作者能够确保他们的模型更准确、更稳定、更高效。归一化和标准化则是将数据转化为模型可接受形式的关键步骤,确保了数据处理的最终结果满足分析的需要。在下一章中,我们将深入探讨如何在Python中应用这些预处理技术以及挖掘算法的实现细节。

# 3. Python中的数据挖掘算法

数据挖掘在本质上是一个循环迭代的过程,它涵盖了从数据收集到模型评估的多个步骤。在Python中,这一过程得到了众多数据科学家和工程师的支持,这要归功于Python提供的强大数据处理和分析的库,比如scikit-learn、NumPy、pandas等。本章节将着重介绍几个在数据挖掘领域中常见且实用的算法,并展示如何在Python中实现它们。

## 3.1 机器学习算法简介

机器学习是数据挖掘的核心组成部分,它让计算机能够通过经验自我改进。机器学习算法可以分为监督学习和非监督学习两类。

### 3.1.1 监督学习与非监督学习

监督学习算法是在带有标签的数据集上进行训练的,其目标是从输入变量预测输出变量。常见的监督学习算法包括线性回归、决策树和支持向

0

0