Java并发编程中的锁机制:深入理解锁的类型与应用

发布时间: 2024-07-22 11:30:30 阅读量: 57 订阅数: 44

Java中的Semaphore:深入理解与应用实践

# 1. Java并发编程概述**

Java并发编程是解决多线程环境下程序正确性和效率问题的关键技术。它允许多个线程同时访问共享资源,从而提高程序的性能和吞吐量。

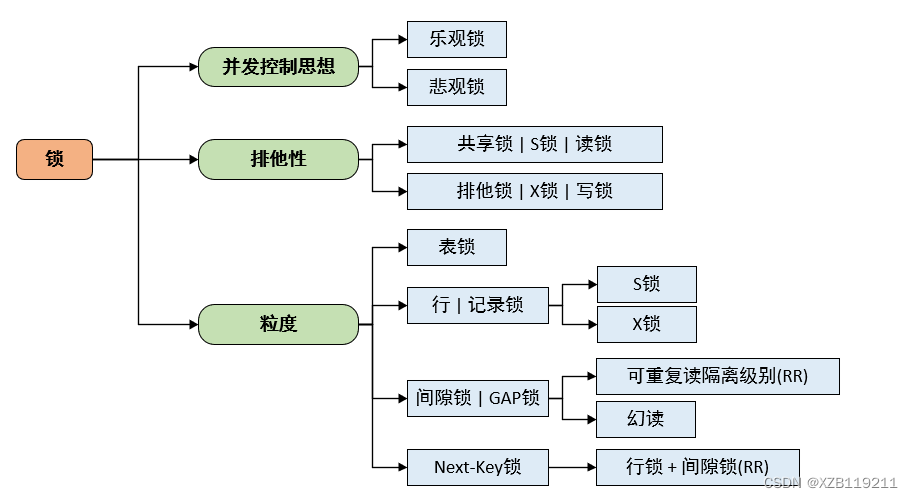

并发编程中,锁是一种重要的同步机制,用于控制对共享资源的访问。通过使用锁,可以确保在同一时间只有一个线程可以访问临界区(即对共享资源进行操作的代码段),从而避免数据竞争和程序崩溃。

# 2. 锁的类型与特性

### 2.1 同步锁与非同步锁

#### 2.1.1 同步锁的原理和实现

**原理:**

同步锁是一种互斥锁,当一个线程获得锁后,其他线程只能等待,直到该线程释放锁。这确保了同一时刻只有一个线程可以访问共享资源,从而避免了并发访问导致的数据不一致性。

**实现:**

Java中同步锁的实现主要通过`synchronized`关键字和`Lock`接口。`synchronized`关键字可以修饰方法或代码块,当一个线程进入同步代码块时,它会自动获取该代码块对应的锁,其他线程只能等待。`Lock`接口提供了更细粒度的锁控制,允许开发者自定义锁的行为。

#### 2.1.2 非同步锁的原理和实现

**原理:**

非同步锁允许多个线程同时访问共享资源,但它通过乐观并发控制机制来保证数据的正确性。非同步锁不会阻止线程访问共享资源,而是通过版本控制或原子操作来确保数据的原子性。

**实现:**

Java中非同步锁的实现主要通过`volatile`关键字和`Atomic`类。`volatile`关键字可以修饰变量,确保变量的修改对所有线程都是可见的。`Atomic`类提供了原子操作,可以保证对变量的修改是原子性的。

### 2.2 公平锁与非公平锁

#### 2.2.1 公平锁的特性和应用场景

**特性:**

公平锁遵循先来先服务的原则,即先请求锁的线程将优先获得锁。这确保了所有线程都有公平的机会访问共享资源。

**应用场景:**

公平锁适用于需要保证线程公平访问的场景,例如资源分配、队列处理等。

#### 2.2.2 非公平锁的特性和应用场景

**特性:**

非公平锁不遵循先来先服务的原则,它允许后来的线程抢占锁。这可能会导致某些线程长时间无法获得锁。

**应用场景:**

非公平锁适用于需要提高吞吐量的场景,例如高并发系统中的读写锁。

### 2.3 可重入锁与不可重入锁

#### 2.3.1 可重入锁的原理和优势

**原理:**

可重入锁允许一个线程多次获取同一把锁。当一个线程已经持有锁时,它可以再次获取该锁,而不会造成死锁。

**优势:**

可重入锁可以防止死锁,并且简化了代码结构。

#### 2.3.2 不可重入锁的原理和限制

**原理:**

不可重入锁不允许一个线程多次获取同一把锁。如果一个线程已经持有锁,它再次获取该锁时将造成死锁。

**限制:**

不可重入锁容易造成死锁,并且限制了代码结构的灵活性。

# 3.1 同步代码块与显式锁

**3.1.1 同步代码块的用法和原理**

同步代码块是 Java 中最常用的锁机制,它通过 `synchronized` 关键字来实现。使用同步代码块时,需要将需要同步访问的代码块放在 `synchronized` 关键字后面,如下所示:

```java

public class Counter {

```

0

0