MATLAB神经网络算法:时间序列预测的强大工具

发布时间: 2024-06-16 12:12:09 阅读量: 88 订阅数: 34

# 1. 神经网络基础**

神经网络是一种受人脑启发的机器学习算法,它由称为神经元的相互连接层组成。每个神经元接收输入,对其进行加权并应用激活函数,然后将输出传递给下一层。

神经网络可以通过训练数据学习复杂模式和关系。训练过程涉及调整神经元之间的权重,以最小化预测输出和实际输出之间的误差。训练好的神经网络可以用于各种任务,包括图像识别、自然语言处理和时间序列预测。

# 2. 时间序列预测原理

### 2.1 时间序列的概念和特点

时间序列是指按时间顺序排列的一系列数据点,它描述了某个变量在不同时间点上的变化情况。时间序列具有以下特点:

- **时序性:**数据点按时间顺序排列,具有时间依赖性。

- **趋势性:**时间序列往往表现出长期上升或下降的趋势。

- **季节性:**时间序列中可能存在周期性的波动,如日、周、月或年。

- **随机性:**时间序列中也存在不规则的波动,这些波动难以预测。

### 2.2 时间序列预测模型

时间序列预测模型旨在根据历史数据预测未来值。常用的模型包括:

- **自回归模型(AR):**利用过去的值预测当前值。

- **滑动平均模型(MA):**利用过去一段时间内的平均值预测当前值。

- **自回归滑动平均模型(ARMA):**结合 AR 和 MA 模型的优点。

- **自回归综合滑动平均模型(ARIMA):**在 ARMA 模型中加入差分操作,消除非平稳性。

**代码块:**

```matlab

% 时间序列数据

data = [1, 2, 3, 4, 5, 6, 7, 8, 9, 10];

% 构建 AR 模型

model = arima(data, 1, 0, 0);

% 预测未来 3 个值

forecast = forecast(model, 3);

% 打印预测结果

disp(forecast);

```

**逻辑分析:**

该代码块使用 MATLAB 的 `arima` 函数构建了一个 AR 模型,并预测了未来 3 个值。`arima` 函数的参数分别表示 AR 阶数、差分阶数和 MA 阶数。

**参数说明:**

- `data`:时间序列数据

- `1`:AR 阶数,表示使用过去 1 个值预测当前值

- `0`:差分阶数,表示不进行差分

- `0`:MA 阶数,表示不使用滑动平均

# 3. MATLAB神经网络算法

### 3.1 神经网络简介

神经网络是一种受人类大脑启发的机器学习算法,它由大量相互连接的节点(神经元)组成。这些神经元通过权重和偏差连接,共同执行复杂的任务。

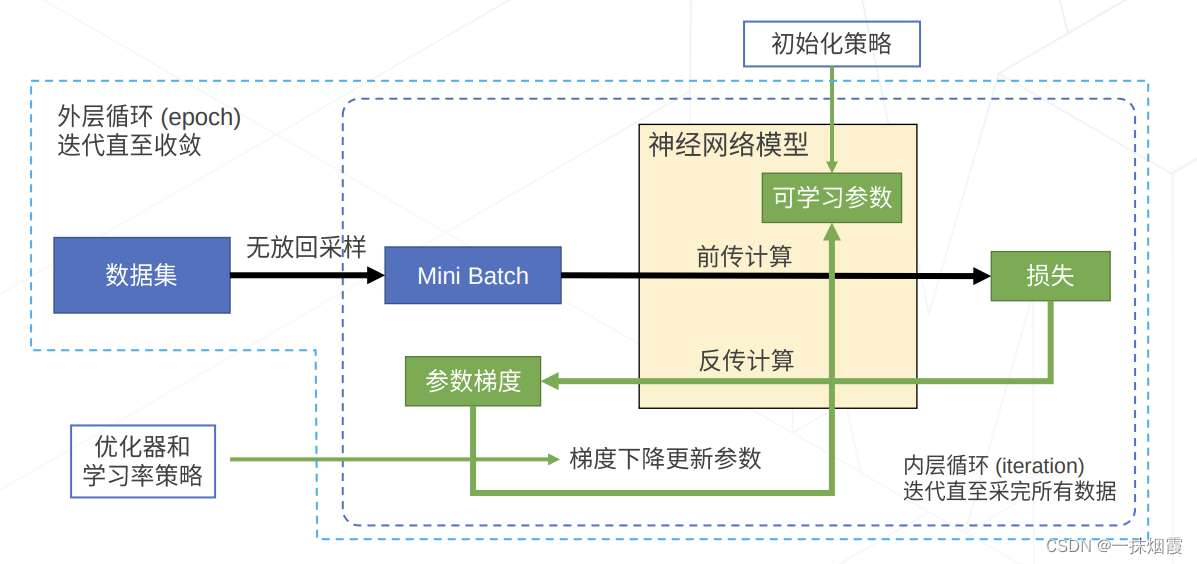

神经网络的学习过程类似于人类大脑,通过不断调整权重和偏差来最小化损失函数。损失函数衡量了网络预测与实际值之间的差异。

### 3.2 常用神经网络算法

MATLAB提供了多种神经网络算法,用于解决各种问题。其中,时间序列预测常用的算法包括:

#### 3.2.1 递归神经网络(RNN)

RNN是一种特殊的神经网络,它可以处理序列数据。RNN通过将当前输入与前一个时间步的隐藏状态相结合,来预测序列的下一个值。

**代码块:**

```matlab

% 创建RNN层

rnnLayer = recurrentLayer('lstm', 10

```

0

0