MATLAB神经网络算法:自然语言处理的革命

发布时间: 2024-06-16 12:17:19 阅读量: 82 订阅数: 34

MATLAB算法基于神经网络

# 1. MATLAB神经网络算法概述

MATLAB神经网络算法是一种强大的机器学习技术,它受到人脑神经网络结构的启发。这些算法可以学习从数据中提取复杂模式,并执行各种任务,包括分类、预测和生成。

在自然语言处理 (NLP) 领域,MATLAB神经网络算法已成为解决各种挑战性任务的有效工具。这些算法能够理解、解释和生成人类语言,从而为 NLP 应用程序开辟了新的可能性。

# 2. 自然语言处理基础

### 2.1 自然语言处理的概念和应用

自然语言处理(NLP)是一门计算机科学领域,它涉及计算机理解、解释和生成人类语言的能力。NLP 的目标是让计算机能够像人类一样处理语言,从而实现人机交互、信息提取和语言生成等应用。

NLP 在现实世界中有着广泛的应用,包括:

- **文本分类:**将文本文档分类到预定义的类别中,例如新闻、体育、商业等。

- **文本生成:**生成类似人类的文本,例如新闻文章、产品描述或聊天机器人响应。

- **机器翻译:**将文本从一种语言翻译成另一种语言。

- **信息检索:**从文本文档中检索与用户查询相关的相关信息。

- **情感分析:**分析文本以确定作者的情感或态度。

### 2.2 自然语言处理技术概述

NLP 涉及一系列技术,包括:

- **词法分析:**将文本分解为单词和符号。

- **句法分析:**识别单词之间的语法关系,形成句子结构。

- **语义分析:**理解单词和句子的含义。

- **语用分析:**理解语言的上下文和意图。

- **机器学习:**使用算法从数据中学习语言模式,并构建模型来执行 NLP 任务。

机器学习在 NLP 中扮演着至关重要的角色,因为它使计算机能够从大量文本数据中学习语言规律,并构建模型来执行各种 NLP 任务,例如文本分类、文本生成和机器翻译。

# 3. MATLAB神经网络算法在自然语言处理中的应用

MATLAB神经网络算法在自然语言处理领域具有广泛的应用,为解决复杂且多样的语言处理任务提供了强大的工具。本节将探讨MATLAB神经网络算法在文本分类、文本生成和机器翻译中的具体应用。

### 3.1 文本分类

#### 3.1.1 文本分类的原理和方法

文本分类是指将文本文档分配到预定义类别或标签的任务。它在许多自然语言处理应用中至关重要,例如垃圾邮件过滤、主题识别和情感分析。

文本分类的原理基于特征提取和分类算法。首先,从文本文档中提取代表性特征,例如词频、词共现和句法结构。然后,将这些特征输入分类算法,该算法根据预先训练的数据学习将文档分配到特定类别的规则。

#### 3.1.2 MATLAB神经网络算法在文本分类中的应用

MATLAB提供了一系列神经网络算法,可用于文本分类任务。其中最常用的算法是:

- **多层感知器 (MLP)**:MLP是一种前馈神经网络,具有输入层、隐藏层和输出层。它通过反向传播算法进行训练,以最小化分类误差。

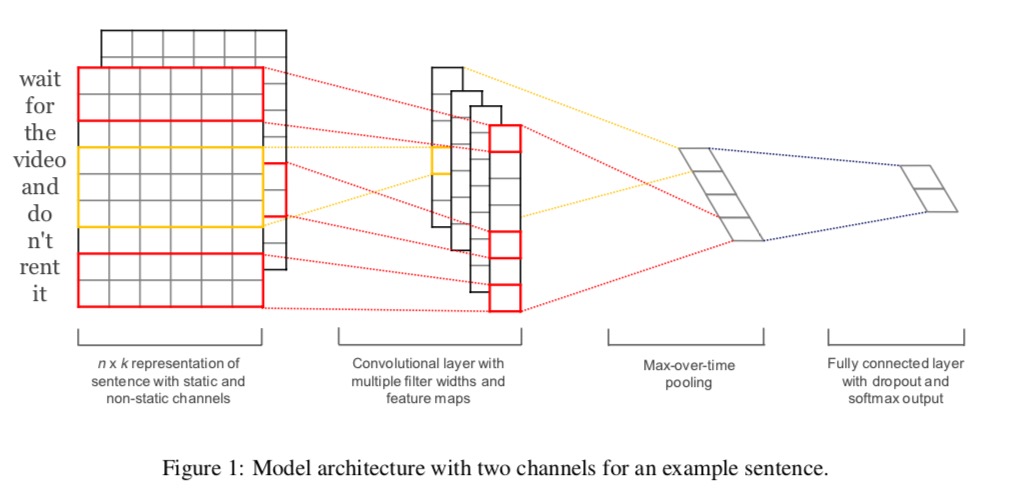

- **卷积神经网络 (CNN)**:CNN是一种深度神经网络,专门用于处理具有网格状结构的数据,例如图像和文本。它使用卷积层和池化层提取文本中的局部特征。

- **循环神经网络 (RNN)**:RNN是一种递归神经网络,能够处理序列数据,例如文本。它使用隐藏状态来记住先前输入的信息,从而对文本的上下文进行建模。

### 3.2 文本生成

#### 3.2.1 文本生成的原理和方法

文本生成是指根据给定的输入生成新文本的任务。它在自然语言处理中具有广泛的应用,例如机器翻译、对话系统和

0

0