HDFS副本策略案例分析:大数据量挑战下的7个成功调整实例

发布时间: 2024-10-28 21:31:52 阅读量: 23 订阅数: 28

# 1. HDFS副本策略概述

## 1.1 HDFS副本策略简介

HDFS(Hadoop Distributed File System)作为大数据存储的基石,设计之初便考虑到了数据的可靠性和可扩展性。副本策略,作为其核心功能之一,涉及到数据块的备份、存储位置选择以及灾难恢复等关键环节。副本策略的核心是确保在部分硬件失效的情况下,系统能够快速恢复数据,维持服务的高可用性。

## 1.2 副本存储的考量

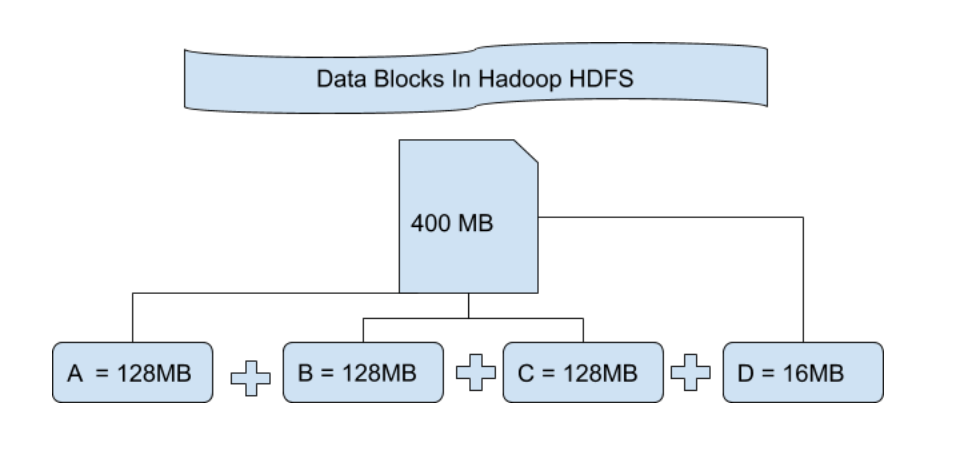

在HDFS中,文件被分成一系列的block(块),每个block默认复制三份存储到不同的datanodes(数据节点)中。这种策略确保了当一个节点失败时,数据不会丢失,系统仍能通过其他节点上的副本继续提供服务。然而,副本数量的管理以及它们的分布位置,直接影响了数据恢复的速度和系统的整体性能。

## 1.3 策略的实际意义

副本策略并不仅仅是关于如何存储数据副本,还包括了数据在存储过程中的安全性、读写性能和管理便捷性。HDFS的副本策略因此需要根据实际的业务需求、硬件资源以及网络状况进行灵活调整。这种调整不仅仅是在集群搭建初期需要考虑,更是一个需要随着数据量增长和业务变化而持续优化的过程。

# 2. 副本策略理论基础

## 2.1 HDFS副本策略的原理

### 2.1.1 副本的基本概念

在分布式文件系统HDFS中,为了保证数据的高可用性和容错性,系统将数据分成块(block)进行存储,并在不同的数据节点(DataNode)上创建数据的多个副本。副本的存在使得即使部分节点发生故障,系统依然可以保证数据的完整性并持续提供服务。

### 2.1.2 副本放置的策略

HDFS通过一种称为“机架感知”的方法来放置副本。它将数据节点组织成不同的机架(rack),并且为了防止机架级别的故障导致数据丢失,每个数据块通常会有副本分别放置在不同的机架上。一般情况下,第一份副本放在写入数据的节点上,其他副本则根据机架的带宽和节点的负载情况进行优化放置。

## 2.2 影响副本策略的关键因素

### 2.2.1 硬件条件与限制

硬件条件包括磁盘空间、CPU性能、内存大小等,这些都是影响副本放置策略的重要因素。在存储空间有限的情况下,可能需要减少副本数量以节省空间。相反,如果硬件资源充足,可以考虑增加副本数量来提高数据的可靠性。

### 2.2.2 网络性能考量

网络带宽和延迟对于副本的读写性能有很大影响。在副本放置时应尽可能考虑网络带宽,避免在网络拥塞的节点之间创建过多副本。同时,也需要考虑节点间的延迟,尽量在延迟较低的节点间复制数据以提升整体性能。

## 2.3 副本策略与数据可靠性

### 2.3.1 副本数量与数据可靠性

副本数量越多,数据可靠性越高,但同时会占用更多的存储空间,并可能影响性能。通常HDFS默认情况下,每个数据块会有三个副本。但是在一些关键应用场合下,可能需要增加副本数量,比如金融系统或医疗记录存储。增加副本数量意味着系统可以容忍更多的节点故障而不丢失数据。

### 2.3.2 自动故障转移与数据恢复

HDFS通过一个中心化的名字节点(NameNode)来管理文件系统命名空间和客户端对文件的访问。当数据节点发生故障时,系统会自动检测到并启动复制过程,从而替换掉已经损坏的副本。故障转移和数据恢复都是透明进行的,保证了系统的高可用性。

在此阶段,系统的故障转移机制和数据恢复过程必须高效和可靠。一旦出现故障,数据的完整性和系统的服务能力都会受到挑战。因此,合理的副本策略能够确保在故障发生时,系统能够快速恢复到正常工作状态。

# 3. 副本策略调整的实践案例

## 3.1 增加副本数量以提高数据可靠性

### 3.1.1 案例背景与需求分析

在数据密集型的业务场景中,数据的可靠性是不容忽视的关键要素。例如,在一个金融机构的交易处理系统中,数据的任何丢失都可能导致重大的经济损失和信任危机。在这样的背景下,HDFS副本策略的调整尤为关键。

金融机构的交易系统数据往往具有以下特点:

- 高写入频率:交易数据不断被生成和存储。

- 数据完整性要求极高:任何交易记录的损坏或丢失都可能导致法律和财务问题。

- 数据访问模式:主要是读操作,但偶尔会有密集的写入操作。

为了保证数据的可靠性,在此案例中,决定增加副本数量。HDFS默认的副本数量是3,对于关键数据,将副本数量提升至5可以提供更高的容错能力。这样做虽然会增加存储成本,但可以显著降低数据丢失的风险。

### 3.1.2 调整副本数量的步骤与效果

增加副本数量的操作步骤如下:

1. 停止相关的HDFS服务(NameNode和DataNode)或使用滚动重启,以确保配置的生效。

2. 通过HDFS的配置文件`hdfs-site.xml`修改副本数量的配置参数`dfs.replication`的值,例如将其设置为5。

```xml

<configuration>

<property>

<name>dfs.replication</name>

<value>5</value>

</property>

</configuration>

```

3. 更新配置后,启动HDFS服务。

4. 使用HDFS命令行工具或API重新上传数据,以便新数据按新的副本数量进行存储。对于已存在数据,

0

0