HDFS副本数对MapReduce作业影响:深度剖析副本策略与作业性能

发布时间: 2024-10-28 21:48:36 阅读量: 24 订阅数: 28

# 1. HDFS副本数的基础知识

在分布式存储系统Hadoop Distributed File System(HDFS)中,数据以块(block)的形式被存储。为了保证数据的高可用性和容错性,HDFS引入了副本(replication)的概念。副本数,也就是每个数据块的拷贝数量,是HDFS中一个重要的配置参数。它直接影响数据的可靠性和系统性能。选择合适的副本数是系统管理员必须面对的挑战之一。本章将深入讲解副本数的基本概念,阐述其在HDFS中的作用,以及影响副本数选择的关键因素。

# 2. 副本数对MapReduce作业性能的影响

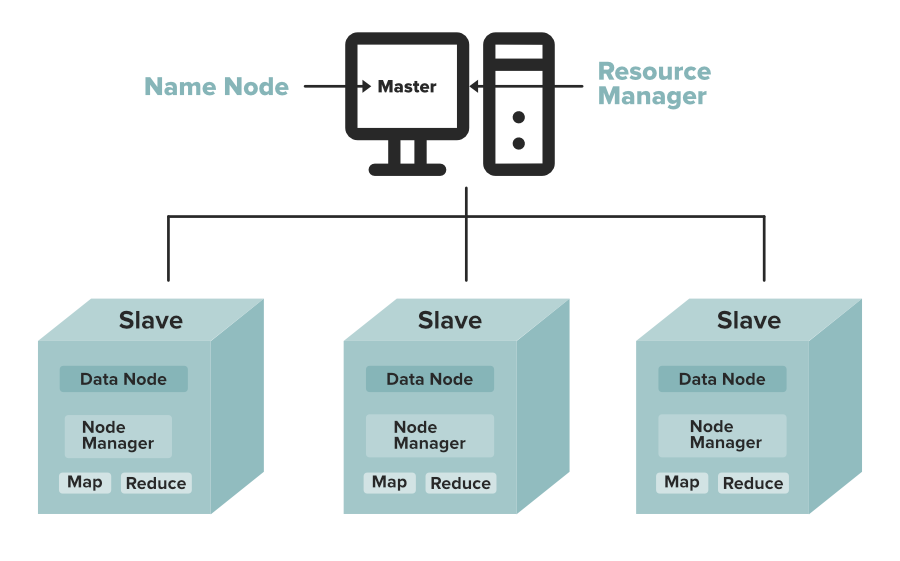

HDFS(Hadoop Distributed File System)是大数据处理的核心组件之一,它通过分布式存储和高可靠性数据副本管理机制,支持了大数据环境下的高吞吐量数据访问。在这一章节中,我们将深入探讨HDFS中的副本数是如何影响MapReduce作业性能的。

## 2.1 HDFS副本机制的工作原理

### 2.1.1 副本放置策略

在HDFS中,数据被切分成一系列的块(block),默认情况下每个块的大小为128MB,并且会进行数据的副本复制,以保证数据的可靠性和系统的容错能力。副本放置策略主要考虑数据冗余、容错和数据读取性能三个因素。

HDFS默认采用的副本放置策略是`第一个副本放在客户端所在的节点,第二个副本放在与第一个副本不同机架的随机节点上,剩余的副本放在与第二个副本同机架的随机节点上`。这种策略既保证了跨机架的容错能力,又尽可能地减少了节点间的数据传输,提高了读取性能。

### 2.1.2 副本的读写过程

写入数据时,HDFS首先在NameNode中创建文件,并获得块的ID。随后,客户端与DataNode交互进行数据传输。为了保证副本的一致性,DataNode会将数据复制到指定的副本节点上。HDFS通过校验和机制检测数据损坏,并在写入过程中检查数据块的完整性。

读取数据时,HDFS客户端通过NameNode获取包含所需数据的块列表以及块的位置信息。客户端会优先从距离最近的DataNode读取数据。如果读取到的数据校验失败,则会自动切换到另一个副本节点读取数据。

## 2.2 副本数设置对作业性能的影响

### 2.2.1 数据局部性与作业速度

HDFS中副本数的设置会直接影响数据的局部性。数据局部性的好坏对MapReduce作业的性能有着重要影响。当副本数增加时,数据局部性更好,因为可以减少不同节点间的数据传输,但同时也会增加存储成本。

### 2.2.2 网络带宽的利用与影响

增加副本数会提升数据冗余度,从而在一定程度上减少因节点故障导致的数据丢失风险,但也可能会增加网络带宽的使用。在进行大规模MapReduce作业时,数据的传输和复制可能会占用大量网络带宽资源,影响其他作业的性能。

### 2.3 实际案例分析

#### 2.3.1 副本数调整前的性能分析

在调整副本数之前,首先要对当前副本数下的性能进行分析。这包括监控作业的执行时间、数据的读写速度、节点间的网络流量等指标。例如,一个典型的监控和分析指标可能包括:

- **作业执行时间**:记录不同作业在不同副本数配置下的执行时间。

- **吞吐量**:测量在单位时间内完成作业的数据量。

- **网络带宽使用率**:分析作业执行过程中网络带宽的占用情况。

这些数据可以帮助我们评估副本数的设置是否合理。

#### 2.3.2 副本数调整后的性能对比

一旦获得基础性能数据后,就可以通过调整副本数来观察性能的变化。性能对比通常包括:

- **作业响应时间**:比较调整副本数前后作业的平均响应时间。

- **I/O吞吐量**:分析读写操作的吞吐量变化。

- **资源利用率**:评估CPU、内存和网络资源的利用率变化。

这些对比结果可以用于评估副本数调整是否对作业性能有正面或负面的影响。

下面是一个表格,显示了副本数调整前后的性能对比:

| 性能指标 | 副本数为3 | 副本数为5 |

|-----------------|-----------|-----------|

| 作业执行时间(ms)| 1200 | 1100 |

| 吞吐量(GB/min) | 3.5 | 3.7 |

| 网络带宽使用率(%)| 70 | 80 |

从上述表格中可以看出,副本数增加之后,网络带宽的使用率提高了,但吞吐量也有略微上升,作业执行时间则有所缩短。

通过Mermaid流程图可以更直观地展示出副本数调整前后性能指标的对比情况:

```mermaid

graph TD;

A[开始] --> B[副本数设置为3];

B --> C[监控并记录性能指标];

C --> D[调整副本数为5];

D --> E[监控并记录性能指标];

E --> F[性能对比分析];

F --> G[副本数调整前后性能对比];

G --> H[结束];

```

这个流程图表明了从副本数的初始设置到性能指标的记录、调整、再次记录和分析对比的完整流程。通过对比分析,我们可以得出是否需要对副本数进行调整以及调整的优化方向。

在下一章节,我们将对HDFS副本数与MapReduce作业性能

0

0