【HDFS与MapReduce协同】:深入解析数据处理流程的秘密

发布时间: 2024-10-28 04:54:25 阅读量: 14 订阅数: 40

# 1. HDFS与MapReduce协同概述

在当今的大数据处理领域,Hadoop作为一个重要的开源框架,为数据的存储和分析提供了坚实的基础。其中,HDFS(Hadoop Distributed File System)和MapReduce是其核心组件,它们互相协作,共同处理海量数据。HDFS负责高效、可靠的存储,而MapReduce则负责数据的并行计算。这种分工合作的模式,使得Hadoop能够在处理大规模数据集时展现出其独特的魅力和强大的能力。

在本章节中,我们将探讨HDFS与MapReduce的基本协同机制,以及它们在大数据处理流程中的作用和优化方法。通过对这两者的协同工作原理的深入分析,我们将揭示它们如何共同完成复杂的任务,例如数据的批处理、实时处理以及数据的生命周期管理。这将为后续章节中对这两个组件的深入探讨奠定坚实的基础。

我们将从HDFS的架构原理和数据操作实践开始,然后深入到MapReduce的核心理论与实现。之后,我们会详细讲解HDFS与MapReduce的协同机制,以及如何在实际案例中应用这些技术。最后,我们将展望HDFS与MapReduce的未来趋势,探讨新一代大数据存储技术和处理框架的演进。通过这一系列的章节,我们期待读者能够全面理解和掌握这两个技术组件,并能够有效地应用于大数据环境。

# 2. HDFS的基础理论与实践

## 2.1 HDFS的架构原理

### 2.1.1 HDFS的核心组件与功能

HDFS(Hadoop Distributed File System)是一个高度容错性的系统,设计用来部署在低廉的硬件上。它提供了高吞吐量的数据访问,非常适合大规模数据集的应用程序。HDFS的架构设计使其能够跨多个硬件数据存储器可靠地存储大量数据,并通过简单的编程模型提供对这些数据的高吞吐量访问。

HDFS的主要组件包括:

- **NameNode**: NameNode是HDFS的主节点,负责管理文件系统的命名空间和客户端对文件的访问。它维护文件系统树及整棵树内的所有文件和目录。这些信息以两种形式存储在磁盘上:fsimage和编辑日志。fsimage是命名空间的持久化状态,而编辑日志记录了对文件系统所做更改的序列。NameNode并不存储实际的数据。

- **DataNode**: DataNode在集群中通常是一个节点一个,负责存储和检索块(blocks)级别的数据。用户数据不会在NameNode存储,而是在多个DataNode上分布式存储。DataNode负责处理文件系统客户端的读写请求,并且执行数据块的创建、删除和复制。

- **Secondary NameNode**: 它并不是NameNode的热备份。它的主要作用是定期合并fsimage和编辑日志,减少NameNode启动时加载的编辑日志数量。它不会替代发生故障的NameNode,也不会保证数据不丢失。

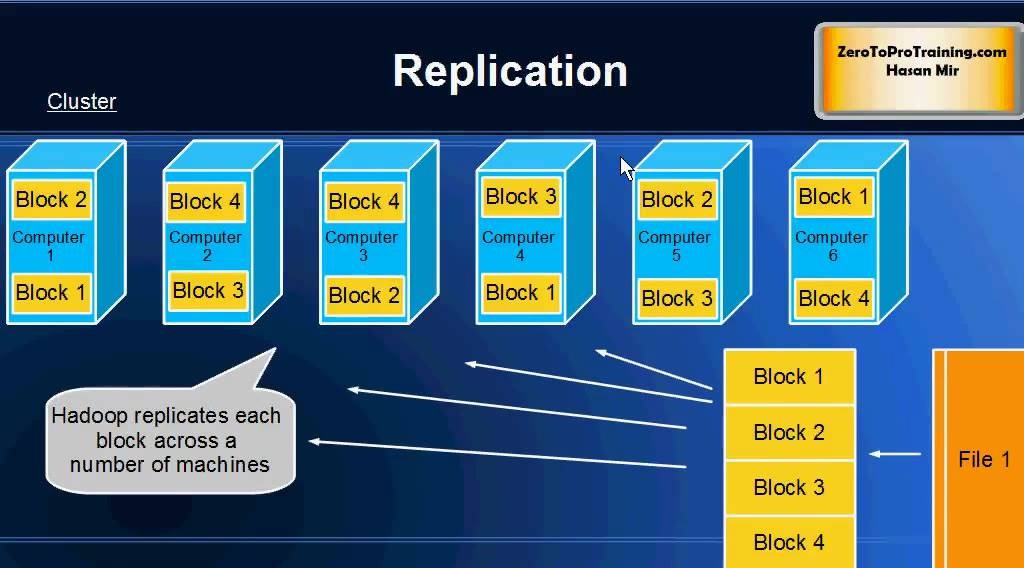

### 2.1.2 数据块的存储机制

在HDFS中,文件被切分成一系列的数据块(block),然后这些数据块分散存储在集群的各个DataNode中。这一设计有利于数据的并发处理和容错,因为多个客户端可以同时访问不同的数据块。HDFS的数据块大小默认是128MB(不同版本的Hadoop可能有所不同),但可以配置。数据块大小的选择对于系统的性能有很大影响。

大块的存储机制有以下优点:

- **减少NameNode的内存需求**:NameNode需要在内存中保存文件系统的元数据。如果数据块小,那么文件的数量会变大,进而导致需要更多的内存来存储元数据。

- **提高数据吞吐量**:对于大规模文件系统,大块存储可以减少寻址时间,提高数据的读写吞吐量。

- **降低NameNode的负载**:因为元数据信息更少,NameNode需要处理的指令就会减少,从而减少负载。

然而,数据块过大会带来一些挑战:

- **数据恢复时间增加**:当DataNode发生故障时,复制较大的数据块需要更长的时间。

- **数据浪费**:因为数据块需要按照设定的大小进行对齐存储,文件的尾部可能会形成小的未用块,造成空间浪费。

### 代码展示

一个简单的例子,展示了如何在Hadoop中使用Java API来访问HDFS文件系统:

```java

Configuration conf = new Configuration();

FileSystem fs = FileSystem.get(URI.create("hdfs://namenode:8020"), conf);

Path path = new Path("/user/hadoop/input.txt");

FSDataInputStream in = fs.open(path);

IOUtils.copyBytes(in, System.out, 4096, false);

in.close();

fs.close();

```

#### 代码逻辑分析

- `Configuration`类的实例`conf`代表了Hadoop的配置,这些配置可以来自于配置文件`hdfs-site.xml`、`core-site.xml`等,也可以是程序中直接设置的。

- `FileSystem.get(URI, Configuration)`方法通过指定的URI和配置信息返回一个FileSystem对象,这个对象是访问HDFS文件系统的接口。

- `Path`类的实例`path`代表了HDFS中的文件路径。

- `FSDataInputStream`是文件系统的数据输入流,用于读取HDFS上的数据。

- `IOUtils.copyBytes(InputStream, OutputStream, int, boolean)`方法将数据从输入流复制到输出流,这里复制的是文件内容到标准输出(控制台)。

- 最后,关闭`FSDataInputStream`和`FileSystem`对象以释放资源。

## 2.2 HDFS的数据操作实践

### 2.2.1 文件的创建、读取与写入

在HDFS中,数据的创建、读取和写入操作是基本操作,涉及多个步骤和组件之间的交互。下面详细说明这些操作的实现机制。

#### 文件创建

HDFS通过`FileSystem.create(Path f)`方法创建新文件。这个方法会先检查目标路径是否已存在,如果存在则抛出异常。如果不存在,它会在NameNode上为新文件创建一个新的记录,并在文件系统的命名空间中分配一个唯一的文件ID。然后,它会在一个DataNode上创建一个临时文件,并返回一个表示正在写入数据的输出流`FSDataOutputStream`。

#### 文件读取

读取HDFS文件首先需要通过`FileSystem.open(Path f)`方法获取`FSDataInputStream`,然后从这个输入流中读取数据。读取过程中,客户端会与NameNode交互,获取文件块的位置信息。对于每一个块,NameNode会返回一系列DataNode的信息。客户端读取数据块时,会直接与提供数据块的DataNode通信,这样NameNode就只负责管理信息,不涉及实际的数据传输。

#### 文件写入

在文件写入阶段,客户端首先通过`FileSystem.create(Path f)`创建文件并获得输出流`FSDataOutputStream`。数据首先写入本地临时文件中,然后经过缓冲区发送给DataNode。客户端写入数据时,它会将数据分成多个块,并在写满一个块后将块复制到多个DataNode上,以保证数据的冗余和可靠性。每个块都会被复制成多个副本来满足HDFS的冗余策略。

### 2.2.2 HDFS的数据一致性模型

HDFS遵循一种简单的写入一次(Write Once Read Many, WORM)的数据一致性模型。这种模型类似于传统数据库的快照隔离机制,意味着一旦数据被写入文件系统,它就不能被改变。

当写入操作完成时,数据块会立即变得对读取者可用,即使数据副本可能还没有完全复制到所有DataNode。HDFS使用版本控制和校验和机制来提供数据的一致性。如果在数据复制期间出现故障,HDFS会保证最终一致性,并在下一次读取时返回最新的一致数据块。

如果客户端需要修改已经存在的文件,HDFS并不支持直接覆盖。客户端必须先删除旧文件,然后创建一个新文件来完成“修改”。这种限制也是为了避免在分布式环境下的复杂性,并保持系统的高可用性和稳定性。

### 代码展示

以下代码演示了如何使用Hadoop的Java API来创建文件,写入数据,然后读取和追加数据到文件:

```java

Configuration conf = new Configuration();

FileSystem fs = FileSystem.get(URI.create("hdfs://namenode:8020"), conf);

Path path = new Path("/user/hadoop/newfile.txt");

// 创建文件

FSDataOutputStream out = fs.create(path, true);

// 写入数据到文件

out.write("Hello HDFS!".getBytes());

out.close();

// 读取文件数据

FSDataInputStream in = fs.open(path);

byte[] buffer = new byte[1024];

int length;

while ((length = in.read(buffer)) != -1) {

String data = new String(buffer, 0, length);

System.out.print(data);

}

in.close();

fs.close();

```

## 2.3 HDFS的容错机制和性能优化

### 2.3.1 NameNode与DataNode的高可用性策略

由于HDFS架构的单一NameNode设计,在发生故障时可能会导致系统部分或全部不可用。为了提高系统的高可用性,Hadoop社区推出了多种机制来增强NameNode的稳定性。

#### NameNode的高可用性配置

- **主备NameNode**: 在这种配置中,有两个NameNode,一个处于活动状态(主),另一个处于待命状态(备)。通过共享存储设备(如NFS、ZooKeeper、Quorum Journal Manager等)保持状态同步。当主NameNode发生故障时,备NameNode可以接管工作。

- **联邦NameNode**: 该策略增加了多个NameNode,每个NameNode管理文件系统的不同命名空间。这些NameNode之间不需要共享数据,每个NameNode负责一部分的元数据管理,因此可以扩展到更多的元数据。

#### DataNode的容错

- **数据复制**: HDFS默认将数据块复制为3份,分别存储在不同的DataNode上,以保证数据的可靠性。当一个DataNode发生故障时,可以从其他DataNode读取数据块的副本。

- **心跳机制**: DataNode会定期向NameNode发送心跳信号,表明它仍在运行。如果NameNode在配置的超时时间内没有收到某个DataNode的心跳信号,则会认为该DataNode已经宕机,并重新调度该节点上的数据块的复制。

### 2.3.2 HDFS的扩展性与性能优化技巧

HDFS的扩展性主要通过增加DataNode的数量来实现。当新节点加入集群时,NameNode会自动检测到新的DataNode,并将一些数据块的副本移动到这些新节点上,以保持数据分布的均衡。

性能优化可以从以下几个方面进行:

- **增加副本数量**: 在网络带宽足够的情况下,增加数据块的副本数量可以增加并行读取的机会,提高数据的读取性能。

- **优化数据块大小**: 更大的数据块可以减少元数据操作的次数,但会增加单次读写操作的延时。需要根据具体应用需求调整数据块大小。

- **提升NameNode的性能**: NameNode是HDFS的瓶颈,可以通过增

0

0