Python递归函数内存优化:尾递归与迭代替代的终极选择

发布时间: 2024-09-20 23:42:05 阅读量: 67 订阅数: 26

# 1. 递归函数与内存消耗

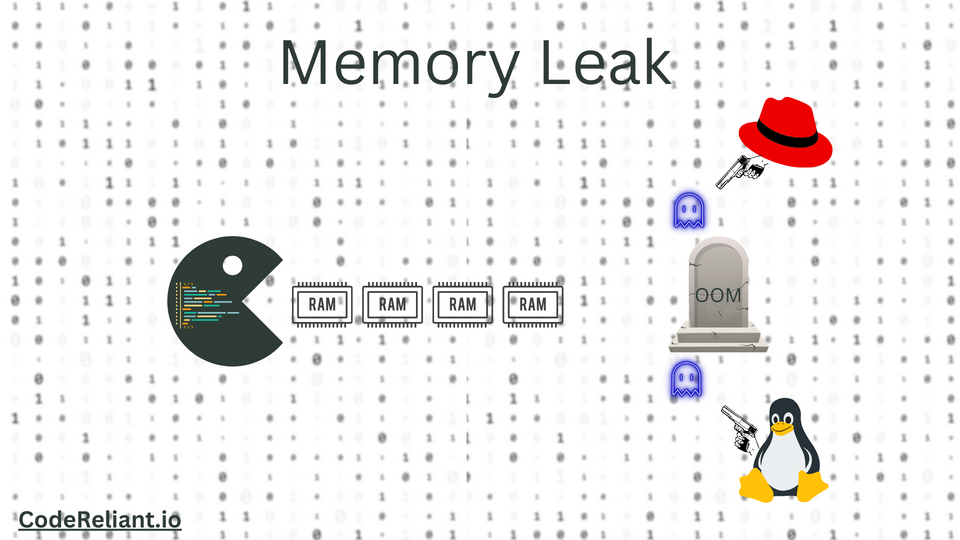

递归是编程中一种优雅而强大的技术,它允许函数调用自身以解决问题。然而,递归的每一个函数调用都会消耗额外的内存来存储其状态,因此随着递归深度的增加,内存消耗也会显著上升。本章将探讨递归函数在内存消耗方面的特点,并分析其对程序性能的影响。

## 1.1 递归函数的工作原理

递归函数通过将问题分解为更小的子问题来求解,每次函数调用自身都会创建一个新的堆栈帧来保存执行上下文。由于堆栈帧是有限的资源,因此大量的递归调用可能会导致栈溢出错误(stack overflow)。

```python

def recursive_function(n):

if n <= 1:

return 1

else:

return n * recursive_function(n - 1)

```

在上面的代码中,`recursive_function` 的每一个实例都占用一定的内存,特别是当 `n` 非常大时,递归深度增加,内存消耗也相应增大。

## 1.2 递归对内存的双重影响

递归函数不仅会因为堆栈帧的增加而消耗更多内存,还会因为需要保存中间结果而进一步增加内存需求。这在某些情况下可能导致性能显著下降,特别是在处理大量数据或深度递归的问题时。

为了更有效地利用内存并避免性能问题,理解和掌握递归函数的内存消耗特性是至关重要的。接下来的章节将深入探讨尾递归优化原理,以及如何通过迭代来减少内存消耗,提高程序的效率。

# 2. 尾递归优化原理与实现

## 2.1 尾递归的概念和作用

### 2.1.1 尾递归的定义和特点

在讨论尾递归之前,需要了解何为递归函数。递归函数是自己调用自己的函数,这种技术在处理具有自相似性质的问题时非常有效,如树的遍历、阶乘计算、汉诺塔问题等。

尾递归是递归函数中的一种特殊情况,它出现在函数的最后一个动作是递归调用的情形。在尾递归中,当前递归调用的结果直接返回,不进行任何额外操作。这意味着编译器或解释器可以进行优化,因为不需要保留当前的执行上下文以完成后续的返回操作。

尾递归的特点在于:

- 它是最简单的递归形式之一,因为递归调用是函数体中的最后一个表达式。

- 在尾递归中,由于不需要保存当前的执行状态,因此相对于普通递归来说,它具有潜在的内存使用优势。

### 2.1.2 尾递归与普通递归的对比

普通递归与尾递归在实现上最大的区别是函数调用后的处理方式。在普通递归中,函数完成递归调用后,可能还需要进行其他计算才能返回结果,这需要额外的栈空间来保存每次递归调用的状态。

相比之下,尾递归不需要额外的栈空间,因为当前的栈帧在完成递归调用后就可以被丢弃,新的调用可以复用这个栈帧。因此,尾递归相对于普通递归而言,是一种更为内存效率的递归形式,特别适合解决那些原本需要大量递归深度的问题。

在代码结构上,尾递归通常需要额外的参数来累积结果,这称为累加器。累加器的作用是将每次递归计算的结果即时传递到下一次递归中,这样最终的结果可以直接返回,而不需要返回到上一层的调用中。

## 2.2 尾递归的编程实践

### 2.2.1 尾递归的代码结构分析

在编写尾递归函数时,需要仔细考虑如何将问题映射为一个累加器模式,其中累加器用于保持状态并逐步构建最终结果。

以计算阶乘为例,普通递归的实现可能如下所示:

```python

def factorial(n):

if n == 0:

return 1

else:

return n * factorial(n-1)

```

而尾递归实现则需要一个额外的参数来累积结果:

```python

def factorial_tail_recursive(n, accumulator=1):

if n == 0:

return accumulator

else:

return factorial_tail_recursive(n-1, accumulator * n)

```

在上述尾递归实现中,第二个参数`accumulator`从一开始的值为1开始,每次递归调用都会与`n`相乘,并在最后作为结果返回。

### 2.2.2 尾递归的Python实现技巧

Python并不原生支持尾递归优化。这使得在Python中利用尾递归的内存效率优势变得比较困难。尽管如此,了解尾递归的实现技巧对于在那些支持尾递归优化的语言中编写高效代码是有帮助的。

要在Python中尽可能模拟尾递归的效果,可以使用迭代的技巧。通过一个循环代替递归,可以避免栈的不断增长。比如,利用一个循环来代替阶乘的尾递归实现:

```python

def factorial_iterative(n):

result = 1

for i in range(1, n+1):

result *= i

return result

```

在其他支持尾递归优化的语言中(如Scala),尾递归会自动被编译器优化。优化后的代码将不会增加栈的深度,而只是简单地更新参数并跳回到函数的顶部。

## 2.3 尾递归优化的限制与挑战

### 2.3.1 Python解释器对尾递归的支持现状

在Python中,尾递归优化并没有得到语言层面的支持,因为Python解释器并不自动地实施这种优化。这意味着即使你的递归函数是尾递归风格的,Python仍会随着递归调用的深度增加而消耗更多的内存。

这主要是因为Python设计之初并没有考虑到性能优化的需求。然而,这种设计理念为Python带来了极高的开发效率和易读性,对于大多数应用来说,这种权衡是可接受的。

### 2.3.2 克服尾递归优化限制的方法

由于Python不支持尾递归优化,开发者在处理递归问题时需要采取一些替代策略。一种方法是使用迭代替代递归。在许多情况下,迭代可以实现与尾递归相似的效果,但使用的是循环结构,这不会有额外的函数调用开销。

另一种方法是使用装饰器模式。对于一些特定类型的尾递归函数,例如树的遍历,可以设计一个装饰器来手动管理递归的栈帧,并用一个显式的栈来模拟递归调用,这在某些情况下可以实现尾递归优化的效果。

例如,下面的装饰器模拟了一个简单的尾递归调用:

```python

def tail_recursion_optimized(func):

def wrapper(*args, **kwargs):

def helper(*args, **kwargs):

return helper

return helper

return wrapper

```

通过这种方式,开发者可以在Python中模拟尾递归优化,尽管这需要更多的工作和对问题结构的深入理解。

# 3. ```

# 第三章:迭代替代策略与效率

## 3.1 迭代方法的基本原理

### 3.1.1 迭代与递归的关系

迭代与递归是两种常见的算法实现方式。迭代是利用重复的过程来解决问题,通常通过循环结构(如for或while循环)来实现。而递归则是一种通过函数自我调用来解决问题的方法。在许多情况下,递归算法可以通过重写为

```

0

0