图神经网络:图数据挖掘与深度学习结合

发布时间: 2024-05-02 08:02:16 阅读量: 128 订阅数: 48

java+sql server项目之科帮网计算机配件报价系统源代码.zip

# 1. 图神经网络基础**

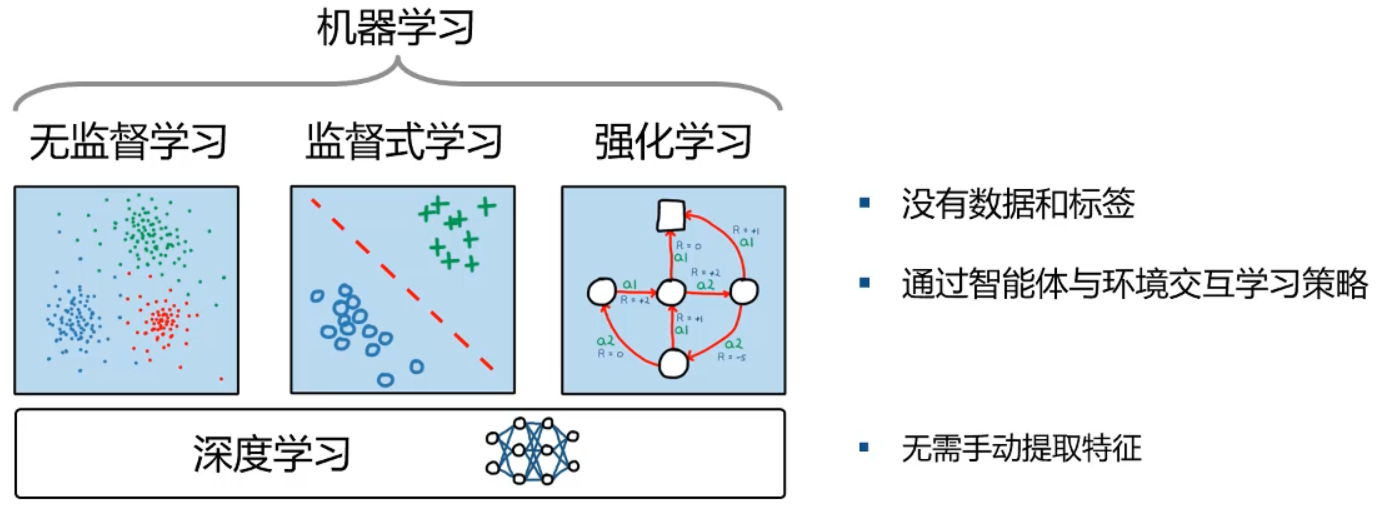

图神经网络(GNN)是深度学习和图数据挖掘相结合的产物,用于处理图结构数据。GNN通过将图结构信息嵌入到神经网络模型中,实现对图数据的表示学习和处理。

图神经网络的基本原理是将图结构表示为邻接矩阵或图拉普拉斯矩阵,并使用神经网络层对图结构信息进行聚合和更新。通过多层神经网络的叠加,GNN可以学习到图中节点和边的特征表示,并用于各种图数据挖掘任务,如节点分类、边缘预测、图生成等。

# 2. 图神经网络模型

图神经网络(GNN)模型旨在处理图结构数据,它通过在图上传播信息来学习图中节点和边的表示。GNN模型主要分为两大类:图卷积神经网络(GCN)和图注意力网络(GAT)。

### 2.1 图卷积神经网络

图卷积神经网络(GCN)是GNN模型中最基本的一种,它将卷积神经网络(CNN)的思想应用到图数据上。GCN通过在图上执行卷积操作来学习节点的表示,其中卷积操作考虑了节点的邻居信息。

#### 2.1.1 图卷积层

图卷积层是GCN的基本组成部分,它执行以下操作:

```python

H^{(l+1)} = \sigma(D^{-\frac{1}{2}} A D^{-\frac{1}{2}} H^{(l)} W^{(l)})

```

其中:

* `H^{(l)}`是第`l`层的节点表示矩阵

* `A`是图的邻接矩阵

* `D`是对角矩阵,其对角线元素为`A`的度矩阵

* `W^{(l)}`是第`l`层的权重矩阵

* `\sigma`是非线性激活函数

图卷积层通过将节点的表示与邻居的表示进行加权求和来计算新的节点表示。其中,`D^{-\frac{1}{2}} A D^{-\frac{1}{2}}`项对图进行归一化,以确保不同大小的图上的卷积操作具有可比性。

#### 2.1.2 图池化层

图池化层用于将图中节点的数量减少到更小的集合。GCN中常用的池化方法包括:

* **最大池化:**选择每个节点邻居中表示最大的节点作为新的节点表示。

* **平均池化:**对每个节点的邻居表示进行平均,得到新的节点表示。

* **图注意力池化:**使用注意力机制来分配每个节点邻居的权重,然后对邻居表示进行加权求和,得到新的节点表示。

### 2.2 图注意力网络

图注意力网络(GAT)是另一种GNN模型,它通过使用注意力机制来学习节点表示。GAT通过计算节点对之间的相似度,然后对邻居的表示进行加权求和,得到新的节点表示。

#### 2.2.1 自注意力机制

自注意力机制是一种注意力机制,它计算节点与其自身之间的相似度。在GAT中,自注意力机制可以用于学习节点的自我重要性,并将其融入到新的节点表示中。

#### 2.2.2 异质注意力机制

异质注意力机制是一种注意力机制,它计算不同类型节点对之间的相似度。在GAT中,异质注意力机制可以用于学习不同类型节点之间的关系,并将其融入到新的节点表示中。

# 3.1 节点分类

节点分类任务的目标是预测图中每个节点的类别标签。图神经网络在节点分类任务中表现出了卓越的性能,因为它能够有效地捕获图中节点的局部和全局特征。

#### 3.1.1 图卷积神经网络应用

图卷积神经网络(GCN)是图神经网络中用于节点分类的常见模型。GCN通过在图上执行卷积操作来聚合节点的特征。具体来说,GCN的第 l 层的卷积操作可以表示为:

```python

H^{(l)} = \sigma(\tilde{D}^{-\frac{1}{2}} \tilde{A} \tilde{D}^{-\frac{1}{2}} H^{(l-1)} W^{(l)})

```

其中,H^{(l)}表示第 l 层的节点特征矩阵,A是图的邻接矩阵,D是度矩阵,W^{(l)}是权重矩阵,σ是激活函数。

GCN通过堆叠多个卷积层来提取图中节点的特征。在每个卷积层中,GCN聚合节点的局部特征,并通过非线性激活函数进行转换。通过这种方式,GCN能够学习到图中节点的复杂特征表示。

#### 3.1.2 图注意力网络应用

图注意力网络(GAT)是另一种用于节点分类的图神经网络模型。GAT通过在图上执行注意力机制来聚合节点的特征。具体来说,GAT的第 l 层的注意力机制可以表示为:

```python

a_{ij}^{(l)} = \frac{\exp(f(h_i^{(l-1)}, h_j^{(l-1)})}{\sum_{k \in N(i)} \exp(f(h_i^{(l-1)}, h_k^{(l-1)})}

```

其中,a_{ij}^{(l)}表示节点 i 和节点 j 之间的注意力权重,h_i^{(l-1)}和h_j^{(l-1)}表示节点 i 和节点 j 的第 l-1 层的特征向量,f是注意力函数,N(i)表示节点 i 的邻居节点集合。

GAT通过注意力机制对节点的邻居节点进行加权聚合。注意力权重衡量了邻居节点对中心节点的重要性。通过这种方式,GAT能够学习到图中节点的更细粒度的特征表示。

# 4. 图神经网络实践**

**4.1 图神经网络框架**

图神经网络的实现需要依赖于专门的框架,这些框架提供了图数据处理、图神经网络模型构建和训练的工具。目前,业界比较流行的图神经网络框架包括:

**4.1.1 PyTorch Geometric**

PyT

0

0