构建个性化解析器:扩展BeautifulSoup的强大功能

发布时间: 2024-09-30 23:03:49 阅读量: 28 订阅数: 44

# 1. BeautifulSoup库简介与安装

## 简介

BeautifulSoup是一个Python库,用来解析HTML和XML文档。它提供简单而强大的方法来提取数据和转换文档结构。BeautifulSoup可以处理不规则或者不完整的HTML,并且易于使用。开发者经常用它来进行网页数据抓取和分析网页内容。

## 安装步骤

对于Python环境,安装BeautifulSoup库非常简单,可以通过pip这个包管理器来完成。在命令行中输入以下命令即可安装最新版本的BeautifulSoup:

```bash

pip install beautifulsoup4

```

同时,BeautifulSoup还需要一个解析器。常用的解析器有`html.parser`, `lxml`等,其中`lxml`由于其优秀的性能和速度被广泛使用。推荐使用`lxml`,安装方法如下:

```bash

pip install lxml

```

安装完成后,就可以在Python脚本中导入BeautifulSoup,并开始解析HTML文档了。以下是一个简单的示例代码:

```python

from bs4 import BeautifulSoup

html_doc = """

<html><head><title>The Dormouse's story</title></head>

<p class="title"><b>The Dormouse's story</b></p>

<p class="story">Once upon a time there were three little sisters; and their names were

<a href="***" class="sister" id="link1">Elsie</a>,

<a href="***" class="sister" id="link2">Lacie</a> and

<a href="***" class="sister" id="link3">Tillie</a>;

and they lived at the bottom of a well.</p>

<p class="story">...</p>

soup = BeautifulSoup(html_doc, 'lxml')

print(soup.prettify())

```

通过以上步骤,你已经可以开始使用BeautifulSoup来解析HTML文档了。在后续章节中,我们将深入了解BeautifulSoup的强大功能和使用技巧。

# 2. BeautifulSoup的核心解析机制

## 2.1 BeautifulSoup标签和树结构解析

### 2.1.1 标签的选择与查找

在解析HTML或XML文档时,BeautifulSoup库为我们提供了多种方式来选择和查找文档中的标签。`find()`和`find_all()`是最常用的两个方法,它们允许我们根据标签名、属性、内容等条件来定位标签。使用`find()`方法可以获取第一个匹配的标签,而`find_all()`则返回所有匹配的标签列表。

```python

from bs4 import BeautifulSoup

html_doc = """

<html><head><title>The Dormouse's story</title></head>

<body>

<p class="title"><b>The Dormouse's story</b></p>

<a href="***" id="link1">Link 1</a>

<a href="***" id="link2">Link 2</a>

<a href="***" id="link3">Link 3</a>

<a href="***">Link 4</a>

</body>

</html>

soup = BeautifulSoup(html_doc, 'html.parser')

# 查找所有的<a>标签

all_links = soup.find_all('a')

for link in all_links:

print(link.text) # 打印链接的文本

# 查找具有特定id属性的<a>标签

specific_link = soup.find('a', id='link2')

print(specific_link.text) # 打印该链接的文本

```

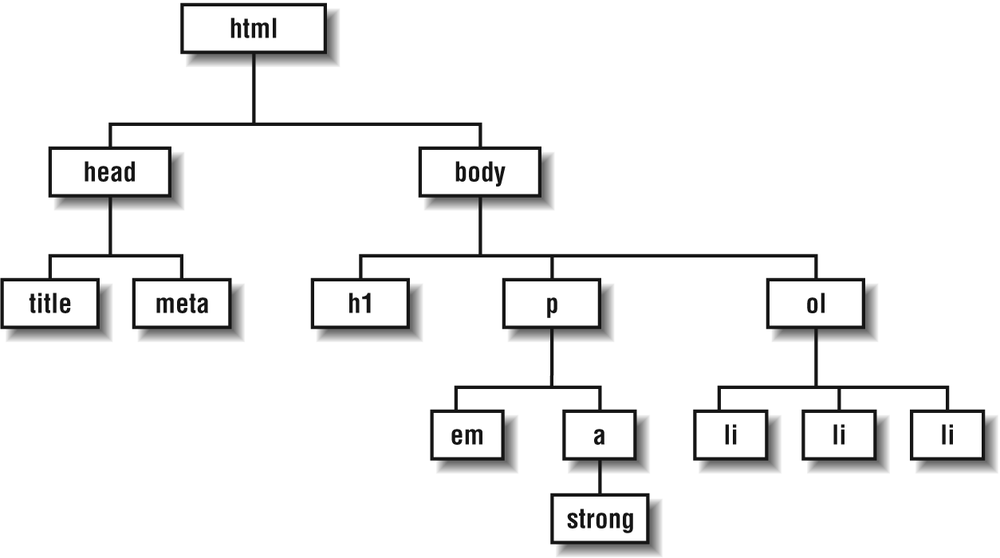

### 2.1.2 树结构的遍历和搜索

BeautifulSoup通过标签的嵌套关系构成了文档的树结构。在解析文档时,我们可以对树结构进行遍历,以更精确地定位和访问元素。通过`.contents`和`.children`属性可以遍历标签的直接子元素,而`.find()`和`.find_all()`则可以搜索整个树。

```python

# 遍历<b>标签的直接子元素

title_tag = soup.find('p', class_='title')

for child in title_tag.children:

print(child) # 打印<b>标签内的所有子元素

# 搜索具有特定文本的<a>标签

for a_tag in soup.find_all('a'):

if 'Link' in a_tag.text:

print(a_tag['href']) # 打印文本中包含"Link"的<a>标签的href属性值

```

## 2.2 解析文档类型的选择

### 2.2.1 解析HTML与XML文档的差异

BeautifulSoup不仅可以解析HTML文档,还可以解析XML文档。不过,HTML和XML之间存在一些差异,比如HTML更宽容于不严格的标签格式,而XML则要求严格的格式。在使用BeautifulSoup进行解析时,选择合适的解析器非常重要,不同的解析器可能会影响解析结果。

### 2.2.2 解析器的性能对比

不同的解析器处理速度和资源消耗是不同的。比如,`lxml`解析器的速度要比Python内置的HTML和XML解析器快很多,但是`lxml`需要额外安装库。在选择解析器时,需要根据项目的具体需求来权衡性能和资源消耗。

```python

# 使用不同的解析器来解析同一HTML文档

from bs4 import BeautifulSoup, Comment

import time

html_doc = """

<html><head><title>Test</title></head>

<body>

<!-- This is a comment -->

<p>Some text.</p>

</body>

</html>

start_time = time.time()

soup_html = BeautifulSoup(html_doc, 'html.parser')

print("HTML parser time:", time.time() - start_time)

start_time = time.time()

soup_lxml = BeautifulSoup(html_doc, 'lxml')

print("LXML parser time:", time.time() - start_time)

```

## 2.3 处理异常与错误

### 2.3.1 错误处理机制

在解析过程中,可能会遇到格式错误的HTML或XML文档。BeautifulSoup提供了异常处理机制来帮助我们优雅地处理这些错误。例如,`BeautifulSoup`构造函数中的`disableBrokenXMLRemoval`参数可以控制是否移除格式错误的XML内容。

### 2.3.2 自定义解析规则和解析错误

如果内置的解析规则不满足需求,我们还可以自定义解析规则。这允许我们对文档中的特定元素或者结构做出定制化的处理。例如,我们可以编写一个自定义的解析函数来处理HTML文档中的脚本标签。

```python

# 定义一个自定义解析函数来处理<script>标签

from bs4.element import Comment

def strip_script_tags(tag):

if tag.name == "script":

return None

elif tag.name == "style":

return None

elif tag.name == "link":

return None

elif tag.name == "head":

return None

elif tag.name == "body":

return None

elif tag.name == "title":

return None

elif tag.name == "html":

return None

elif tag.name == "meta":

return None

elif tag.name == "link":

return None

elif tag.name == "div" and tag.parent.name == "head":

return None

elif tag.name == "link" and tag.parent.name == "head":

return None

elif isinstance(tag, Comment):

return None

else:

return tag

soup = BeautifulSoup(html_doc, 'html.parser', parse_only=strip_script_tags)

for script in soup.find_all('script'):

print(script.name) # 打印被移除的<script>标签数量

```

以上代码段展示了如何在解析HTML文档时忽略所有的`<script>`和`<style>`标签。通过修改解析规则,可以有效地控制输出的文档结构,使其更加符合特定的需求。

# 3. 扩展BeautifulSoup功能的实践技巧

随着数据驱动的项目日益增长,对BeautifulSoup库的深度使用和功能拓展变得日益重要。本章将探讨如何使用插件增强BeautifulSoup的解析能力,构建自定义解析器,以及进行性能优化和错误处理。

## 3.1 使用插件增强解析能力

在复杂的网页结构面前,

0

0