动态内容不再难:BeautifulSoup的动态网页数据提取技术

发布时间: 2024-09-30 22:46:48 阅读量: 57 订阅数: 44

Python爬虫技术:使用BeautifulSoup与Scrapy进行网页抓取

# 1. 动态网页数据提取概述

在当代互联网应用中,动态网页技术(如AJAX与JavaScript)已成为网页内容生成的主流方式。与静态网页相比,动态网页能够根据用户交互或特定条件实时更新页面内容,给数据提取带来了挑战。动态内容的提取不仅要求开发者掌握HTTP请求和响应机制,还需要理解JavaScript在客户端渲染过程中扮演的角色。本章旨在为读者提供动态网页数据提取的入门知识,让读者理解其背后的原理与常见挑战,并为接下来深入学习库和技术打下坚实的基础。

# 2. BeautifulSoup库的基础知识

## 2.1 Beautiful Soup库的安装与配置

### 2.1.1 安装BeautifulSoup的方法

BeautifulSoup是一个Python库,用于解析HTML和XML文档。它是用Python编写的,并且可以和多种解析器一起使用,包括`lxml`、`html.parser`和`html5lib`。安装BeautifulSoup可以通过Python包管理工具`pip`来完成。在命令行中,执行以下命令即可安装最新版本的BeautifulSoup:

```bash

pip install beautifulsoup4

```

需要注意的是,`beautifulsoup4`库与`bs4`作为包名。大多数情况下,如果你安装的是标准的Python库,那么使用`pip`命令默认安装的是`beautifulsoup4`版本。如果你需要安装对应解析器,如`lxml`,可以使用:

```bash

pip install lxml

```

### 2.1.2 配置BeautifulSoup环境

安装完成之后,可以使用`import`语句将其导入Python环境中。为方便起见,通常导入时使用别名`bs`:

```python

import beautifulsoup4 as bs

```

对于不同的解析器,使用时需要在创建BeautifulSoup实例时进行指定。如使用`lxml`作为解析器:

```python

soup = bs.BeautifulSoup(html_content, 'lxml')

```

除了`lxml`之外,也可以使用`html.parser`(Python内置的解析器),或者`html5lib`(一个更为严格的解析器,符合HTML5标准):

```python

from bs4 import BeautifulSoup

soup_html_parser = BeautifulSoup(html_content, 'html.parser')

soup_html5lib = BeautifulSoup(html_content, 'html5lib')

```

不同的解析器在解析速度和容错性上有所不同。`lxml`非常快速且强大,但在某些情况下可能过于严格,导致无法解析一些不规范的HTML文档。`html.parser`是Python自带的解析器,虽然稍慢一些,但不需要额外安装。`html5lib`则能够更好地处理现代Web页面,尤其是那些包含复杂嵌入式内容的页面,例如在`<div>`标签中使用`<script>`标签插入JavaScript代码的情况。

## 2.2 Beautiful Soup的解析技术

### 2.2.1 解析HTML/XML文档结构

BeautifulSoup提供了一系列方法和属性,用于导航、搜索和修改解析树,使得文档遍历变得简单。它可以将HTML文档转换成一个复杂的树形结构,每个节点都是Python对象,所有对象可以归纳为四种类型:标签、NavigableString、BeautifulSoup和Comment。

通过`find()`和`find_all()`等方法,可以轻松地在文档树中查找特定的标签或数据。例如,查找所有的`<a>`标签:

```python

soup = BeautifulSoup(html_doc, 'html.parser')

links = soup.find_all('a')

```

### 2.2.2 选择器的使用与优势

选择器是BeautifulSoup的精髓所在。它们允许你根据标签的ID、类名、属性等来查找特定的元素。BeautifulSoup支持CSS1到CSS3的选择器,使用起来与jQuery类似,这使得开发者可以非常方便地定位需要的数据。以下是几种常用的选择器:

- ID选择器:`#element_id`

- 类选择器:`.class_name`

- 属性选择器:`[attribute='value']`

例如,要找到id为`main`的元素:

```python

main_element = soup.find(id="main")

```

或者找到所有具有`item`类的`<div>`元素:

```python

items = soup.find_all("div", class_="item")

```

### 2.2.3 搜索树结构的方法

BeautifulSoup支持多种搜索树结构的方法,包括但不限于:

- `find()`: 查找单个元素

- `find_all()`: 查找所有匹配的元素

- `find_parents()` 和 `find_parent()`: 查找父元素

- `find_next_siblings()` 和 `find_next_sibling()`: 查找之后的兄弟元素

- `find_previous_siblings()` 和 `find_previous_sibling()`: 查找之前的兄弟元素

- `contents`: 获取文档的直接子节点列表

- `children`: 遍历元素的直接子节点

- `descendants`: 遍历所有子孙节点

通过上述方法,可以有效地遍历整个文档结构,找到所需的数据。例如,遍历一个表格,获取所有的行:

```python

table = soup.find('table')

for row in table.find_all('tr'):

cells = row.find_all(['th', 'td'])

print(cells)

```

## 2.3 Beautiful Soup与网络请求

### 2.3.1 结合requests库进行网络请求

虽然BeautifulSoup专门用于解析HTML和XML文档,但它需要源HTML作为输入。因此,通常会与`requests`库结合使用来完成网络请求。`requests`是一个非常流行的HTTP库,可以用来发送各种HTTP请求。

首先安装`requests`库:

```bash

pip install requests

```

然后,结合`requests`库和BeautifulSoup可以这样使用:

```python

import requests

from bs4 import BeautifulSoup

# 发送GET请求获取HTML内容

response = requests.get("***")

html_doc = response.text

# 使用BeautifulSoup解析HTML内容

soup = BeautifulSoup(html_doc, 'html.parser')

# 之后可以使用soup进行所需的数据提取

```

### 2.3.2 处理会话和Cookies

有时网站需要在多个请求之间保持状态,如登录会话。这时可以使用`requests`的`Session`对象来维持会话:

```python

from requests import Session

with Session() as s:

# 在一个会话中发送请求

s.get("***")

s.post("***", data={'username':'user', 'password':'pass'})

# 发送更多请求...

```

当处理需要Cookies的网站时,可以使用`session.cookies`来管理Cookies:

```python

# 获取当前会话中的Cookies

print(s.cookies)

# 设置Cookies

s.cookies.set('key', 'value')

# 如果需要处理响应时维护Cookies,也可以直接在请求中设置

response = s.get("***", cookies={'key':'value'})

```

### 2.3.3 避免爬虫被封禁的策略

网络爬虫如果行为不当,很容易被网站封禁。为了避免这种情况,应该采取一些策略:

- 限制爬虫的抓取速率,使用`time.sleep()`函数,或者`requests`的`pause`参数(`requests-futures`库)。

- 使用合理的请求头(User-Agent、Referer等),模拟浏览器访问。

- 处理异常和错误,避免由于请求失败而重试导致的资源浪费和潜在封禁。

- 尊重robots.txt文件的规则,不要爬取禁止爬取的内容。

- 可以使用代理服务器轮换IP地址。

```python

# 使用会话对象来保持Cookies,并控制请求间隔

with Session() as s:

for url in url_list:

response = s.get(url, headers={'User-Agent': 'Mozilla/5.0'})

# 处理响应...

time.sleep(1) # 间隔一秒

```

以上内容介绍了BeautifulSoup库的基础知识,包括安装配置、解析技术、与网络请求的结合方法以及避免被封禁的策略。这些是使用BeautifulSoup进行网页数据提取时必须掌握的基础技能。

# 3. 动态内容提取的技术原理

动态网页内容的提取是现代网络爬虫技术中的一个复杂环节,因为它涉及到对JavaScript渲染页面的深入理解和相应技术的应用。本章将探讨动态内容的生成机制、面临的挑战以及实际操作中的应对策略。

## 3.1 动态网页生成机制

### 3.1.1 JavaScript渲染页面的原理

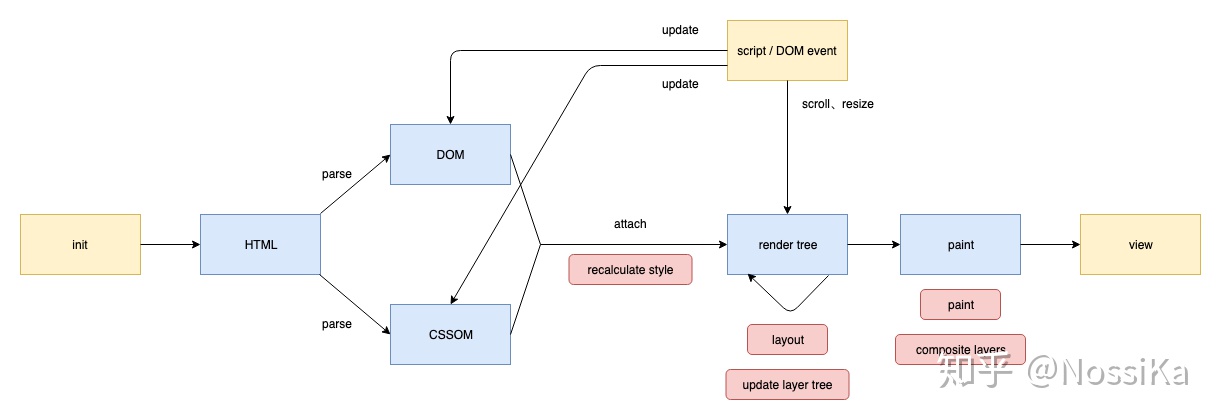

动态网页经常利用JavaScript来实现页面内容的动态渲染。这种技术的核心在于,页面的HTML初始结构通常在服务器端生成,但关键的内容或布局调整则是在客户端执行JavaScript代码后完成的。这意味着传统的静态页面爬虫无

0

0