BP神经网络过拟合问题:深入分析与彻底解决方案

发布时间: 2024-06-14 08:41:13 阅读量: 297 订阅数: 45

# 1. BP神经网络概述

BP神经网络(反向传播神经网络)是一种多层前馈神经网络,广泛应用于模式识别、图像处理和自然语言处理等领域。其基本原理是通过输入层、隐含层和输出层之间的连接权重,通过反向传播算法不断调整权重,使网络输出与期望输出之间的误差最小化。

BP神经网络具有强大的非线性映射能力,能够学习复杂的数据模式。其结构通常包括:输入层、一个或多个隐含层和输出层。输入层接收输入数据,隐含层处理输入数据并提取特征,输出层产生最终输出。

# 2. BP神经网络过拟合问题

### 2.1 过拟合的成因分析

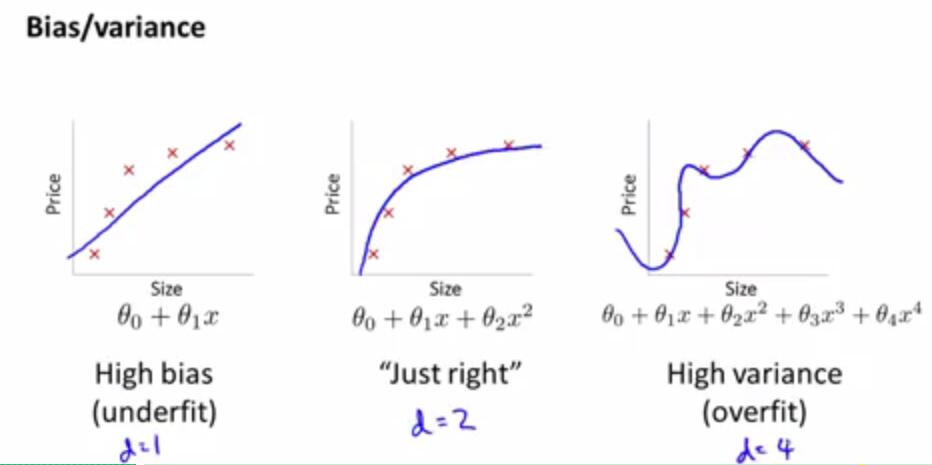

BP神经网络过拟合问题是指模型在训练数据集上表现良好,但在未知测试数据集上泛化能力差,出现预测准确率低的情况。过拟合的成因主要可以从以下三个方面分析:

#### 2.1.1 数据集特征

* **数据量不足:**训练数据量过少,无法充分代表问题的复杂性,导致模型无法学习到数据的真实规律。

* **数据分布不均衡:**训练数据中不同类别的样本分布不均衡,容易导致模型偏向于某一类别,从而忽略其他类别的特征。

* **数据噪声:**训练数据中存在噪声或异常值,会干扰模型的学习过程,导致模型对噪声敏感,无法提取数据的真实特征。

#### 2.1.2 网络结构和参数

* **网络结构过复杂:**网络层数和节点数过多,导致模型参数数量庞大,容易出现过拟合。

* **权重初始化不当:**权重初始化的值过大或过小,会影响模型的收敛速度和泛化能力。

* **学习率过高:**学习率过高会导致模型在训练过程中更新参数过快,容易跳过最优解,导致过拟合。

#### 2.1.3 训练过程

* **训练次数过多:**训练次数过多会导致模型在训练数据集上不断优化,最终过度拟合训练数据,忽略测试数据集的泛化能力。

* **训练数据顺序不当:**训练数据顺序不当,例如按类别顺序排列,会影响模型对不同类别的学习效果,导致过拟合。

* **批次大小不合适:**批次大小过大或过小都会影响模型的收敛速度和泛化能力。

### 2.2 过拟合的检测方法

#### 2.2.1 训练集和测试集误差对比

最直观的过拟合检测方法是比较训练集和测试集上的误差。如果训练集误差远低于测试集误差,则表明模型存在过拟合问题。

#### 2.2.2 正则化项引入

正则化项可以惩罚模型的复杂度,从而抑制过拟合。如果引入正则化项后,模型的测试集误差降低,则表明存在过拟合问题。

#### 2.2.3 交叉验证

交叉验证是一种评估模型泛化能力的有效方法。将训练数据划分为多个子集,依次使用每个子集作为测试集,其他子集作为训练集。如果交叉验证的平均误差较高,则表明模型存在过拟合问题。

# 3.1 数据增强与正则化

#### 3.1.1 数据增强方法

数据增强是一种通过对原始数据进行变换和扩充,生成更多样化数据集的技术。它可以有效缓解过拟合问题,因为扩充后的数据集包含了更丰富的特征信息,从而使模型能够更好地泛化到未见数据。

常用的数据增强方法包括:

- **随机旋转和翻转:**对图像进行随机旋转和翻转,可以增加图像的多样性,防止模型对特定方向或角度的过拟合。

- **随机裁剪:**从图像中随机裁剪不同大小和位置的区域,可以增强模型对图像局部特征的识别能力。

- **随机缩放:**对图像进行随机缩放,可以改变图像的大小和比例,防止模型对特定尺寸的过拟合。

- **添加噪声:**在图像中添加随机噪声,可以模拟真实世界中的数据噪声,提高模型的鲁棒性。

- **颜色抖动:**对图像的亮度、对比度和饱和度进行随机调整,可以增强模型对颜色变化的泛化能力。

#### 3.1.2 正则化方法

正则化是一种通过在损

0

0