BP神经网络收敛性分析:揭开网络训练过程的神秘面纱

发布时间: 2024-06-14 08:43:27 阅读量: 103 订阅数: 45

# 1. BP神经网络简介**

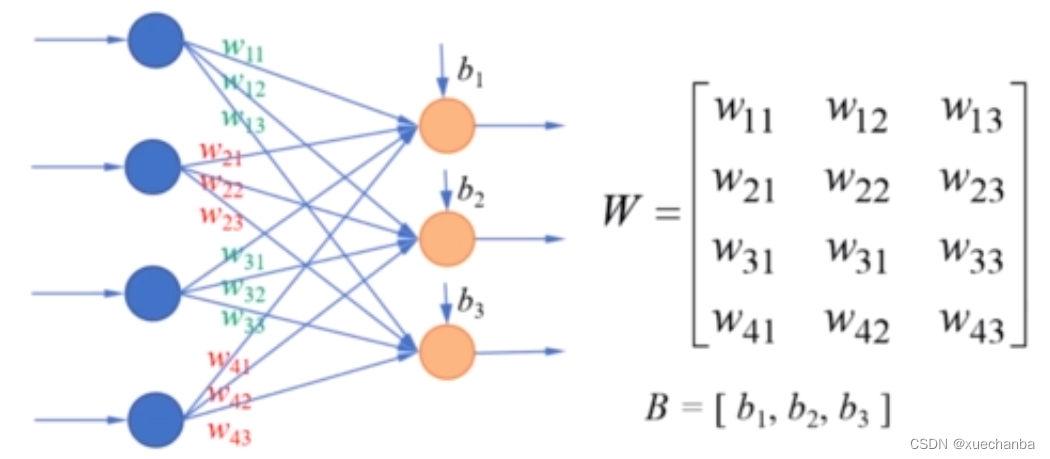

BP神经网络(又称反向传播神经网络)是一种多层前馈神经网络,因其在解决复杂非线性问题中的有效性而闻名。它由输入层、隐含层和输出层组成,其中隐含层可以有多个。

BP神经网络的工作原理是通过误差反向传播算法来调整网络权重。该算法首先将输入数据正向传播至输出层,计算输出与期望输出之间的误差。然后,将误差反向传播回网络,并根据误差值调整权重。这个过程不断重复,直到误差达到预设的阈值或训练次数达到预设值。

# 2. BP神经网络收敛性理论**

### 2.1 收敛性条件

BP神经网络的收敛性受多种因素影响,主要包括:

- **学习率(α):**控制权值更新的步长。较大的学习率可能导致网络不稳定,而较小的学习率可能导致收敛速度缓慢。

- **动量因子(β):**用于平滑权值更新,防止网络陷入局部极小值。

- **激活函数:**非线性激活函数(如ReLU、Sigmoid)引入非线性,使网络能够学习复杂关系。

### 2.2 收敛性证明

BP神经网络的收敛性可以从两个方面证明:

#### 2.2.1 梯度下降法

BP神经网络使用梯度下降法来最小化损失函数。梯度下降法通过沿着负梯度方向更新权值,逐步接近局部极小值。

#### 2.2.2 误差反向传播算法

误差反向传播算法计算损失函数的梯度,并将其反向传播到网络中。通过更新权值来减少损失函数,网络逐步收敛到局部极小值。

### 代码示例

考虑一个简单的两层BP神经网络,其中输入层有2个节点,隐含层有3个节点,输出层有1个节点。网络的损失函数为均方误差(MSE):

```python

import numpy as np

# 定义网络参数

input_nodes = 2

hidden_nodes = 3

output_nodes = 1

learning_rate = 0.1

momentum_factor = 0.9

# 随机初始化权值

weights_ih = np.random.randn(hidden_nodes, input_nodes)

weights_ho = np.random.randn(output_nodes, hidden_nodes)

# 训练数据

X = np.array([[0, 0], [0, 1], [1, 0], [1, 1]])

y = np.array([0, 1, 1, 0])

# 训练网络

for epoch in range(1000):

# 前向传播

hidden_activations = np.dot(X, weights_ih)

hidden_outputs = np.maximum(0, hidden_activations) # ReLU激活函数

output_activations = np.dot(hidden_outputs, weights_ho)

output = output_activations

# 计算误差

error = y - output

# 反向传播

output_gradient = -2 * error

hidden_gradient = np.dot(output_gradient, weights_ho.T) * (hidden_activations > 0) # ReLU激活函数的梯度

weights_ho -= learning_rate * np.dot(output_gradient, hidden_outputs.T) + momentum_factor * weights_ho

weights_ih -= learning_rate * np.dot(hidden_gradient, X.T) + momentum_factor * weights_ih

# 评估网络

print("训练后的权值:")

print(weights_ih)

print(weights_ho)

```

**逻辑分析:**

- 网络使用ReLU激活函数,将其梯度设置为0,以避免权值更新中的梯度消失。

- 动量因子用于平滑权值更新,防止网络陷入局部极小值。

- 训练过程通过梯度下降法和误差反向传播算法最小化损失函数。

# 3.1 训练数据集选择

训练数据集是影响BP神经网络收敛性的关键因素之一。一个好的训练数据集应该具有以下特征:

- **代表性:**训练数据集应能充分代表问题域,包含各种可能遇到的输入和输出模式。

- **多样性:**训练数据集应具有多样性,避免出现重复或相似的样本,以防止网络过拟合。

- **无噪声:**训练数据集应尽量无噪声,避免引入不必要的干扰,影响网络的学习过程。

### 3.2 网络结构设

0

0