【MATLAB机器学习应用探索】:优化算法助力AI突破

发布时间: 2024-08-30 23:17:33 阅读量: 112 订阅数: 41

MATLAB人工智能算法解析与应用.docx

# 1. MATLAB机器学习概述

机器学习是人工智能领域的一个重要分支,其核心目标是让计算机能够自主学习和做出决策。MATLAB,作为一种高级的数值计算和可视化软件,为机器学习提供了一系列工具箱和函数,使得开发者能够更便捷地处理复杂数据和算法。

MATLAB不仅支持传统的统计分析,还集成了先进的机器学习算法,这使得它成为学术界和工业界广泛使用的一种工具。从简单的线性回归到复杂的神经网络,MATLAB的机器学习模块都能够提供强大的支持。

本章旨在简明扼要地介绍MATLAB在机器学习领域的应用和优势,并为接下来的章节提供一个理论和实践相结合的背景铺垫。通过本章,读者将对MATLAB在机器学习中扮演的角色有一个初步的认识,并能够期待深入了解其在机器学习中的具体应用和进阶技巧。

# 2. MATLAB中的机器学习理论基础

## 2.1 机器学习基本概念

### 2.1.1 机器学习的定义和分类

机器学习是一门研究计算机如何通过经验来改进自身性能的学科,是人工智能领域的一个重要分支。它依赖于统计学、计算机科学和优化理论等领域的研究成果,使计算机能够在没有明确编程的情况下完成任务。

机器学习可以分为几种类型,主要包括监督学习、无监督学习、半监督学习和强化学习。

- 监督学习:在此类学习中,算法从标记的训练数据中学习一个模型,然后对未标记的数据进行预测。常见的监督学习算法包括线性回归、逻辑回归、支持向量机和决策树等。

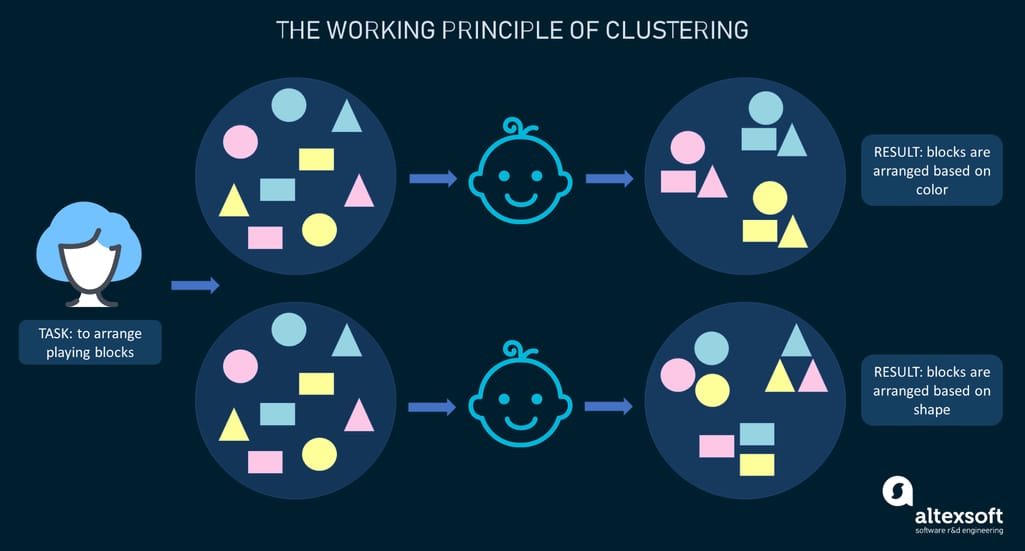

- 无监督学习:无监督学习算法处理未标记的数据,其目的是找出数据中的隐藏结构和模式。聚类和关联规则学习是无监督学习的两种主要方法。

- 半监督学习:在半监督学习中,数据一部分有标签,另一部分没有。该方法试图利用少量的标签数据和大量的无标签数据来构建更好的模型。

- 强化学习:这是一种学习方法,其中智能体通过与环境的交互来学习。智能体通过执行动作并接收反馈(奖励或惩罚)来学习如何实现特定目标。

### 2.1.2 模型训练和评估基础

模型训练是机器学习的核心过程之一,它涉及到从数据中学习模型参数的过程。训练过程通常包括以下步骤:

1. **数据准备**:收集和准备用于训练和测试的数据集。

2. **特征选择**:从原始数据中选择有用的特征来表示数据。

3. **模型选择**:根据问题的类型选择适当的机器学习算法。

4. **训练模型**:利用训练数据对模型参数进行学习。

5. **模型验证**:通过验证集评估模型的性能,避免过拟合。

6. **参数调优**:根据验证集的结果调整模型参数。

模型评估是机器学习任务中另一个关键的步骤。评估的目的是确定模型在未知数据上的表现。评估指标取决于具体问题的类型。例如,分类问题常用准确度、精确率、召回率和F1分数作为评估指标,而回归问题常用的评估指标包括均方误差(MSE)、均方根误差(RMSE)和R平方值等。

## 2.2 算法理论详解

### 2.2.1 监督学习算法

监督学习算法是机器学习中最常见的类型之一。我们来深入探讨两种广泛使用的监督学习算法:线性回归和支持向量机(SVM)。

#### 线性回归

线性回归模型是试图通过线性方程来拟合输入变量和输出变量之间的关系。最简单的线性回归是一元线性回归,其模型可以表示为:

```matlab

y = ax + b

```

其中,`y` 是因变量,`x` 是自变量,`a` 是斜率(权重),`b` 是截距。

在MATLAB中,可以使用内置函数 `fitlm` 来拟合线性模型:

```matlab

% 假设 X 和 Y 是数据集中的特征和标签

lm = fitlm(X, Y);

```

逻辑回归是线性回归的扩展,它用于处理二分类问题。其模型通过逻辑函数(如Sigmoid函数)将线性回归的输出映射到0和1之间。

#### 支持向量机(SVM)

支持向量机(SVM)是一种强大的监督学习模型,主要用于分类问题。SVM通过在特征空间中找到一个最优的超平面来区分不同类别的数据,这个超平面能够最大化不同类别数据之间的边界。

在MATLAB中,可以使用 `fitcsvm` 函数来构建SVM模型:

```matlab

% 假设 X 是特征矩阵,Y 是对应的标签

SVMModel = fitcsvm(X, Y);

```

### 2.2.2 无监督学习算法

无监督学习算法尝试从数据中发现隐藏的结构和关系,其中聚类是无监督学习中最常见的一种方法。我们将重点讲解K-均值聚类算法。

#### K-均值聚类算法

K-均值聚类是一种迭代方法,它将数据集中的数据点分配到K个集群中。算法的目的是使得同一个集群内的点之间的距离最小,而不同集群之间的距离最大。

在MATLAB中,可以使用 `kmeans` 函数来执行K-均值聚类:

```matlab

% 假设 Data 是一个 m×n 的矩阵,其中 m 是数据点的数量,n 是特征的数量

[idx, C] = kmeans(Data, K);

```

其中,`idx` 是每个数据点所属集群的索引,`C` 是每个集群的中心点。

### 2.2.3 强化学习算法

强化学习是一种让机器通过与环境互动来学习的方法。在强化学习中,智能体通过尝试不同的动作并根据获得的奖励或惩罚来更新其策略。强化学习的关键概念包括状态、动作、策略、奖励和值函数。

Q-learning是强化学习中的一种重要算法,它是一种基于值的无模型的强化学习方法。Q-learning的主要思想是智能体在给定状态下选择动作,并更新这个动作的估计值,即Q值。

在MATLAB中,可以使用 `rlQAgent` 或其他强化学习相关的函数和类来实现Q-learning。

## 2.3 优化算法在机器学习中的应用

### 2.3.1 优化问题与求解方法

优化问题是机器学习中的一个核心问题,涉及到寻找最优解的过程。在机器学习中,优化问题通常是指寻找损失函数的最小值。常见的优化问题求解方法包括梯度下降、牛顿法、拟牛顿法、遗传算法等。

### 2.3.2 常见优化算法

#### 梯度下降法

梯度下降法是最常用的优化算法之一,它通过计算损失函数相对于模型参数的梯度,然后向梯度下降的方向进行迭代来寻找最优解。梯度下降的更新规则为:

```matlab

theta = theta - learning_rate * gradient

```

其中,`theta` 是模型参数,`learning_rate` 是学习率,`gradient` 是损失函数关于模型参数的梯度。

在MATLAB中实现梯度下降算法:

```matlab

% 假设 loss_function 是损失函数,gradient_function 是梯度函数

theta = theta - learning_rate * gradient_function(theta);

```

#### 遗传算法

遗传算法是一种启发式搜索算法,模仿自然选择和遗传学的原理。遗传算法通过选择、交叉和变异等操作,不断迭代优化,最终找到全局最优解。

在MATLAB中,可以使用 `ga` 函数从全局优化工具箱中实现遗传算法。

这些优化算法对于机器学习模型的训练至关重要,通过选择合适的优化策略,可以显著提高模型的性能。

# 3. MATLAB机器学习实践操作

## 3.1 数据预处理与特征工程

### 3.1.1 数据清洗和标准化

在机器学习的实践中,数据的清洗和标准化是极为关键的步骤。它们能够提高模型对数据的理解能力,提升最终模型的性能。数据清洗的主要目标是识别并修正或删除数据中的错误和异常值,保证数据质量。

MATLAB提供了丰富的数据处理工具和函数。例如,`clean`函数可以用于识别并处理缺失数据;`fillmissing`函数用于填充缺失值;`rmmissing`函数用于移除含有缺失值的行。数据的标准化则通常通过 `z-score` 标准化或是将数据缩放至一定范围(例如0-1)来完成。

```matlab

% 例子:数据清洗和标准化

data = readtable('data.csv'); % 读取数据表

data = rmmissing(data); % 删除含有缺失值的行

% 标准化数据

normalizedData = zscore(data); % z-score标准化

% 或者

normalizedData = (data - mean(data)) / std(data); % 手动实现z-score标准化

% 可视化标准化前后的数据分布

histogram(data, 'Normalization', 'pdf');

figure;

histogram(normalizedData, 'Normalization', 'pdf');

```

以上代码先读取CSV文件中的数据,然后移除含有缺失值的行,并对数据进行z-score标准化处理。标准化前后数据的分布情况可以通过直方图来直观地对比。

### 3.1.2 特征提取与选择方法

特征提取与选择是特征工程的重要组成部分,有助于提高模型的性能,并减少计算量。在MATLAB中,可以使用多种方法进行特征选择。

- **单变量特征选择:** 这种方法会使用统计测试来选择与输出变量最相关的特征。例如,MATLAB提供了`fscchi2`、`fsrftest`、`fscnca`等函数用于基于不同统计测试的特征选择。

- **递归特征消除(RFE):** RFE是一种基于模型的特征选择方法,通过递归地构建模型,并在每次迭代中选择最重要的特征。

```matlab

% 例子:使用递归特征消除选择特征

X = normalizedData(:, 1:end-1); %

```

0

0