特征工程从零开始:手把手教你打造世界级特征

发布时间: 2024-09-03 20:31:57 阅读量: 80 订阅数: 47

# 1. 特征工程的基础理论

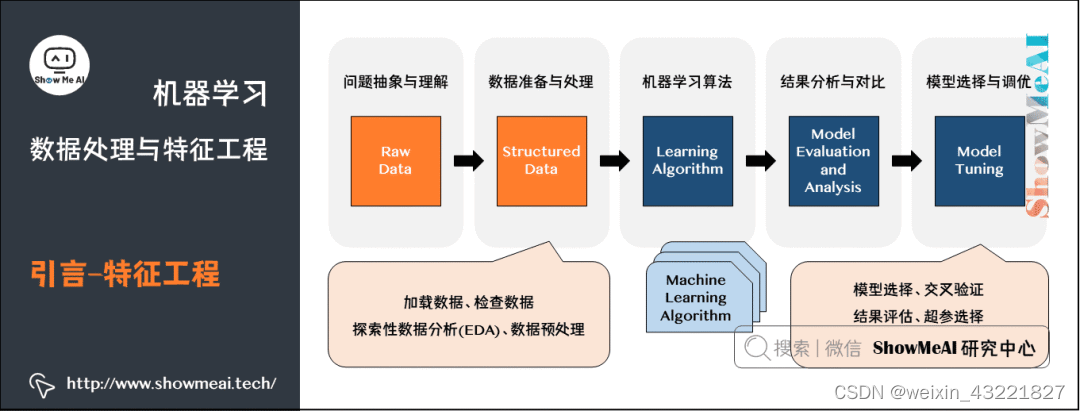

## 特征工程概述

特征工程是机器学习中极为重要的一环,涉及从原始数据中提取、构建、选择和转换信息,使其更适合模型学习的过程。它直接影响到机器学习算法的效率和预测性能。

## 特征工程的目的

在机器学习任务中,数据常以原始形式出现,包含大量噪声、冗余和非相关信息。特征工程的目标是通过理解数据背后的逻辑关系,从而提炼出对模型训练最有助益的特征,提高模型性能。

## 特征工程的重要性

良好的特征可以提高模型的准确度、减少训练时间和防止过拟合。特征工程的好坏往往决定了机器学习项目的成败。通过特征工程,我们可以为模型提供有意义的“学习线索”,增强模型的泛化能力。

在接下来的章节中,我们将深入探讨特征选择、预处理、构造和转换等基础理论,了解它们在实际问题中的应用和对模型性能的影响。

# 2. 特征选择与预处理

## 2.1 特征选择的方法论

### 2.1.1 为什么要进行特征选择

在机器学习和数据分析中,特征选择是一个至关重要的步骤,它的目的是从原始数据中选择出对预测任务最有用的特征子集。特征选择不仅能减少模型的复杂度、提高计算效率,还能提高模型的预测性能,尤其是当面对高维数据时。

减少过拟合是特征选择的另一个重要原因。当模型拥有过多的特征时,可能会学习到数据中的噪声和无关的信息,从而影响模型的泛化能力。通过特征选择,我们可以剔除那些对预测目标贡献不大的特征,从而减少噪声并提高模型的稳健性。

除此之外,特征选择还能提高模型的可解释性。在许多应用中,尤其是医疗、金融等领域,模型的可解释性至关重要。通过减少特征的数量,模型更容易被理解和解释,同时也更容易向非专业人员展示决策逻辑。

### 2.1.2 常用的特征选择技术

特征选择方法可以分为三大类:过滤法(Filter),包裹法(Wrapper),和嵌入法(Embedded)。每种方法都有其适用的场景和优缺点。

过滤法是通过特征与目标变量之间的统计度量来进行特征选择的方法。常见的过滤法包括卡方检验、互信息、相关系数等。这些方法计算速度快,易于实现,但是它们通常不考虑特征间的相互作用,也可能忽略一些重要的特征。

包裹法考虑了特征与目标变量之间的关系,以及特征与特征之间的相互作用。常见的包裹法包括递归特征消除(RFE)、基于模型的特征选择等。包裹法通常会产生更优的特征集,但是计算成本较高,容易过拟合。

嵌入法在模型训练过程中进行特征选择,通常与特定的模型框架相结合。例如,使用带有正则化的线性模型(如Lasso回归)可以自动进行特征选择,正则化项会使得一些不重要的特征系数趋于零。嵌入法能够在模型训练的同时选择特征,减少了外部计算,但是对模型的依赖性较强。

## 2.2 特征预处理技术

### 2.2.1 数据标准化和归一化

数据标准化和归一化是数据预处理中常见的步骤,目的是将特征的值调整到一个公共的尺度,以便于比较和计算。

数据标准化主要是将数据的均值变为0,方差变为1,常用的方法是z-score标准化:

```python

from sklearn.preprocessing import StandardScaler

# 假设X是特征矩阵

scaler = StandardScaler()

X_scaled = scaler.fit_transform(X)

```

归一化则是将数据缩放到[0, 1]区间,常用方法有最小-最大归一化:

```python

from sklearn.preprocessing import MinMaxScaler

# 假设X是特征矩阵

scaler = MinMaxScaler()

X_scaled = scaler.fit_transform(X)

```

标准化与归一化的适用情况不同。标准化更适合大多数基于距离的算法(如KNN、SVM),而归一化在使用基于梯度下降的算法(如神经网络、线性回归)时更为有效。

### 2.2.2 缺失值处理和异常值检测

数据集中缺失值和异常值的存在会严重影响模型的性能,因此需要适当的方法来处理。

对于缺失值,有几种常见的处理方法:

- 删除含有缺失值的记录。

- 用某个固定值(如均值、中位数、众数)填充缺失值。

- 使用模型预测缺失值。

在Python的Pandas库中,可以使用`dropna`、`fillna`等函数来处理缺失值。

异常值的检测通常需要定义什么样的值可以被认为是异常的。常用的方法包括Z-score、IQR(四分位数间距)、基于统计模型的异常检测等。异常值一旦检测出来,可以考虑删除或替换为其他值。

## 2.3 特征构造和转换

### 2.3.1 基于统计的特征构造

基于统计的方法可以利用现有的特征数据构造新的特征,比如:

- 使用特征的统计量,如最大值、最小值、均值、中位数、标准差等。

- 对时间序列数据,使用统计方法提取趋势和季节性信息。

例如,我们可以使用Pandas库来计算时间序列的统计特征:

```python

import pandas as pd

# 假设df是包含时间序列数据的DataFrame

df['mean'] = df['feature'].rolling(window=10).mean() # 10个时间点的均值

df['std'] = df['feature'].rolling(window=10).std() # 10个时间点的标准差

```

### 2.3.2 特征编码与转换技术

特征编码是对类别特征进行转换的过程,常用的方法有:

- 标签编码(Label Encoding):将类别标签转换为数值。

- 独热编码(One-Hot Encoding):为每个类别标签创建一个新的二进制列。

例如,使用Pandas进行标签编码和独热编码:

```python

# 假设df['category']是类别特征

from sklearn.preprocessing import LabelEncoder

le = LabelEncoder()

df['category_encoded'] = le.fit_transform(df['category'])

from sklearn.preprocessing import OneHotEncoder

ohe = OneHotEncoder()

df_ohe = ohe.fit_transform(df[['category']]).toarray()

```

特征转换是指将数据从一个表示转换到另一个表示,常用的技术包括:

- 对数转换:适用于具有指数分布的特征。

- 平方根转换:适用于具有泊松分布的特征。

- 倒数转换:适用于具有长尾分布的特征。

这些转换方法可以使用Numpy、Pandas或Scikit-learn库来实现。

通过以上内容的介绍,我们可以看到,特征选择与预处理是构建高效机器学习模型的基石。在这个过程中,我们需要对原始数据进行仔细的探索和分析,并采用适当的技术来提高数据质量,从而为后续的建模工作打下坚实的基础。

# 3. 高级特征工程技术

## 3.1 非线性特征抽取

### 3.1.1 核方法与核技巧

核方法是一种强大的数学工具,用于处理原本在原始空间中难以解决的非线性问题。通过将数据映射到更高维的空间,核方法能够在该高维空间中寻找线性关系,进而解决非线性问题。核技巧的主要思想是避免显式地进行高维空间的映射,而是通过定义一个核函数来隐式地计算高维空间中数据点的内积。

核函数的选择至关重要,因为它直接关系到能否有效地在高维空间中找到数据的分布规律。常见的核函数包括线性核、多项式核、径向基函数(RBF)核和Sigmoid核等。其中,RBF核由于其强大的表达能力,在许多领域中被广泛使用。

下面是一个使用RBF核的简单例子,展示了如何使用Python中的Scikit-learn库来应用核技巧。

```python

from sklearn.svm import SVC

from sklearn.datasets import make_classification

from sklearn.model_selection import train_test_split

# 创建一个简单的非线性可分数据集

X, y = make_classification(n_samples=100, n_features=2, n_redundant=0, n_informative=2, n_clusters_per_class=1, flip_y=0.1, class_sep=0.5, random_state=0)

# 划分数据集为训练集和测试集

X_train, X_test, y_train, y_test = train_test_split(X, y, test_size=0.2, random_state=1)

# 使用RBF核的支持向量机进行训练

clf = SVC(kernel='rbf', gamma='scale', C=1)

clf.fit(X_train, y_train)

```

在上述代码中,我们首先导入了必要的模块,并创建了一个非线性可分的分类数据集。然后,我们使用支持向量机(SVM)进行分类,并选择了RBF核。`gamma` 参数控制了RBF核的参数,影响了数据映射到高维空间

0

0