Sqoop数据集成秘籍:高效连接Hadoop与关系数据库

发布时间: 2024-10-25 20:52:48 阅读量: 36 订阅数: 39

大数据环境下使用Sqoop实现HBase与关系型数据库间的数据迁移

# 1. Sqoop简介与数据集成基础

在当今的大数据时代,数据集成是构建企业数据仓库的重要环节。作为Hadoop生态系统中的一员,Sqoop(SQL-to-Hadoop)是一种针对关系数据库和Hadoop之间进行批量数据迁移的工具。它支持从关系数据库导入数据到HDFS,以及从HDFS导出数据到关系数据库的操作。通过利用MapReduce的分布式并行处理能力,Sqoop能够高效地处理大规模数据集。

Sqoop的出现,极大地简化了传统数据仓库的数据整合流程,提供了更加灵活的数据处理机制。在数据集成过程中,Sqoop通过其命令行接口,使用户能够轻松地定义数据源,选择合适的分隔符,以及配置数据转换规则,从而实现不同类型数据源之间的无缝链接。

要深入了解Sqoop,首先需要掌握其基本的数据迁移原理和操作,这将为后续的安装配置、高级应用和性能调优打下坚实的基础。接下来,我们将详细探讨Sqoop安装与配置的相关内容,并逐步深入到数据导入导出技术的核心原理及其在数据转换与批处理中的应用。

# 2. Sqoop的安装与配置

## 2.1 Sqoop安装过程

安装Sqoop是一个相对直接的过程,但需要提前准备JDK和Hadoop环境。以下是基于Linux系统的安装步骤:

```sh

wget ***

```

首先确保你的系统已经安装了Java Development Kit (JDK) 和 Hadoop。然后,你可以下载Sqoop的二进制包并解压。为了简化安装过程,推荐使用包管理工具来完成安装。

### 2.1.1 环境检查

在安装Sqoop之前,需要检查JDK和Hadoop环境:

```sh

java -version

hadoop version

```

这两个命令会分别打印出你的Java和Hadoop版本信息,确保它们都已正确安装并配置在你的PATH环境变量中。

### 2.1.2 安装Sqoop

Sqoop的安装非常简单,只需下载对应版本的安装包,并解压到指定目录即可。

```sh

wget ***

```

### 2.1.3 配置环境变量

解压后需要设置环境变量`SQOOP_HOME`和更新`PATH`,这样可以在任何目录下使用`sqoop`命令。

```sh

export SQOOP_HOME=/path/to/sqoop-1.4.7.bin__hadoop-2.6.0

export PATH=$SQOOP_HOME/bin:$PATH

```

## 2.2 Sqoop配置详解

Sqoop的配置文件主要是`sqoop-site.xml`,位于`$SQOOP_HOME/conf`目录下。配置这个文件可以帮助用户自定义一些特定的参数,以适应不同的使用场景。

### 2.2.1 配置文件解析

在`sqoop-site.xml`文件中,你可以添加或修改配置参数来满足你的需求:

```xml

<configuration>

<property>

<name>sqoop.metastore.client.autoconnect.url</name>

<value>true</value>

</property>

</configuration>

```

### 2.2.2 配置示例

以下是一些常用的配置项:

- `sqoop.metastore.client.autoconnect.url`: 控制是否自动连接到元数据存储。

- `mapred.job.tracker`: Hadoop集群的JobTracker地址。

- `fs.defaultFS`: Hadoop文件系统的默认名称。

### 2.2.3 高级配置

Sqoop还提供了连接数据库的一些高级配置选项,例如指定数据库连接驱动类名和认证信息。

```xml

<property>

<name>sqoop.Connector.factory.class.db2</name>

<value>org.apache.sqoop.connector.db2.Db2ConnectorFactory</value>

</property>

```

在上述配置中,我们为DB2数据库指定了连接器工厂类。

## 2.3 Sqoop与Hadoop集群集成

### 2.3.1 Hadoop配置与安全性

配置Sqoop和Hadoop集群集成时,需要考虑Hadoop集群的安全设置,如Kerberos认证。

### 2.3.2 集成实践

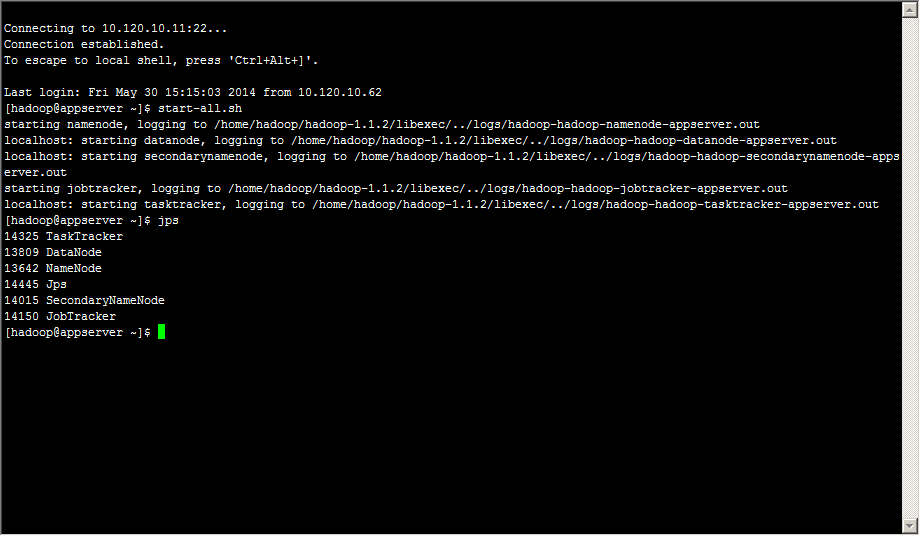

在集成过程中,你需要确保Sqoop能够与Hadoop集群的NameNode、JobTracker以及资源管理器(如YARN)正确通信。

```sh

sqoop import \

--connect jdbc:mysql://***/db \

--username dbuser \

--password dbpassword \

--query "SELECT * FROM table" \

--target-dir /user/hadoop/output

```

以上命令演示了一个简单的从MySQL到HDFS的数据导入过程,它指定了数据库连接、认证信息、查询语句和存储路径。

### 2.3.3 问题诊断与调试

集成过程中可能会遇到各种问题,如连接失败、权限不足等。建议启用Sqoop的日志记录功能,以便进行问题诊断。

```sh

sqoop import ... --verbose

```

使用`--verbose`参数可以开启详细的日志记录,这将帮助你快速定位问题所在。

## 2.4 验证安装

### 2.4.1 命令行验证

验证安装的最好方式是使用`sqoop`命令。简单运行`sqoop list-databases`可以列出所有数据库,确保连接是成功的。

```sh

sqoop list-databases --connect jdbc:mysql://***/ --username dbuser --password dbpassword

```

### 2.4.2 测试数据导入导出

除了列出数据库,还可以尝试导入导出一些实际的数据,来进一步验证安装的有效性。

```sh

sqoop import \

--connect jdbc:mysql://***/db \

--username dbuser \

--password dbpassword \

--table example_table \

--target-dir /user/hadoop/output_table

```

### 2.4.3 GUI工具验证

虽然Sqoop主要是命令行工具,但也有第三方提供的GUI工具,这些工具可以帮助可视化任务执行过程和结果。

### 2.4.4 日志分析

最后,查看Sqoop的日志文件是验证安装的一部分。日志文件通常位于`$SQOOP_HOME/logs`目录下,可以提供详细的执行信息和错误信息。

通过这些步骤,我们可以确保Sqoop安装无误,并且已经做好了与Hadoop集群集成的准备。以上安装与配置内容在任何规模的Hadoop集群上都有应用,无论是小型测试环境还是大规模生产环境。

# 3. Sqoop数据导入与导出技术

## 3.1 Sqoop数据导入原理

### 3.1.1 从关系数据库导入数据到HDFS

在处理大数据时,从传统的关系数据库(如MySQL、Oracle)将数据迁移到Hadoop的分布式文件系统(HDFS)是一个常见的需求。Sqoop提供了一种高效的方法来进行这种迁移。

在导入数据之前,首先需要确保Sqoop已正确安装并配置。一旦设置完成,导入数据的基本命令如下:

```bash

sqoop import \

--connect jdbc:mysql://localhost/db_name \

--username db_username \

--password db_password \

--table table_name \

--target-dir /sqoop_data

```

这个命令将指定的数据库中的数据表导入到HDFS中指定的目标目录。`--connect`参数用于指定数据库的JDBC连接信息,`--username`和`--password`分别用于数据库的用户名和密码,`--table`指定要导入的数据表,而`--target-dir`指定了数据在HDFS上的存储位置。

在这个过程中,Sqoop会自动为数据表中的每一行数据创建一个记录,并将其转换成适合HDFS存储的格式。导入操作是并行执行的,这意味着Sqoop会将数据表分成多个部分,每个部分由一个单独的Map任务处理,从而大大提高了数据迁移的效率。

### 3.1.2 从关系数据库导入数据到HBase

导入数据到HBase时,Sqoop同样提供了便捷的方法。HBase是一个高性能的、开源的、分布式的列式存储数据库,它与Hadoop紧密集成,非常适合存储大规模数据集。

基本的命令结构与导入到HDFS类似,但目标是HBase表:

```bash

sqoop import \

--connect jdbc:mysql://localhost/db_name \

--username db_username \

--password db_password \

--table table_name \

--columns column1,column2,... \

--hbase-table hbase_table_name \

--column-family column_family \

--hbase-row-key column1

```

在这个例子中,`--hbase-table`指定了目标HBase表的名字,`--column-family`定义了数据应该存储在HBase的哪个列族下,而`--hbase-row-key`指定了用于构造HBase行键的列。

将数据从关系数据库导入到HBase的过程涉及到数据格式的转换,因为HBase使用的是列式存储格式,而关系数据库使用的是行式存储格式。Sqoop负责将每一行数据映射到HBase的列族和行键上。

### 表格说明

| 参数 | 说明 |

| --- | --- |

| `--connect` | 数据库的JDBC连接信息 |

| `--username` | 数据库访问用户名 |

| `--password` | 数据库访问密码

0

0