Kafka与Hadoop整合指南:实时数据处理进阶技巧

发布时间: 2024-10-25 21:24:34 阅读量: 41 订阅数: 28

# 1. Kafka与Hadoop整合概述

在当今的大数据时代,企业对于数据的实时处理和存储有着迫切的需求。Kafka和Hadoop作为开源数据处理和存储的两大重要技术,当它们被整合在一起时,可以提供一个强大而灵活的数据处理平台。本章将概述Kafka与Hadoop整合的意义,介绍它们整合的基础理论和必要性,并为后续章节中对整合过程的深入探讨打下基础。

整合Kafka和Hadoop不仅能够实现数据的实时处理和高效存储,而且还能帮助企业构建出能够处理PB级别数据的可扩展性解决方案。在接下来的章节中,我们将详细探讨如何搭建Kafka和Hadoop的整合环境,并通过实践案例展示整合后的应用场景。

# 2. Kafka与Hadoop的理论基础

## 2.1 Kafka基础

### 2.1.1 Kafka架构解析

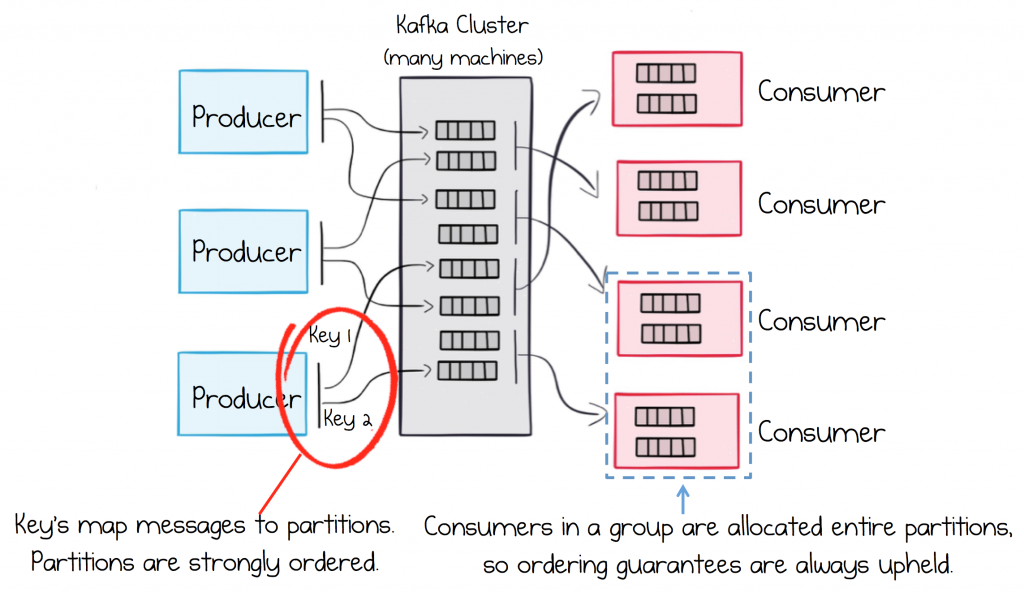

Kafka作为一个分布式流处理平台,它的架构设计支持了高性能、可扩展以及数据的持久化。其核心组件包括`Producer`(生产者)、`Consumer`(消费者)、`Broker`(代理服务器)、`Topic`(主题)以及`Partition`(分区)。

- **Producer**:负责发布消息到Kafka的topic中。生产者在发布记录时可以指定键,通过这个键来决定消息被发送到哪个分区。

- **Consumer**:从Kafka的topic中读取数据。消费者按照特定的逻辑(如分区和偏移量)来读取数据。

- **Broker**:是Kafka集群中的单个服务器节点,用于存储数据和处理数据的读写请求。

- **Topic**:消息的分类名,主题是消息的逻辑容器,可以被视为一个消息流的集合。

- **Partition**:一个分区是一个有序的消息序列,每个topic可以分为多个分区,分区可以分布在网络中的多个服务器上,从而提升容错能力和水平扩展能力。

### 2.1.2 Kafka核心概念

Kafka的核心概念围绕着数据的发布和订阅展开,其中有几个关键点:

- **消息**:Kafka的数据单元,由字节数组组成。

- **偏移量**:每个分区的消息都会被赋予一个唯一的序列号,也就是偏移量,用于标识消息在分区内的位置。

- **副本**:为了保证数据的可靠性,每个分区可以配置多个副本,其中一个副本是Leader,其他的副本是Follower。所有的读写操作都是在Leader副本上进行,然后由Leader副本同步到Follower副本。

- **消息保留策略**:Kafka通过配置文件中的`log.retention.hours`等参数来定义消息保留多久。此外,还可以根据日志大小来清理旧消息。

- **负载均衡**:通过分区机制,Kafka可以将数据和负载均匀分散在所有代理服务器上。

## 2.2 Hadoop基础

### 2.2.1 Hadoop生态系统概览

Hadoop是一个由Apache软件基金会开发的开源框架,它允许使用简单的编程模型在跨计算机集群存储和处理大量数据。其生态系统包含多个子项目:

- **HDFS**:Hadoop Distributed File System,分布式文件存储系统。

- **MapReduce**:用于并行处理大数据的编程模型。

- **YARN**:Yet Another Resource Negotiator,负责集群资源管理和作业调度。

- **HBase**:建立在HDFS之上,支持大量稀疏数据集的随机实时读写访问。

- **ZooKeeper**:分布式协调服务,管理分布式应用。

- **Hive**:构建在Hadoop上的数据仓库工具,提供SQL查询语言HiveQL。

- **Pig**:提供数据流语言Pig Latin,用于并行计算数据。

### 2.2.2 Hadoop核心组件分析

**HDFS**:

HDFS主要用于存储大量数据。HDFS具有高容错性的特点,并提供高吞吐量的数据访问。它采用了主/从(Master/Slave)架构,一个HDFS集群包含一个NameNode(主节点)和多个DataNode(数据节点)。NameNode负责管理文件系统的元数据,而DataNode则存储实际的数据。

**YARN**:

YARN是Hadoop的资源管理器和作业调度平台。YARN的核心组件包括Resource Manager、Node Manager和Application Master。Resource Manager是集群资源的管理者,Node Manager是每个节点上的资源和任务管理器,Application Master负责管理单个应用程序的生命周期。

**HBase**:

HBase是一个分布式、可扩展的大数据存储系统,它是建立在HDFS之上的列式存储数据库。HBase为存储超大规模的数据集提供高性能、可扩展的存储解决方案。它的核心概念包括行键、列族、列限定符、时间戳和单元格。

## 2.3 Kafka与Hadoop整合的必要性

### 2.3.1 实时数据处理的优势

实时数据处理指的是数据生成后即刻被处理的能力。Kafka与Hadoop整合可以实现数据的实时流式处理。Kafka擅长于处理高吞吐量的实时数据流,而Hadoop擅长于大规模的批处理和持久化存储。通过整合Kafka和Hadoop,可以在数据被记录的同时进行分析处理,甚至直接流入Hadoop生态中的HBase或其他存储组件,实现数据的即时消费。

### 2.3.2 整合的场景应用

整合Kafka与Hadoop的场景应用包括但不限于以下几种:

- **日志分析**:将应用程序的日志实时推送到Kafka,然后使用Kafka与Hadoop整合的解决方案,比如Kafka Connect,将数据导入HDFS进行深入分析。

- **事件驱动的数据处理**:例如实时推荐系统,将用户行为事件实时收集至Kafka,然后通过Hadoop进行离线计算生成推荐模型。

- **实时监控与警报系统**:从各种监控工具中收集实时数据流到Kafka,然后使用Hadoop的生态系统工具进行数据处理和分析,快速反应业务警报。

- **大数据分析平台**:对于需要同时处理实时数据和历史数据的大数据平台,Kafka可以作为实时数据的入口,Hadoop则负责后续的批量计算和历史数据的分析。

## 2.4 Kafka与Hadoop整合的技术挑战和解决方案

整合Kafka与Hadoop面临的技术挑战主要包括数据同步延迟、系统复杂度、故障恢复等问题。以下是可能的解决方案:

- **数据同步延迟**:通过合理配置Kafka与Hadoop之间的连接器(Connector)来确保数据传输的及时性。

- **系统复杂度**:通过使用现成的集成框架如Apache NiFi来简化Kafka与Hadoop的整合流程,以及提供易于管理的用户界面。

- **故障恢复**:采用分布式架构设计,实现高可用的Kafka和Hadoop集群,同时进行定期的备份和监控,确保系统的稳定性和数据的安全性。

这些挑战和解决方案的分析,有助于在实施Kafka与Hadoop整合项目时,提前预见到潜在的问题,并制定出合适的应对策略,以期达到更高效、稳定的数据处理效果。

# 3. Kafka与Hadoop整合实践

## 3.1 环境搭建

### 3.1.1 Kafka环境安装与配置

在本章节中,我们将详细探讨如何在生产环境中安装与配置Kafka,以确保它能与Hadoop无缝整合。

首先,需要从Apache Kafka官网下载最新的Kafka压缩包。下载后,解压缩至您选择的安装目录:

```shell

tar -xzf kafka_2.12-2.4.0.tgz

cd kafka_2.12-2.4.0

```

接下来,需要对Kafka的配置文件进行适当调整。最基础且必须设置的配置文件是`server.properties`,它位于Kafka安装目录的`config`文件夹下。

关键配置项包括:

- `broker.id`:每个Kafka集群中的broker必须有一个唯一的ID。

- `listeners`:配置Kafka监听的地址和端口,这对于集群配置尤为重要。

- `log.dirs`:指定Kafka消息日志存储的位置。

- `zookeeper.connect`:设置Zookeeper连接信息。

一个典型的`server.properties`配置示例可能如下所示:

```properties

broker.id=0

listeners=PLAINTEXT://localhost:9092

log.dirs=/tmp/kafka-logs

zookeeper.connect=localhost:2181

```

完成基本配置后,就可以启动Kafka服务了。在命令行中输入以下命令:

```shell

bin/kafka-server-start.sh config/server.properties

```

该命令会启动Kafka服务器,并开始监听配置的端口。

在生产环境中,还需要考虑安全性配置、资源分配、备份策略等高级设置。这些设置可以帮助保证系统的稳定性和数据的安全性。此外,监控和日志分析也是生产环境中不可或缺的一部分,以便实时了解Kafka集群的状态。

### 3.1.2 Hadoop环境安装与配置

Hadoop环境的搭建通常更为复杂,因为它涉及到多个组件,如HDFS、YARN等。这里我们仅概述安装步骤,并重点讨论与Kafka整合相关的配置。

Hadoop可以通过其包管理工具或源码编译来安装。以下是使用包管理工具安装的简化步骤:

1. 下载Hadoop压缩包并解压:

```shell

tar -xzf hadoop-3.2.1.tar.gz

mv hadoop-3.2.1 /usr/local/hadoop

```

2. 配置Hadoop环境变量,编辑`~/.bashrc`文件,添加:

```shell

export HADOOP_HOME=/usr/local/hadoop

export PATH=$PATH:$HADOOP_HOME/bin:$HADOOP_HOME/sbin

```

接下来是核心配置文件的编辑:

- `hdfs-site.xml`:配置文件系统相关设置。

- `core-site.xml`:配置Hadoop的全局设置。

- `yarn-site.xml`:配置YARN相关设置。

例如,在`core-site.xml`中,最基本的配置是设置Hadoop的默认文件系统:

```xml

<configuration>

<property>

<name>fs.defaultFS</name>

<value>hdfs://localhost:9000</value>

</property>

</configuration>

```

对于与Kafka的整合,特别需要关注的是Kafka与HDFS的数据集成,这将涉及到Hadoop的文件系统API来读取或写入数据。

完成以上步骤后,通过运行以下命令来格式化HDFS文件系统:

```shell

hdfs namenode -format

```

最后,启动所有Hadoop守护进程:

```shell

start-dfs.sh

start-yarn.sh

```

在生产环境中,还需要考虑Hadoop集群的高可用配置、数据副本策略、网络优化、安全性配置等。为了与Kafka集成,可能还需要对Kafka Connect进行配置,以实现Kafka和Hadoop组件之间的数据流动。

## 3.2 数据流的集成

### 3.2.1 Kafka到HDFS的数据管道

将Kafka的数据流高效地传输到Hadoop的HDFS中,是许多大数据应用的核心需求。构建Kafka到HDFS的数据管道主要依赖于Kafka Connect HDFS Connector。

首先,需要下载并解压Kafka Connect HDFS Connector:

```shell

tar -xzf kafka-connect-hdfs-2.4.0-plugin.tar.gz

cd kafka-connect-hdfs

```

接着,需要在Kafka的`connect-distributed.properties`文件中指定连接HDFS所需的配置,如:

```properties

# 连接到HDFS的配置

hdfs.url=hdfs://localhost:9000

# Kafka Connect工作文件存放路径

offset.storage.file.filename=/tmp/connect.offsets

offset.flush.interval.ms=10000

```

配置完成后,启动Kafka Connect服务:

```shell

bin/connect-distribute

```

0

0