MapReduce编程模型实战指南:大数据处理的秘诀

发布时间: 2024-10-25 20:29:37 阅读量: 21 订阅数: 39

MapReduce编程模型基础实战教程:理解并实现大规模数据处理

# 1. MapReduce编程模型入门

## 1.1 MapReduce概念简介

MapReduce是一种编程模型,用于大规模数据集的并行运算。它由Google提出,被广泛应用于分布式计算领域。在MapReduce模型中,开发者不需要关心底层的分布式处理细节,只需要定义好Map和Reduce两个处理函数,系统会自动完成数据的分发和处理过程。

## 1.2 MapReduce的适用场景

这种模型非常适合于处理大量无结构或半结构化的数据集,如日志文件分析、统计排序、文本聚类等。MapReduce使得这些大规模数据处理任务能够易于编写且能运行在成百上千的机器上。

## 1.3 MapReduce的基本原理

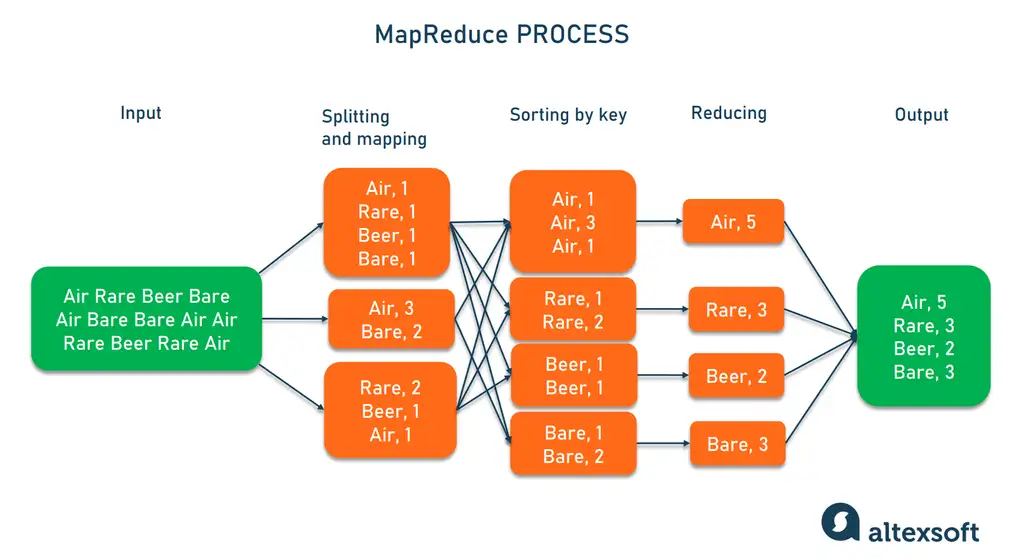

MapReduce模型分为两个主要阶段:Map阶段和Reduce阶段。Map阶段负责处理输入数据并生成中间的键值对(key-value pairs)。Reduce阶段则对这些键值对进行汇总处理,输出最终结果。简单地说,Map阶段类似于数据库中的group by操作,而Reduce阶段则类似于聚合操作。

下面的章节将详细介绍MapReduce编程模型,包括其核心概念、编程范式和环境搭建等,帮助读者从入门到深入理解MapReduce的各个方面。

# 2. 深入MapReduce的理论基础

### 2.1 MapReduce的核心概念

#### 2.1.1 Map和Reduce的定义与作用

MapReduce是一种编程模型,用于处理大量数据的并行运算。这一概念最早由Google提出,之后被Apache Hadoop所采纳并广泛使用。MapReduce模型可以分为两个主要的处理阶段:Map阶段和Reduce阶段。

在Map阶段,输入数据集被切分成更小的数据块,这些数据块可以被并行处理。Map函数对这些数据块进行处理,通常是对数据集进行过滤和排序,产生一系列中间键值对(key-value pairs)。这个过程的目的是把大规模数据集转换成一组较小的数据集,而这些数据集正是Reduce阶段处理的基础。

Reduce阶段则是对Map阶段输出的中间键值对进行汇总。Reduce函数把具有相同键的所有值聚合到一起,并且进行合并处理,最终得到较小数量的输出结果。这一阶段的处理对于数据的合并、计算、汇总等操作非常有效。

举一个简单的例子:假设我们要统计一个文本文件中每个单词出现的次数,Map阶段会把文本文件的每一行映射为键值对,其中键是单词,值是1。Reduce阶段随后会对所有的键值对进行汇总,如果两个键相同,它们的值将被累加,得到每个单词出现的次数。

MapReduce的这种设计允许开发者把注意力集中在编写Map和Reduce这两个函数上,而把数据的分配、任务的调度、容错处理等复杂问题交给底层的MapReduce框架来处理。

#### 2.1.2 MapReduce的工作流程详解

理解MapReduce的工作流程是掌握这一模型的关键。MapReduce程序的工作流程可以概括为以下几步:

1. 输入数据处理:MapReduce作业的输入数据通常存储在Hadoop的分布式文件系统(HDFS)中。这些数据在开始计算前被切分成多个数据块(blocks),每个数据块由一个Map任务处理。

2. Map阶段:每个Map任务读取输入数据块,将其解析为键值对。然后应用用户定义的Map函数到这些键值对上,生成中间键值对。

3. Shuffle阶段:Map任务完成后,框架自动对所有中间键值对进行排序和分组。这一步骤保证了所有相同键的值都会被发送到同一个Reduce任务。

4. Reduce阶段:Reduce任务接收到排序后的键值对列表后,对每个键下的所有值进行合并处理,通常是汇总或聚合操作。最终,Reduce函数输出最终结果。

5. 输出数据存储:Reduce任务的输出结果被写入HDFS中,作为MapReduce作业的最终输出。

整个流程可以用下面的流程图来表示:

```mermaid

graph LR

A[输入数据] -->|切分| B(Map任务)

B -->|处理| C[中间键值对]

C -->|排序| D(Shuffle)

D -->|分组| E[Reduce任务]

E -->|汇总| F[最终结果]

F -->|存储| G[输出数据]

```

在这个过程中,MapReduce框架负责整个作业的调度和监控,确保数据的一致性和可靠性。开发者只需要关注于编写Map和Reduce逻辑。

理解MapReduce的工作流程,对于开发高效的数据处理程序至关重要。开发者需要根据Map和Reduce函数的特性来设计算法,以充分利用MapReduce模型的并行计算能力。在下一节中,我们将探讨MapReduce编程范式的原理及其与传统编程的区别。

# 3. MapReduce实践技巧与案例分析

## 3.1 MapReduce编程实战

### 3.1.1 开发第一个MapReduce程序

MapReduce编程实战的起点是理解如何编写一个基本的MapReduce程序。在Hadoop中,编写MapReduce程序通常涉及两个主要组件:Mapper和Reducer。以下是一个简单的MapReduce程序的框架,用于统计文本文件中的单词频率。

```java

import org.apache.hadoop.conf.Configuration;

import org.apache.hadoop.fs.Path;

import org.apache.hadoop.io.IntWritable;

import org.apache.hadoop.io.Text;

import org.apache.hadoop.mapreduce.Job;

import org.apache.hadoop.mapreduce.Mapper;

import org.apache.hadoop.mapreduce.Reducer;

import org.apache.hadoop.mapreduce.lib.input.FileInputFormat;

import org.apache.hadoop.mapreduce.lib.output.FileOutputFormat;

import java.io.IOException;

public class WordCount {

public static class TokenizerMapper extends Mapper<Object, Text, Text, IntWritable> {

private final static IntWritable one = new IntWritable(1);

private Text word = new Text();

public void map(Object key, Text value, Context context) throws IOException, InterruptedException {

String[] words = value.toString().split("\\s+");

for (String str : words) {

word.set(str);

context.write(word, one);

}

}

}

public static class IntSumReducer extends Reducer<Text, IntWritable, Text, IntWritable> {

private IntWritable result = new IntWritable();

public void reduce(Text key, Iterable<IntWritable> values, Context context) throws IOException, InterruptedException {

int sum = 0;

for (IntWritable val : values) {

sum += val.get();

}

result.set(sum);

context.write(key, result);

}

}

public static void main(String[] args) throws Exception {

Configuration conf = new Configuration();

Job job = Job.getInstance(conf, "word count");

job.setJarByClass(WordCount.class);

job.setMapperClass(TokenizerMapper.class);

job.setCombinerClass(IntSumReducer.class);

job.setReducerClass(IntSumReducer.class);

job.setOutputKeyClass(Text.class);

job.setOutputValueClass(IntWritable.class);

FileInputFormat.addInputPath(job, new Path(args[0]));

FileOutputFormat.setOutputPath(job, new Path(args[1]));

System.exit(job.waitForCompletion(true) ? 0 : 1);

}

}

```

### 3.1.2 输入输出数据的处理

在MapReduce中,输入数据通常以键值对的形式存在,经过Mapper处理后,输出的也是一个键值对。最终这些键值对会被Reducer处理,输出最终的结果。理解如何处理输入输出数据对于编写有效的MapReduce程序至关重要。

以下是一个关于如何自定义输入输出格式的简单例子:

```java

public class CustomInputFormat extends FileInputFormat<Text, IntWritable> {

@Override

public RecordReader<Text, IntWritable> createRecordReader(InputSplit split,

```

0

0