【特征工程】:决策树与逻辑回归的特征选择与数据预处理技巧

发布时间: 2024-09-05 05:59:07 阅读量: 64 订阅数: 48

# 1. 特征工程基础

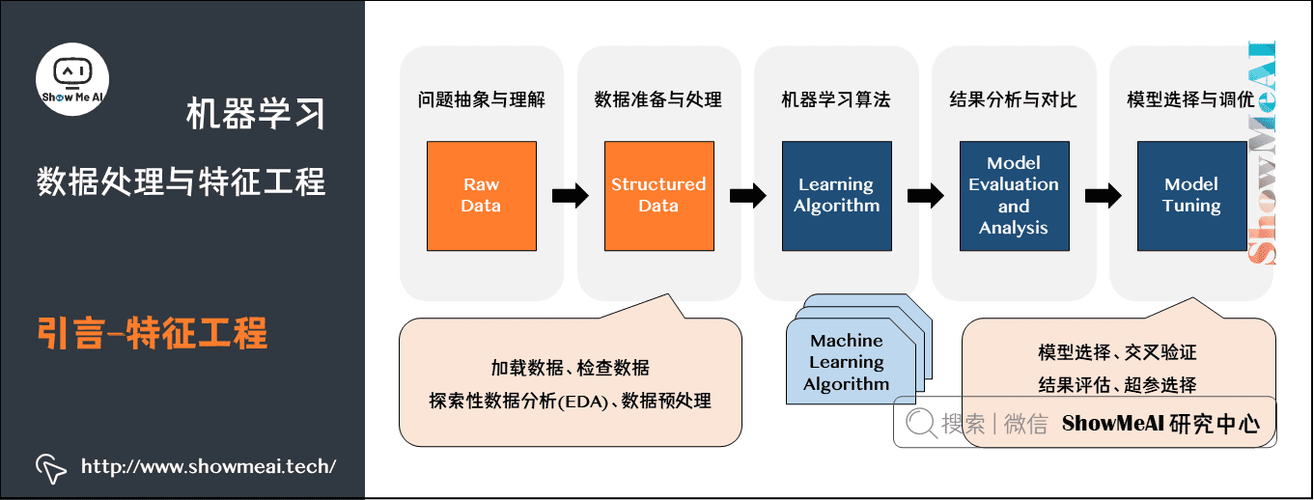

## 特征工程概述

特征工程是机器学习中的一个核心环节,它涉及到从原始数据中提取有用信息,并将这些信息转换成模型能够理解和利用的形式。在这个过程中,数据分析师和数据科学家需要了解数据的结构和特征,以及它们与预测目标之间的关系。

## 特征工程的重要性

在机器学习模型的训练过程中,特征工程的好坏直接关系到模型的性能。一个优秀的特征工程过程能够提高模型的预测准确度,减少过拟合的风险,并提升模型的泛化能力。准确地说,特征工程是决定模型性能上限的关键步骤。

## 特征工程的基本步骤

1. **数据预处理**:包括清洗、归一化、标准化、缺失值处理等。

2. **特征提取**:从原始数据中生成新的特征,比如使用统计量、提取文本中的n-gram等。

3. **特征选择**:从众多特征中选取对模型最有帮助的特征,移除冗余特征。

4. **特征构造**:通过现有特征组合创造新的特征,增加模型的表达能力。

5. **特征转换**:使用函数转换特征,如对数、平方根、对数几率等,以满足模型的假设条件。

通过以上步骤,特征工程能够显著提升数据质量和模型性能,为机器学习任务的成功奠定基础。在接下来的章节中,我们将深入探讨特征工程在决策树模型中的具体应用。

# 2. 决策树模型的特征选择方法

## 2.1 决策树模型理论基础

### 2.1.1 决策树的构建过程

决策树是一种常用的监督学习算法,通过一系列的规则将数据集进行递归分割,最终形成一个树状结构模型。构建决策树的过程涉及以下关键步骤:

1. **特征选择**:选择最佳特征对数据进行分割。常见的选择标准包括信息增益、基尼指数等。

2. **决策树生成**:根据选定的最佳特征,对数据集进行分割,生成树的分支。该步骤递归执行,直到满足停止条件。

3. **决策树剪枝**:防止过拟合,通过剪掉一些分支以简化模型。剪枝策略包括预剪枝和后剪枝。

在实现决策树时,可以使用如Scikit-learn库中的`DecisionTreeClassifier`或`DecisionTreeRegressor`类。以下是构建决策树的基本代码:

```python

from sklearn.tree import DecisionTreeClassifier

# 假定 X_train, y_train 分别为特征训练数据和标签数据

dt_classifier = DecisionTreeClassifier(criterion="gini", max_depth=3)

dt_classifier.fit(X_train, y_train)

```

在此代码中,`criterion="gini"`指定了使用基尼指数作为分割标准,而`max_depth=3`是一个超参数,限制了树的最大深度。

### 2.1.2 特征重要性的评估

特征重要性评估是决策树模型中的一个关键部分,它有助于我们理解哪些特征对模型预测的贡献更大。在Scikit-learn中,特征重要性基于每个特征在树中分割点的加权总和计算得出。

特征重要性可以通过以下代码获取,并通过绘制条形图可视化:

```python

import matplotlib.pyplot as plt

# 获取特征重要性

importances = dt_classifier.feature_importances_

indices = np.argsort(importances)[::-1]

# 绘制特征重要性条形图

plt.figure()

plt.title("Feature importances")

plt.bar(range(X_train.shape[1]), importances[indices], color="r", align="center")

plt.xticks(range(X_train.shape[1]), indices)

plt.xlim([-1, X_train.shape[1]])

plt.show()

```

在上述代码中,`feature_importances_`属性提供了特征重要性的评估结果。`indices`变量是对特征重要性从高到低排序后的索引,而`plt.bar`用于绘制条形图。

## 2.2 决策树模型的特征选择实践

### 2.2.1 基于信息增益的特征选择

信息增益是决策树中常用的特征选择方法。信息增益考虑了特征对数据集纯度的影响,通常使用熵来衡量。信息增益越大,表示该特征对分类提供的信息量越多。

为了计算信息增益,我们首先需要定义熵的概念。对于一个标签值的分布,其熵定义如下:

```python

from sklearn.metrics import entropy_score

# 假设 y_train 是标签值的数组

entropy = entropy_score(y_train, y_train)

```

信息增益可以通过比较分割前后的熵差值来计算。以某特征A为例,先计算分割前的整体熵,然后对每个分割点计算熵,信息增益即为两者之差。

### 2.2.2 基于基尼指数的特征选择

基尼指数(Gini Index)是另一种衡量数据集不纯度的方法。基尼指数反映了从数据集中随机选取两个样本,其类别标记不一致的概率。基尼指数越小,表示数据集的纯度越高。

计算基尼指数的基本公式是:

```python

def gini_index(groups, class_values):

n_instances = float(sum([len(group) for group in groups]))

score = 1.0 - sum(

[len(group) / n_instances * (len(group) / n_instances) for group in groups]

)

return score

```

在实际应用中,我们将使用这个函数来评估分割前后的基尼指数,从而确定最佳特征。

### 2.2.3 剪枝技术在特征选择中的应用

剪枝技术是防止过拟合的一种重要方法。在决策树模型中,剪枝可以分为预剪枝和后剪枝。

- **预剪枝**是在树生长的过程中,通过设置如树的最大深度、最小样本数等超参数来控制树的复杂度。

- **后剪枝**是在树完全生长后,通过移除一些节点来简化树结构。

Scikit-learn支持后剪枝操作,可以通过`ccp_alpha`参数实现:

```python

dt_classifier = DecisionTreeClassifier(criterion="gini", ccp_alpha=0.01)

dt_classifier.fit(X_train, y_train)

```

在上述代码中,`ccp_alpha`参数控制了执行后剪枝的强度。较低的`ccp_alpha`值会导致较少的剪枝,从而可能增加模型复杂度和过拟合的风险。

## 2.3 决策树模型的超参数优化

### 2.3.1 超参数对决策树性能的影响

决策树的超参数包括树的深度、节点的最小分裂数、叶子节点的最小样本数等。这些参数的设置对模型的性能有着直接的影响:

- **最大深度(max_depth)**:控制树的最大深度,可以限制过拟合。

- **最小分裂样本数(min_samples_split)**:分割节点所需的最小样本数。

- **最小叶子节点样本数(min_samples_leaf)**:一个叶子节点所需的最小样本数。

通过对这些超参数进行调整,我们可以控制决策树的复杂度,从而影响模型的泛化能力。

### 2.3.2 网格搜索与随机搜索策略

为了有效地优化超参数,可以采用网格搜索(Grid Search)和随机搜索(Random Search)两种策略:

- **网格搜索**通过穷举所有超参数的组合,找到最优参数组合。

- **随机搜索**则在预定义的参数空间中随机选择参数,通常比网格搜索更快,且在高维空间中表现更佳。

以下是使用Scikit-learn进行网格搜索的示例代码:

```python

from sklearn.model_selection import GridSearchCV

# 定义参数空间

parameters = {'max_depth': [3, 5, 7, 10], 'min_samples_split': [2, 5, 10]}

grid_search = GridSearchCV(estimator=DecisionTreeClassifier(), param_grid=parameters, cv=5)

grid_search.fit(X_train, y_train)

# 输出最佳参数

best_params = grid_search.best_params_

print(best_params)

```

在此代码中,`GridSearchCV`类用于执行网格搜索,其中`cv=5`指定了5折交叉验证。通过`fit`方法拟合模型,并通过`best_params_`属性获取最佳超参数组合。

## 2.4 实践中的特征选择技巧

特征选择是机器学习中一个重要的预处理步骤,它有助于提高模型的性能,并减少模型的训练时间。在决策树模型中,特征选择主要关注于根据特征对目标变量的重要性进行排序,从而选择出对模型贡献最大的特征。

### 实践技巧

在实践中,以下是一些特征选择的技巧:

- **相关性分析**:检查每个特征与目标变量之间的相关性。相关性高的特征可能对模型预测有较大帮助。

- **方差分析**:选择方差较大的特征,方差较大的特征往往包含了更多有用的信息。

- **特征重要性排序**:利用模型提供的特征重要性排序,选取前N个最重要的特征。

- **递归特征消除**:通过递归减少特征数量的方法,选择模型表现最佳的特征子集。

### 应用代码

以下是一个使用Scikit-learn的`SelectFromModel`方法进行特征选择的示例:

```python

from skl

```

0

0