【BERT模型中的多头注意力机制详解】: 详细解析BERT模型中的多头注意力机制

发布时间: 2024-04-20 11:52:15 阅读量: 123 订阅数: 42

# 1. 理解BERT模型的基本原理

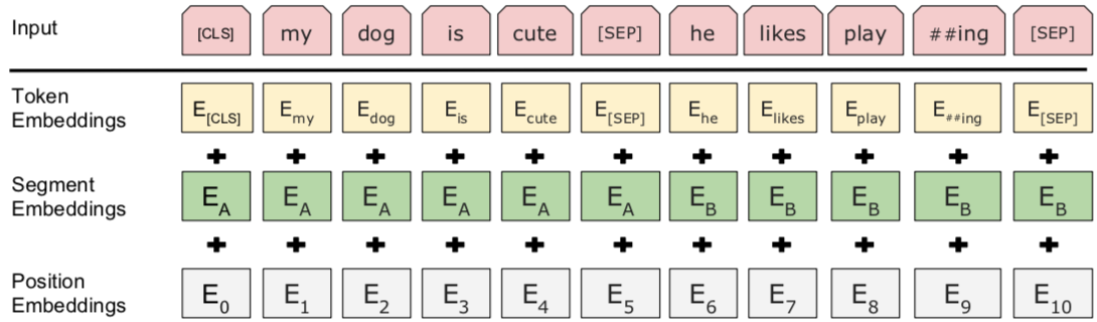

BERT(Bidirectional Encoder Representations from Transformers)是一种基于Transformer的预训练模型,它的核心思想在于通过大规模无监督训练来学习通用的语言表示。BERT模型在自然语言处理领域取得了巨大成功,其基本原理是利用Transformer结构中的编码器来学习双向语境表示,使得模型具备了理解上下文语境的能力。通过对大规模文本语料进行预训练,BERT模型可以在各种NLP任务上进行微调,取得优异的性能表现。BERT模型的基本原理对于理解后续章节中的多头注意力机制应用至关重要。

# 2. 多头注意力机制解析

在本章中,我们将深入探讨BERT模型中关键的组成部分之一:多头注意力机制。多头注意力机制是BERT模型在处理文本数据时非常重要的一环,通过并行地学习多组自注意力机制,使得模型可以同时捕捉不同位置的语义信息,从而提升模型在自然语言处理任务中的表现。

### 2.1 单头注意力机制介绍

在深入讨论多头注意力机制之前,让我们先来了解一下单头注意力机制的基本原理。

#### 2.1.1 注意力权重计算

注意力机制通过学习文本中各个词之间的依赖关系,从而赋予每个词不同的权重,以捕捉词与词之间的语义联系。

```python

# 注意力权重计算过程

def attention(query, key, value):

scores = query * key / sqrt(d_k)

return softmax(scores) * value

```

注:函数中的`softmax`函数用于计算归一化的注意力权重,`d_k`代表向量的维度。

#### 2.1.2 Self-Attention的作用

Self-Attention机制允许模型在计算不同位置词的表示时,同时考虑到句子中其他位置的词,从而更好地捕捉全局信息。

```python

# Self-Attention计算

def self_attention(input):

query = input * W_q

key = input * W_k

value = input * W_v

return attention(query, key, value)

```

#### 2.1.3 自注意力矩阵计算

自注意力机制会生成一个与输入序列长度相同的注意力权重矩阵,用于表征每个位置与其他位置的相关性。

### 2.2 多头注意力机制原理

在理解了单头注意力机制的基本原理之后,我们来探讨多头注意力机制是如何运作的。

#### 2.2.1 多头注意力是如何工作的

多头注意力机制通过学习多组不同参数的自注意力机制,使得模型能够并行地从不同子空间中进行学习,最终融合不同注意力头的表征。

```python

# 多头注意力计算

def multi_head_attention(input):

return concatenate([self_attention(input) for _ in range(num_heads)], axis=-1) * W_o

```

注:`num_heads`代表注意力头的数量,`W_o`是输出权重。

#### 2.2.2 多头注意力的优势和应用

多头注意力机制能够同时关注来自不同子空间的语义信息,从而提升模型在建模长距离依赖关系和捕获不同位置信息的能力。

#### 2.2.3 多头注意力的实现方式

多头注意力机制实现时,需要将输入进行线性变换后分成多份,分别输入不同的注意力头,最后通过拼接和线性变换得到最终输出。

通过本章的学习,我们深入理解了BERT模型中的多头注意力机制,以及其在自然语言处理任务中的重要性和应用价值。在接下来的章节中,我们将进一步探讨BERT模型中多头注意力的具体应用场景及效果。

# 3. BERT模型中的多头注意力应用

### 3.1 BERT模型概述

BERT(Bidirectional Encoder

0

0