深度学习的正则化探索:L2正则化应用与效果评估

发布时间: 2024-11-24 06:03:27 阅读量: 6 订阅数: 7

# 1. 深度学习中的正则化概念

## 1.1 正则化的基本概念

在深度学习中,正则化是一种广泛使用的技术,旨在防止模型过拟合并提高其泛化能力。过拟合是指模型在训练数据上表现得过于完美,以至于丢失了泛化到新数据的能力。正则化通过向模型引入额外的信息来克服这一问题,确保模型学习到的数据的内在结构而不是噪声。理解正则化是优化深度学习模型性能的关键步骤,尤其对于复杂的神经网络结构。

## 1.2 正则化的历史发展

正则化概念最早起源于统计学习,其目的是在模型复杂度与拟合能力之间找到一个平衡点。随后,随着深度学习的崛起,正则化技术得到了更加广泛的研究与应用。正则化方法从简单的权重衰减(如L2正则化)发展到更为复杂的结构化正则化(如Dropout、Batch Normalization),这些方法在防止过拟合方面取得了显著的效果。

## 1.3 正则化的必要性

随着训练数据量的增加,模型复杂度和容量的提升,正则化变得愈发重要。如果没有正则化,深度学习模型可能会学习到训练数据中的噪声和异常值,导致模型在新的数据上表现不佳。正则化方法通过在损失函数中添加一个额外项来约束模型的复杂度,使得模型在维持良好拟合效果的同时,能够保留足够的泛化能力。这在提高模型性能和稳定模型训练过程中起到了至关重要的作用。

# 2. L2正则化理论基础

### 2.1 L2正则化的定义与数学原理

#### 2.1.1 L2正则化项的引入与作用

L2正则化,也称为岭回归(Ridge Regression)或权重衰减(Weight Decay),是一种在损失函数中加入权重向量的L2范数的平方的惩罚项的方法。其目的是防止模型复杂度过高从而引起过拟合。在数学上,L2正则化项可以表示为一个包含权重向量的L2范数平方的项,通常乘以一个正则化参数λ(lambda)。

一个具有L2正则化的线性回归模型的损失函数可以表示为:

L(w) = ||Xw - y||^2 + λ||w||^2

其中,第一项||Xw - y||^2是模型预测值与实际值差异的平方和,第二项λ||w||^2是正则化项,w是权重向量,X是数据特征矩阵,y是目标变量向量,λ是调节正则化强度的超参数。

引入L2正则化项的作用在于:

- **防止过拟合**:通过惩罚大的权重值,强制模型学习较小的权重,从而降低模型复杂度。

- **改善数值稳定性**:在数据矩阵X不满秩或特征维度很高时,L2正则化可以帮助改善模型的数值稳定性。

- **提高泛化能力**:使模型更注重数据的整体趋势而非局部细节,从而在未见数据上表现出更好的泛化能力。

#### 2.1.2 损失函数的扩展与优化目标

当添加了L2正则化项后,损失函数由最小化均方误差扩展到最小化均方误差加上正则化项。这一过程可以看作是优化问题中的约束优化,即在满足权重向量的L2范数不越界的情况下,最小化原始的损失函数。

优化的目标在数学上可以表述为:

min_w L(w) = min_w (||Xw - y||^2 + λ||w||^2)

对此优化目标求导数,并令导数等于零可以得到权重量的最优解。这个解的形式是关于数据矩阵X的函数,可以清晰地看到正则化参数λ在平衡数据拟合项和正则化项中的作用。

在实际应用中,我们不直接对λ求解,而是通过交叉验证等方法来选择一个合适的λ值,这样可以在模型的复杂度和过拟合之间取得一个平衡。

### 2.2 L2正则化与其他正则化方法的比较

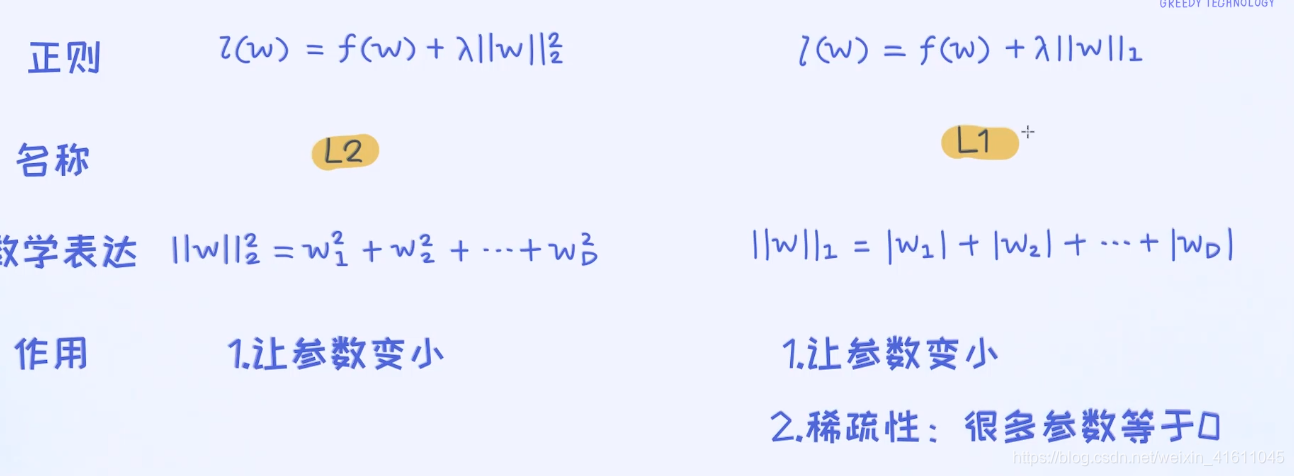

#### 2.2.1 L1正则化的特点与差异

L1正则化是向损失函数中添加权重向量的L1范数的项。与L2正则化相比,L1正则化倾向于产生稀疏权重矩阵,即模型中某些权重可能被压缩到零。这使得L1正则化在特征选择方面有其独特的优势,因为它可以自动地对不重要的特征进行惩罚,并将其权重置为零。

从数学的角度来看,L1正则化的优化问题不容易解析求解,因为它涉及的绝对值函数不是凸函数。因此,一般通过一些迭代算法来求解,例如坐标下降法。

二者的数学差异导致了在实际应用中的不同选择,L2正则化通常用于防止过拟合,保持模型稳定,而L1正则化更多用于特征选择和稀疏模型的构建。

#### 2.2.2 其他正则化技术的简介与对比

除了L1和L2正则化,还有其他一些正则化技术,例如弹性网络(Elastic Net),它的损失函数结合了L1和L2正则化项;Dropout,一种在训练过程中随机地暂时“关闭”部分神经元的技术;以及早期停止(Early Stopping),即在验证集上观察到模型性能不再提升时停止训练。

弹性网络通过结合L1和L2正则化,试图同时获得两者的优势。它特别适合于高维数据和多重共线性问题。

Dropout是一种在神经网络中广泛使用的正则化技术,它的优势在于可以迫使网络学习更鲁棒的特征,因为网络不能依赖于任何一个特征。

早期停止则是另一种非常直观的正则化方法,通过控制训练的时长来避免过拟合。

这些正则化技术各有特点和适用场景,在实际工作中选择合适的正则化方法,需要结合具体问题的特性、数据集的特点以及模型的需求进行权衡。

# 3. L2正则化在深度学习中的应用实践

## 3.1 L2正则化在神经网络中的应用

### 3.1.1 神经网络中权重衰减的实现

在神经网络中,L2正则化通常以权重衰减的形式出现,其目的是限制网络权重的大小,防止模型过拟合。权重衰减实现的一个简单例子是在权重更新时,除了正常的梯度下降步骤之外,额外减去一个与权重成比例的项。在数学上,这可以表示为更新规则:

\[

w \leftarrow w - \eta \frac{\partial L}{\partial w} - \lambda w

\]

其中,\(w\) 是权重,\(\eta\) 是学习率,\(L\) 是损失函数,\(\lambda\) 是正则化项的权重,控制了正则化的强度。这种形式的L2正则化通常称为权重衰减。

为了理解代码中权重衰减的实现方式,我们可以看下面的伪代码示例:

```python

# 假设 loss_function 是损失函数,parameters 是模型参数的集合

# alpha 是学习率,l2_lambda 是L2正则化系数

for each epoch:

gradients = compute_gradients(loss_function, parameters)

for param, grad in zip(parameters, gradients):

param_update = -alpha * grad - l2_lambda * param

param += param_update

```

在这个示例中,`param_update` 不仅包含了基于损失函数梯度的更新,还包括了一个正则化项,它将模型权重推向零。权重衰减的正则化项在每次迭代中都执行,确保了在学习过程中持续对权重进行约束。

### 3.1.2 超参数的选取与调优策略

L2正则化的一个关键超参数是正则化系数\(\lambda\),它直接影响了模型复杂度和正则化效果。选择合适的\(\lambda\)是防止过拟合和提高泛化能力的关键。在实践中,通常需要通过交叉验证等方法来确定\(\lambda\)的值。

超参数的选取通常依赖于一系列实验来完成。一个常用的策略是进行网格搜索(Grid Search),尝试不同\(\lambda\)值的组合,并评估其在验证集上的性能。例如:

```python

from sklearn.model_selection import GridSearchCV

# 假设有一个模型,它接受一个正则化系数参数

pipeline = make_pipeline(ModelClass(l2_lambda=1e-4))

# 设置参数网格,以尝试不同的正则化系数

param_grid = {'model__l2_lambda': [1e-1, 1e-2, 1e-3, 1e-4, 1e-5]}

grid_search = GridSearchCV(pipeline, param_grid, scoring='accuracy', cv=5)

grid_search.fit(X_train, y_train)

# 输出最佳的正则化系数

print("Best l2_lambda:", grid_search.best_params_)

```

在上述代码中,我们使用了`GridSearchCV`来自动尝试不同的正则化系数,并使用交叉验证来评估模型的性能。最终,我们可以获得最佳的正则化系数,以供训练最终模型使用。

## 3.2 L2正则化的编程实现

### 3.2.1 TensorFlow中的L2正则化实现

TensorFlow是一个强大的机器学习库,它提供了方便的接口来实现L2正则化。在TensorFlow中,我们可以使用`tf.keras`模块来添加L2正则化项。

```python

import tensorflow as tf

# 定义模型结构

model = tf.keras.Sequential([

tf.keras.layers.Dense(128, activation='relu', kernel_regularizer=tf.keras.regularizers.l2(0.01)),

tf.keras.layers.Dense(64, activation='relu', kernel_regularizer=tf.keras.regularizers.l2(0.01)),

tf.keras.layers.Dense(10, activation='softma

```

0

0