大规模深度学习系统:Dropout的实施与优化策略

发布时间: 2024-11-24 07:24:39 阅读量: 11 订阅数: 19

# 1. 深度学习与Dropout概述

在当前的深度学习领域中,Dropout技术以其简单而强大的能力防止神经网络的过拟合而著称。本章旨在为读者提供Dropout技术的初步了解,并概述其在深度学习中的重要性。我们将从两个方面进行探讨:

首先,将介绍深度学习的基本概念,明确其在人工智能中的地位。深度学习是模仿人脑处理信息的机制,通过构建多层的人工神经网络来学习数据的高层次特征,它已经成为许多创新应用的核心。

然后,将分析Dropout技术出现的背景,阐述它如何通过在训练过程中随机丢弃(或“关闭”)网络中的一些神经元来提高模型泛化能力。通过减少神经元间的共适应性,Dropout有助于提升模型的鲁棒性并降低过拟合的风险。

总的来说,本章为理解后续章节中Dropout技术的详细探讨,以及在实战中如何应用该技术提供了坚实的基础。

# 2. Dropout技术的理论基础

Dropout技术是深度学习领域中一种简单而强大的正则化方法,旨在解决神经网络的过拟合问题,提升模型的泛化能力。在深入了解Dropout如何在深度学习模型中实施及其优化策略之前,我们需要从理论上探究其本质原理。

## 2.1 神经网络的过拟合问题

### 2.1.1 过拟合的定义与影响

在机器学习中,过拟合是指模型在训练数据上学习得太好,以至于捕捉到了训练数据中的噪声和细节,导致模型在新的、未见过的数据上表现不佳。简而言之,过拟合的模型具有高方差。

过拟合不仅会使模型在未来的预测任务中表现不佳,还可能导致模型的决策逻辑难以理解和解释。例如,在医学诊断中,过拟合的模型可能会依赖于与疾病无关的因素,从而在实际应用中造成严重后果。

### 2.1.2 识别过拟合的方法

识别过拟合可以通过以下几种方法:

- **可视化训练和验证曲线**:绘制训练损失和验证损失随训练过程变化的曲线,如果训练损失持续下降,而验证损失开始上升,表明模型开始过拟合。

- **使用正则化项**:例如L1和L2正则化,这些项能够惩罚模型复杂度,防止过拟合。

- **交叉验证**:使用不同的训练集和验证集进行多次训练和验证,以评估模型的稳定性。

## 2.2 Dropout技术原理

### 2.2.1 Dropout的工作机制

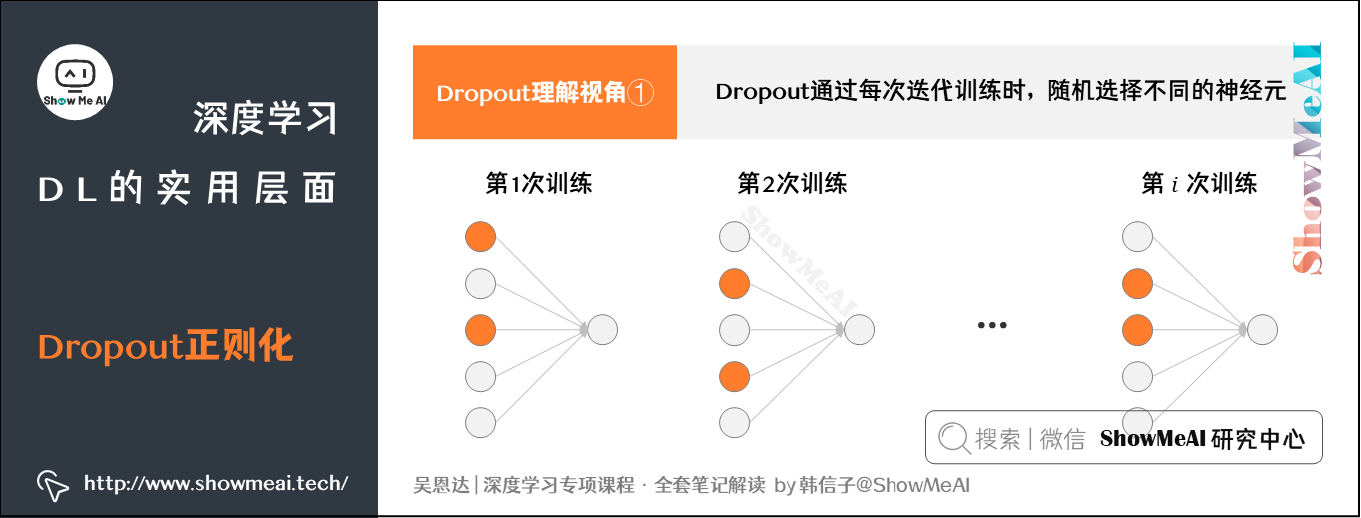

Dropout是一种在神经网络训练过程中随机丢弃(即暂时删除)部分神经元的技术。这样做的目的是在每次训练迭代中,网络的结构都是随机变化的,迫使网络学习到更加鲁棒的特征。

在训练过程中,每个神经元以一定的概率p(称为Dropout率)被临时移除,这意味着神经元不会参与前向传播和反向传播。在测试时,所有的神经元都会参与,但每个神经元的输出会被缩放,以保持输出值的期望不变。

### 2.2.2 Dropout的数学解释

假设我们有一个全连接层,其权重矩阵为W,偏置为b,激活函数为f,输入为x。对于Dropout层,我们定义一个掩码矩阵M,该矩阵的元素为0或1,且每个元素是独立同分布的,服从伯努利分布,概率为p。

在训练时,网络的输出可以表示为:

\[ y = f(M \cdot (Wx + b)) \]

其中,\( M \cdot (Wx + b) \) 表示矩阵和向量的逐元素乘积。在测试时,我们不需要掩码M,因此输出简化为:

\[ y = f(pWx + b) \]

由于训练时每个神经元被保留的概率为p,测试时输出乘以p,所以可以认为模型在训练和测试时输出的期望是相等的。

## 2.3 Dropout与正则化

### 2.3.1 Dropout与其他正则化技术的比较

正则化技术的目的是防止模型过拟合,而Dropout是其中一种有效的技术。与传统的正则化方法相比,如L1和L2正则化,Dropout具有以下几个优势:

- **动态正则化**:Dropout是动态的,每次迭代都会随机更改网络结构,而L1和L2正则化是静态的。

- **结构性正则化**:Dropout不仅限制了模型的权重,还促进了更加鲁棒的特征学习。

- **不需要超参数选择**:虽然Dropout率p是一个超参数,但它比L1和L2正则化参数的选择容易得多。

### 2.3.2 Dropout在不同网络结构中的应用

Dropout技术可以很容易地应用在各种类型的神经网络结构中,包括前馈神经网络、卷积神经网络(CNN)、循环神经网络(RNN)等。

在CNN中,Dropout通常被应用在全连接层,而不是卷积层,因为卷积层的参数相对较少,并且卷积操作本身就是一种有效的特征提取方法。而在RNN中,Dropout可以被应用在不同的时间步长之间,帮助模型抵抗时间序列数据的过拟合。

Dropout的引入,为深度学习领域提供了一种非常实用的正则化工具,有助于提升模型的泛化能力,从而在实际应用中取得更好的效果。随着神经网络架构的不断发展和优化,Dropout技术也在不断地适应新的挑战,并与其他技术相结合,持续推动着深度学习向前发展。

# 3. Dropout在深度学习中的实施

## 3.1 Dropout的实现方式

### 3.1.1 编程语言层面的实现

在编程语言层面,Dropout通常是通过在神经网络框架内添加随机数生成逻辑来实现的。这在Python和PyTorch或TensorFlow等库中特别常见。在训练模式中,一些节点将被随机“丢弃”,即其激活值将临时置零,而在测试时,所有节点都会参与计算。

下面是一个简单的Python代码示例,展示了在PyTorch中如何实现Dropout。这段代码定义了一个简单的神经网络层,并应用Dropout:

```python

import torch

import torch.nn as nn

import torch.nn.functional as F

class SimpleNeuralNetwork(nn.Module):

def __init__(self):

super(SimpleNeuralNetwork, self).__init__()

self.fc1 = nn.Linear(10, 50)

self.dropout = nn.Dropout(p=0.5)

self.fc2 = nn.Linear(50, 1)

def forward(self, x):

x = F.relu(self.fc1(x))

x = self.dropout(x)

x = self.fc2(x)

return x

# 创建模型

model = SimpleNeuralNetwork()

# 开启训练模式

model.train()

# 生成随机输入

input_data = torch.randn(1, 10)

# 通过模型

output = model(input_data)

# 打印输出

print(output)

# 开启测试模式,此时Dropout不会被应用

model.eval()

output = model(input_data)

print(output)

```

在这个例子中,`nn.Dropout(p=0.5)`创建了一个Dropout层,其中`p=0.5`表示有50%的概率将节点的激活值置零。`model.train()`和`model.eval()`分别用于切换模型到训练模式和评估模式。在训练模式中,Dropout会被应用,在评估模式中则不会。

### 3.1.2 框架层面的实现

在深度学习框架中,Dropout通常作为一个可配置的层提供。TensorFlow和PyTorch等框架已经内置了Dropout层,使得添加Dropout变得非常简单。

以TensorFlow为例,下面是使用Dropout的代码:

```python

import tensorflow as tf

from tensorflow.keras.layers import Dense, Dropout

from tensorflow.keras.models import Sequential

model = Sequential([

Dense(50, activation='relu', input_shape=(10,)),

Dropout(0.5),

Dense(1, activation='sigmoid')

])

# 编译模型

model.compile(optimizer='adam', loss='binary_crossentropy', metrics=['accuracy'])

# 训练模型

model.fit(X_train, y_train, epochs=10, batch_size=64, validation_split=0.2)

```

在这个例子中,

0

0