Python DB库并发控制:多线程_多进程数据库操作的最佳实践

发布时间: 2024-10-17 18:04:23 阅读量: 39 订阅数: 33

python并发编程多进程 模拟抢票实现过程

# 1. Python并发编程概述

## 并发编程的定义与重要性

并发编程是计算机科学中的一个重要领域,它允许程序同时执行多个任务,提高资源利用效率和系统吞吐量。在Python中,并发编程尤为关键,因为它可以通过多线程或异步操作来提升应用程序的性能。

## Python并发编程的挑战

Python由于其全局解释器锁(GIL)的存在,在多线程编程时面临一些挑战。尽管如此,Python提供了多进程和异步编程的丰富工具,以应对并发操作中的复杂性。

## 开始Python并发编程的第一步

作为Python开发者,可以从学习`threading`和`multiprocessing`模块开始,逐步深入理解并发编程模型。通过实践,掌握如何创建线程和进程,以及如何在它们之间协调和同步任务。

```python

import threading

def print_numbers():

for i in range(1, 6):

print(i)

time.sleep(1)

threading.Thread(target=print_numbers).start()

print("Hello from the main thread!")

```

以上代码展示了如何使用Python的`threading`模块来创建一个新线程执行任务,同时主程序继续执行,展示了并发的初步实践。

# 2. 数据库并发操作基础

### 2.1 数据库并发控制理论

#### 2.1.1 事务隔离级别

数据库事务隔离级别是并发控制的关键组成部分,它定义了事务执行过程中对其他事务的可见性。SQL标准定义了四种隔离级别,不同的隔离级别提供不同程度的并发访问保证。

- `READ UNCOMMITTED`(读未提交):最低的隔离级别,允许读取尚未提交的数据变更,可能导致脏读。

- `READ COMMITTED`(读已提交):保证一个事务只能读取已经提交的事务所做的修改,可以避免脏读,但不能防止幻读或不可重复读。

- `REPEATABLE READ`(可重复读):确保同一个事务中多次读取同样记录的结果是一致的,可防止脏读和不可重复读,但幻读仍可能发生。

- `SERIALIZABLE`(可串行化):最高的隔离级别,强制事务串行执行,避免了脏读、不可重复读和幻读。

实现不同隔离级别的开销不同。隔离级别越高,系统并发性能越低,因为要增加更多的锁和检查,以保证数据的一致性。

#### 2.1.2 锁机制

锁是数据库并发控制的主要机制之一,它可以防止多个事务同时修改同一数据。锁有多种类型和不同的粒度,用于提高并发度和保证数据一致性。

- **共享锁(Shared Lock)**:也称为读锁,多个事务可以共享一个资源,但不允许修改。

- **排他锁(Exclusive Lock)**:也称为写锁,不允许其他事务读取或修改资源。

- **意向锁(Intention Locks)**:表示事务打算对资源加共享锁或排他锁。

- **表级锁(Table Lock)**:锁定整个表,限制对表的访问。

- **行级锁(Row-level Lock)**:只锁定单行数据,提高了并发性能,但系统开销更大。

数据库的锁策略对性能和数据一致性有直接影响。系统设计时,应根据业务需求合理选择锁策略。

### 2.2 多线程与数据库操作

#### 2.2.1 Python多线程基础

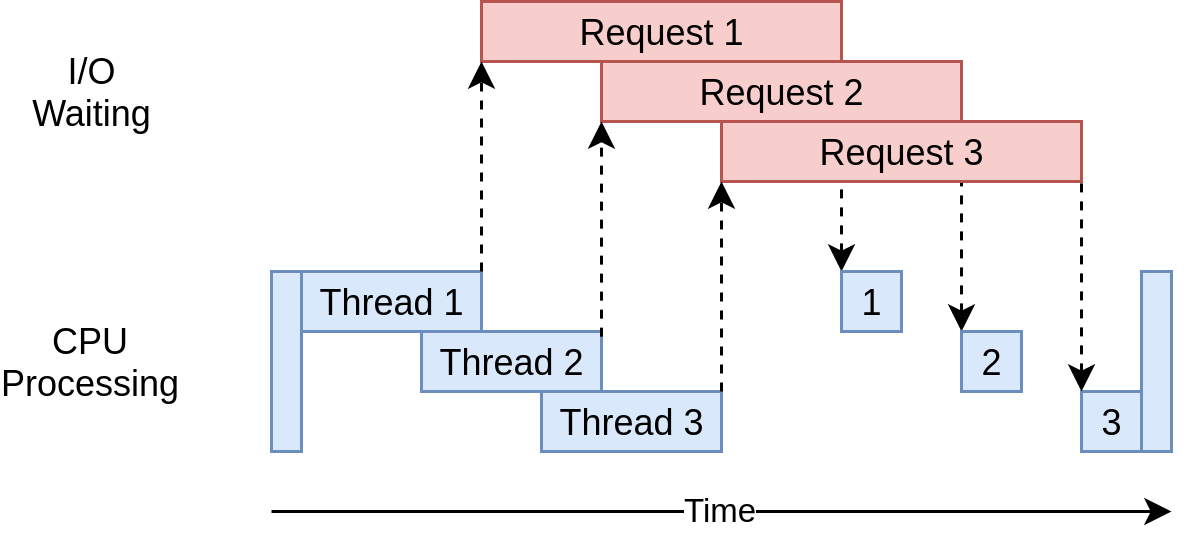

Python的`threading`模块允许开发者创建和管理线程,但它受到全局解释器锁(GIL)的限制,GIL使得同一时刻只有一个线程可以执行Python字节码。然而,对于I/O密集型任务,Python的多线程还是能带来显著的性能提升。

多线程编程中需要注意线程同步和数据共享问题。为了避免线程安全问题,开发者常用锁机制来同步线程之间的操作。

```python

import threading

# 创建锁对象

lock = threading.Lock()

def thread_function():

with lock:

# 确保锁被线程独占

print("Lock acquired via with statement")

# 创建多个线程

threads = [threading.Thread(target=thread_function) for _ in range(5)]

# 启动线程

for thread in threads:

thread.start()

# 等待所有线程完成

for thread in threads:

thread.join()

```

在这个示例中,我们创建了一个锁,并在多个线程中尝试获取锁以执行操作。`with`语句可以保证即使在发生异常时也能正确释放锁。

#### 2.2.2 多线程中的数据库操作

在多线程环境中,正确的管理数据库连接和事务是非常关键的。因为线程间的操作是并发的,如果没有适当的管理,可能会导致死锁、资源竞争等问题。

一个常用的策略是为每个线程创建独立的数据库连接,确保线程安全。在Python中,可以使用`threading.local`来保存线程特定的数据。

```python

import threading

thread_local = threading.local()

def get_db_connection():

if not hasattr(thread_local, "conn"):

thread_local.conn = create_db_connection()

return thread_local.conn

def create_db_connection():

# 创建数据库连接逻辑

pass

def perform_database_action():

conn = get_db_connection()

# 执行数据库操作

pass

# 在每个线程中使用独立的数据库连接

def thread_function():

perform_database_action()

threads = [threading.Thread(target=thread_function) for _ in range(5)]

for thread in threads:

thread.start()

```

上述代码展示了如何为每个线程提供独立的数据库连接,以避免线程间对连接的竞争。

### 2.3 多进程与数据库操作

#### 2.3.1 Python多进程基础

Python的`multiprocessing`模块可以创建进程,它们不受GIL的限制。对于CPU密集型任务,使用多进程可以有效利用多核处理器。

多进程之间的数据共享比多线程更困难,因为每个进程有自己的内存空间。进程间通信(IPC)是解决这个问题的关键。

```python

from multiprocessing import Process

def child_process_function():

# 子进程执行的函数

pass

if __name__ == "__main__":

processes = [Process(target=child_process_function) for _ in range(5)]

for process in processes:

process.start()

for process in processes:

process.join()

```

在这个示例中,创建了多个子进程,并启动和等待它们结束。在多进程程序中,使用`if __name__ == "__main__":`是为了避免在主模块加载时创建子进程。

#### 2.3.2 多进程中的数据库操作

由于每个进程有独立的内存空间,进程间直接共享数据库连接是不可能的。因此,每个进程需要独立建立数据库连接。当数据库连接作为资源被多个进程共享时,必须非常小心地管理这些连接。

例如,在某些情况下,可以使用套接字或管道(IPC方法)来实现进程间通信。Python提供`multiprocessing.Queue`和`multiprocessing.Pipe`作为IPC工具。

```python

from multiprocessing import Process, Queue

import time

def worker(queue):

conn = get_db_connection()

# 执行数据库操作并将结果发送到队列

result = perform_database_action(conn)

queue.put(result)

conn.close()

def main():

queue = Queue()

processes = [Process(target=worker, args=(queue,)) for _ in range(5)]

for process in processes:

process.start()

for process in processes:

process.join()

# 从队列获取结果

while not queue.empty():

print(queue.get())

if __name__ == "__main__":

main()

```

在这个示例中,我们使用队列在进程间传递数据库操作结果。每个进程执行数据库操作并将结果放入队列中,主进程从队列中获取结果。

在多进程与数据库操作的实践中,务必要理解Python的进程模型和进程间通信机制,以确保数据库操作既安全又有效。

# 3. Python DB库并发控制实践

在本章中,我们将深入探讨Python DB库在并发操作中的实践。包括使用线程安全的数据库库、进程间通信的实现,以及如何避免死锁和资源竞争。为了实现有效的并发控制,Python开发者需要理解并应用多种编程技巧和库,以此来保证数据库操作的安全性和效率。

## 3.1 使用线程安全的数据库库

### 3.1.1 线程锁在数据库操作中的应用

线程锁是防止多个线程同时访问共享资源造成数据不一致的机制。在数据库操作中,线程锁可以确保对数据的访问是串行的,从而避免并发写入时可能出现的问题。

```python

import threading

import queue

# 创建一个线程安全的队列用于模拟数据库操作

db_

```

0

0